Ollama 是一款开源跨平台的大模型工具,它专注于本地部署大型语言模型(LLM),旨在简化和优化大型语言模型在本地环境中的部署、管理和推理流程。

一、Ollama安装部署(修改默认位置C盘)

1.1、下载Ollama安装包

通过官网或第三方下载地址下载

官方下载页面

选择Windows版本

在下载页面,找到适用于Windows系统的安装包。Ollama通常提供.exe格式的安装程序,直接点击下载即可。

最新安装包已上传到CSDN,官网下载速度比较慢,可使用以下地址下载安装包。

OllamaSetup-0.9.6安装包资源-CSDN下载

1.2、修改安装路径,默认在C盘

默认在C盘,占用4个多GB

默认安装路径一般在:C:UsersxxxAppDataLocalProgramsOllama 进行存储的

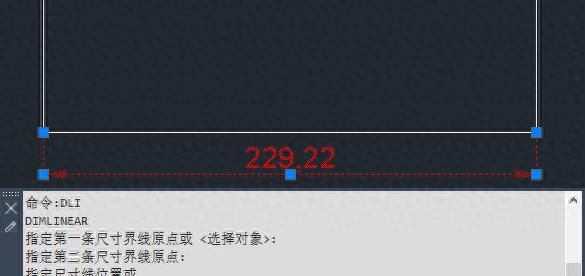

使用命令行安装:

然后在CMD窗口输入:** .OllamaSetup.exe /DIR="D:ProgramOllama"**

语法:软件名称 /DIR=这里放你上面创建好的Ollama指定安装目录

出现安装界面,点击安装、下一步

已经安装在C盘的小伙伴,想改成非C盘路径:

方法一:卸载,重新安装

方法二:不想卸载,拷贝原安装路径下文件到指定目录,更改系统变量

二、Ollama修改模型路径

Ollama对于它下载的模型(models及其配置文件)位置一般会在: C:Usersxxx.ollama 进行存储的。

1、创建模型存储目录

首先先在你想要存储的盘符下创建好存储目录,比如我想存到E盘下面,我这里就创建了该目录:E:ModelAI_Ollama_Model

然后再移动 C:Usersxxx.ollamamodels 下的所有内容到 E:ModelAI_Ollama_Model 下

2、通过软件修改或修改环境变量

方法一:增加环境变量

打开系统环境变量方法:右键开始-设置-系统-高级系统设置,或按快捷键Win+Pause/Break,或在运行对话框(通过Win + R快捷键打开)中输入sysdm.cpl后按回车键

新建一个环境变量OLLAMA_MODELS,改成你要存储模型的地址

OLLAMA_MODELS :E:ModelAI_Ollama_Model

方法二:通过软件修改

邮件任务栏,Ollama小图标,打开设置页面,修改Model location项:

迁移复制转移到新创建的大模型存储目录:

1)创建完环境变量后,把Ollama停止,然后进入C盘–>用户–>你自己的电脑名称–>.ollama–>复制整个models到刚刚上面新建的存储目录下;

2)重启Ollama,打开CMD输入Ollama list,查看大模型资源包是否能正常显示,显示正常则迁移完成,也可以直接和大模型进行提问,能回复说明也正常。如果异常的话,重启电脑再尝试;

三、Ollama常用命令

以下是 Ollama 的常用命令,涵盖模型管理、运行与基本操作

1. 模型管理

# 拉取模型(默认从Ollama库下载)

ollama pull llama2:7b

# 列出本地已下载模型

ollama list

# 删除本地模型

ollama rm llama2:7b

# 查看模型详细信息

ollama show llama2:7b

2. 启动交互对话

# 启动模型交互式对话(支持Markdown输出)

ollama run llama2:7b

# 使用系统提示词

ollama run llama2:7b "你是一个专业编程助手"

3、模型构建(自定义模型)

# 创建并构建自定义模型(基于Dockerfile语法)

echo "FROM llama2:7b

PARAMETER temperature 0.2" > Modelfile

ollama build -t my-llama

4、启动Web服务

# 启动API服务(默认端口11434)

ollama serve

# 以指定端口启动

ollama serve --port 8080

5. 导出 / 导入模型

# 运行时指定参数(如温度、最大生成长度)

ollama run llama2:7b --temperature 0.7 --max_tokens 2048

# 启用GPU加速(需支持Metal/CUDA)

ollama run llama2:7b --n-gpu-layers 32

暂无评论内容