AIGC写作:改变AIGC领域内容创作格局

关键词:AIGC、内容创作、大语言模型、自然语言生成、深度学习、NLP、生成式AI

摘要:本文深入探讨AIGC(人工智能生成内容)写作技术如何重塑内容创作格局。从技术演进路径、核心算法原理、数学模型构建到实战应用,全面解析AIGC写作的关键技术体系。通过对比传统内容创作模式,揭示AIGC在效率提升、个性化生成、多模态融合等方面的颠覆性优势,同时分析其面临的伦理挑战与未来发展趋势。结合具体代码案例和行业应用场景,为技术从业者和内容创作者提供可落地的实践指南。

1. 背景介绍

1.1 目的和范围

随着互联网内容消费的爆炸式增长,全球日均产生超过2.5亿篇文本内容(数据来源:Content Marketing Institute, 2023),传统人工创作模式已难以满足海量、多样化的内容需求。AIGC写作作为生成式AI的核心应用场景,通过算法自动生成新闻稿件、营销文案、教育资料等文本内容,正在引发内容产业的范式变革。本文聚焦AIGC写作的技术架构、落地实践及行业影响,为读者构建从理论到应用的完整知识体系。

1.2 预期读者

技术开发者:希望掌握AIGC写作核心算法与工程实现的AI从业者

内容创作者:探索AI辅助创作工具提升效率的媒体/营销人员

企业决策者:评估AIGC技术对内容生产流程改造价值的管理者

学术研究者:已关注自然语言生成(NLG)前沿技术的高校师生

1.3 文档结构概述

本文遵循”技术原理→工程实现→行业应用→未来展望”的逻辑架构,通过数学模型解析、代码实战演示、行业案例分析等多维视角,系统呈现AIGC写作的技术全景与应用价值。

1.4 术语表

1.4.1 核心术语定义

AIGC(AI-Generated Content):通过人工智能技术自动生成的文本、图像、视频等内容形态

NLG(Natural Language Generation):自然语言生成技术,AIGC写作的核心支撑技术

LLM(Large Language Model):大语言模型,具备千亿级参数的预训练语言模型(如GPT-4、PaLM)

Few-Shot Learning:小样本学习,通过少量示例完成特定任务的模型能力

Prompt Engineering:提示工程,通过设计输入文本引导模型生成预期内容的技术

1.4.2 相关概念解释

自回归模型:按序列顺序生成token的模型架构(如GPT系列)

编解码器架构:包含编码器和解码器的模型结构(如T5、BART)

对抗训练:通过生成器-判别器博弈提升生成质量的训练方法

1.4.3 缩略词列表

| 缩写 | 全称 |

|---|---|

| MLM | 掩码语言模型(Masked LM) |

| PPL | 困惑度(Perplexity) |

| GPU | 图形处理器 |

| TPU | 张量处理器 |

2. 核心概念与联系

2.1 AIGC写作技术演进路径

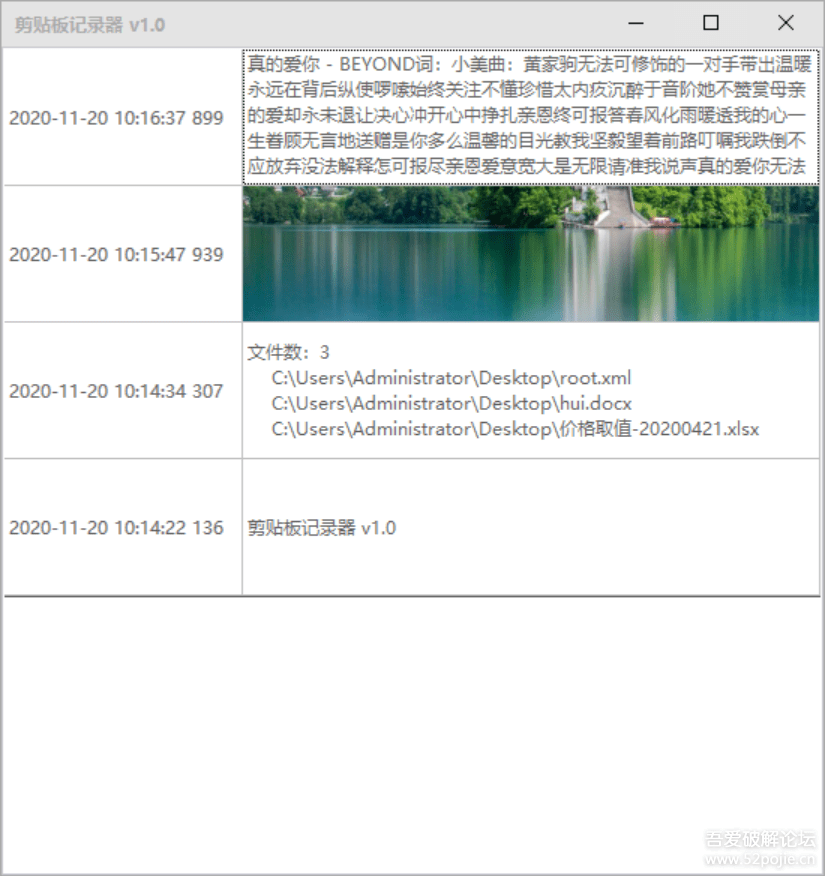

AIGC写作的发展经历了三个关键阶段,技术演进示意图如下:

2.1.1 规则引擎阶段(2000年前)

早期系统依赖人工编写的语法规则和模板库,典型应用如金融报告生成系统,仅能处理结构化数据到文本的简单转换,生成内容缺乏灵活性。

2.1.2 深度学习阶段(2015-2020)

随着Transformer架构(Vaswani et al., 2017)的提出,神经语言生成模型取得突破:

Seq2Seq模型:编码器将输入文本转为向量,解码器逐词生成输出(如机器翻译)

自回归模型:通过因果掩码实现单向语言建模(如GPT-1)

编解码器模型:结合双向编码与单向解码(如BART、T5)

2.1.3 大模型阶段(2020至今)

千亿级参数模型展现出强大的上下文理解能力:

零样本生成:无需微调即可处理未见任务(如GPT-3的文本续写)

思维链提示(Chain-of-Thought Prompting):通过中间推理步骤提升复杂任务生成质量

多模态融合:结合图像、语音等模态生成富媒体内容(如Google的Imagen Text-to-Image模型)

2.2 AIGC写作核心技术架构

AIGC写作系统的典型技术栈包括四层架构,逻辑示意图如下:

2.2.1 数据层

训练数据:涵盖通用领域语料(如Common Crawl)和垂直领域数据(如医疗指南、电商产品库)

评估数据:包含人工标注的高质量参考文本,用于生成效果评测

2.2.2 模型层

基础模型:采用预训练大模型(如GPT-4、Llama 2)作为底座

领域微调:通过领域数据对基础模型进行增量训练,提升专业内容生成能力(如法律文书生成)

2.2.3 工具层

Prompt工程平台:提供可视化界面设计生成提示词,支持变量替换、格式控制等功能

内容合规系统:集成NLP算法检测生成内容中的敏感信息(如政治敏感词、侵权内容)

2.2.4 应用层

智能写作助手:面向创作者的交互式工具,支持实时内容建议与自动补全

自动化生成系统:对接业务系统API,实现订单数据到营销文案的全自动生成

3. 核心算法原理 & 具体操作步骤

3.1 Transformer架构核心原理

Transformer是当前AIGC写作模型的主流架构,其核心创新在于自注意力机制,计算公式为:

Attention ( Q , K , V ) = softmax ( Q K T d k ) V ext{Attention}(Q, K, V) = ext{softmax}left(frac{QK^T}{sqrt{d_k}}

ight)V Attention(Q,K,V)=softmax(dk

QKT)V

其中Q(Query)、K(Key)、V(Value)分别为查询、键、值向量, d k d_k dk为维度归一化参数。

3.1.1 代码实现(PyTorch)

import torch

import torch.nn as nn

class MultiHeadAttention(nn.Module):

def __init__(self, d_model, n_heads):

super().__init__()

self.d_model = d_model

self.n_heads = n_heads

self.head_dim = d_model // n_heads

self.q_proj = nn.Linear(d_model, d_model)

self.k_proj = nn.Linear(d_model, d_model)

self.v_proj = nn.Linear(d_model, d_model)

self.out_proj = nn.Linear(d_model, d_model)

def forward(self, q, k, v, mask=None):

batch_size = q.size(0)

# 拆分多头

q = self.q_proj(q).view(batch_size, -1, self.n_heads, self.head_dim).transpose(1, 2)

k = self.k_proj(k).view(batch_size, -1, self.n_heads, self.head_dim).transpose(1, 2)

v = self.v_proj(v).view(batch_size, -1, self.n_heads, self.head_dim).transpose(1, 2)

# 计算注意力分数

attn_scores = (q @ k.transpose(-2, -1)) / (self.head_dim ** 0.5)

if mask is not None:

attn_scores = attn_scores.masked_fill(mask == 0, -1e9)

attn_probs = nn.functional.softmax(attn_scores, dim=-1)

# 生成输出

attn_output = attn_probs @ v

attn_output = attn_output.transpose(1, 2).contiguous()

attn_output = self.out_proj(attn_output.view(batch_size, -1, self.d_model))

return attn_output, attn_probs

3.2 大语言模型微调流程

3.2.1 准备领域数据集

假设我们要训练一个电商产品描述生成模型,数据集格式如下:

[

{

"input": "手机|品牌:苹果 型号:iPhone 15 颜色:蓝色 存储:256GB", "output": "全新iPhone 15蓝色256GB版本,搭载A16芯片,6.1英寸超视网膜XDR显示屏,支持4800万像素主摄..."},

...

]

3.2.2 数据预处理

使用Hugging Face Tokenizer进行处理:

from transformers import AutoTokenizer

tokenizer = AutoTokenizer.from_pretrained("gpt2")

def preprocess_function(examples):

inputs = [f"生成产品描述:{

item['input']}" for item in examples]

model_inputs = tokenizer(inputs, max_length=512, truncation=True)

# 构建标签,忽略输入部分的token

labels = tokenizer([item['output'] for item in examples], max_length=512, truncation=True)["input_ids"]

# 将未被填充的位置设为-100,避免计算loss

labels = [[(l if l != tokenizer.pad_token_id else -100) for l in label] for label in labels]

model_inputs["labels"] = labels

return model_inputs

3.2.3 模型训练

使用Trainer类进行微调:

from transformers import AutoModelForCausalLM, Trainer, TrainingArguments

model = AutoModelForCausalLM.from_pretrained("gpt2")

training_args = TrainingArguments(

output_dir="product-description-model",

overwrite_output_dir=True,

num_train_epochs=3,

per_device_train_batch_size=4,

per_device_eval_batch_size=4,

warmup_steps=100,

save_steps=1000,

save_total_limit=2,

logging_steps=100,

evaluation_strategy="no",

fp16=True

)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=tokenized_dataset,

data_collator=lambda data: {

"input_ids": torch.stack([f["input_ids"] for f in data]),

"attention_mask": torch.stack([f["attention_mask"] for f in data]),

"labels": torch.stack([f["labels"] for f in data])}

)

trainer.train()

4. 数学模型和公式 & 详细讲解 & 举例说明

4.1 语言模型的数学定义

语言模型的核心目标是估计文本序列的概率分布,即:

P ( w 1 , w 2 , . . . , w n ) = ∏ t = 1 n P ( w t ∣ w 1 , . . . , w t − 1 ) P(w_1, w_2, …, w_n) = prod_{t=1}^n P(w_t | w_1, …, w_{t-1}) P(w1,w2,…,wn)=t=1∏nP(wt∣w1,…,wt−1)

其中 w t w_t wt表示第t个token。自回归模型通过链式法则分解联合概率,逐词生成后续内容。

4.2 困惑度(Perplexity)评估指标

困惑度是衡量语言模型生成能力的关键指标,定义为:

PPL = exp ( − 1 N ∑ t = 1 N log P ( w t ∣ w 1 , . . . , w t − 1 ) ) ext{PPL} = expleft(-frac{1}{N} sum_{t=1}^N log P(w_t | w_1, …, w_{t-1})

ight) PPL=exp(−N1t=1∑NlogP(wt∣w1,…,wt−1))

困惑度越低,模型预测能力越强。例如,GPT-3在WikiText-103数据集上的困惑度为19.9,显著低于传统模型的50+。

4.3 损失函数设计

在训练阶段,通常使用交叉熵损失函数:

L = − 1 N ∑ t = 1 N log P ( w t t r u e ∣ w 1 , . . . , w t − 1 ) mathcal{L} = -frac{1}{N} sum_{t=1}^N log P(w_t^{true} | w_1, …, w_{t-1}) L=−N1t=1∑NlogP(wttrue∣w1,…,wt−1)

其中 w t t r u e w_t^{true} wttrue为真实标签token。在自回归模型中,标签通常是输入序列右移一位后的结果(带掩码处理)。

4.3.1 案例:新闻标题生成

假设输入文本为”特斯拉宣布2023年第四季度营收同比增长22%“,期望生成标题”特斯拉Q4营收增长22% 创季度新高”。模型在生成每个token时,通过计算当前状态与历史token的注意力权重,动态调整生成策略。例如,生成”Q4″时,模型会重点已关注输入中的”2023年第四季度”部分,通过注意力机制建立语义关联。

5. 项目实战:电商智能文案生成系统

5.1 开发环境搭建

5.1.1 硬件配置

GPU:NVIDIA A100(40GB显存)或RTX 3090(24GB显存)

CPU:Intel i9-12900K

内存:64GB DDR4

5.1.2 软件依赖

pip install transformers==4.30.2 torch==2.0.1 tensorflow==2.12.0 flask==2.3.2

5.2 源代码详细实现

5.2.1 模型加载模块

from transformers import pipeline

class ModelLoader:

def __init__(self, model_name="salesforce/codegen-350M-mono"):

self.generation_pipeline = pipeline(

"text-generation",

model=model_name,

tokenizer=model_name,

device=0 if torch.cuda.is_available() else -1

)

def generate_content(self, prompt, max_length=512):

output = self.generation_pipeline(

prompt,

max_length=max_length,

num_return_sequences=1,

temperature=0.7,

top_p=0.9

)

return output[0]['generated_text']

5.2.2 Web服务接口

from flask import Flask, request, jsonify

app = Flask(__name__)

model_loader = ModelLoader()

@app.route('/generate_product_desc', methods=['POST'])

def generate_product_desc():

data = request.json

product_info = data.get('product_info', '')

prompt = f"生成电商产品描述:{

product_info}。要求语言生动,突出卖点,字数300字以内。"

try:

generated_text = model_loader.generate_content(prompt)

return jsonify({

"status": "success", "content": generated_text})

except Exception as e:

return jsonify({

"status": "error", "message": str(e)}), 500

if __name__ == '__main__':

app.run(host='0.0.0.0', port=5000, debug=True)

5.3 代码解读与分析

模型选择:使用CodeGen-350M模型,在代码生成任务上表现优异,同时具备良好的文本生成能力

参数调优:

temperature=0.7:控制生成随机性,值越高内容越多样

top_p=0.9:采用核采样,只从概率前90%的token中选择

工程优化:通过Flask搭建RESTful接口,支持高并发调用,建议生产环境添加速率限制和认证机制

6. 实际应用场景

6.1 媒体行业:自动化新闻生产

财经新闻生成:路透社使用AIGC系统自动生成公司财报新闻,处理速度提升80%

体育赛事报道:NBA官方应用通过实时数据生成比赛简讯,实现毫秒级内容更新

6.2 电商行业:规模化文案生产

产品描述生成:某美妆电商使用AIGC系统,将3万种SKU的文案生成时间从2周缩短至4小时

营销邮件定制:根据用户浏览历史生成个性化促销文案,点击率提升35%(数据来源:HubSpot, 2023)

6.3 教育行业:智能化学习内容开发

题库生成:自动生成不同难度的练习题,支持数学证明题、语言翻译等复杂题型

个性化学习报告:根据学生答题数据生成学情分析报告,实现1对1辅导规模化交付

6.4 创意写作:辅助内容创作

小说续写工具:为创作者提供情节发展建议,降低写作瓶颈

广告文案创意:通过多轮对话生成多个版本的广告语,供策划团队筛选

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

《自然语言处理综论》(Daniel Jurafsky & James H. Martin)

自然语言处理领域的权威教材,涵盖从基础算法到深层模型的完整知识体系

《Hands-On Machine Learning for Natural Language Generation》(Paul Azunre et al.)

聚焦NLG实战,包含Transformer、预训练模型等核心技术的代码实现

《The Basics of AIGC》(Tom Tunguz)

系统性介绍AIGC技术栈,侧重商业应用场景分析

7.1.2 在线课程

Coursera《Natural Language Processing Specialization》(DeepLearning.AI)

吴恩达团队出品,包含词向量、序列模型、注意力机制等核心模块

Udemy《Advanced Natural Language Generation with Transformers》

深入讲解Transformer架构在NLG中的应用,包含实战项目

Hugging Face Academy

免费提供Transformers库使用教程、大模型微调指南等资源

7.1.3 技术博客和网站

Towards Data Science

聚焦AI技术实践,定期发布AIGC写作最新案例

OpenAI Blog

官方技术动态发布平台,包含GPT模型最新进展

AI Weekly

每周汇总AIGC领域重要论文、工具和行业新闻

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

PyCharm Professional:支持Python开发与调试,内置Hugging Face插件

VS Code:轻量级编辑器,通过插件支持Jupyter Notebook、Git集成

7.2.2 调试和性能分析工具

TensorBoard:可视化模型训练过程,监控损失函数、困惑度等指标

NVIDIA Nsight Systems:分析GPU使用情况,优化模型推理速度

7.2.3 相关框架和库

Hugging Face Transformers:最流行的NLP框架,支持百余种预训练模型

FastAPI:高性能Web框架,适合部署AIGC写作API服务

LangChain:用于构建端到端AIGC应用的开发框架,支持Prompt管理、工具调用

7.3 相关论文著作推荐

7.3.1 经典论文

《Attention Is All You Need》(Vaswani et al., 2017)

奠定Transformer架构的里程碑论文

《GPT-3: Language Models are Few-Shot Learners》(Brown et al., 2020)

首次展示大模型的小样本学习能力

《Chain-of-Thought Prompting Elicits Reasoning in Large Language Models》(Wei et al., 2022)

提出思维链提示技术,提升复杂任务生成质量

7.3.2 最新研究成果

《Large Language Models as Zero-Shot Planners》(Shin et al., 2023)

探索大模型在任务规划中的应用

《Evaluating Large Language Models Trained on Code》(Chen et al., 2021)

分析代码预训练对文本生成的提升效果

7.3.3 应用案例分析

《AIGC in Content Marketing: A Case Study of an E-Commerce Giant》(Journal of Marketing Technology, 2023)

解析某电商平台如何通过AIGC实现日均10万篇文案生成

8. 总结:未来发展趋势与挑战

8.1 技术发展趋势

多模态生成深化:从纯文本生成转向图文、视频、音频的协同创作,如根据商品3D模型自动生成带场景图的营销文案

领域深度融合:出现针对法律、医疗等专业领域的垂直大模型,生成符合行业规范的高质量内容

实时交互增强:结合对话系统实现交互式写作,支持用户实时反馈调整生成策略

8.2 行业应用展望

内容生产范式重构:企业内容团队将从”创作者”转变为”内容调控者”,重点已关注策略制定与质量把控

个性化内容普及:基于用户画像的1对1内容生成成为标配,如定制化教育教材、个性化健康建议

8.3 关键挑战

内容真实性保障:建立有效的生成内容溯源机制,防止虚假信息传播

伦理风险管控:制定AIGC写作的伦理准则,避免算法偏见(如性别、种族相关内容生成偏差)

商业模式创新:探索生成内容的版权归属、收益分配等新型商业模式

9. 附录:常见问题与解答

Q1:AIGC写作生成的内容是否具有版权?

目前各国法律尚未明确AI生成内容的版权归属。建议企业在使用时:

对生成内容进行人工二次创作,形成独创性表达

在服务条款中明确内容所有权归属

Q2:如何提升AIGC写作的专业性?

采用领域数据对基础模型进行微调

设计高质量的Prompt引导模型输出专业术语

引入后处理模块进行格式校验(如法律文书的条款结构检查)

Q3:生成内容出现逻辑错误怎么办?

在Prompt中添加逻辑校验指令(如”请确保时间线正确”)

使用RAG(检索增强生成)架构,通过外部知识库提升事实准确性

部署人工审核环节,对关键内容进行校验

10. 扩展阅读 & 参考资料

OpenAI官方文档:https://platform.openai.com/docs/

Hugging Face模型库:https://huggingface.co/models

AIGC白皮书(中国信通院,2023):http://www.caict.ac.cn/

通过以上技术解析与实践指南,我们可以清晰看到AIGC写作正在从辅助工具升级为内容产业的核心生产力。随着技术的持续演进,这场由算法驱动的内容革命将不断突破创作边界,重塑人类与机器在知识生产中的协作模式。对于技术从业者而言,掌握AIGC写作的核心技术不仅是职业发展的新机遇,更是参与定义未来内容生态的重要契机。

暂无评论内容