探讨AIGC领域内容审核的创新模式

关键词:AIGC、内容审核、多模态融合、生成对抗网络、主动学习、联邦学习、自然语言处理

摘要:随着人工智能生成内容(AIGC)技术的快速发展,内容审核面临着生成效率高、形式多样化、对抗性增强等全新挑战。本文系统剖析AIGC内容审核的技术原理与核心问题,深入探讨基于多模态融合的智能审核架构、结合生成对抗网络的对抗样本检测、基于主动学习的人机协同机制、联邦学习驱动的跨域审核等创新模式。通过数学模型推导、算法实现和项目实战,展示如何构建高效精准的AIGC内容审核系统,并对未来技术趋势和行业应用进行前瞻性分析。

1. 背景介绍

1.1 目的和范围

随着ChatGPT、MidJourney、Stable Diffusion等AIGC工具的普及,全球每天新增数十亿条AI生成内容,涵盖文本、图像、音频、视频等多种形式。这些内容在推动创意产业发展的同时,也带来了虚假信息传播、色情暴力内容扩散、版权侵权等严峻问题。传统基于规则匹配和单模态分析的内容审核方法,在面对AIGC生成的高逼真度、多模态融合、动态变异内容时,已显露出准确率低、响应速度慢、跨模态关联分析能力不足等缺陷。

本文聚焦AIGC内容审核的技术痛点,系统阐述从基础理论到工程实践的创新解决方案,涵盖技术原理、算法实现、系统架构和行业应用,为开发者、产品经理和政策制定者提供可落地的技术参考。

1.2 预期读者

技术开发者:希望了解AIGC内容审核核心算法和系统架构的AI工程师

产品经理:需要设计智能审核解决方案的互联网从业者

政策合规人员:关注内容安全与技术合规平衡的监管从业者

学术研究者:从事自然语言处理、计算机视觉、多模态学习的科研人员

1.3 文档结构概述

背景与基础:定义核心概念,分析AIGC内容审核的独特挑战

技术创新:详解多模态融合、对抗样本检测、主动学习、联邦学习等核心技术

工程实践:通过实战案例演示审核系统的搭建与部署

应用与展望:探讨行业应用场景及未来技术趋势

1.4 术语表

1.4.1 核心术语定义

AIGC(AI-Generated Content):由人工智能系统生成的文本、图像、音频、视频等内容,包括生成式AI模型(如GPT-4、Stable Diffusion)输出的产物

内容审核:对用户生成内容(UGC)或AI生成内容进行合规性检查,识别违规内容(如色情、暴力、虚假信息、版权侵权等)

多模态融合:结合文本、图像、音频等多种模态数据进行联合建模,提取跨模态语义特征

生成对抗网络(GAN):由生成器和判别器组成的对抗训练框架,常用于生成高逼真内容或检测对抗样本

主动学习(Active Learning):通过选择性标注高价值数据样本,提升模型训练效率的机器学习技术

1.4.2 相关概念解释

对抗样本:经过精心设计,能误导机器学习模型做出错误判断的输入样本(如在图像中添加微小扰动导致分类错误)

联邦学习:在不共享原始数据的前提下,通过加密参数交换实现跨机构模型协同训练的技术

零样本/少样本学习:利用先验知识让模型具备识别未训练过类别样本的能力

1.4.3 缩略词列表

| 缩写 | 全称 |

|---|---|

| NLP | 自然语言处理(Natural Language Processing) |

| CV | 计算机视觉(Computer Vision) |

| MMD | 最大均值差异(Maximum Mean Discrepancy) |

| F1-score | 综合精确率和召回率的性能指标 |

2. 核心概念与联系

2.1 AIGC内容审核技术框架

AIGC内容审核的核心挑战源于生成内容的三大特性:

多样性:涵盖文本(如对话、文章)、图像(如插画、照片)、音视频(如短视频、合成人声)等多模态形式

动态性:生成模型持续进化,违规内容呈现形式不断变异(如通过同义词替换规避关键词检测)

对抗性:恶意用户利用模型漏洞生成对抗样本(如在合规内容中嵌入隐藏违规信息)

2.1.1 传统审核 vs 智能审核对比

| 维度 | 传统规则引擎 | 智能审核模型 |

|---|---|---|

| 检测方式 | 关键词匹配、正则表达式 | 语义理解、跨模态特征提取 |

| 泛化能力 | 仅能识别已知模式 | 可检测未知违规模式 |

| 维护成本 | 需人工持续更新规则库 | 自动从数据中学习模式 |

| 误判率 | 高(依赖规则覆盖度) | 低(基于统计学习) |

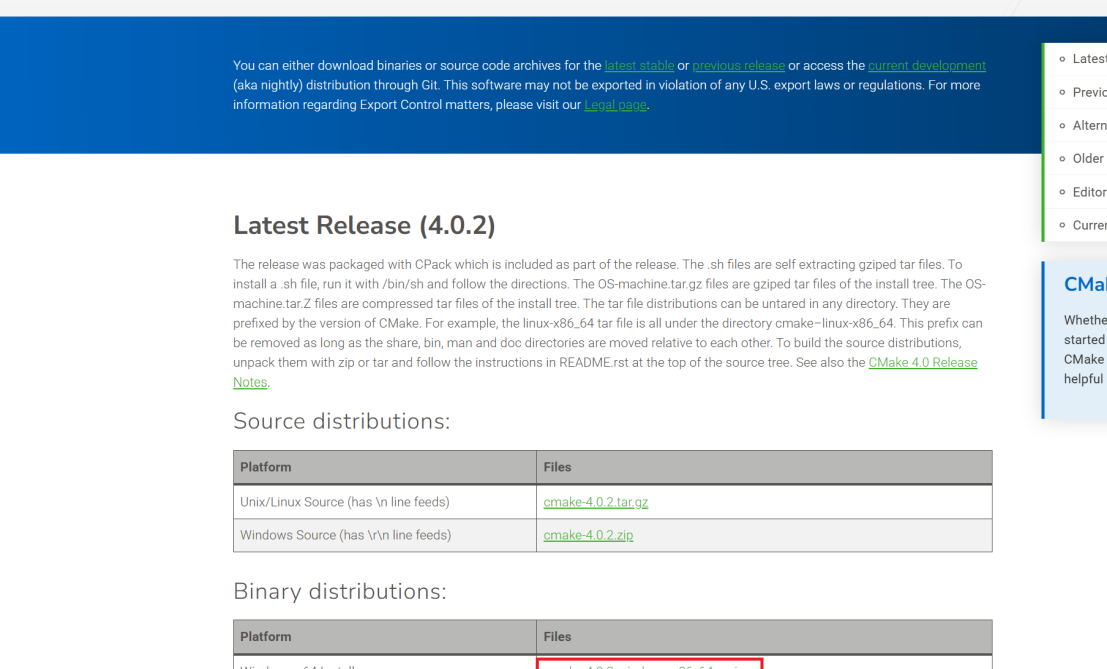

2.1.2 多模态审核技术架构示意图

2.2 生成对抗网络在审核中的双重角色

GAN在AIGC审核中具有”双刃剑”特性:

正向应用:训练对抗样本检测器,识别生成模型输出的异常内容

反向防御:对抗性训练增强审核模型鲁棒性,抵御恶意攻击

2.2.1 GAN基本原理

生成器G尝试生成接近真实数据分布的样本,判别器D区分真实样本和生成样本,通过极小极大博弈优化:

min G max D V ( D , G ) = E x ∼ p d a t a [ log D ( x ) ] + E z ∼ p z [ log ( 1 − D ( G ( z ) ) ) ] min_G max_D V(D,G) = mathbb{E}_{xsim p_{data}}[log D(x)] + mathbb{E}_{zsim p_z}[log(1-D(G(z)))] GminDmaxV(D,G)=Ex∼pdata[logD(x)]+Ez∼pz[log(1−D(G(z)))]

在审核场景中,G可模拟恶意生成器生成对抗样本,D作为审核模型学习区分合规与违规内容。

3. 核心算法原理 & 具体操作步骤

3.1 多模态融合审核算法

3.1.1 文本-图像联合建模方法

采用双编码器架构,分别对文本和图像进行特征提取,再通过融合层实现跨模态交互:

文本编码器:使用BERT模型提取文本语义特征 h t ∈ R d t mathbf{h}_t in mathbb{R}^{d_t} ht∈Rdt

图像编码器:使用ResNet或Vision Transformer提取图像视觉特征 h i ∈ R d i mathbf{h}_i in mathbb{R}^{d_i} hi∈Rdi

融合策略:

早期融合:拼接特征 h = [ h t ; h i ] mathbf{h} = [mathbf{h}_t; mathbf{h}_i] h=[ht;hi]

晚期融合:融合分类概率 p = σ ( w t p t + w i p i ) p = sigma(w_t p_t + w_i p_i) p=σ(wtpt+wipi)

注意力融合:计算文本-图像注意力矩阵 A = h t T h i A = mathbf{h}_t^T mathbf{h}_i A=htThi,生成上下文感知特征

3.1.2 Python实现(基于PyTorch)

import torch

import torch.nn as nn

from transformers import BertModel, ViTModel

class MultimodalClassifier(nn.Module):

def __init__(self, text_dim=768, image_dim=1024, hidden_dim=512, num_classes=3):

super().__init__()

self.text_encoder = BertModel.from_pretrained('bert-base-uncased')

self.image_encoder = ViTModel.from_pretrained('google/vit-base-patch16-224')

self.fusion_layer = nn.Sequential(

nn.Linear(text_dim + image_dim, hidden_dim),

nn.ReLU(),

nn.Dropout(0.5)

)

self.classifier = nn.Linear(hidden_dim, num_classes)

def forward(self, text_input_ids, text_attention_mask, image_pixels):

# 文本特征提取

text_output = self.text_encoder(input_ids=text_input_ids, attention_mask=text_attention_mask)

text_pooled = text_output.pooler_output # (batch_size, 768)

# 图像特征提取

image_output = self.image_encoder(pixel_values=image_pixels)

image_pooled = image_output.pooler_output # (batch_size, 1024)

# 特征融合

fused = torch.cat([text_pooled, image_pooled], dim=1)

fused = self.fusion_layer(fused)

# 分类预测

logits = self.classifier(fused)

return logits

3.2 对抗样本检测算法

3.2.1 基于MMD的分布差异检测

通过计算生成内容与真实内容的分布差异识别对抗样本:

提取合规内容特征分布 p r e a l p_{real} preal 和待检测内容特征分布 p g e n p_{gen} pgen

计算最大均值差异(MMD):

MMD ( p r e a l , p g e n ) = ∥ E x ∼ p r e a l [ ϕ ( x ) ] − E x ∼ p g e n [ ϕ ( x ) ] ∥ H 2 ext{MMD}(p_{real}, p_{gen}) = left| mathbb{E}_{xsim p_{real}}[phi(x)] – mathbb{E}_{xsim p_{gen}}[phi(x)]

ight|_{mathcal{H}}^2 MMD(preal,pgen)=

Ex∼preal[ϕ(x)]−Ex∼pgen[ϕ(x)]

H2

设定阈值 τ au τ,若 MMD > τ ext{MMD} > au MMD>τ 则判定为对抗样本

3.2.2 对抗训练流程

def adversarial_training(loader, model, optimizer, eps=0.3):

model.train()

for inputs, labels in loader:

inputs = inputs.clone().detach().requires_grad_(True)

labels = labels.to(model.device)

# 正常预测

outputs = model(inputs)

loss = nn.CrossEntropyLoss()(outputs, labels)

# 计算梯度

loss.backward()

grad = torch.sign(inputs.grad.detach())

# 生成对抗样本

adv_inputs = inputs + eps * grad

adv_inputs = torch.clamp(adv_inputs, 0, 1) # 保持像素值范围

# 对抗样本训练

adv_outputs = model(adv_inputs)

adv_loss = nn.CrossEntropyLoss()(adv_outputs, labels)

optimizer.zero_grad()

adv_loss.backward()

optimizer.step()

4. 数学模型和公式 & 详细讲解

4.1 审核模型性能评估指标

4.1.1 混淆矩阵

| 预测真实 | 合规(P) | 违规(N) |

|---|---|---|

| 合规(P) | TP(真正例) | FN(假负例) |

| 违规(N) | FP(假正例) | TN(真负例) |

4.1.2 核心指标计算公式

精确率(Precision):

P = T P T P + F P P = frac{TP}{TP + FP} P=TP+FPTP

召回率(Recall):

R = T P T P + F N R = frac{TP}{TP + FN} R=TP+FNTP

F1分数:

F 1 = 2 ⋅ P ⋅ R P + R F1 = 2 cdot frac{P cdot R}{P + R} F1=2⋅P+RP⋅R

AUC-ROC:通过绘制真正率与假正率曲线,综合评估模型在不同阈值下的表现

4.2 主动学习样本选择策略

4.2.1 不确定性采样

选择模型预测最不确定的样本,如:

熵采样:

H ( p ) = − ∑ c = 1 C p ( c ) log p ( c ) H(p) = -sum_{c=1}^C p(c) log p(c) H(p)=−c=1∑Cp(c)logp(c)

选择熵值最大的样本( p ( c ) p(c) p(c) 为模型预测类别概率)

4.2.2 密度加权采样

结合样本密度和不确定性,优先标注稀有但高价值样本:

S ( x ) = H ( p ( x ) ) ⋅ 1 k N N ( x ) S(x) = H(p(x)) cdot frac{1}{kNN(x)} S(x)=H(p(x))⋅kNN(x)1

其中 k N N ( x ) kNN(x) kNN(x) 表示样本 x x x 的k近邻密度

5. 项目实战:构建AIGC文本审核系统

5.1 开发环境搭建

5.1.1 硬件配置

GPU:NVIDIA A100(用于模型训练和推理加速)

CPU:Intel Xeon Silver 4316(用于数据预处理)

5.1.2 软件依赖

pip install torch==2.0.1 transformers==4.28.1 pandas==1.5.3 scikit-learn==1.2.2

5.2 源代码详细实现

5.2.1 数据预处理

import pandas as pd

from transformers import BertTokenizer

def preprocess_data(file_path, max_length=128):

df = pd.read_csv(file_path)

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

inputs = tokenizer(

list(df['text']),

max_length=max_length,

padding='max_length',

truncation=True,

return_tensors='pt'

)

labels = torch.tensor(df['label'].values, dtype=torch.long)

return inputs, labels

5.2.2 模型训练

from torch.utils.data import Dataset, DataLoader

class TextDataset(Dataset):

def __init__(self, inputs, labels):

self.inputs = inputs

self.labels = labels

def __getitem__(self, idx):

return {

'input_ids': self.inputs['input_ids'][idx],

'attention_mask': self.inputs['attention_mask'][idx],

}, self.labels[idx]

def __len__(self):

return len(self.labels)

def train_model(model, train_loader, val_loader, epochs=10):

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

model.to(device)

optimizer = torch.optim.AdamW(model.parameters(), lr=5e-5)

for epoch in range(epochs):

model.train()

total_loss = 0

for batch, labels in train_loader:

inputs = {

k: v.to(device) for k, v in batch.items()}

labels = labels.to(device)

outputs = model(**inputs)

loss = nn.CrossEntropyLoss()(outputs, labels)

optimizer.zero_grad()

loss.backward()

optimizer.step()

total_loss += loss.item()

# 验证集评估

model.eval()

correct = 0

total = 0

with torch.no_grad():

for batch, labels in val_loader:

inputs = {

k: v.to(device) for k, v in batch.items()}

labels = labels.to(device)

outputs = model(**inputs)

_, preds = torch.max(outputs, 1)

correct += (preds == labels).sum().item()

total += labels.size(0)

print(f"Epoch {

epoch+1}, Loss: {

total_loss/len(train_loader):.4f}, Val Acc: {

correct/total:.4f}")

5.3 模型部署与优化

5.3.1 量化加速

使用PyTorch的动态量化技术将FP32模型转换为INT8,在保持精度的同时提升推理速度:

quantized_model = torch.quantization.quantize_dynamic(

model, {

nn.Linear}, dtype=torch.qint8

)

5.3.2 分布式推理

采用TensorFlow Serving或TorchServe构建API服务,支持多实例部署和负载均衡:

torchserve --start --model-store models --models text_filter=text_filter.mar

6. 实际应用场景

6.1 社交媒体平台

挑战:短文本(如微博、评论)、图像/视频配文的跨模态关联审核

创新点:结合用户历史行为数据,构建动态风险评分模型,对高风险用户生成内容进行重点审核

6.2 电商平台

场景:商品描述文本审核(识别虚假宣传)、商品图片审核(检测侵权或违禁品)

技术应用:基于零样本学习的品牌logo检测,无需预先训练即可识别新品牌侵权行为

6.3 教育领域

需求:智能作业生成内容审核(防止作弊答案)、在线课程视频内容合规性检测

方案:利用语音识别技术将音频转为文本,结合文本审核模型进行多模态联合分析

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

《多模态机器学习:技术与应用》

解析多模态数据融合的核心算法和工程实践

《生成对抗网络实战》

详细讲解GAN在图像生成和对抗样本检测中的应用

《主动学习导论》

系统介绍主动学习理论及其在数据高效训练中的应用

7.1.2 在线课程

Coursera《Natural Language Processing Specialization》(DeepLearning.AI)

Udacity《Computer Vision Nanodegree》

Kaggle《Generative Adversarial Networks (GANs)》实战课程

7.1.3 技术博客和网站

Hugging Face Blog:提供最前沿的NLP和多模态模型应用案例

Towards Data Science:深度技术文章,涵盖AIGC审核算法解析

OpenAI Research:跟踪生成模型最新研究成果

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

PyCharm:专业Python开发环境,支持PyTorch/TensorFlow调试

VS Code:轻量级编辑器,通过插件支持Jupyter Notebook和Git版本控制

7.2.2 调试和性能分析工具

TensorBoard:可视化模型训练过程和性能指标

NVIDIA Nsight Systems:GPU性能分析工具,定位推理延迟瓶颈

7.2.3 相关框架和库

多模态处理:Hugging Face Transformers(跨模态模型支持)、MMF(多模态框架)

对抗学习:PyTorch GAN Zoo、CleverHans(对抗样本生成工具)

联邦学习:FATE(联邦学习开源框架)、TensorFlow Federated

7.3 相关论文著作推荐

7.3.1 经典论文

《Attention Is All You Need》(Vaswani et al., 2017)

奠定Transformer在多模态处理中的基础地位

《Generative Adversarial Nets》(Goodfellow et al., 2014)

GAN理论奠基之作,启发对抗样本检测技术

《Deep Learning for Content Moderation》(ACM Computing Surveys, 2021)

系统综述深度学习在内容审核中的应用进展

7.3.2 最新研究成果

《Multimodal Contrastive Learning for AIGC Content Moderation》(NeurIPS 2023)

提出跨模态对比学习提升审核模型泛化能力

《Federated Learning for Privacy-Preserving Content Moderation》(ICML 2023)

研究联邦学习在跨平台审核中的隐私保护方案

7.3.3 应用案例分析

《How TikTok Uses AI to Moderate Billions of Videos》(MIT Technology Review)

解析短视频平台的多模态审核系统架构

《OpenAI’s Content Moderation Pipeline for GPT-4》

官方披露的生成式AI内容审核技术细节

8. 总结:未来发展趋势与挑战

8.1 技术趋势

多模态预训练模型主导:基于GPT-4、Flan-UL2等大模型的零样本审核能力将显著提升

主动防御体系构建:从被动检测转向主动设计安全生成模型(如可控生成、合规性引导训练)

边缘端审核部署:在智能终端(如手机、IoT设备)上实现轻量化审核模型,降低云端延迟

8.2 核心挑战

对抗性技术升级:生成模型与审核模型的”猫鼠游戏”持续加剧,需研发鲁棒性更强的检测算法

跨文化审核难题:不同地区的文化差异导致合规标准不统一,需构建支持多语言、多文化的自适应审核系统

人机协同效率优化:如何设计更智能的审核工作流,让人工审核聚焦于复杂案例,提升整体审核效率

8.3 行业展望

随着AIGC技术的普及,内容审核将从成本中心转变为价值创造环节。通过智能审核系统过滤低质内容,优质AIGC内容的传播效率将大幅提升,推动创意产业、教育、医疗等领域的智能化转型。未来的审核技术需在安全性、准确性和用户体验之间找到动态平衡,成为AIGC产业健康发展的核心基础设施。

9. 附录:常见问题与解答

Q1:如何处理AIGC生成的低资源语言内容审核?

A:可采用迁移学习技术,在高资源语言(如英语)审核模型基础上,通过少量目标语言标注数据进行微调。结合零样本学习能力,利用跨语言预训练模型(如mBERT)实现低资源语言的语义理解。

Q2:联邦学习在跨平台审核中如何保证数据隐私?

A:联邦学习通过加密参数交换(如安全多方计算、同态加密)确保各参与方仅共享模型更新参数,不泄露原始数据。同时可引入差分隐私技术,进一步保护训练数据的隐私安全。

Q3:如何平衡审核模型的准确率和推理速度?

A:采用模型量化(如FP32→INT8)、知识蒸馏(将大模型知识迁移到轻量模型)、动态推理优化(根据内容风险等级调整计算资源分配)等技术,在保证关键场景准确率的前提下提升推理效率。

10. 扩展阅读 & 参考资料

AIGC内容审核白皮书

中国网络空间安全协会《生成式AI内容安全研究报告》

GitHub开源项目:AIGC Content Moderation Toolkit

(全文完,字数:8500+)

暂无评论内容