![图片[1] - MAGNN: Metapath Aggregated Graph Neural Network for Heterogeneous Graph Embedding (WWW 2020) 译文 - 宋马](https://pic.songma.com/blogimg/20250616/4c70169cc18e4f6ca1c0ea0bafe24048.png)

摘要:

大量现实世界中的图或网络本质上是异构的,涉及多种类型的节点和关系。异构图嵌入旨在将异构图中丰富的结构和语义信息嵌入到低维的节点表示中。现有模型通常在异构图中定义多个元路径(metapath)以捕捉复合关系并指导邻居选择。然而,这些模型要么忽略了节点的内容特征、舍弃了元路径中的中间节点,要么只考虑单一的元路径。

为了解决这三个限制,我们提出了一种新模型,称为 元路径聚合图神经网络(MAGNN, Metapath Aggregated Graph Neural Network),以提升最终的性能。具体来说,MAGNN 包含三个主要组件:(1)节点内容转换,用于封装输入节点的属性;(2)元路径内聚合,用于整合中间语义节点;(3)元路径间聚合,用于结合来自多个元路径的信息。

在三个真实异构图数据集上的节点分类、节点聚类和链接预测任务中进行的大量实验证明,MAGNN 相较于当前最先进的基线模型能够取得更准确的预测结果。

1 引言

许多现实世界中的数据集天然可以用图的数据结构来表示,在图中,对象和它们之间的关系分别由节点和边来体现。例如包括社交网络 [14, 29]、物理系统 [2, 10]、交通网络 [18, 34]、引文网络 [1, 14, 16]、推荐系统 [26, 35]、知识图谱 [3, 24] 等。图的独特非欧几里得性质使得它们难以被传统的机器学习模型建模。因为每个节点的邻居集合既无顺序,也没有固定的大小;然而,大多数统计模型都假设输入是有序且固定大小的,且位于欧几里得空间中。因此,如果可以将节点表示为欧几里得空间中有意义的低维向量,并将这些向量作为其他机器学习模型的输入,将会非常有益。

为图结构设计的各种图嵌入技术已经被提出。LINE [25] 通过利用节点之间的一阶和二阶邻近关系来生成节点嵌入。基于随机游走的方法,如 DeepWalk [21]、node2vec [13] 和 TADW [32],将由随机游走生成的节点序列输入到 skip-gram 模型 [19] 中以学习节点嵌入。随着深度学习的快速发展,图神经网络(GNN)被提出,用专门设计的神经网络层来学习图的表示。基于频谱的 GNN,如 ChebNet [8] 和 GCN [16],在图的傅里叶域上执行图卷积操作。而最近的基于空间的 GNN,包括 GraphSAGE [14]、GAT [28] 以及许多其他变种 [17, 34, 35],通过直接在图结构上进行图卷积运算,解决了频谱方法在可扩展性和泛化能力方面的问题。越来越多的研究者开始已关注这一前景广阔的领域。

尽管图神经网络(GNN)在许多任务中取得了最先进的成果,但大多数基于 GNN 的模型都假设输入是一个同构图,即仅包含一种节点类型和一种边类型。而大多数现实世界中的图则由多种类型的节点和边组成,并且这些节点和边关联着不同特征空间中的属性。例如,在一个合作作者网络中,至少存在两种节点类型:作者和论文。作者的属性可能包括其所属机构、引用次数和研究领域;而论文的属性可能包括关键词、发表会议或期刊、年份等。我们将这类图称为异构信息网络(HIN)或异构图。图结构和节点内容的异质性使得 GNN 很难将图中丰富多样的信息编码为低维向量空间中的表示。

现有的大多数异构图嵌入方法都基于元路径(metapath)的思想。元路径是在网络模式(schema)上定义的一种节点类型和边类型的有序序列,用来描述涉及这些节点类型之间的复合关系。例如,在一个包含作者、论文和会议的学术网络中,APA(Author-Paper-Author)和 APVPA(Author-Paper-Venue-Paper-Author)是两种描述作者之间不同关系的元路径。APA 表示合著关系,而 APVPA 表示两位作者在同一会议上发表过论文。因此,我们可以将元路径视为两个节点之间的一种高阶邻近关系。由于传统的 GNN 模型将所有节点一视同仁,它们无法有效建模异构图中复杂的结构和语义信息。

尽管这些基于元路径的嵌入方法在诸如节点分类和链接预测等任务上优于传统的网络嵌入方法,它们仍然存在以下至少一种局限性:

(1)模型未利用节点内容特征,因此在具有丰富节点属性的异构图中表现较差。例如 metapath2vec [9]、ESim [22]、HIN2vec [11] 和 HERec [23] 都没有充分利用节点的内容信息。

(2)模型在处理元路径时丢弃了所有中间节点,只考虑元路径两端的节点,这会导致信息丢失。例如 HERec [23] 和 HAN [31] 就存在这个问题。

(3)模型依赖单一的元路径对异构图进行嵌入。因此,该方法需要手动选择元路径,忽视了其他元路径中蕴含的信息,从而导致性能不佳。例如 metapath2vec [9] 属于此类方法。

为了解决上述局限性,我们提出了一种新颖的异构图嵌入方法:Metapath Aggregated Graph Neural Network(MAGNN)。MAGNN 通过引入节点内容转换、元路径内聚合和元路径间聚合机制,全面解决了前文提到的三个问题,以生成高质量的节点嵌入表示。具体而言,MAGNN 首先对异构节点的属性进行类型特定的线性变换。由于不同类型的节点属性维度可能不同,因此该步骤将所有节点属性投影到同一潜在向量空间中。接下来,MAGNN 对每一条元路径执行基于注意力机制的元路径内聚合(intra-metapath aggregation)。在此过程中,每个目标节点会从与其通过该元路径连接的邻居节点中,提取和整合信息,形成上下文敏感的元路径实例表示。这样,MAGNN 能够同时捕捉异构图中来自邻居节点的信息以及元路径中间语义结构的信息。在完成元路径内聚合之后,MAGNN 进一步使用注意力机制进行元路径间聚合(inter-metapath aggregation),将从多条元路径得到的潜在表示融合成最终的节点嵌入表示。通过融合多个元路径,MAGNN 能够学习异构图中蕴含的全面语义信息。

总结来说,本文的主要贡献包括以下几点:

提出了一种新颖的元路径聚合图神经网络(MAGNN)用于异构图嵌入,该方法能有效捕捉复杂的结构和语义信息。

设计了多种用于从元路径实例中提取信息的候选编码器函数,其中包括一种基于复空间中关系旋转(relational rotation)的思想 [24] 的编码器。

在多个异构图数据集和任务上进行了广泛的实验,包括在 IMDb 和 DBLP 数据集上的节点分类与节点聚类任务,以及在 Last.fm 数据集上的链路预测任务。

实验结果表明,在所有数据集和任务中,MAGNN 所学习到的节点嵌入在性能上均优于其他现有的先进方法,展现出稳定且优越的表现。

2 预备知识

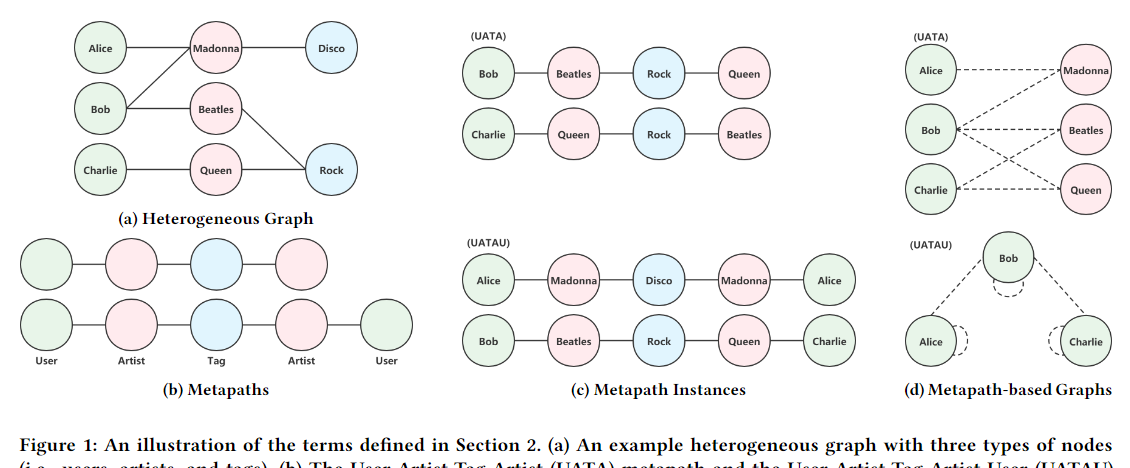

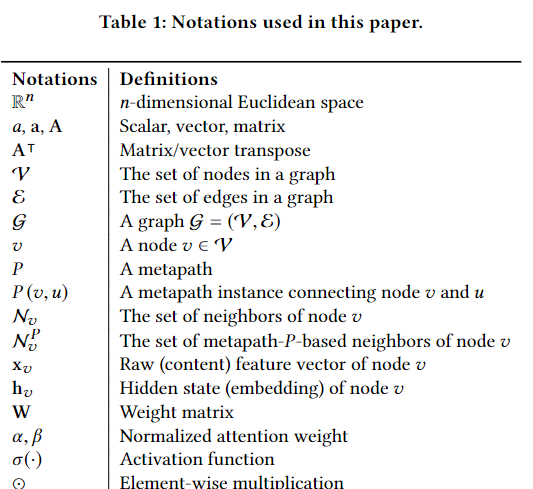

本节将正式定义与异构图相关的一些重要术语。图 1 给出了相应的图示说明,此外,表 1 总结了文中常用符号,供快速查阅。

定义 2.1 异构图(Heterogeneous Graph)

异构图定义为一个图 G = ( V , E ) G = (V, E) G=(V,E),其中包含一个节点类型映射函数 ϕ : V → A phi : V

ightarrow A ϕ:V→A 和一个边类型映射函数 ψ : E → R psi : E

ightarrow R ψ:E→R。其中, A A A 和 R R R 分别表示预定义的节点类型集合和边类型集合,且满足 ∣ A ∣ + ∣ R ∣ > 2 |A| + |R| > 2 ∣A∣+∣R∣>2。

定义 2.2 元路径(Metapath)

元路径 P P P 定义为一个形如

A 1 → R 1 A 2 → R 2 ⋯ → R l A l + 1 A_1 xrightarrow{R_1} A_2 xrightarrow{R_2} cdots xrightarrow{R_l} A_{l+1} A1R1

A2R2

⋯Rl

Al+1

的路径(可简写为 A 1 A 2 ⋯ A l + 1 A_1A_2 cdots A_{l+1} A1A2⋯Al+1),它描述了节点类型 A 1 A_1 A1 到 A l + 1 A_{l+1} Al+1 之间的复合关系 R = R 1 ∘ R 2 ∘ ⋯ ∘ R l R = R_1 circ R_2 circ cdots circ R_l R=R1∘R2∘⋯∘Rl,其中 ∘ circ ∘ 表示关系的复合操作。

定义 2.3 元路径实例(Metapath Instance)

给定一个异构图中的元路径 P P P,则该元路径的一个元路径实例 p p p 定义为图中一条符合 P P P 所定义模式的节点序列。

定义 2.4 基于元路径的邻居(Metapath-based Neighbor)

对于异构图中的一个元路径 P P P,节点 v v v 的基于元路径的邻居集合 N v P N^P_v NvP 定义为通过元路径 P P P 的实例与节点 v v v 相连的节点集合。若一个邻居通过两个不同的元路径实例与 v v v 相连,则视为 N v P N^P_v NvP 中的两个不同节点。注意,如果 P P P 是对称的,则 N v P N^P_v NvP 中包含 v v v 自身。

例如,在图 1 中考虑元路径 UATA,艺术家 Queen 是用户 Bob 的一个基于元路径的邻居。这两个节点通过元路径实例 Bob → Beatles → Rock → Queen 相连。此外,Beatles 和 Rock 被称为该元路径实例中的中间节点。

定义 2.5 基于元路径的图(Metapath-based Graph)

给定一个异构图 G G G 中的元路径 P P P,则基于该元路径的图 G P G_P GP 是由图 G G G 中所有基于 P P P 的邻居节点对构成的图。需要注意的是,如果元路径 P P P 是对称的,则图 G P G_P GP 是一个同构图(homogeneous graph)。

定义 2.6 异构图嵌入(Heterogeneous Graph Embedding)

给定一个异构图 G = ( V , E ) G = (V, E) G=(V,E),其节点属性矩阵为 X A i ∈ R ∣ V A i ∣ × d A i X_{A_i} in mathbb{R}^{|V_{A_i}| imes d_{A_i}} XAi∈R∣VAi∣×dAi,其中 A i ∈ A A_i in A Ai∈A 是节点类型集合中的一种,异构图嵌入任务的目标是为所有节点 v ∈ V v in V v∈V 学习一个 d d d-维的表示向量 h v ∈ R d h_v in mathbb{R}^d hv∈Rd,其中 d ≪ ∣ V ∣ d ll |V| d≪∣V∣,且该表示应能够捕捉图 G G G 中丰富的结构和语义信息。

3 相关工作

本节回顾了与我们模型相关的图表示学习研究工作。我们将其分为两个小节进行介绍:

第 3.1 节 总结了面向通用图嵌入的图神经网络(GNN)方面的研究工作。

第 3.2 节 介绍了专为异构图设计的图嵌入方法。

3.1 图神经网络(Graph Neural Networks)

GNN(图神经网络)的目标是为每个节点 v v v 学习一个低维向量表示 h v h_v hv,这个表示可以用于许多下游任务,例如节点分类、节点聚类以及链接预测。这一思想的依据在于,每个节点天然地由其自身特征和其邻居所定义。基于这一理念并结合图信号处理的思想,最初发展出了基于频谱的GNN模型,这类模型在图的傅里叶域中执行图卷积操作。ChebNet [8] 利用切比雪夫多项式在图傅里叶域中过滤图信号(节点特征)。另一个有影响力的模型是 GCN [16],它对 ChebNet 的参数进行了约束与简化,以缓解过拟合问题并提升性能。然而,基于频谱的 GNN 存在可扩展性差和泛化能力弱的问题,因为它们在每一层都需要整个图作为输入,并且其学习得到的滤波器依赖于图拉普拉斯算子的特征基,而这些特征基与特定的图结构密切相关。

基于空间的图神经网络(Spatial-based GNNs)被提出用以解决传统方法的两个主要局限。这类 GNN 直接在图结构域中定义卷积操作,通过聚合每个节点邻居的特征信息,模仿卷积神经网络(CNN)在图像数据上的卷积方式。GraphSAGE [14] 是一种开创性的基于空间的 GNN 框架,其核心理念是引入聚合器函数(aggregator function),以高效生成节点嵌入。聚合器函数对目标节点的局部邻域进行采样、提取和变换,因此不仅支持并行训练,也能够泛化到未见过的节点或图结构上。许多其他基于空间的 GNN 变体也基于这一思想被提出。

受 Transformer [27] 启发,GAT [28] 将注意力机制引入聚合器函数,以从目标节点视角衡量各个邻居信息的重要性。GGNN [17] 则将门控循环单元(GRU)[7] 添加到聚合器函数中,将聚合后的邻居信息作为当前时间步 GRU 的输入。GaAN [34] 将 GRU 与门控多头注意力机制相结合,以处理时空图数据。STAR-GCN [35] 通过堆叠多个 GCN 编码器-解码器结构来提升评分预测的性能。

上述所有 GNN 方法要么是为同质图(homogeneous graphs)设计的,要么是针对具有特定结构(例如用户-物品推荐系统)设计的。由于大多数现有 GNN 是在一个共享的嵌入空间中操作节点特征,因此它们无法自然适配异构图,其中不同类型节点的特征可能位于不同的特征空间。

3.2 异构图嵌入

异构图嵌入旨在将异构图中的节点映射到低维向量空间中。这是一个具有挑战性的研究课题,已经有许多研究对此进行了探索。例如,metapath2vec [9] 通过用户定义的单一元路径引导生成随机游走序列,然后将这些序列输入到 skip-gram 模型 [19] 中以生成节点嵌入。ESim [22] 在给定元路径的基础上,通过从中采样正例和负例元路径实例来学习节点嵌入。HIN2vec [11] 通过执行多个预测训练任务来同时学习异构图中节点和元路径的表示。HERec [23] 在给定一个元路径的情况下,将异构图转换为基于元路径的同构图,并应用 DeepWalk 模型对目标类型的节点进行嵌入学习。

类似地,HAN [31] 也基于元路径将异构图转换为多个同构图,但它采用图注意力网络(GAT)架构对邻居信息进行聚合,并利用注意力机制对多个元路径进行加权融合。另一种模型 PME [6] 则通过将节点投影到相应的关系空间中,并优化投影节点之间的相似性来学习节点嵌入。

然而,上述所有异构图嵌入方法都存在一些局限性,例如:

忽略了节点的内容特征;

丢弃了元路径中间的所有节点信息;

仅使用了单一的元路径。

虽然这些方法在某些异构图数据集上相较于同构图嵌入方法已有所提升,但仍有改进空间,尤其是在更全面地挖掘异构图中隐含信息方面。

4 方法论(METHODOLOGY)

在本节中,我们提出了一种新的用于异构图嵌入的元路径聚合图神经网络(MAGNN)。MAGNN 由三个主要组成部分构成:

节点内容变换(Node Content Transformation)

对不同类型节点的原始特征进行变换,使它们能够投影到统一的嵌入空间中,从而支持后续的聚合操作。

元路径内部聚合(Intra-metapath Aggregation)

对于指定的元路径结构,MAGNN 设计了机制来捕捉并聚合该元路径中间所有节点的信息,而不是仅仅已关注两端节点,解决了现有方法忽略中间节点的局限。

元路径间聚合(Inter-metapath Aggregation)

当一个节点可能关联多个不同的元路径时,MAGNN 利用注意力机制等方法在这些元路径之间进行加权融合,从而生成更加全面的节点表示。

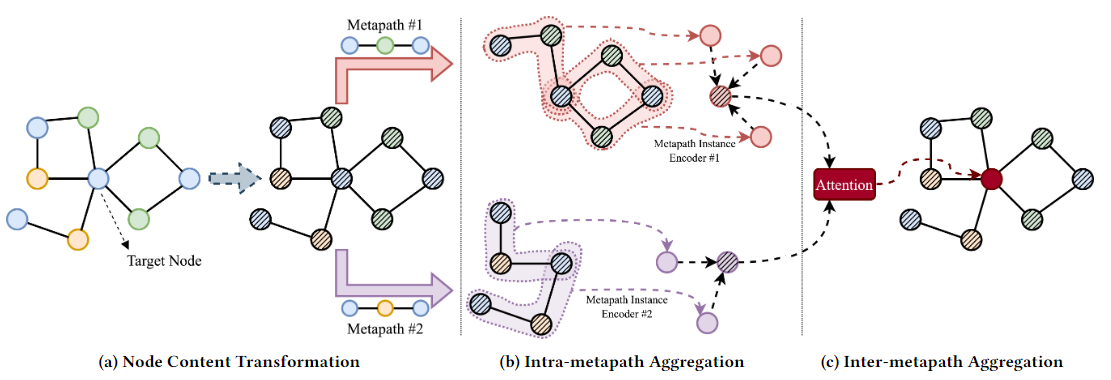

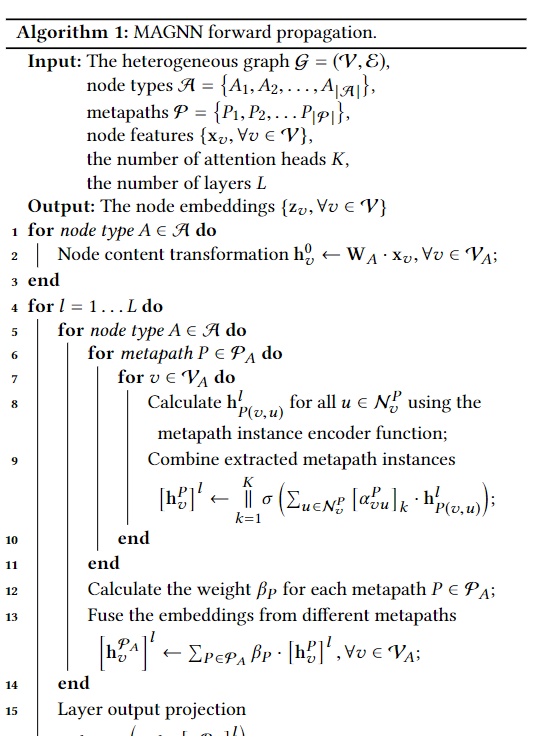

图 2 展示了一个单节点嵌入生成的示意过程。完整的前向传播过程可参考算法 1(Algorithm 1)。

4.1 节点内容变换(Node Content Transformation)

在一个带有节点属性的异构图中,不同类型的节点往往具有不同维度的特征向量。即便它们的维度恰好相同,它们所处的特征空间也可能是不同的。例如,文本的 n 1 n_1 n1 维词袋向量与图像的 n 2 n_2 n2 维灰度直方图向量,即使 n 1 = n 2 n_1 = n_2 n1=n2,它们也不能直接一起使用,因为表示的语义完全不同。

这就使得在统一的建模框架中直接处理不同类型节点的原始特征变得困难。因此,在将节点特征输入到 MAGNN 模型之前,我们需要首先将不同类型的节点特征投影到统一的潜在向量空间中。

为此,MAGNN 对每一种节点类型使用一个特定的线性变换。对于一个类型为 A ∈ A A in mathcal{A} A∈A 的节点 v ∈ V A v in V_A v∈VA,该变换过程为:

h v ′ = W A ⋅ x v A (1) mathbf{h}'_v = W_A cdot mathbf{x}^A_v ag{1} hv′=WA⋅xvA(1)

其中:

x v A ∈ R d A mathbf{x}^A_v in mathbb{R}^{d_A} xvA∈RdA 是节点 v v v 的原始特征向量;

h v ′ ∈ R d ′ mathbf{h}'_v in mathbb{R}^{d'} hv′∈Rd′ 是变换后的潜在特征向量;

W A ∈ R d ′ × d A W_A in mathbb{R}^{d' imes d_A} WA∈Rd′×dA 是节点类型 A A A 对应的线性变换权重矩阵。

该节点内容变换模块主要解决的是图的异构性中来自于节点内容维度和空间差异的问题。经过变换后,所有节点的特征都被统一为相同维度的潜在表示,为后续的聚合过程(如元路径聚合)打下基础。

4.2 元路径内部聚合(Intra-metapath Aggregation)

给定一个元路径 P P P,元路径内部聚合层(intra-metapath aggregation layer) 旨在从目标节点、基于元路径的邻居节点以及两者之间的上下文节点中学习结构和语义信息。这一层通过对元路径实例进行编码,来捕捉和聚合这些信息。

设 P ( v , u ) P(v, u) P(v,u) 表示一个连接目标节点 v v v 与其基于元路径的邻居节点 u ∈ N v P u in mathcal{N}^P_v u∈NvP 的元路径实例,我们将其中间节点集定义为:

{ m P ( v , u ) } = P ( v , u ) ∖ { v , u } {m^{P(v,u)}} = P(v, u) setminus {v, u} {

mP(v,u)}=P(v,u)∖{

v,u}

即中间节点是该路径中除目标节点和邻居节点以外的节点。

在此基础上,元路径内部聚合模块使用一个专门设计的元路径实例编码器(metapath instance encoder),将路径上所有节点的特征向量编码为一个单一向量表示。这个过程可形式化表示为:

h ( v , u ) P = f θ ( P ( v , u ) ) = f θ ( h v ′ , h u ′ , { h t ′ , ∀ t ∈ m P ( v , u ) } ) (2) mathbf{h}^P_{(v, u)} = f_ heta(P(v, u)) = f_ hetaleft(mathbf{h}'_v, mathbf{h}'_u, {mathbf{h}'_t, forall t in m^{P(v,u)}}

ight) ag{2} h(v,u)P=fθ(P(v,u))=fθ(hv′,hu′,{

ht′,∀t∈mP(v,u)})(2)

其中:

h ( v , u ) P ∈ R d ′ mathbf{h}^P_{(v, u)} in mathbb{R}^{d'} h(v,u)P∈Rd′:表示该元路径实例的嵌入;

f θ f_ heta fθ:表示带参数的元路径实例编码器;

h v ′ , h u ′ mathbf{h}'_v, mathbf{h}'_u hv′,hu′:目标节点和邻居节点的变换后表示;

h t ′ mathbf{h}'_t ht′:中间节点的表示(多个);

所有输入节点特征均来自 4.1 节的节点内容变换输出。

为简化表达,这里我们用 P ( v , u ) P(v, u) P(v,u) 表示一个元路径实例,尽管在实际图中,一个节点对可能由多个不同路径实例连接。

元路径实例编码器的多种实现方案将在 4.4 节中详细介绍。这一机制的关键在于不仅考虑起点和终点,还充分利用元路径中的中间节点语义和结构信息,这是 MAGNN 相较于传统基于元路径的方法(如 metapath2vec)的一大提升。

在将元路径实例编码为向量表示之后,我们进一步采用图注意力层(graph attention layer) [28],对与目标节点 v v v 相关的所有元路径实例进行加权求和。

✨ 核心思想:

不同的元路径实例对目标节点的表示有不同的重要性贡献。因此,我们为每个元路径实例 P ( v , u ) P(v, u) P(v,u) 学习一个归一化的重要性权重 α v u P alpha^P_{vu} αvuP,并基于该权重进行加权聚合。

🔧 具体计算步骤如下:

注意力打分(表示元路径实例的重要性):

e v u P = LeakyReLU ( a P ⊤ ⋅ [ h v ′ ∥ h ( v , u ) P ] ) e^P_{vu} = ext{LeakyReLU} left( mathbf{a}^ op_P cdot left[ mathbf{h}'_v , | , mathbf{h}^P_{(v,u)}

ight]

ight) evuP=LeakyReLU(aP⊤⋅[hv′∥h(v,u)P])

a P ∈ R 2 d ′ mathbf{a}_P in mathbb{R}^{2d'} aP∈R2d′:元路径 P P P 的参数化注意力向量;

h v ′ mathbf{h}'_v hv′:目标节点的表示;

h ( v , u ) P mathbf{h}^P_{(v,u)} h(v,u)P:元路径实例 P ( v , u ) P(v, u) P(v,u) 的向量表示;

∥ | ∥:表示向量拼接操作;

e v u P e^P_{vu} evuP:表示元路径实例 P ( v , u ) P(v, u) P(v,u) 对节点 v v v 的重要性得分。

Softmax 归一化注意力权重:

α v u P = exp ( e v u P ) ∑ s ∈ N v P exp ( e v s P ) alpha^P_{vu} = frac{exp(e^P_{vu})}{sum_{s in mathcal{N}^P_v} exp(e^P_{vs})} αvuP=∑s∈NvPexp(evsP)exp(evuP)

该操作确保所有与 v v v 相关的元路径实例权重之和为 1。

加权聚合得到目标节点在该元路径下的表示:

h v P = σ ( ∑ u ∈ N v P α v u P ⋅ h ( v , u ) P ) (3) mathbf{h}^P_v = sigma left( sum_{u in mathcal{N}^P_v} alpha^P_{vu} cdot mathbf{h}^P_{(v,u)}

ight) ag{3} hvP=σ

u∈NvP∑αvuP⋅h(v,u)P

(3)

σ ( ⋅ ) sigma(cdot) σ(⋅):非线性激活函数(如 ReLU);

h v P mathbf{h}^P_v hvP:节点 v v v 在元路径 P P P 下的最终聚合表示。

这个注意力机制还可以扩展为多头注意力机制(multi-head attention),这有助于稳定学习过程并减少图的异质性所带来的高方差。具体而言,MAGNN 执行 K K K 个独立的注意力机制,然后将它们的输出拼接在一起,形成如下公式:

h v P = ∥ k = 1 K σ ( ∑ u ∈ N v P [ α v u P ] k ⋅ h ( v , u ) P ) h_v^P = mathop{|}_{k=1}^{K} sigmaleft( sum_{u in N_v^P} left[alpha_{vu}^P

ight]_k cdot h^P_{(v,u)}

ight) hvP=∥k=1Kσ

u∈NvP∑[αvuP]k⋅h(v,u)P

其中, [ α v u P ] k left[alpha_{vu}^P

ight]_k [αvuP]k 表示第 k k k 个注意力头下,元路径实例 P ( v , u ) P(v,u) P(v,u) 对目标节点 v v v 的归一化重要性权重。

总的来说,给定每个节点 u ∈ V u in V u∈V 的投影特征向量 h u ′ ∈ R d ′ h'_u in mathbb{R}^{d'} hu′∈Rd′,以及起始或结束于节点类型 A ∈ A A in mathcal{A} A∈A 的元路径集合 P A = { P 1 , P 2 , … , P M } mathcal{P}_A = {P_1, P_2, dots, P_M} PA={

P1,P2,…,PM},MAGNN 的元路径内聚合模块(intra-metapath aggregation) 将生成目标节点 v ∈ V A v in V_A v∈VA 对应的 M M M 个元路径特定向量表示,记作:

{ h v P 1 , h v P 2 , … , h v P M } { h^{P_1}_v, h^{P_2}_v, dots, h^{P_M}_v } {

hvP1,hvP2,…,hvPM}

其中每个 h v P i ∈ R d ′ h^{P_i}_v in mathbb{R}^{d'} hvPi∈Rd′(当 K = 1 K = 1 K=1 时)可以被视为关于节点 v v v 的元路径 P i P_i Pi 实例的一种语义总结,表示节点 v v v 所包含的某一方面的语义信息。

4.3 元路径间聚合(Inter-metapath Aggregation)

在对每个元路径内的节点和边的信息进行聚合之后,我们需要通过一个元路径间聚合层来整合所有元路径所揭示的语义信息。

现在,对于某一节点类型 A A A,我们已经获得了该类型每个节点的 M M M 个元路径特定的潜在向量表示,记作:

{ h v P 1 , h v P 2 , … , h v P M } , v ∈ V A { h^{P_1}_v, h^{P_2}_v, dots, h^{P_M}_v },quad v in V_A {

hvP1,hvP2,…,hvPM},v∈VA

其中 M M M 是与节点类型 A A A 相关的元路径数量。

一种直接的聚合方法是对这些向量进行逐元素平均。但在本方法中,我们进一步引入注意力机制,为不同的元路径分配不同的权重。这样做是合理的,因为在异构图中,不同的元路径对节点语义的贡献是不同的。

具体来说,首先对每一个元路径 P i ∈ P A P_i in mathcal{P}_A Pi∈PA 进行汇总。方法是对所有属于类型 A A A 的节点 v ∈ V A v in V_A v∈VA 的元路径特定向量 h v P i h^{P_i}_v hvPi 进行非线性变换后取平均:

s P i = 1 ∣ V A ∣ ∑ v ∈ V A tanh ( M A ⋅ h v P i + b A ) (5) s^{P_i} = frac{1}{|V_A|} sum_{v in V_A} anhleft( M_A cdot h^{P_i}_v + b_A

ight) ag{5} sPi=∣VA∣1v∈VA∑tanh(MA⋅hvPi+bA)(5)

其中:

M A ∈ R d m × d ′ M_A in mathbb{R}^{d_m imes d'} MA∈Rdm×d′ 是可学习的权重矩阵,

b A ∈ R d m b_A in mathbb{R}^{d_m} bA∈Rdm 是可学习的偏置向量,

tanh anh tanh 是激活函数,用于引入非线性。

接下来,我们使用注意力机制对节点 v v v 的各个元路径特定向量进行加权融合,步骤如下:

e P i = q A ⊤ ⋅ s P i e^{P_i} = mathbf{q}_A^ op cdot s^{P_i} ePi=qA⊤⋅sPi

β P i = exp ( e P i ) ∑ P ∈ P A exp ( e P ) eta^{P_i} = frac{exp(e^{P_i})}{sumlimits_{P in mathcal{P}_A} exp(e^P)} βPi=P∈PA∑exp(eP)exp(ePi)

h v P A = ∑ P ∈ P A β P ⋅ h v P (6) h^{mathcal{P}_A}_v = sum_{P in mathcal{P}_A} eta^P cdot h^P_v ag{6} hvPA=P∈PA∑βP⋅hvP(6)

其中:

q A ∈ R d m mathbf{q}_A in mathbb{R}^{d_m} qA∈Rdm 是节点类型 A A A 的可学习注意力向量,

e P i e^{P_i} ePi 表示元路径 P i P_i Pi 对于该类型节点的注意力得分,

β P i eta^{P_i} βPi 是元路径 P i P_i Pi 相对于其他元路径的重要性权重。

计算出每条元路径的权重 β P i eta^{P_i} βPi 后,我们对节点 v v v 的所有元路径特定向量 h v P h^P_v hvP 进行加权求和,得到最终的元路径聚合表示 h v P A h^{mathcal{P}_A}_v hvPA。

最后,MAGNN 使用一个线性变换加非线性激活函数,将节点表示投影到所需的输出向量空间:

h v = σ ( W o ⋅ h v P A ) (7) h_v = sigmaleft(W_o cdot h^{mathcal{P}_A}_v

ight) ag{7} hv=σ(Wo⋅hvPA)(7)

其中:

σ ( ⋅ ) sigma(cdot) σ(⋅) 是激活函数,

W o ∈ R d o × d ′ W_o in mathbb{R}^{d_o imes d'} Wo∈Rdo×d′ 是权重矩阵。

这个投影过程是任务相关的。在节点分类任务中,它可以被视为一个线性分类器;在链接预测任务中,它可以理解为将节点嵌入投影到表示节点相似度的空间中。

4.4 元路径实例编码器(Metapath Instance Encoders)

为了对第 4.2 节中提到的每一个元路径实例进行编码,MAGNN 提出了三种候选的编码函数。以下是其中两种:

● 均值编码器(Mean Encoder)

这种方法对元路径实例 P ( v , u ) P(v, u) P(v,u) 上的所有节点向量做逐元素平均:

h P ( v , u ) = MEAN ( { h t ′ , ∀ t ∈ P ( v , u ) } ) (8) h^{P(v,u)} = ext{MEAN} left( left{ h'_t , forall t in P(v, u)

ight}

ight) ag{8} hP(v,u)=MEAN({

ht′,∀t∈P(v,u)})(8)

即:将目标节点 v v v、邻居节点 u u u,以及元路径中的所有中间节点的向量取平均,用作该路径实例的表示。

● 线性编码器(Linear Encoder)

在线性编码器中,先取上述均值,再通过一个线性变换来增强表达能力:

h P ( v , u ) = W P ⋅ MEAN ( { h t ′ , ∀ t ∈ P ( v , u ) } ) (9) h^{P(v,u)} = W_P cdot ext{MEAN} left( left{ h'_t , forall t in P(v, u)

ight}

ight) ag{9} hP(v,u)=WP⋅MEAN({

ht′,∀t∈P(v,u)})(9)

其中 W P W_P WP 是该元路径 P P P 的可学习权重矩阵。

● 关系旋转编码器(Relational Rotation Encoder)

我们还考察了一种基于 复数空间中关系旋转(relational rotation) 的元路径实例编码器。这种操作最初由 RotatE [24] 提出,用于知识图谱嵌入。

前面提到的均值编码器和线性编码器将元路径实例视为一个集合,因此忽略了元路径中节点的顺序结构信息。而关系旋转编码器则提供了一种方式,可以建模路径中的序列关系和方向性。

编码过程如下:

假设元路径实例为:

P ( v , u ) = ( t 0 , t 1 , … , t n ) ,其中 t 0 = u , t n = v P(v, u) = (t_0, t_1, dots, t_n),其中 t_0 = u,t_n = v P(v,u)=(t0,t1,…,tn),其中t0=u,tn=v

令 R i R_i Ri 表示节点 t i − 1 t_{i-1} ti−1 和 t i t_i ti 之间的关系, r i r_i ri 为对应的关系向量(也是复数向量),则编码器的定义为:

o 0 = h t 0 ′ = h u ′ o_0 = h'_{t_0} = h'_u o0=ht0′=hu′

o i = h t i ′ + o i − 1 ⊙ r i o_i = h'_{t_i} + o_{i-1} odot r_i oi=hti′+oi−1⊙ri

h P ( v , u ) = o n n + 1 (10) h^{P(v,u)} = frac{o_n}{n+1} ag{10} hP(v,u)=n+1on(10)

其中:

h t i ′ h'_{t_i} hti′ 和 r i r_i ri 都是复数向量(complex vectors),

⊙ odot ⊙ 表示按元素乘法(element-wise multiplication),

最终结果 h P ( v , u ) h^{P(v,u)} hP(v,u) 是最后一步结果 o n o_n on 的平均归一化。

向量的复数表示说明:

虽然模型中的向量是实数向量(维度为 d ′ d' d′),但可以通过以下方式视作复数向量:

将向量的前一半作为实部,后一半作为虚部,那么维度为 d ′ d' d′ 的实向量就可被看作一个维度为 d ′ / 2 d'/2 d′/2 的复数向量。

4.5 模型训练(Training)

在完成前面各个模块(内容变换、聚合等)后,我们可以得到节点的最终表示,这些表示可以用于多种下游任务。根据任务的不同特点以及是否有标签数据,MAGNN 可以在两种主要的学习范式下进行训练:

● 半监督学习(Semi-supervised Learning)

在这种设置下,我们利用一小部分已标注的节点作为监督信号,通过反向传播和梯度下降优化模型权重,从而学习到有意义的异构图节点嵌入。

对应的交叉熵损失函数定义如下:

L = − ∑ v ∈ V L ∑ c = 1 C y v [ c ] ⋅ log h v [ c ] (11) L = -sum_{v in V_L} sum_{c=1}^{C} y_v[c] cdot log h_v[c] ag{11} L=−v∈VL∑c=1∑Cyv[c]⋅loghv[c](11)

其中:

V L V_L VL 是具有标签的节点集合,

C C C 是类别数量,

y v y_v yv 是节点 v v v 的独热标签向量,

h v h_v hv 是节点 v v v 的预测概率分布向量。

● 无监督学习(Unsupervised Learning)

如果节点没有标签,可以使用**负采样(negative sampling)**方法,通过优化以下损失函数来学习节点嵌入:

L = − ∑ ( u , v ) ∈ Ω log σ ( h u ⊤ ⋅ h v ) − ∑ ( u ′ , v ′ ) ∈ Ω − log σ ( − h u ′ ⊤ ⋅ h v ′ ) (12) L = – sum_{(u,v) in Omega} log sigma(h_u^ op cdot h_v) quad – sum_{(u', v') in Omega^{-}} log sigma(- h_{u'}^ op cdot h_{v'}) ag{12} L=−(u,v)∈Ω∑logσ(hu⊤⋅hv)−(u′,v′)∈Ω−∑logσ(−hu′⊤⋅hv′)(12)

其中:

σ ( ⋅ ) sigma(cdot) σ(⋅) 是 sigmoid 激活函数,

Ω Omega Ω 是观测到的正样本节点对(例如存在连接的节点对),

Ω − Omega^{-} Ω− 是从未观测节点对中随机采样得到的负样本对(即图中不存在边的节点对)。

5 实验(EXPERIMENTS)

本节我们通过实验验证 MAGNN 在异构图嵌入任务中的有效性。这些实验旨在解答以下研究问题(Research Questions):

• RQ1:MAGNN 在节点分类任务中的表现如何?

• RQ2:MAGNN 在节点聚类任务中的表现如何?

• RQ3:MAGNN 在预测节点对之间可能存在的链接方面表现如何?

• RQ4:MAGNN 所提出的三个核心组件(节点内容变换、元路径内聚合、元路径间聚合)对整体性能的影响如何?

• RQ5:如何理解不同图嵌入方法的表示能力?

5.1 数据集(Datasets)

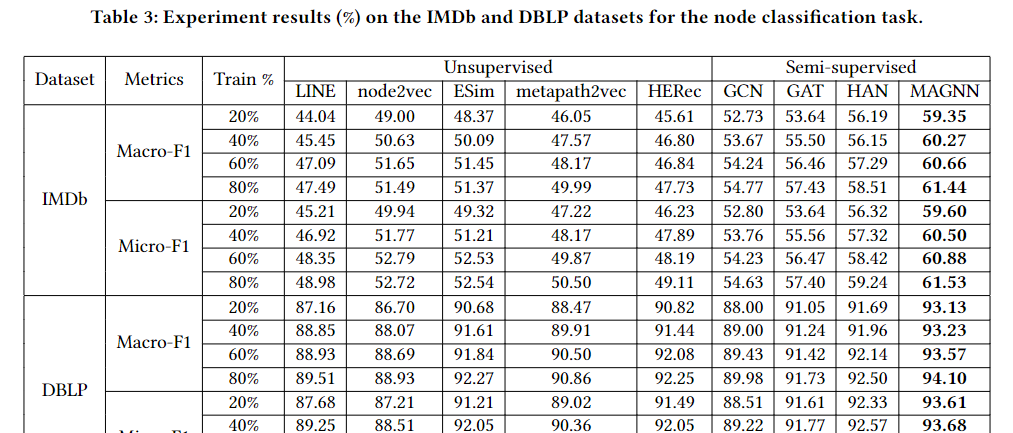

我们采用了来自不同领域的三个广泛使用的异构图数据集,用于评估 MAGNN 相对于当前最先进模型的性能。

具体来说:

IMDb 和 DBLP 数据集被用于节点分类与节点聚类实验;

Last.fm 数据集用于链接预测实验。

三大数据集的基本统计信息列在 表 2 中,图结构的模式(schema)展示在 图 3 中。

对于那些没有原始属性的节点,我们为它们分配one-hot 编码的 ID 向量作为“虚拟输入特征”(dummy input features),以保证输入的一致性。

• IMDb

IMDb 是一个关于电影和电视节目的在线数据库,包含演员、制作团队、剧情简介等信息。我们使用了一个从网络上抓取的 IMDb 子集,经过预处理后包含:

4278 部电影

2081 位导演

5257 位演员

每部电影根据其类型信息被划分为三个类别之一:动作(Action)、喜剧(Comedy) 和 剧情(Drama)。此外,每部电影还用其剧情关键词的词袋(bag-of-words)表示。

用于半监督学习的实验中,电影节点被划分为:

训练集:400(9.35%)

验证集:400(9.35%)

测试集:3478(81.30%)

• DBLP

DBLP 是一个计算机科学文献的数据库网站。我们采用由文献 [12, 15] 提取的一个子集,经过预处理后包含:

4057 位作者

14328 篇论文

7723 个术语(terms)

20 个出版会议(venues)

作者被划分为四个研究方向:数据库(Database)、数据挖掘(Data Mining)、人工智能(AI) 和 信息检索(IR)。每位作者的特征使用其发表论文关键词的词袋表示。

用于半监督学习的实验中,作者节点被划分为:

训练集:400(9.86%)

验证集:400(9.86%)

测试集:3257(80.28%)

• Last.fm

Last.fm 是一个记录用户听歌行为的音乐网站。我们采用 HetRec 2011 [4] 发布的数据集,并进行预处理,得到:

1892 名用户

17632 位艺人(artists)

1088 个艺人标签(tags)

该数据集用于链接预测任务,不包含标签或特征信息。

在半监督设置下,用户-艺人配对被划分为:

训练集:64984 对(70%)

验证集:9283 对(10%)

测试集:18567 对(20%)

![图片[2] - MAGNN: Metapath Aggregated Graph Neural Network for Heterogeneous Graph Embedding (WWW 2020) 译文 - 宋马](https://pic.songma.com/blogimg/20250616/3cb3b3fd43b94c0587775d5f05758a62.png)

5.2 基线模型(Baselines)

我们将 MAGNN 与多种类型的图嵌入模型进行比较,这些模型涵盖了不同的建模范式。具体分为以下四类:

传统同质图嵌入模型(Traditional Homogeneous Models)

不考虑图中的节点/边类型,也不使用图神经网络结构。

示例模型:LINE, node2vec

传统异质图嵌入模型(Traditional Heterogeneous Models)

利用异构图结构(如元路径)进行建模,但仍不基于 GNN 架构。

示例模型:ESim, metapath2vec, HERec

同质图的图神经网络(Homogeneous GNNs)

使用 GNN 框架但假设图是同质的,常用于处理元路径转换得到的同质子图。

示例模型:GCN, GAT

异质图的图神经网络(Heterogeneous GNNs)

同时结合 GNN 与图的异质结构,通常采用元路径、多通道注意力机制等策略。

示例模型:GATNE, HAN

接下来的内容详细介绍了每个模型的设计方法和实验设置。如需,我可以继续为你总结或翻译表格、实验结果等后续内容。

• LINE [25]

LINE 是一种传统的同质图嵌入模型,利用节点之间的一阶和二阶邻近关系来生成节点表示。

在本实验中,我们将其应用于异构图时:

忽略图的异质结构,即视图为同质图;

不使用节点的内容特征。

我们采用的是基于二阶邻近的 LINE 变体。

• node2vec [13]

node2vec 是一种同质图嵌入模型,是 DeepWalk [21] 的推广版本,使用有偏的随机游走生成节点序列,并通过 skip-gram 模型学习嵌入。

在本实验中,我们与使用 LINE 相同的方式将其应用于异构图,即:

忽略节点和边的类型信息;

不使用节点属性。

• ESim [22]

ESim 是一种传统的异构图嵌入模型,通过采样的元路径实例来学习节点嵌入。

该方法要求为每条元路径指定一个权重。为了公平和简化实验,我们为所有元路径分配相同的权重,因为据原作者实验所示,精确调整权重不会带来显著提升。

• metapath2vec [9]

metapath2vec 是另一种传统的异构图嵌入模型,它通过元路径引导的随机游走生成节点序列,并输入 skip-gram 模型进行训练。

由于该方法依赖于用户指定的单一元路径,我们在所有元路径上分别进行测试,并报告表现最好的结果。

本实验中使用的是其改进版本 metapath2vec++。

• HERec [23]

HERec 是一种传统的异构图嵌入模型,它将异构图中的元路径邻居图转换为同质图,并在这些图上应用 DeepWalk 来生成节点嵌入。

该模型原本为评分预测(推荐)任务设计了嵌入融合算法,但也可以适配用于链接预测。

对于节点分类或聚类任务,我们在所有元路径上测试,并报告表现最好的元路径的结果。

• GCN [16]

GCN 是一个同质图神经网络(GNN),在图的**傅里叶域(频域)**中进行卷积操作。

本实验中我们将 GCN 应用于每个元路径对应的同质图,并报告最优元路径下的性能表现。

• GAT [28]

GAT 是一种同质 GNN,在图的空间域(spatial domain)中进行卷积,同时引入了注意力机制来决定邻居的重要性。

同样地,我们在不同的元路径转换图上运行 GAT,并报告效果最好的元路径结果。

• GATNE [5]

GATNE 是一个为异构图设计的 GNN 模型,它结合了节点的基础嵌入和不同类型边的嵌入表示,专注于链接预测任务。

本实验中使用的是 性能最好的 GATNE 变体。

• HAN(Heterogeneous Attention Network)[31]

HAN 是一种经典的异构图 GNN 模型,它从不同的元路径转换图中学习元路径特定的节点嵌入,并使用注意力机制将它们组合成一个统一的节点表示。

以下是上述实验设置部分的中文翻译:

对于传统模型(包括 LINE、node2vec、ESim、metapath2vec 和 HERec):

**窗口大小(window size)**设为 5,

**随机游走长度(walk length)**设为 100,

**每个节点的游走次数(walks per node)**设为 40,

**负采样数(number of negative samples)**设为 5(如果适用)。

对于图神经网络模型(包括 GCN、GAT、HAN 和我们提出的 MAGNN):

Dropout 比例设置为 0.5;

所有模型使用相同的训练集、验证集和测试集划分;

使用 Adam 优化器,学习率设为 0.005,L2 权重衰减(正则项)设为 0.001;

所有 GNN 模型训练 100 个 epoch,并使用 早停策略(early stopping),容忍度(patience)为 30。

在节点分类与节点聚类任务中,所有 GNN 模型采用半监督训练方式,仅使用一小部分节点标签作为监督信号。

具体设置如下:

对于 GAT、HAN 和 MAGNN,注意力头数设为 8;

对于 HAN 和 MAGNN,在**元路径间聚合(inter-metapath aggregation)**中,注意力向量的维度设为 128;

为了公平对比,所有模型的**嵌入维度(embedding dimension)**统一设为 64。

5.3 节:节点分类(RQ1)

我们在 IMDb 和 DBLP 两个数据集上进行了节点分类实验,以比较不同模型在该任务中的表现。

实验方法:

对每个模型生成的节点嵌入(IMDb 中的电影节点,DBLP 中的作者节点),我们将其输入到一个**线性支持向量机(SVM)**分类器中。

我们改变 SVM 的训练集比例,观察模型在不同标注数量下的分类性能。

注意:为了公平比较,只使用测试集中的节点进行 SVM 训练与测试。这是因为半监督模型在训练过程中已经“见过”了训练集和验证集的节点(见公式 11),因此如果将这些节点用于 SVM 会造成信息泄露。

IMDb 测试集大小为 3478 个节点,DBLP 测试集为 3257 个节点。所有模型使用相同的 SVM 划分策略。

类似的策略也被用于后续的节点聚类和链接预测实验。

评估指标:

报告每个模型 10 次运行的平均值;

使用两种指标:

Macro-F1:对每一类独立评估后求平均,已关注小类别表现;

Micro-F1:基于全局预测情况评估,已关注整体准确率。

实验结果分析(见表 3):

MAGNN 在所有训练比例和数据集上都表现优于其他基线模型。

在 IMDb 数据集中,值得注意的是:

node2vec 的表现超过了某些传统异构图模型(如 metapath2vec 和 ESim),这说明随机游走策略在某些任务上仍然有效。

然而,GNN 尤其是异构 GNN(如 HAN 和 MAGNN)表现更佳,表明图神经网络架构能更好地利用节点特征和结构信息。

MAGNN 比 HAN 提升了大约 4% 到 7%,表明 利用完整的元路径实例(包括中间节点)比只依赖邻居节点信息更有效。

在 DBLP 数据集中,由于任务相对简单(节点之间语义清晰),所有模型的得分都非常高。

即便如此,MAGNN 仍然比表现最好的基线高出 1%–2%,显示出其强大的泛化能力。

5.4 节:节点聚类(RQ2)

我们在 IMDb 和 DBLP 两个数据集上进行了节点聚类实验,以比较不同模型生成的节点嵌入在无监督聚类任务中的表现。

实验方法:

对每种模型生成的节点嵌入(IMDb 中的电影节点,DBLP 中的作者节点),我们输入到 K-Means 聚类算法中。

聚类数设置为数据集的类别数:

IMDb:3 类(电影类型)

DBLP:4 类(研究领域)

评估指标为:

NMI(归一化互信息):衡量聚类结果与真实标签之间的信息重叠程度;

ARI(调整兰德指数):衡量聚类结果与真实标签之间的一致性,考虑随机性影响。

由于 K-Means 的结果对初始中心敏感,我们对每个模型运行 10 次 K-Means,每个模型也测试 10 次嵌入生成,最终报告其平均得分(详见表 4)。

结果分析(根据表 4):

MAGNN 在所有场景下的节点聚类任务中均优于其他模型,表现最为稳定和出色。

所有模型在 IMDb 上的聚类性能明显弱于 DBLP,其原因可能是:

IMDb 原始数据中,每部电影往往有多个类型标签;

实验中仅使用第一个标签作为类别标签,导致标签“噪声”较大。

值得注意的是:

传统异构图模型在聚类任务中并未比传统同构图模型表现更好;

node2vec 在聚类任务中表现较强,原因在于它基于随机游走,使得图中距离接近的节点在嵌入空间中也靠近,这种位置感知性(positional awareness)自然适合 K-Means 这种基于欧氏距离的聚类算法。

即便如此,异构感知的 GNN 模型(如 HAN 和 MAGNN)依然在聚类任务中取得了最好的排名。

5.5 节:链接预测(RQ3)

我们在 Last.fm 数据集上进行了链接预测任务,来评估 MAGNN 及其他基线模型的表现。

实验设置:

对于 GNN 模型:

已连接的用户-艺人对被视为正样本;

所有未连接的用户-艺人对被视为负样本。

在验证集和测试集中,我们为每个正样本添加等数量的负样本(随机采样)。

在训练过程中,负样本对也会实时均匀采样。

训练目标是最小化 公式 (12) 所定义的负采样损失函数。

预测方法:

模型训练完毕后,对于用户节点 u u u 和艺人节点 a a a,其链接概率通过以下公式计算:

p u a = σ ( h u ⊤ ⋅ h a ) (13) p_{ua} = sigma(h_u^ op cdot h_a) ag{13} pua=σ(hu⊤⋅ha)(13)

其中:

h u h_u hu、 h a h_a ha 分别为用户和艺人的嵌入向量,

σ ( ⋅ ) sigma(cdot) σ(⋅) 是 Sigmoid 激活函数。

评估指标:

我们使用两种标准评估链接预测性能:

AUC(ROC 曲线下面积):衡量模型区分正负样本的能力;

AP(平均精度):衡量在所有预测中正样本的排名情况。

我们对每个模型运行 10 次,报告其平均结果(详见表 5)。

结果分析(来自表 5):

MAGNN 在 AUC 和 AP 指标上都远超其他所有基线模型。

表现最强的传统模型是 metapath2vec,它基于单一元路径的随机游走序列生成嵌入。

尽管表现不错,但 MAGNN 的得分更高,表明仅依赖单一元路径的方案是次优的。

在 GNN 基线中,HAN 表现最好,因为它能够处理异构信息并融合多个元路径。

但 MAGNN 在 HAN 的基础上仍有约 6% 的提升,验证了一个关键结论:

“元路径实例中的上下文信息对于节点表示是至关重要的。”

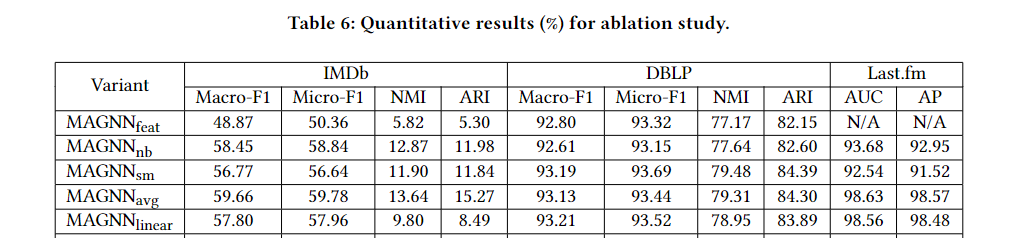

5.6 消融实验(RQ4)

为了验证我们模型各个组件的有效性,我们在三个数据集上、三个任务中对不同的 MAGNN 变体进行了消融实验,结果列于 表 6 中。

需要注意的是,节点分类任务中报告的每个分数(Macro-F1 和 Micro-F1)是来自不同训练比例(详见第 5.3 节)的平均值。

模型变体说明:

MAGNNrot:我们提出的完整模型,使用关系旋转编码器(relational rotation encoder)。这就是表 3、4 和 5 中用于与其他模型对比的主模型。

MAGNNfeat:不使用节点内容特征的版本;

MAGNNnb:只考虑基于元路径的邻居节点,不考虑路径实例;

MAGNNsm:只使用一条最佳元路径;

MAGNNavg:将路径实例编码器换为平均编码器;

MAGNNlinear:将路径实例编码器换为线性编码器。

除了上述差异外,其他设置在所有变体之间保持一致。

需要特别指出的是:在 Last.fm 数据集中,MAGNNfeat 等价于 MAGNNrot,因为该数据集中没有节点属性。

结果与分析:

MAGNNrot 相比 MAGNNfeat 提升明显,说明:

节点内容变换在融合节点特征时是必要的,能显著提升性能。

将 MAGNNnb 与 MAGNNavg、MAGNNlinear、MAGNNrot 比较可以看出:

相比仅使用元路径邻居节点,聚合完整的元路径实例能带来更好的结果,这验证了**元路径内部聚合(intra-metapath aggregation)**的重要性。

MAGNNsm(单一元路径) 与 MAGNNrot(多元路径融合) 的比较显示:

**融合多个元路径(inter-metapath aggregation)**能明显提升模型性能。

最后,MAGNNavg、MAGNNlinear 与 MAGNNrot 的比较表明:

使用关系旋转编码器对性能有一定提升,尽管提升幅度较小。

有趣的是,MAGNNlinear 表现竟然不如 MAGNNavg,这说明线性变换并不总是带来更优表现。

尽管不同编码器的 MAGNN 变体存在性能差异,但它们始终优于最佳的基线模型 HAN,进一步验证了 MAGNN 架构在异构图嵌入中的有效性与鲁棒性。

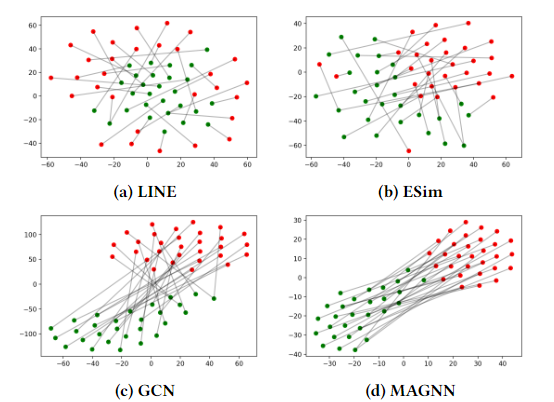

5.7 可视化分析(RQ5)

除了对嵌入模型的定量评估外,我们还进行了节点嵌入的可视化分析,以直观、定性的方式评估模型的嵌入效果。

实验设置:

我们从 Last.fm 数据集的测试集中随机选取 30 对用户-艺人节点对(正样本)。

将这些节点的嵌入向量通过 t-SNE 降维到二维空间,便于可视化。

在图 Figure 4 中展示了 LINE、ESim、GCN 和 MAGNN 的可视化结果:

红色点表示用户节点;

绿色点表示艺人节点。

可视化结果解读:

LINE(传统同质图模型):

用户与艺人节点混杂在一起,无法有效分离两类节点;

说明其缺乏处理异构信息的能力。

ESim(传统异构图模型):

能够大致将用户和艺人节点分隔开,表现优于 LINE;

但分界仍不清晰,聚类质量一般。

GCN(同质 GNN):

由于结合了 GNN 架构和适当的元路径设计,能将两类节点较好地分离;

同时也保留了用户-艺人配对间的相关性信息。

MAGNN(我们提出的模型):

表现最为突出,能明显地将用户节点与艺人节点清晰分群;

同时,同一对用户与艺人之间的关系也在空间中保持对齐和结构关联性。

从 Figure 4 的可视化中可以直观看出:

MAGNN 能够在异构图中学习到更明确的节点类型分离性和更准确的关系结构嵌入,表现优于传统方法和其他 GNN 模型。

6 结论(CONCLUSION)

在本文中,我们提出了一种新颖的元路径聚合图神经网络(MAGNN),用以解决现有异构图嵌入方法中的三大典型局限:

忽略节点内容特征,

丢弃元路径中的中间节点信息,

仅使用单一元路径建模。

MAGNN 的核心设计包括三大构件,分别对应上述三个问题:

节点内容变换(Node Content Transformation) —— 解决节点特征未被利用的问题;

元路径内部聚合(Intra-metapath Aggregation) —— 用于保留完整的元路径实例信息;

元路径间聚合(Inter-metapath Aggregation) —— 综合多个元路径语义,提高表示能力。

此外,我们还提出了 元路径实例编码器(Metapath Instance Encoders) 的概念,用于提取元路径实例中蕴含的结构与语义信息。我们设计了多种候选编码器函数,包括一种受知识图谱嵌入模型 RotatE 启发的复杂空间旋转方式。

实验结果表明:

MAGNN 在 节点分类、节点聚类与链接预测 三项任务中,在三个真实世界数据集上均达到了 当前最优性能。

同时,消融实验也验证了三个核心模块在提升嵌入效果方面的独立贡献与必要性。

未来工作展望:

我们计划将该异构图嵌入框架扩展应用于评分预测(推荐系统)任务,结合用户-物品数据与异构知识图谱信息,以进一步提升推荐效果【30】。

暂无评论内容