前言

在这个AI百花齐放的时代,不会使用AI来加速工作的完成,显得有点落后了。随着AI对话,到AI智能体的演变,到MCP协议,A2A协议,各种为了加快内容生产与产出的活动迭代层出不穷,让我们不得不产生危机感。特别是现有的应用,聊天对话到图文生成到视频生成,到主动学习。AI的发展势头已经是锐不可挡。那么应用好AI才能让我们跟紧时代的脚步。本教程旨在华为云平台基于Flexus+DeepSeek上10分钟带你从0到1在华为云上完成Dify-LLM应用开发平台搭建并发布自己的AI工具应用

为什么选择华为云平台

一键私有化部署开箱即用

华为云基于Flexus云服务器X实例上进了深度优化,提供了快速私有化部署开箱即用的Dify LLM应用开发平台的能力,使开发者可以快速搭建生产级的生成式AI应用。

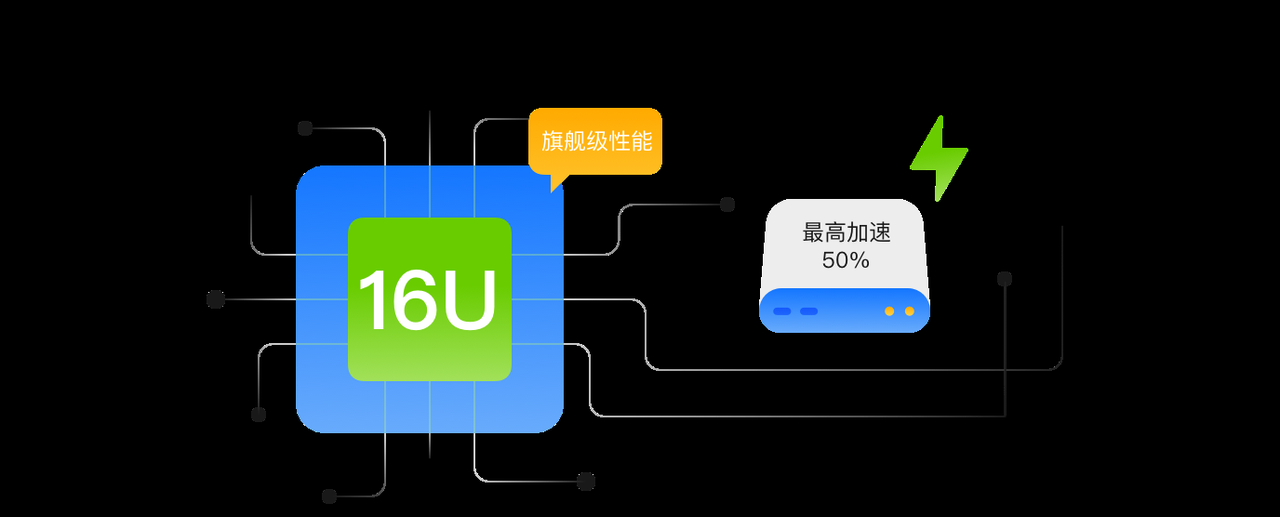

1.6倍算力支持

华为云的1.6倍算力支持,主要是基于华为云 Flexus X 实例,该实例依托擎天 QingTian 架构与瑶光云脑技术,融合大模型调度及智能加速算法,实现的 1.6 倍于业界通用独享产品的算力。

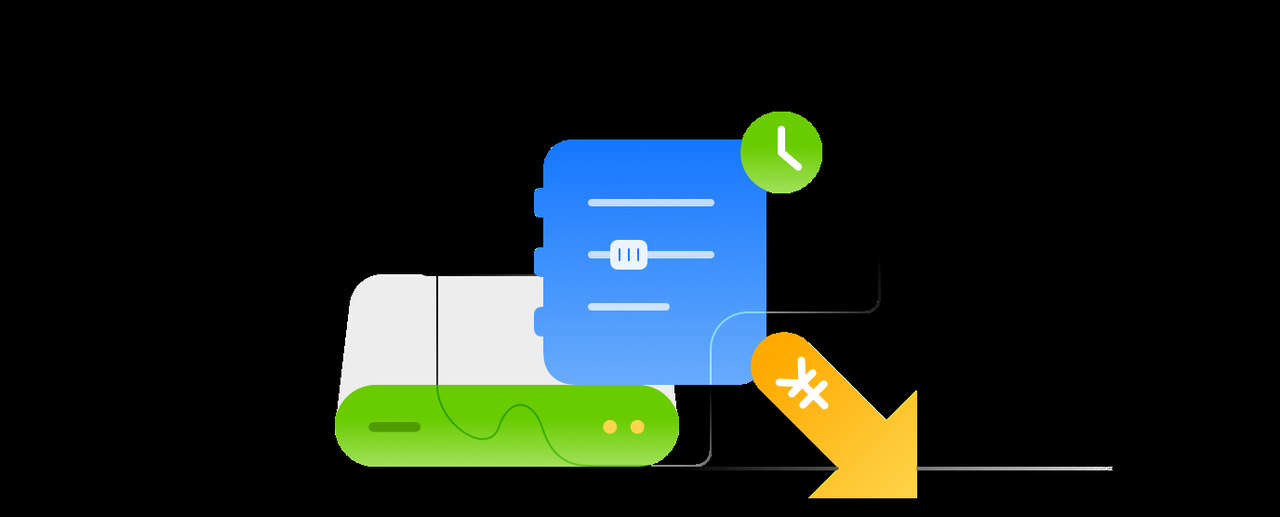

关键业务应用6倍加速

华为云的关键业务6倍加速,主要也是在Flexus X实例中,通过首创大模型加持,智能全域调度;X-Turbo加速,常见应用性能最高可达业界同规格6倍。

综合降本30%

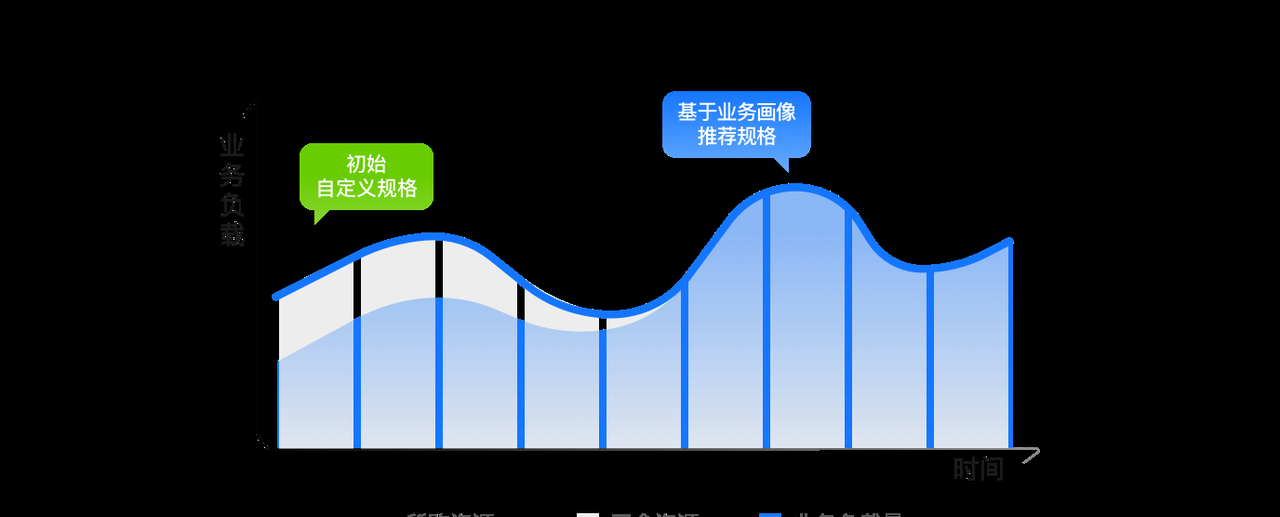

依托于华为云的迁移预画像、智能规格优化和超精细定价策略,真正地站在用户成本上考虑。达到了使用算力不浪费,资源和规格相匹配,定价友好,省钱。

相关算力支持,和关键应用6倍加速数据,综合降本详细数据请参见华为云Flexus X 实例产品

开通免费体验DeepSeek-V3/R1商用服务模型服务

友情提示:在开通模型服务前,请先登录/注册华为云平台账号,并进行实名认证,以便获取服务的开通。

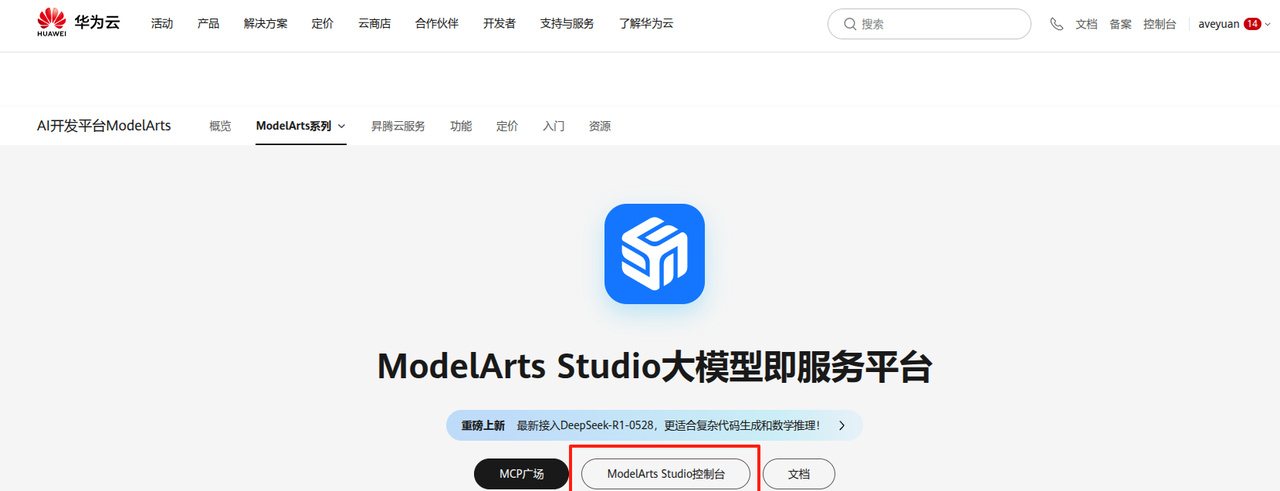

1. 打开ModelArts Studio_MaaS_大模型即服务_华为云,并点击 ModelArts Studio控制台

2. 在控制台中开通服务时勾选同意服务协议,选择西南贵阳一区(免费模型token)然后选择”模型推理 -> 在线推理”,开通DeepSeek-V3-32K大模型的商用服务,目前提供了免费模型体验服务,可以先领取免费的Token进行实用。

3. 查看模型的调用参数

点击免费模型后面的使用说明,切换到OpenAI SDK,复制出API地址和模型名称到你的记事本(后面Dify模型配置调用会用到)

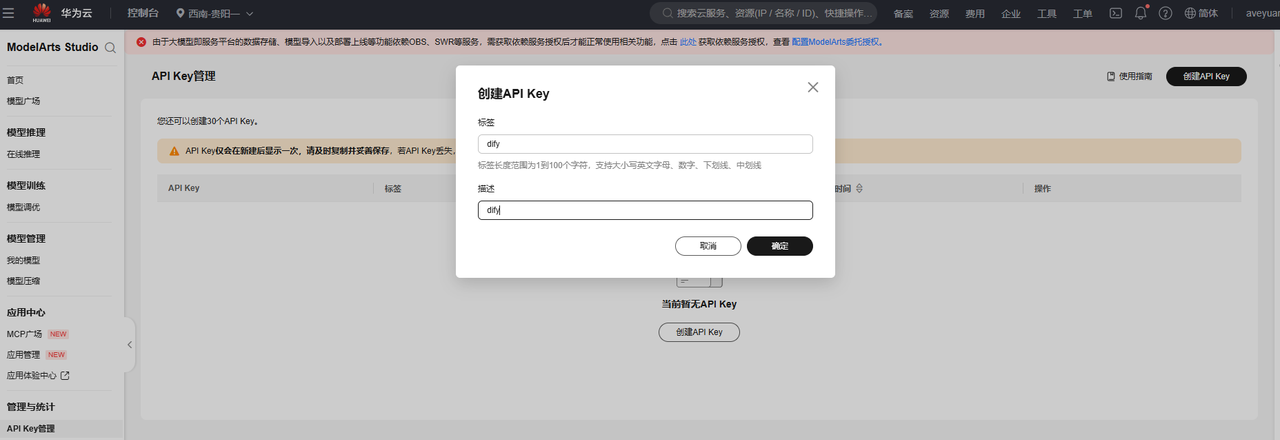

4. 开通apikey服务

在apikey管理,创建一个APIKEY,标签,描述写dify就行后门的apikey保存下来,后面有用

搭建部署Dify平台

充点小钱

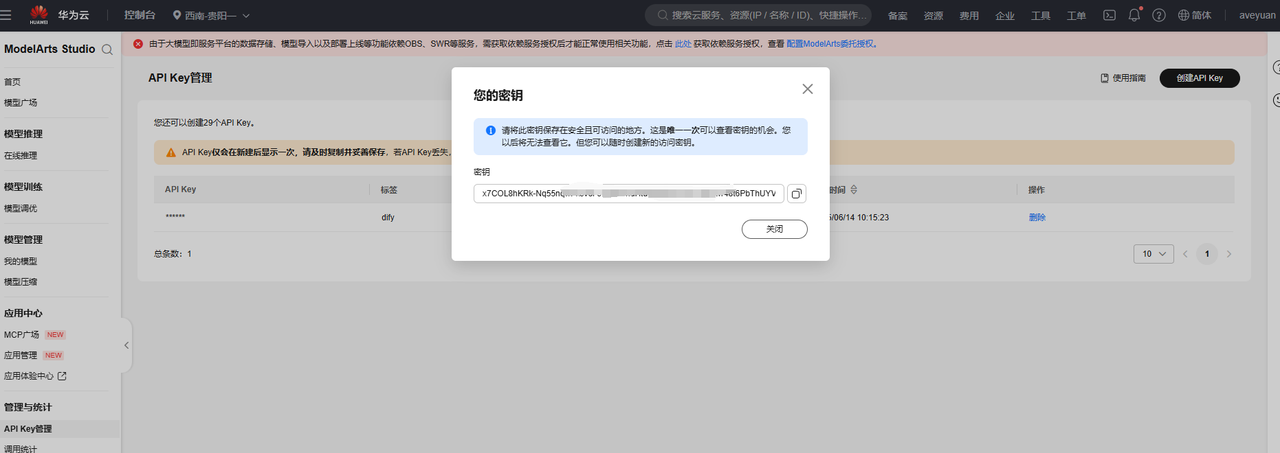

华为云的Dify服务不能免费体验,所以在使用前,需要先充值10元,如果你有钱,可以跳过这个步骤

1. 来点击费用中心,看看你有么有钱

2. 很好,跟我一样,余额0。现在和我一起点击充值按钮进行充值

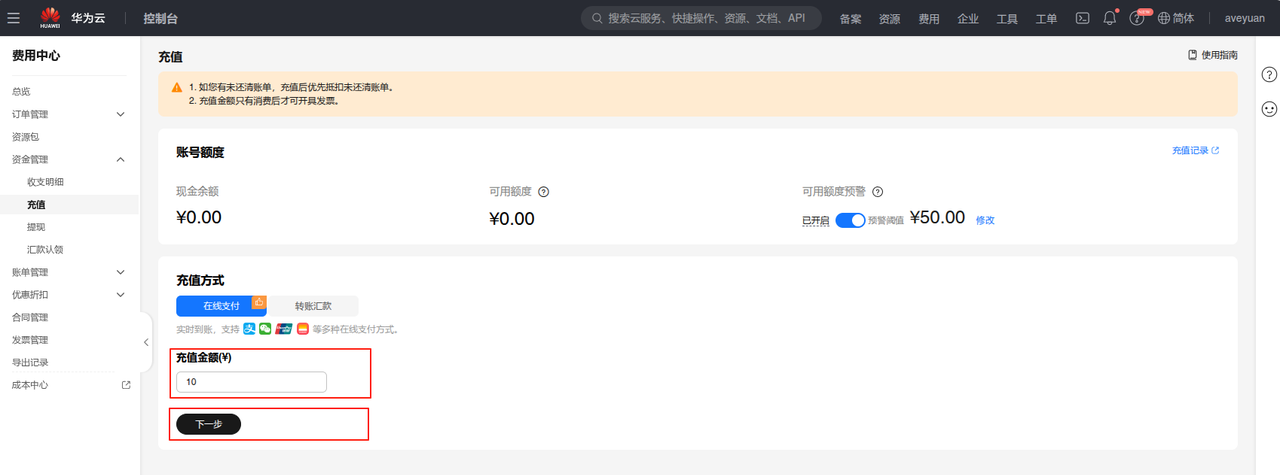

在充值页面中,输入10,点击下一步

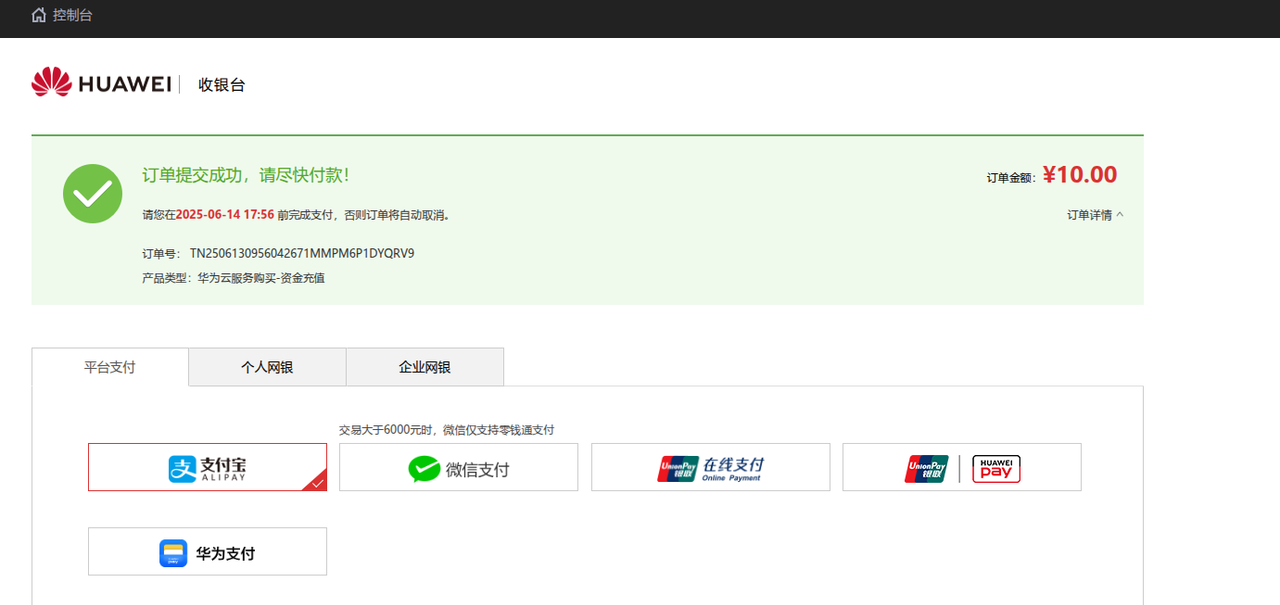

3. 选择你喜欢的平台进行付款

订单已经生成了,你喜欢支付宝还是微信支付?我选的支付宝,因为可以用花呗。也确实使用的花呗付款。

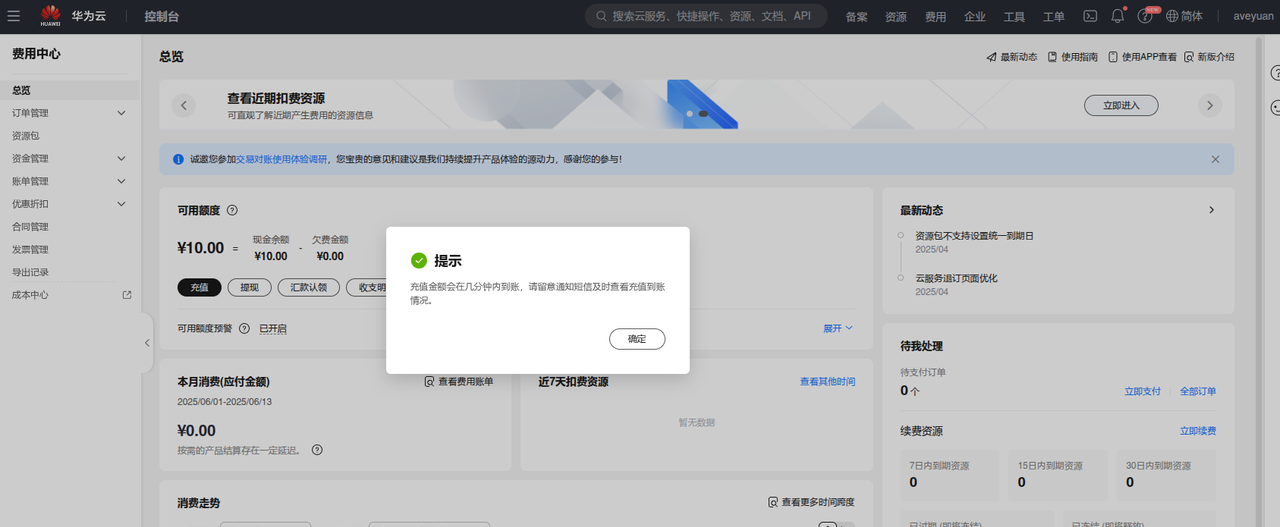

4. 恭喜你,支付成功了,现在有钱了,可以进行下一步了。距离AI应用又近了一步。想想还有点小激动呢。

Dify-LLM应用平台部署

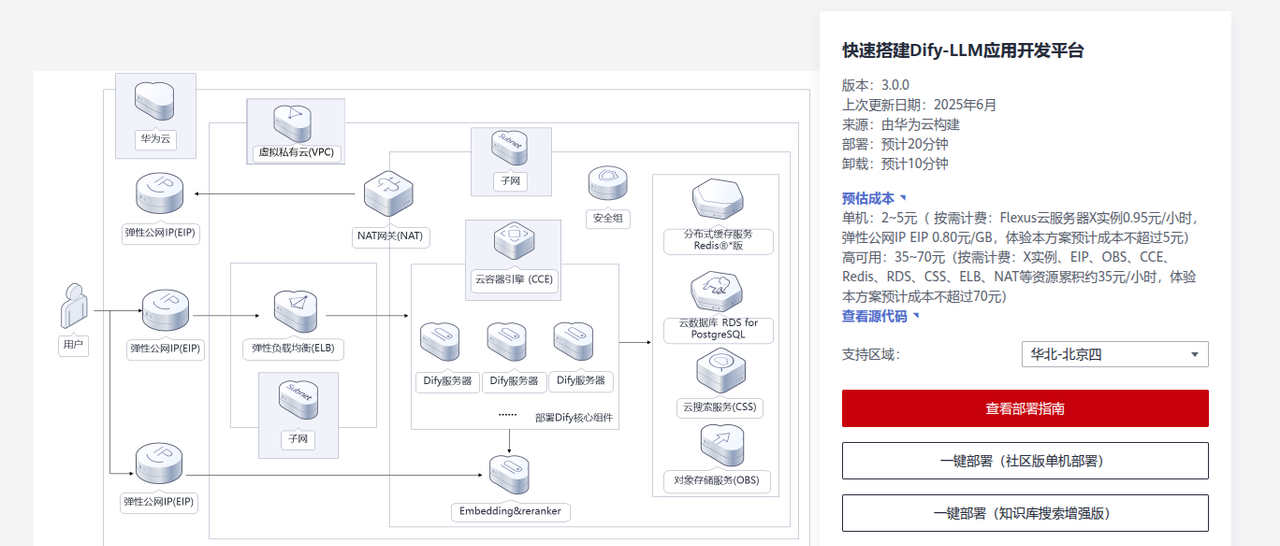

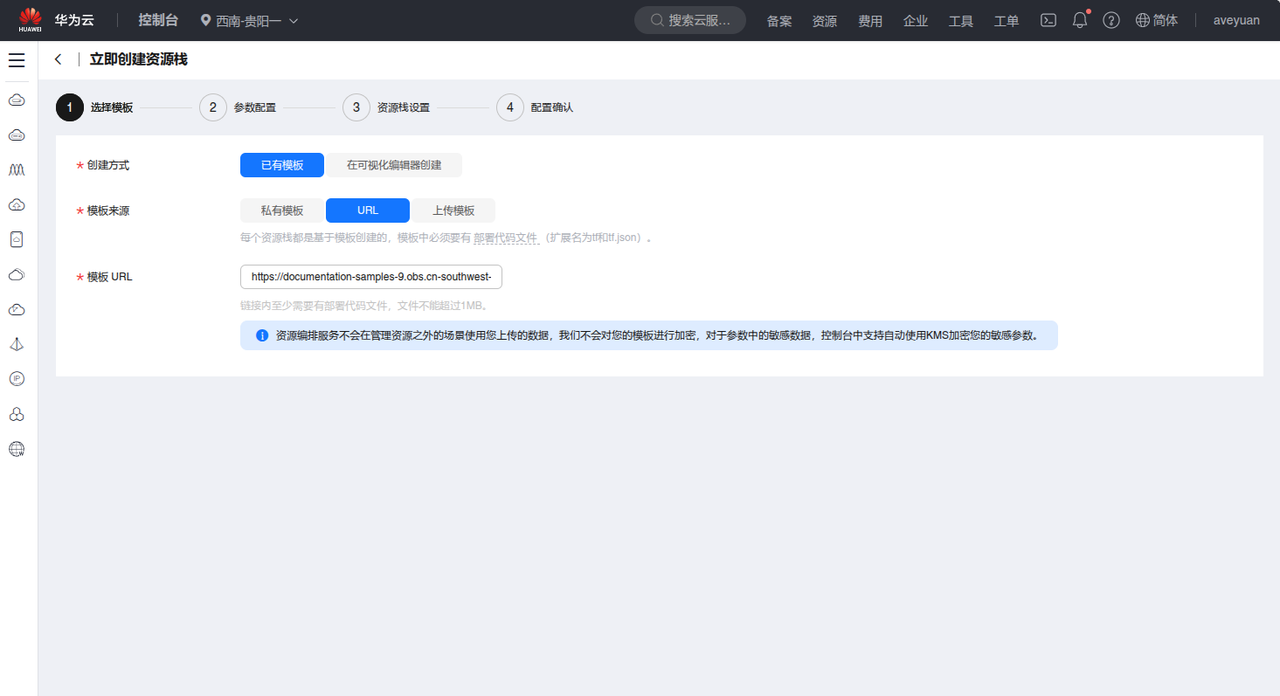

1. 访问 快速搭建Dify-LLM应用开发平台-华为云平台,有单机社区的,有高可用的的架构。你喜欢哪个?我选单机先试试看。

实例地区选择离你最近的就行,价格上没差异。

2. 选择默认的模板即可,不用改动任何配置,进行下一步

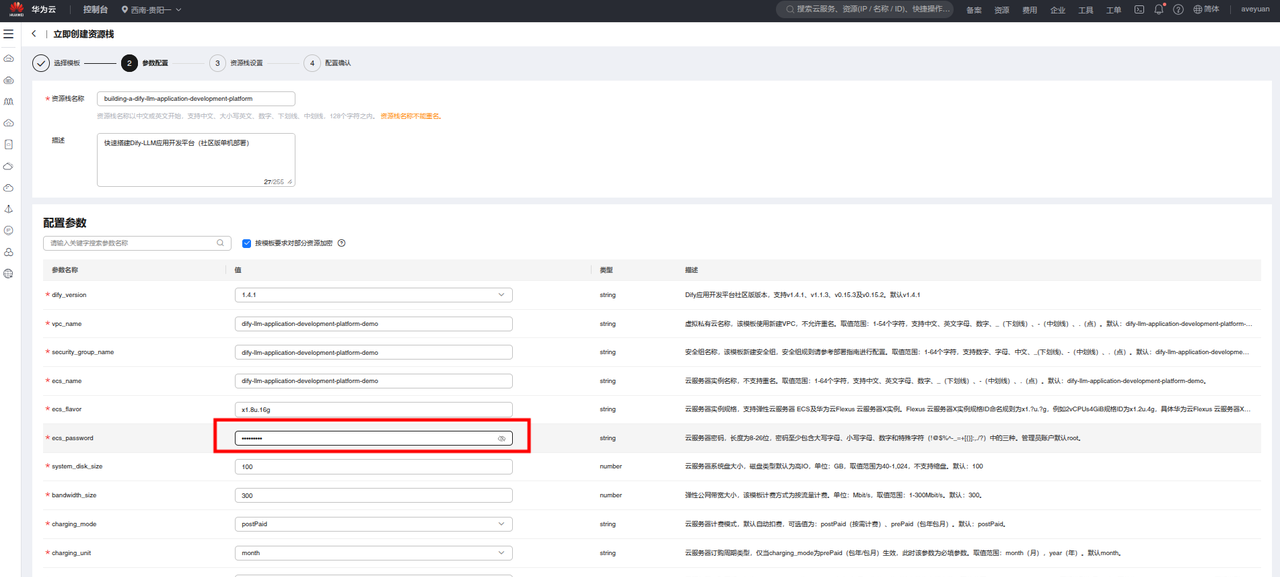

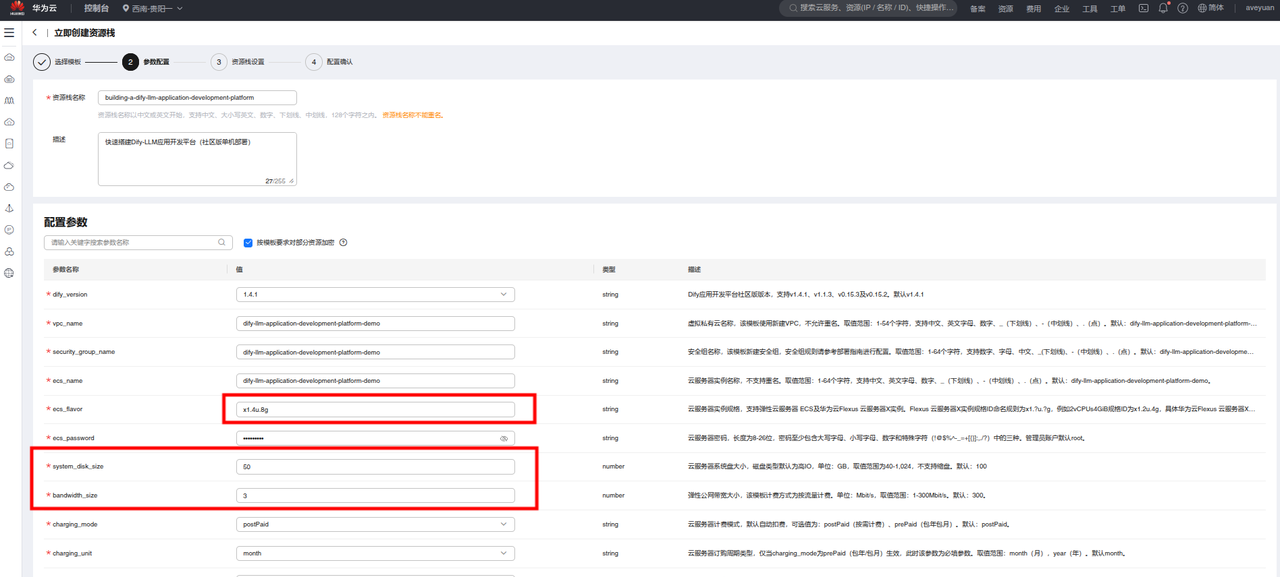

3. 看一下模板的参数配置

这里选择dify版本默认是1.4.1

默认的服务器配置是8核16G

默认的硬盘是100G

默认的贷款是300M

注意:填写你的密码。

单机版配置都给这么高吗?

3.1 等等如果你只是想体验的话,服务器没必要开那么大的,还是和我一起,调整下。

配置调整为4核8G

磁盘调整为50G

带宽调整为3M

体验用,够了,多的钱,留着还能多体验几小时,他不香?跟着本教程混,是不是有种赚到了的感觉?没错,学习体验跟上的情况下,冤枉钱,一分也不能多花。

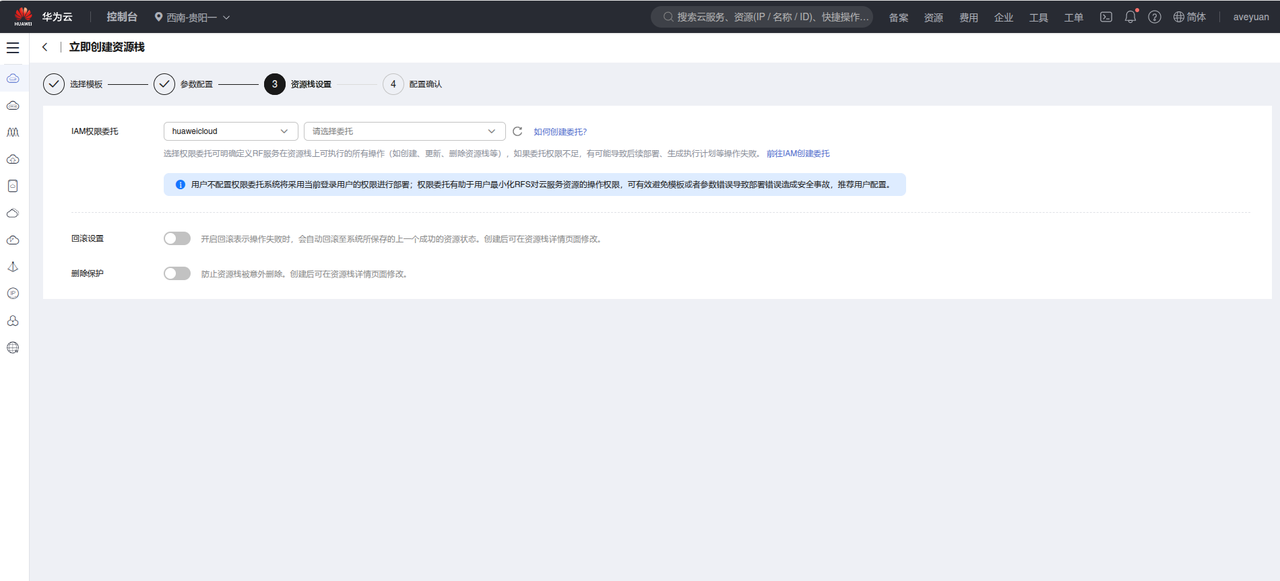

4. 点击下一步,出现了IAM委托

IAM委托是提供给公司使用的,给了更多的权限,目前我们个人测试使用,不用开。下面的回滚设置,删除保护,也不用。继续下一步。(如果你是企业用户,并且有多人权限分配,这步可以配置下)

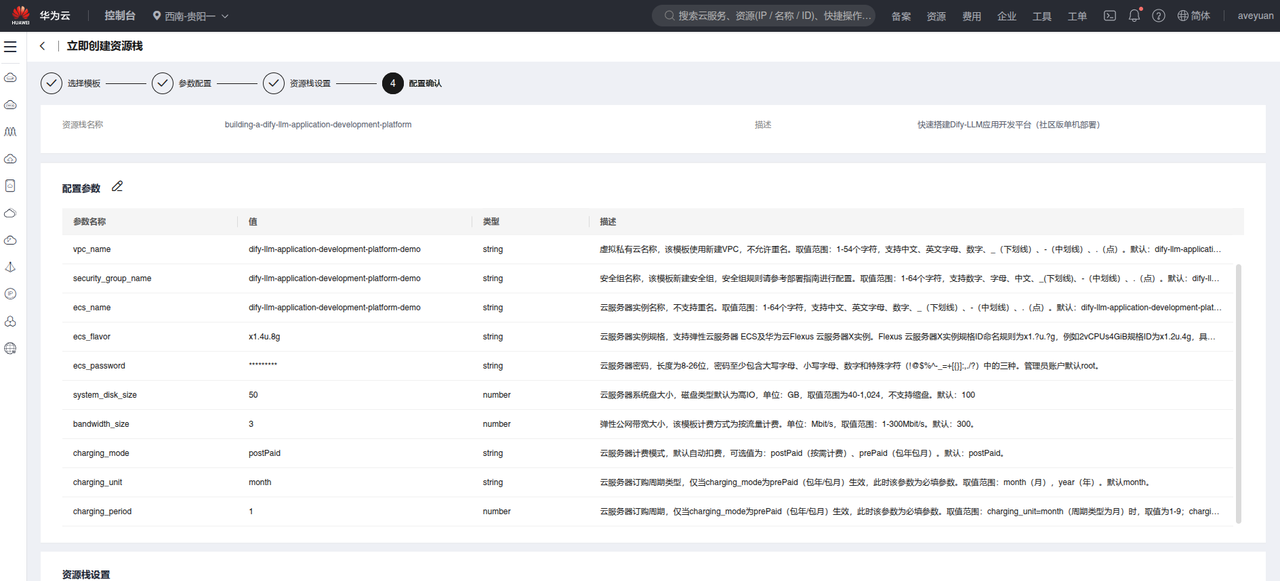

5. 配置确认

这里可以看到我们配置数据总览,进行确认一下,没问题就下一步

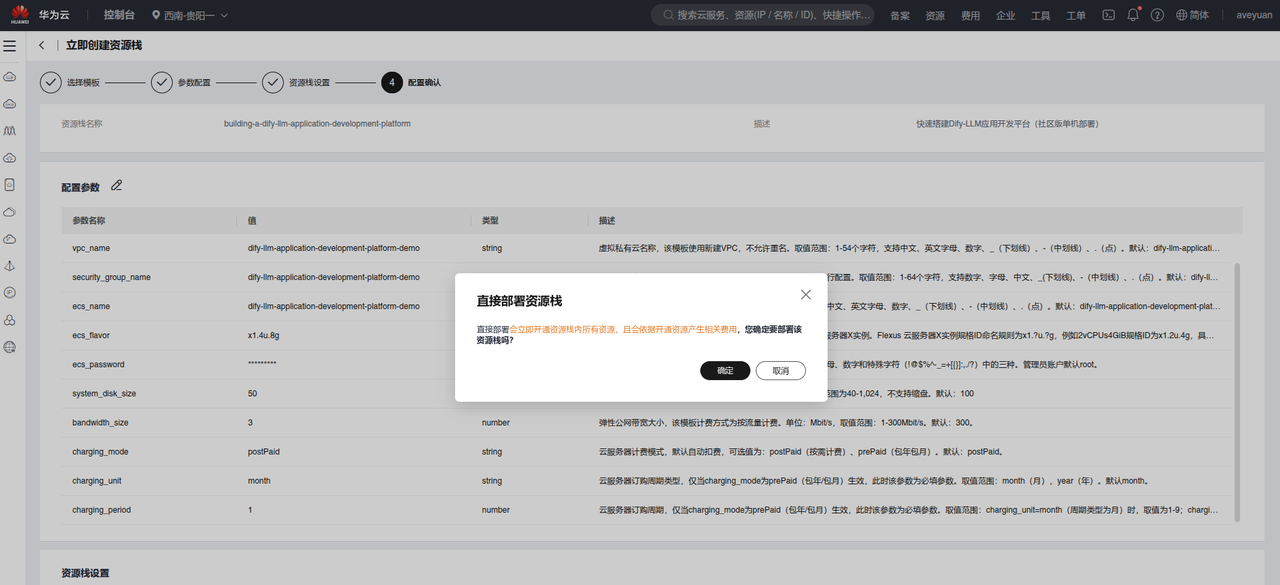

6. 点击直接部署

直接部署资源栈与创建执行计划的不同的地方在于,“创建执行计划”可以看到比较详细的部署流程,万一有错误,可以及时的发现与调整。根据你的需求来哈,你想要看细节还想想一把梭?我选择一把梭。

点击后还有一个确认的过程中,他提示我们,这个要产生费用。你如果没钱肯定会部署失败,可以看看上面的充值过程。如果你有钱,还要犹豫一下?还等什么呢?给我点确定。开通

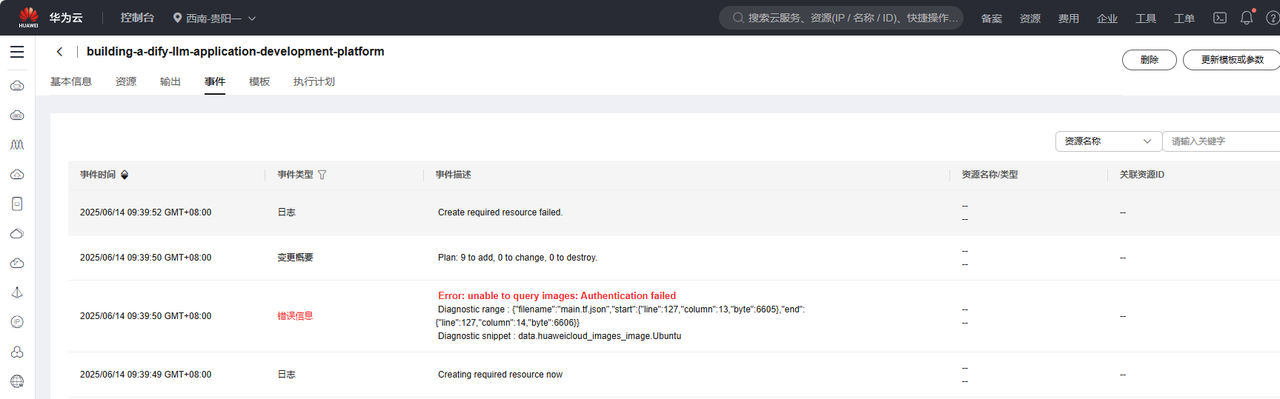

7. 踩坑了,部署失败

目前在贵阳节点,部署会失败

8. 更换到上海节点,完成

在右上角删除资源,然后重新,选择上海部署

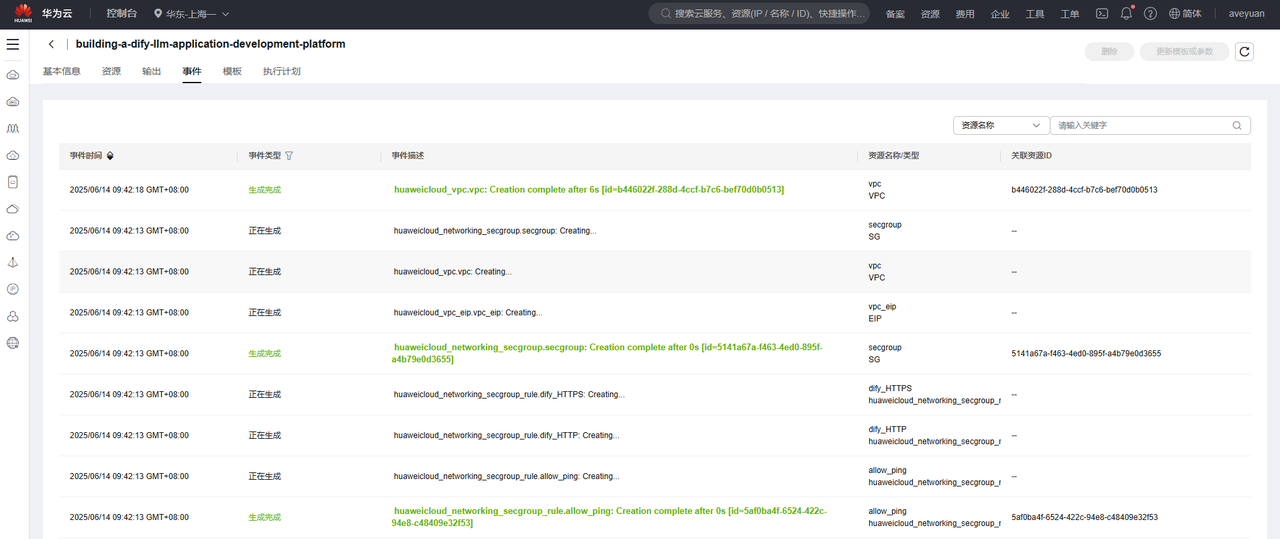

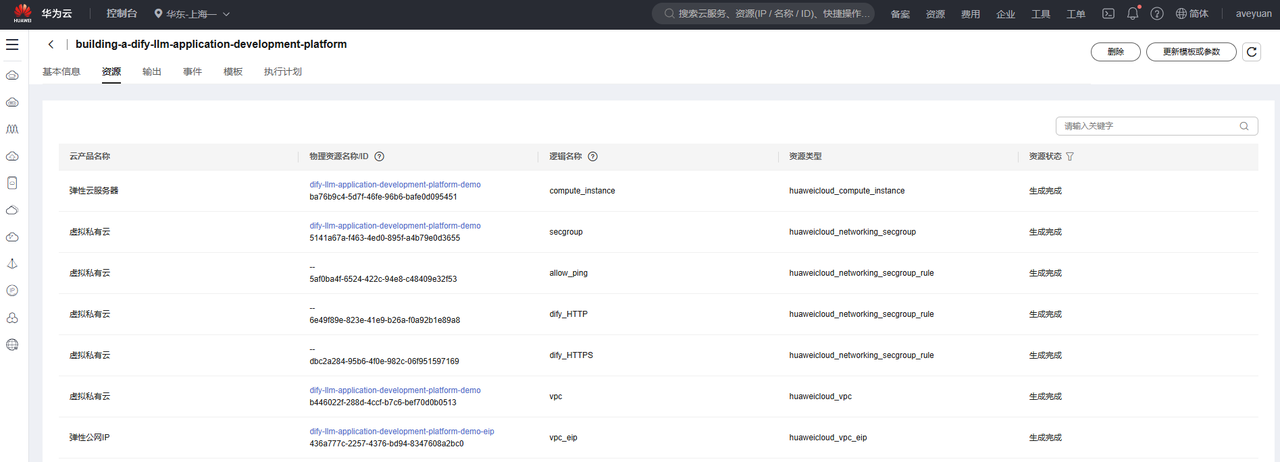

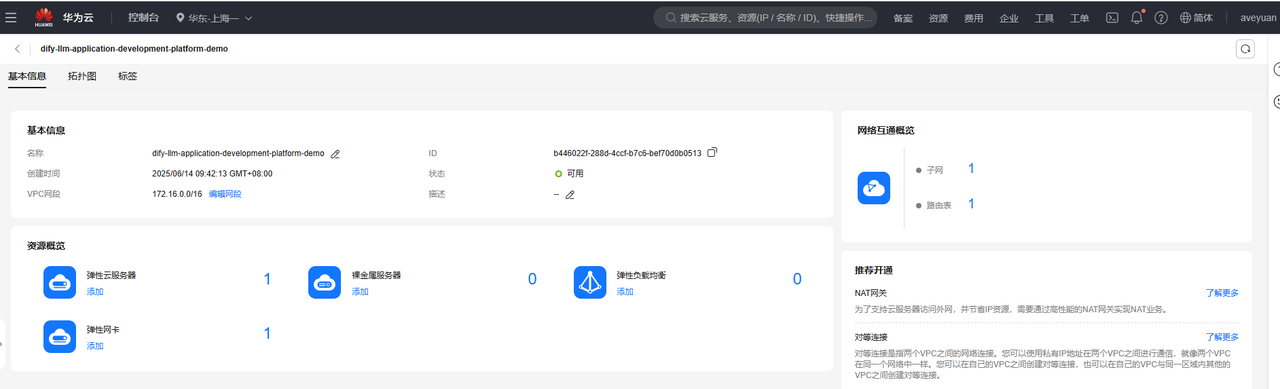

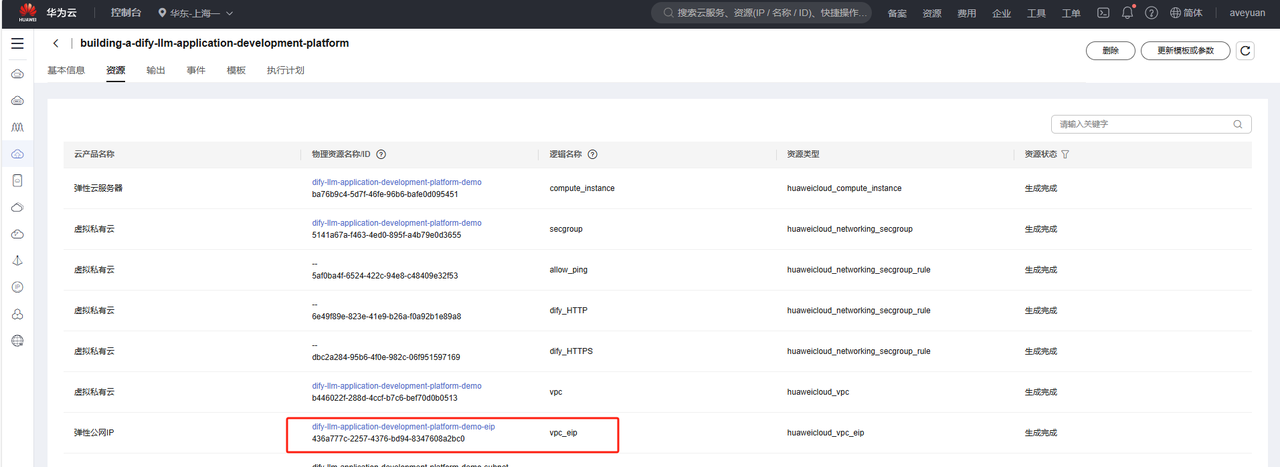

9. 资源概览

看看通过模板部署创建的资源列表

进入初始化DIfy控制台

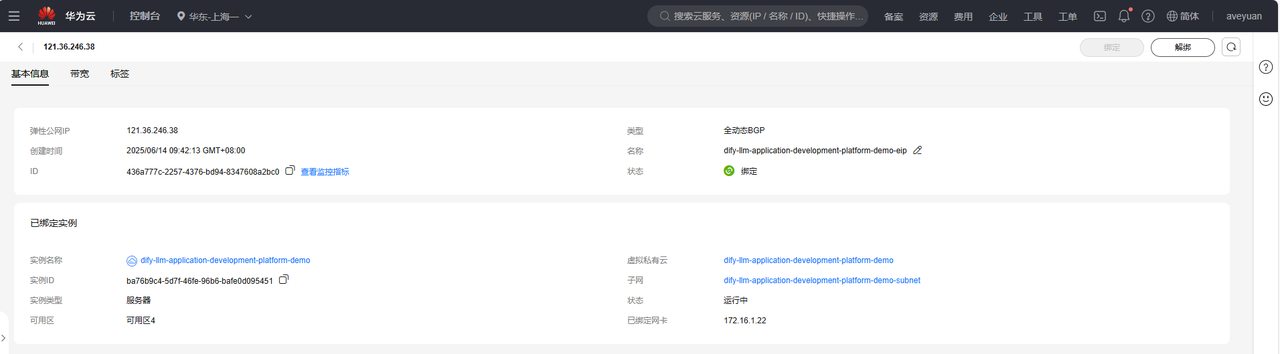

1. 在上面的弹性IP资源中,我们找到可以访问的公网IP地址

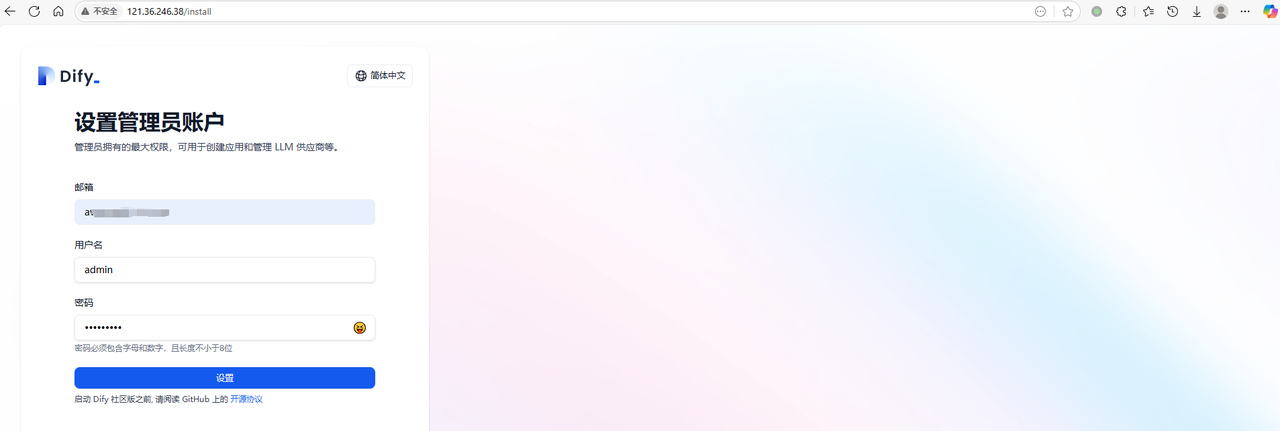

2. 访问Dify控制台

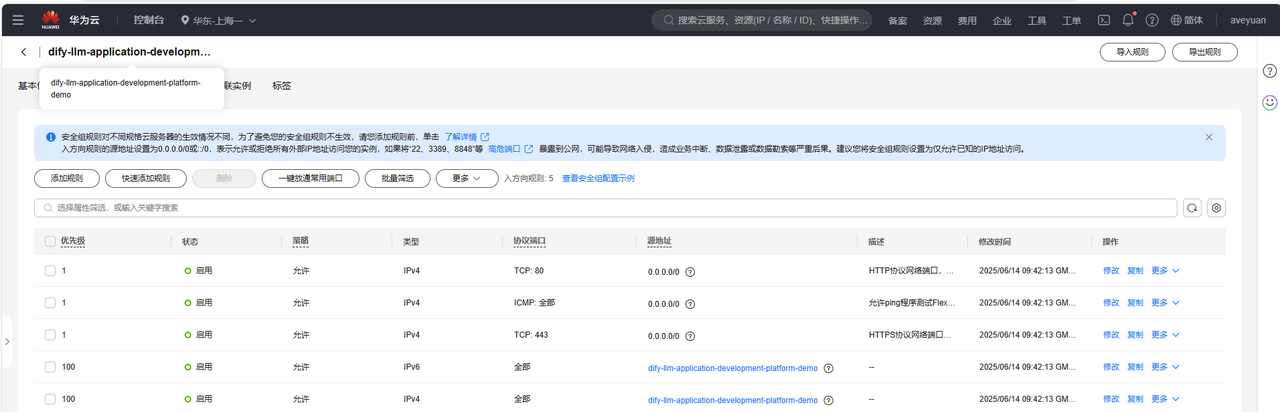

因为安全组已经已经放行了80端口,我们直接使用80端口,打开后,设置以下你的邮箱,账户名和密码,最后点击设置。

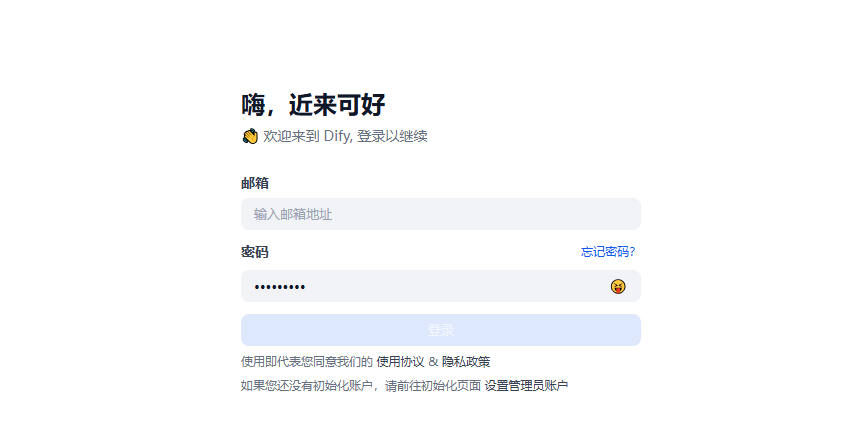

3. 登录dify

通过上面设置的邮箱和密码登录

4. 登录到工作台

5. 到这个过程中,开通搭建部署工作就已经完成了。

小试牛刀

设置模型

目前我们已经开通了DeepSeek-V3/R1服务,也已经搭建了Dify平台,接下来就开始将这两者结合,起来做做一个AI聊天应用吧。

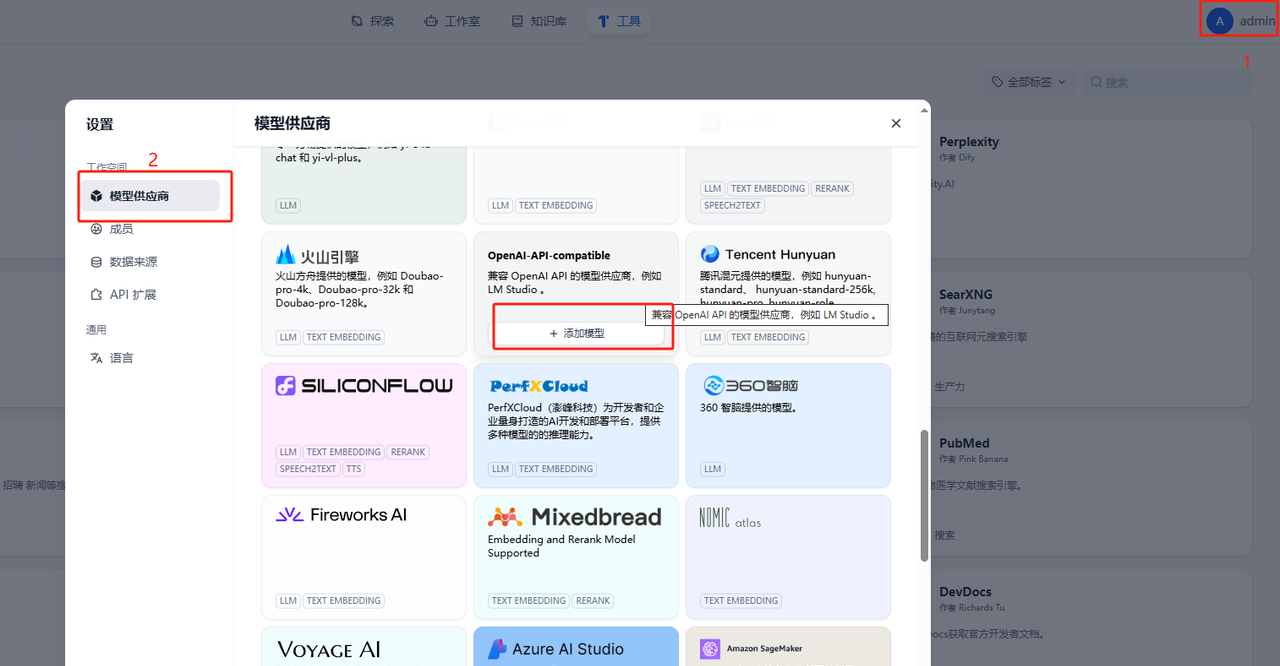

1. 设置OpenAI模型

在右上角个人图标中点击设置,然后在模型供应商中点击OpenAI-API-compatible,点击添加模型

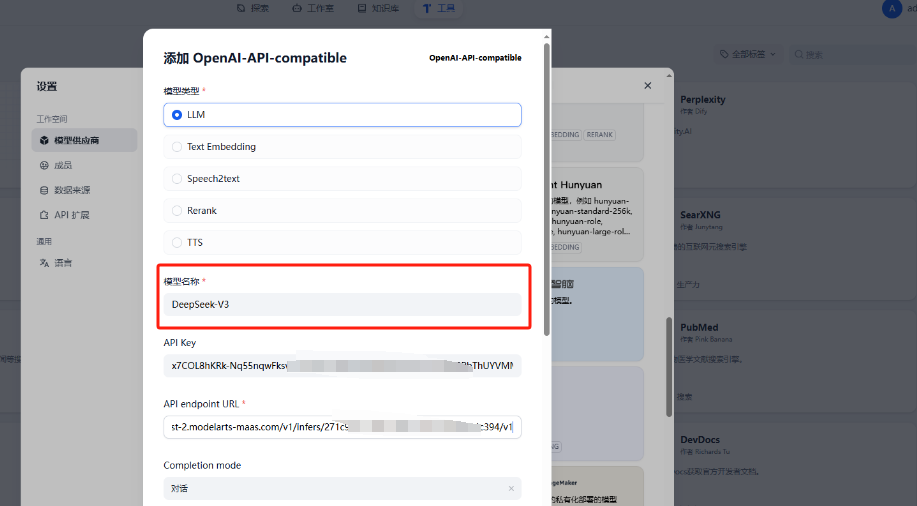

2. 填写相关模型信息

(下面4点请注意位置)

2.1 模型类型选择LLM

2.2 模型名称不能乱填,选择DeepSeek-v3 (和在线推理-服务里面的使用说明定义的一致)

2.3 ApiKey填写在ModelArts控制中心里面申请的ApiKey

2.4 Endpoint填写模型的地址 (和在线推理-服务里面的使用说明定义的一致)

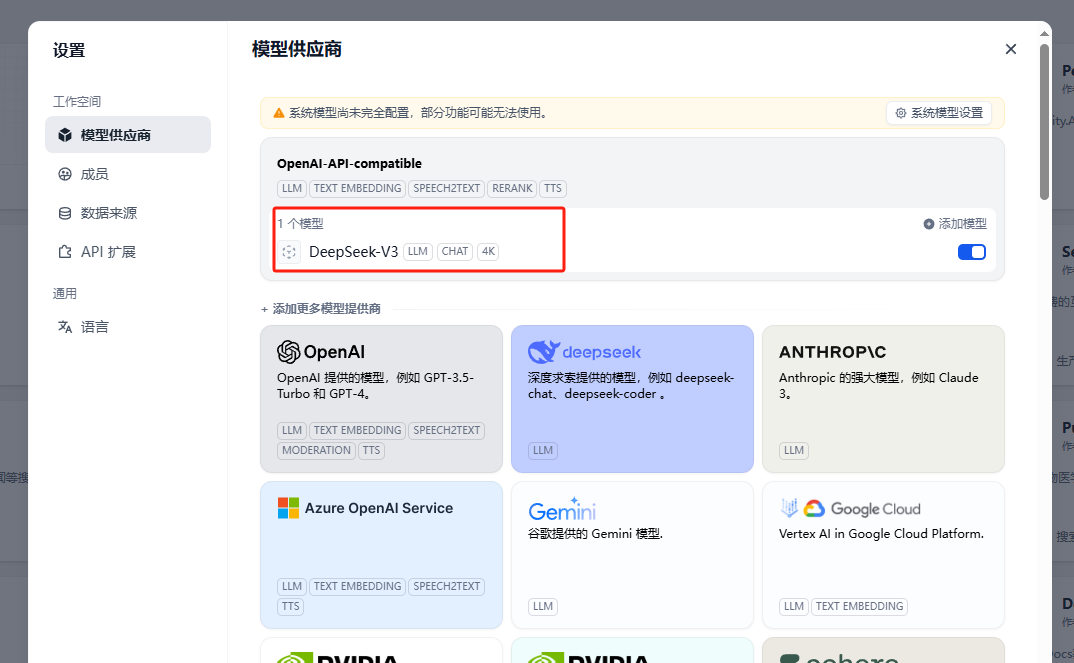

3. 模型添加好以后,我们就能看到启用的模型了

开启AI对话

现在,我们来到工作室,开始使用AI进行对话

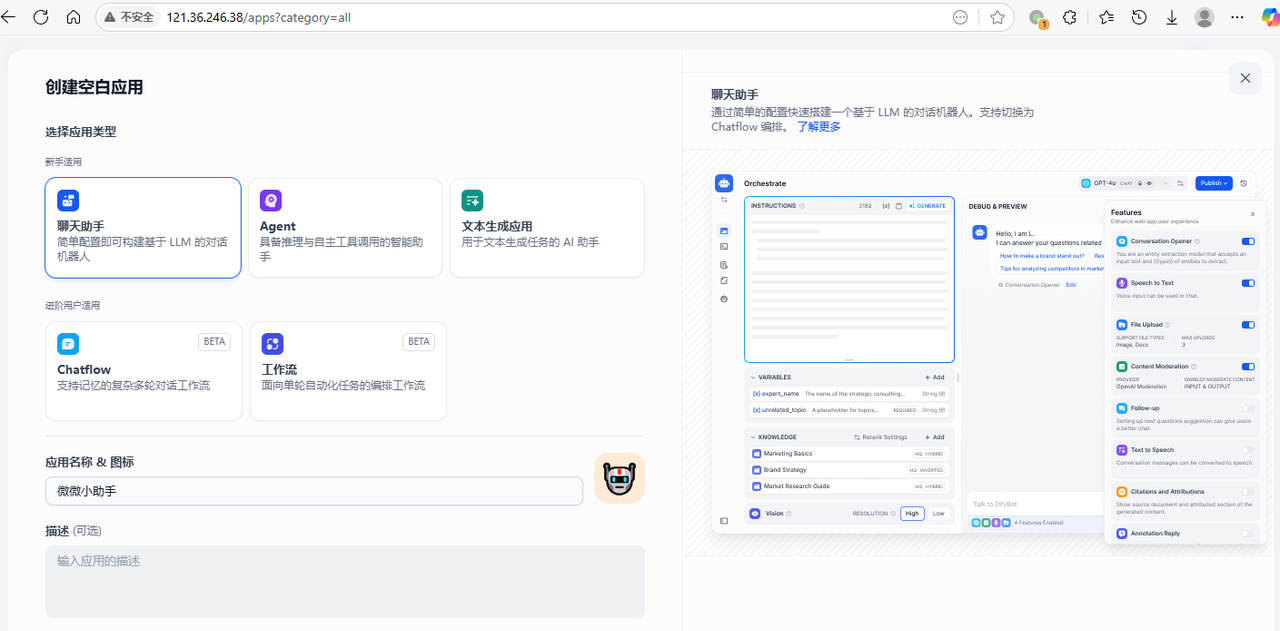

1. 选择工作室,点击创建空白应用

2. 点击聊天助手,取个名字,这里我叫微微小助手,图标你自己看。描述随便,我这里没写。为了做实验嘛,先掠过。

3.开始体验

点击去设置,选择以下之前配置的模型,再更新以下就ok了(怀疑是同步问题,就这样操作)

点击更新了以后,界面就正常了。

4. 得到结果

简单的设置一个系统提示词,然后再聊天框中发送你的问题,得到答案

下面是AI的回答,比较专业全面,分析了各种利弊,和替代的方法,可以帮助我们进一步优化代码

# Go语言中实现递归

递归是一种函数调用自身的技术,在Go语言中实现递归和其他语言类似。下面是Go语言中递归的基本实现方法和一些注意事项:

## 基本递归实现

```go

package main

import "fmt"

// 经典的阶乘递归实现

func factorial(n int) int {

if n <= 1 { // 基本情况(递归终止条件)

return 1

}

return n * factorial(n-1) // 递归调用

}

func main() {

fmt.Println(factorial(5)) // 输出: 120

}

```

## 递归三要素

1. **基本情况**:递归的终止条件,防止无限递归

2. **递归情况**:问题分解为更小的子问题

3. **向基本情况推进**:每次递归调用都应使问题更接近基本情况

## 常见递归示例

### 1. 斐波那契数列

```go

func fibonacci(n int) int {

if n <= 1 {

return n

}

return fibonacci(n-1) + fibonacci(n-2)

}

```

### 2. 二分查找(递归实现)

```go

func binarySearch(arr []int, target, low, high int) int {

if low > high {

return -1 // 未找到

}

mid := low + (high-low)/2

if arr[mid] == target {

return mid

} else if arr[mid] > target {

return binarySearch(arr, target, low, mid-1)

} else {

return binarySearch(arr, target, mid+1, high)

}

}

```

## 递归的注意事项

1. **栈溢出风险**:Go的调用栈默认有限(约1GB),深度递归可能导致栈溢出

2. **性能问题**:某些递归(如普通斐波那契实现)会产生大量重复计算

3. **尾递归优化**:Go不保证尾递归优化,深度递归应考虑迭代实现

## 递归转迭代

对于可能产生深度递归的情况,通常建议使用迭代:

```go

// 阶乘的迭代实现

func factorialIterative(n int) int {

result := 1

for i := 2; i <= n; i++ {

result *= i

}

return result

}

```

## 使用递归的场景

递归适合处理:

- 树形结构遍历(二叉树、目录遍历等)

- 分治算法(如快速排序、归并排序)

- 组合问题

- 某些数学定义明确的算法(如斐波那契)

递归代码通常更简洁直观,但需要权衡性能和可读性。发布你的Ai应用

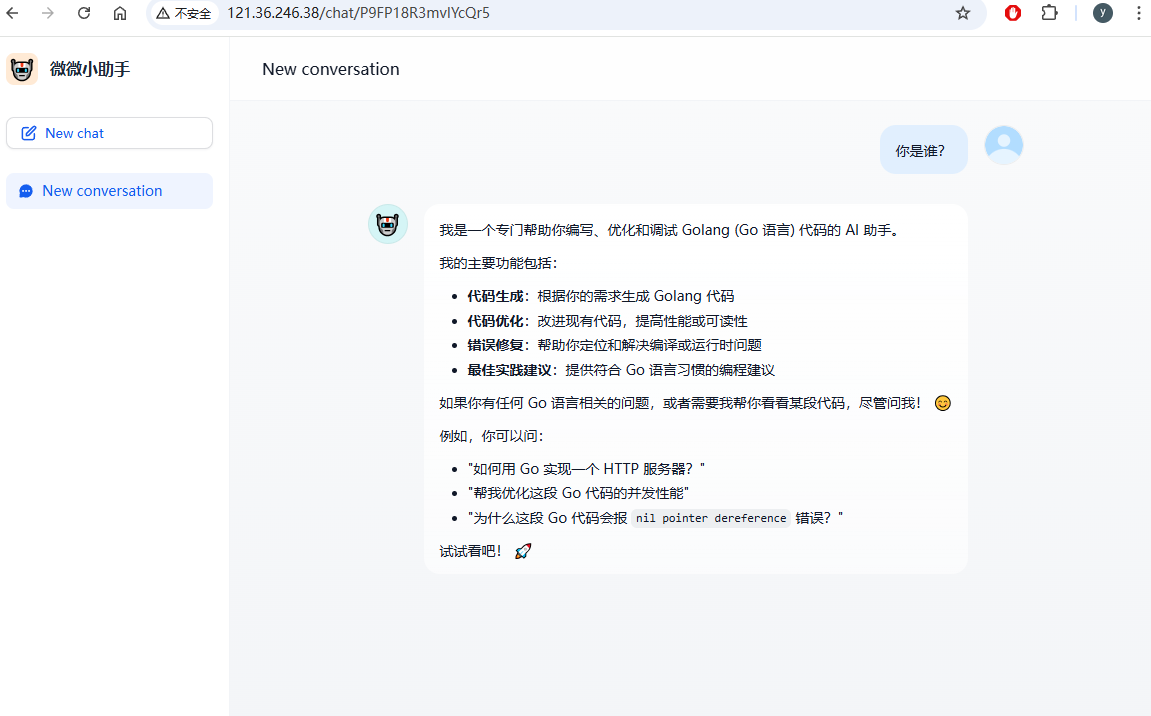

在上面的小试牛刀中,我们已经体验到了如何通过dify与deepseek模型结合,并打造一个聊天助手,接下来,我们将这个聊天助手进行发布到外部使用

1. 在右上角点击发布,先更新以下提示内容,然后点击运行

2. 你的Ai工具已经就位

点击运行,此时dify系统会为刚刚这个应用生成一个外部可调用的AI工具

3. 给你周边的同事/朋友使用吧

将你发布的AI应用地址发给你的同事/朋友,你的朋友就可以开开心地使用拉

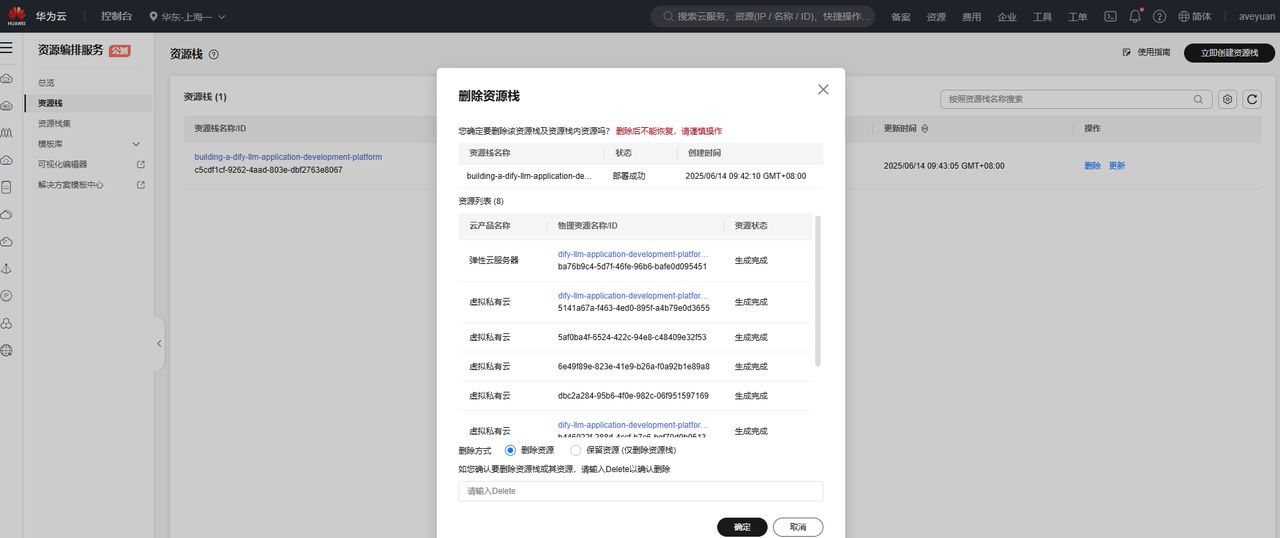

回收清理资源

特别注意:如果你不想使用dify了,需要自己手工进行资源的清理,不然是会一直扣费的,另外,模型开通的是免费的服务,领取的免费的token,那个不用管。用完了,再购买就好了。

点击资源控制中心选择你所在的地区,进行资源回收

关于体验成本

得益于华为云的成本控制系统非常的精细,所以,目前体验了一个多小时,才用了6毛钱不到。所以,大家在体验的过程中,可以放心的冲。也就是说,一天才15块左右的成本。这点非常的nice。

结语

在这里,10分钟带你从0到1在华为云上完成Dify-LLM应用开发平台搭建并发布自己的AI工具应用,从模型服务的开通到Dify平台的搭建,到小试牛刀做一个基础的小助手工具,到最后把你的小助手工具进行发布使用。整个过程没有一点水分,全是干货,得益于华为云的一键部署方案,部署非常快,省心,成本也不高,冲个10快钱差不多可以快乐地使用一天。

暂无评论内容