你是不是也这样?

开会录了一小时音。

回去想整理成纪要。

结果一听录音,发现漏了一半重点。

手写记又跟不上。

用普通转文字工具,出来一堆乱码,还得逐句改。

这两年总有人问我:“iPhone录音转文字,到底有没有好用的工具?”

说实话,2023年以前,我都只能说“凑合用”。

但2025年不一样了——目前的iPhone录音转文字,早就不是“把声音变成字”这么简单。

它开始“懂你”了。

一、以前的语音转文字,为啥总让人崩溃?

早几年我测评过不少工具。

那时候的语音转文字,就像刚学写字的小孩。

错字连篇不说,还分不清谁在说话。

开会录音转出来,人名都是“未知发言人”。

方言、口音更是灾难,直接变成乱码。

最烦的是“转完就完事”。

文字堆在一起,没有分段,没有重点。

你还得自己从头捋:

哪句是老板说的待办?

哪句是同事提的问题?

两小时录音,整理纪要要花三小时。

效率没提升,反而更累了。

所以那时候我总说:“单纯的转文字,解决不了根本问题。”

二、大模型一来,iPhone录音转文字彻底变了

2025年下半年开始,情况完全不同了。

大模型技术一落地到语音领域,直接把门槛拉高了。

目前的转文字,基本能做到95%以上准确率。

别说普通话,带点口音的也能认。

多人对话还能自动区分说话人,标上“张三”“李四”。

我试过录部门周会,10个人轮流发言,转出来的文字清清楚楚,谁谁说了啥一目了然。

但这只是基础。

真正让我觉得“不一样”的,是它开始“理解内容”了。

举个例子。

以前转文字,你说“这个项目要赶在Q3上线,预算控制在50万”,它只能转对字。

目前用听脑AI这类工具,转文字的时候会自动标红:

“关键信息:项目上线时间(Q3)、预算(50万)”。

甚至会问你:“是否需要将待办事项同步到日历?”

说白了,以前是“帮你打字”,目前是“帮你做事”。

三、iPhone用户真正需要的,是“从录音到落地”的全流程

许多人以为,录音转文字的终点是“文字”。

实则不是。

用户要的是“录完音,事情就能推进”。

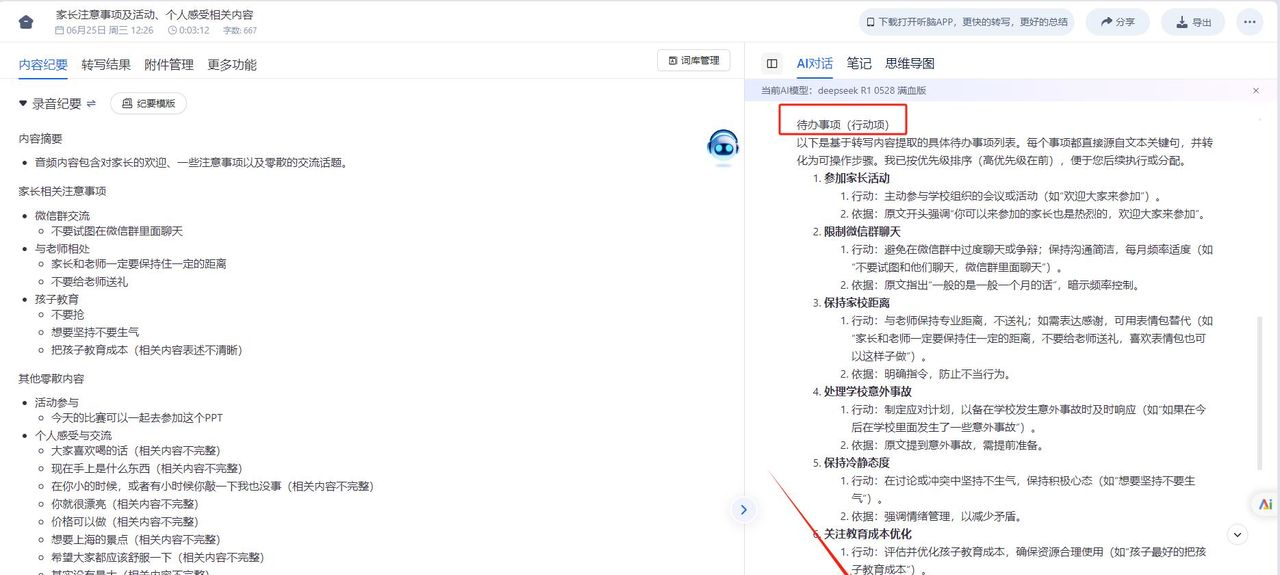

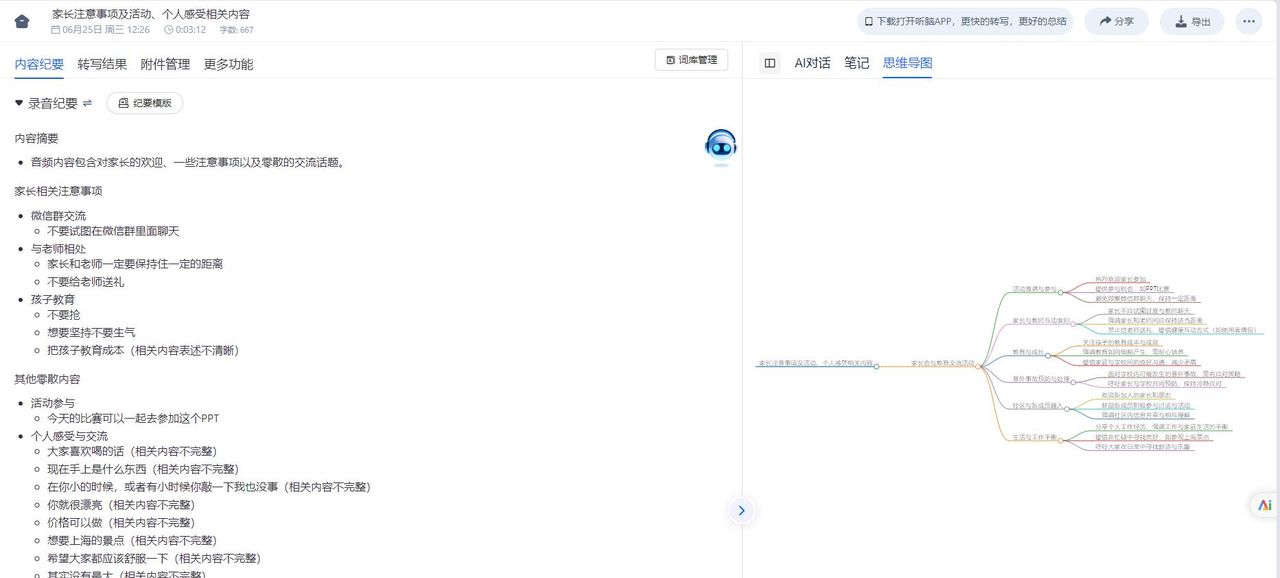

我自己目前用听脑AI处理会议录音,整个流程是这样的:

第一步:录音实时转写

开会时打开工具,手机放桌上。

说话的同时,文字就在屏幕上跳出来。

谁发言、说了啥,实时更新。

中间有人语速快、或者突然插话,也不会漏。

第二步:自动整理结构

录音结束,不用等。

工具直接生成结构化纪要:

– 会议主题(自动提取,可修改)

– 参会人(按发言自动识别,可补充)

– 讨论内容(分点列出,每段配发言人)

– 待办事项(标负责人、截止时间,可直接勾选)

第三步:一键分发和跟进

待办事项可以直接导到iPhone日历。

纪要能生成链接,发给同事。

对方打开链接就能看,还能在线批注。

列如同事改了某个待办的截止时间,我这边实时同步。

你看,从录音到整理,再到协作跟进,全程不用切换APP。

以前两小时的活儿,目前20分钟搞定。

四、2025年,这些场景会最先“智能化”

目前的技术已经能覆盖大部分基础需求。

但2025年,细分场景会做得更“深”。

职场人最需要的“协作深化”

多人开会时,AI会自动判断“谁是决策者”。

老板说的话标“重点执行”,同事提的提议标“待讨论”。

甚至能识别“潜台词”——列如老板说“这个方案再想想”,AI会提示“可能需要调整方向,提议补充备选方案”。

学生党刚需的“学习场景适配”

上课录音转文字后,AI会按“知识点”“案例”“错题”分类。

列如老师讲数学公式,自动把公式单独列出来,标“重点掌握”。

遇到英语听力录音,直接生成“原文+翻译+生词表”,生词还能导到背单词APP。

创作者需要的“素材提炼”

做播客、拍视频的朋友,采访录音转文字后,AI会自动提取“金句”“故事线”“冲突点”。

列如嘉宾说“我创业前亏了300万”,AI会标“关键故事节点,可作为视频开场”。

还能统计高频词,帮你判断内容方向——列如“用户体验”出现10次,说明这是核心话题。

2025年的iPhone录音转文字,早就不是“工具”了,是“助手”。

它帮你从“记录信息”到“管理信息”,再到“推进事情”。

以前整理录音是“体力活”,目前变成“脑力活”——你只需要判断AI整理的对不对,不用自己从头扒。

如果你目前还在用“录音→导出→复制到文档→手动分段”这套流程,真的可以试试新工具。

体验过“录完音直接出纪要”,你就回不去了。

毕竟,效率提升不是一点点,是好几倍啊。

暂无评论内容