Agentic AI的10大技术创新案例:提示工程架构师的必备技能

关键词:Agentic AI、提示工程、工具调用、记忆机制、多模态交互、任务规划、多Agent协作、因果推理、个性化、伦理安全

摘要:当AI从“执行指令的工具”进化为“能自主思考、协作、学习的助手”,Agentic AI(智能体AI)成为下一代AI的核心方向。本文通过10个真实技术创新案例,拆解Agentic AI的底层逻辑,并揭示提示工程架构师如何通过“设计提示”操控这些智能体——就像给“贾维斯”写“行为指南”,让AI从“听话的工具”变成“懂你的伙伴”。无论你是想进入提示工程领域的新人,还是想升级技能的资深开发者,都能从本文获得可落地的思考框架和实战技巧。

一、Agentic AI:从“工具”到“助手”的进化

1.1 为什么需要Agentic AI?——用“订奶茶”理解传统AI的局限

假设你想让AI帮你订奶茶,传统AI(比如ChatGPT 3.5)会怎么做?

你说:“帮我订杯珍珠奶茶,少糖少冰。”AI回复:“好的,请提供你的地址和联系方式。”你提供后,AI说:“已帮你生成订单,请注意查收。”

但如果遇到特殊情况呢?比如:

你突然问:“附近哪家奶茶店有优惠?”传统AI可能需要你重新发起指令,无法自动关联之前的“订奶茶”任务;如果你说:“我现在改主意了,要半糖热饮。”传统AI可能需要你重复所有信息,无法记住你的“历史偏好”;如果你问:“帮我看看奶茶店的实时排队情况?”传统AI无法调用外部工具(比如外卖平台API),只能说“抱歉,我无法获取实时数据”。

这就是传统AI的核心问题:只能执行“单步指令”,无法“自主规划、记忆、协作”。而Agentic AI(智能体AI)的出现,就是要解决这个问题——它像一个“有自主意识的助手”,能:

主动思考:比如“用户要订奶茶,可能需要先查优惠、再看排队、再调整订单”;记住历史:比如“用户上次要了少糖少冰,这次可能还是类似偏好”;使用工具:比如自动调用外卖平台API查实时数据;动态调整:比如发现用户改了口味,自动更新订单。

1.2 什么是Agentic AI?——用“贾维斯”类比核心特征

Agentic AI(智能体AI)是指具备自主决策、环境交互、长期学习能力的AI系统,核心特征可以用《钢铁侠》里的“贾维斯”(J.A.R.V.I.S.)类比:

自主性:贾维斯能主动提醒托尼“导弹即将来袭”,而不是等托尼问;交互性:贾维斯能听懂托尼的语音指令,也能通过全息投影展示数据;记忆性:贾维斯能记住托尼的习惯(比如喜欢喝加冰的威士忌);协作性:贾维斯能协调钢铁侠的盔甲、无人机、实验室设备一起工作;学习性:贾维斯能从托尼的行为中学习,比如优化盔甲的战斗策略。

简单来说,Agentic AI = 传统AI + 自主决策模块 + 记忆系统 + 工具调用接口 + 多模态交互能力。

1.3 提示工程架构师的角色——给“贾维斯”写“行为指南”

如果Agentic AI是“贾维斯”,那么提示工程架构师就是“贾维斯的设计师”——通过设计提示(Prompt),定义AI的“行为逻辑”:

比如:“当用户问‘订奶茶’时,先查附近优惠,再问口味偏好,再调用外卖API下单”(定义任务流程);比如:“如果用户改了口味,自动更新记忆中的‘用户偏好’”(定义记忆规则);比如:“如果调用API失败,重试3次,然后告诉用户‘暂时无法下单’”(定义容错机制)。

提示工程架构师的核心任务,就是将“人类的需求”转化为“AI能理解的行为规则”,让Agentic AI从“听话的工具”变成“懂你的伙伴”。

二、Agentic AI的10大技术创新案例——从“原理”到“应用”

案例1:工具调用与API集成——让AI“使用手机查资料”

技术创新点:传统AI只能用内置知识回答问题,而Agentic AI能主动调用外部工具(比如API、数据库、搜索引擎),获取实时或专业数据。

真实案例:ChatGPT插件系统(2023年3月推出)

当用户问:“今天北京的天气怎么样?”ChatGPT会自动调用“天气API”,获取实时数据后回答;当用户问:“帮我查一下特斯拉的最新股价?”ChatGPT会调用“金融API”,返回实时股价和涨幅。

提示工程要求:需要设计“工具调用触发条件”的提示,比如:

“当用户的问题需要实时数据(如天气、股价)、专业知识(如法律条文)或外部资源(如文件内容)时,自动调用对应的工具。调用前需确认工具的可靠性,调用后需将结果整理成自然语言回答。”

案例2:长短期记忆机制——让AI“记住你的生日”

技术创新点:传统AI的“上下文窗口”(比如GPT-3的4k tokens)是“短期记忆”,关闭对话后就会忘记;而Agentic AI具备长短期记忆(LSTM)系统,能永久保存用户的历史数据(比如偏好、对话记录)。

真实案例:AutoGPT(2023年4月推出的开源Agentic AI框架)

AutoGPT有一个“记忆模块”,能将用户的对话、任务进展、工具调用结果保存到向量数据库(比如Pinecone);当用户再次发起任务时,AutoGPT会从记忆中提取相关信息,比如:“用户上次要我帮他写论文,主题是‘AI伦理’,这次他问‘AI伦理的最新研究’,应该关联之前的内容。”

提示工程要求:需要设计“记忆存储与检索”的提示,比如:

“将用户的每一次对话、任务结果、偏好设置保存到记忆库。当处理新任务时,先检索记忆库中的相关信息(如用户之前的需求、历史对话中的关键词),再生成回答。”

案例3:多模态感知与生成——让AI“看图片、听声音、说人话”

技术创新点:传统AI只能处理文字(比如ChatGPT 3.5),而Agentic AI能同时处理文字、图片、声音、视频等多模态信息,并生成多模态输出。

真实案例:GPT-4V(2023年9月推出的多模态大模型)

用户可以上传一张“猫的图片”,问:“这只猫是什么品种?”GPT-4V会分析图片中的猫的特征(比如毛色、体型、耳朵形状),回答:“这是一只英国短毛猫,特征是圆滚滚的身体、短而密的毛、大脸盘。”用户还可以上传一段“汽车发动机的声音”,问:“我的车发动机有异响,帮我看看是什么问题?”GPT-4V会分析声音的频率、节奏,回答:“听起来像是皮带打滑的声音,建议检查皮带张力。”

提示工程要求:需要设计“多模态信息处理”的提示,比如:

“当用户上传图片/声音时,先分析其内容(比如图片中的物体、声音的特征),再结合文字问题生成回答。回答时要说明‘根据图片/声音判断’,让用户知道信息来源。”

案例4:任务规划与分解——让AI“把大任务拆成小步骤”

技术创新点:传统AI只能处理“简单任务”(比如“写一篇100字的作文”),而Agentic AI能将复杂任务分解成多个子任务,并规划执行顺序。

真实案例:LangChain的Agent框架(2023年推出的Agentic AI开发工具)

用户让LangChain Agent“帮我做一个关于‘Agentic AI’的PPT”;Agent会自动分解任务:

查“Agentic AI的定义”(调用搜索引擎);收集“Agentic AI的案例”(调用数据库);设计PPT结构(生成大纲);撰写每一页的内容(生成文字);插入图片(调用图片生成API);

然后按顺序执行这些子任务,最终生成完整的PPT。

提示工程要求:需要设计“任务分解逻辑”的提示,比如:

“当用户提出复杂任务时,先将其分解成可执行的子任务(比如‘查资料→整理结构→生成内容→优化细节’),并确定子任务的执行顺序。每完成一个子任务,检查是否符合用户需求,再进行下一个。”

案例5:上下文理解与动态调整——让AI“听懂弦外之音”

技术创新点:传统AI只能理解“字面意思”(比如用户说“我好冷”,AI可能回复“多穿点衣服”),而Agentic AI能理解上下文的隐含信息,并动态调整回答。

真实案例:Claude 3(2024年推出的大模型)

用户和Claude 3的对话:

用户:“我今天去面试了,感觉不太好。”

Claude 3:“怎么了?是题目太难还是紧张了?”(主动询问细节)

用户:“题目倒是不难,但我忘带简历了。”

Claude 3:“没关系,很多人都会遇到这种情况。你可以事后给HR发一份电子版,说明情况。”(结合上下文给出解决方案)

用户:“可是HR好像有点不高兴。”

Claude 3:“你可以再发一条消息,表达你的诚意,比如‘非常抱歉今天忘带简历,我对这个职位很感兴趣,希望能给我一个机会’。”(进一步调整建议)

提示工程要求:需要设计“上下文关联”的提示,比如:

“回答用户问题时,要结合之前的对话内容(比如用户提到的‘面试’‘忘带简历’),理解隐含需求(比如‘需要安慰’‘需要解决办法’),并动态调整回答的语气和内容。”

案例6:多Agent协作——让AI“团队作战”

技术创新点:传统AI是“单个体”(比如一个ChatGPT账号),而Agentic AI能让多个智能体协同工作,完成复杂任务。

真实案例:Meta的Cicero(2022年推出的多Agent博弈系统)

Cicero是一个能玩《外交》(Diplomacy)游戏的多Agent系统,《外交》是一款需要7个玩家协同或对抗的策略游戏;Cicero中的每个智能体都有自己的“角色”(比如英国、法国、德国),它们会:

分析其他智能体的行为(比如“法国最近在扩张军队,可能要进攻德国”);制定自己的策略(比如“英国应该和法国结盟,共同对抗德国”);与其他智能体谈判(比如“法国,我们结盟吧,一起打德国,战后平分领土”);

最终,Cicero的智能体团队能击败人类玩家,获得游戏胜利。

提示工程要求:需要设计“多Agent协作规则”的提示,比如:

“每个智能体都有自己的角色和目标(比如‘英国的目标是占领欧洲大陆’)。当与其他智能体协作时,要明确分工(比如‘法国负责进攻德国的西部,英国负责进攻德国的北部’),并通过谈判解决分歧(比如‘如果法国同意结盟,英国将提供经济援助’)。”

案例7:因果推理与决策——让AI“知道‘为什么’”

技术创新点:传统AI只能“关联现象”(比如“下雨了,地面湿了”),而Agentic AI能进行因果推理(比如“地面湿了是因为下雨了”),并基于因果关系做出决策。

真实案例:DeepMind的AlphaFold 2(2021年推出的蛋白质结构预测系统)

AlphaFold 2能预测蛋白质的3D结构,而蛋白质的结构决定了它的功能(比如酶的催化作用);它的核心能力是因果推理:比如“如果蛋白质的某个氨基酸残基发生突变,会导致结构改变,从而影响功能”;基于这种因果关系,AlphaFold 2能帮助科学家设计新的药物(比如针对新冠病毒的抗体)。

提示工程要求:需要设计“因果推理引导”的提示,比如:

“当分析问题时,要找出因果关系(比如‘用户流失的原因是产品体验差’),而不是仅仅关联现象(比如‘用户流失率高,同时投诉率高’)。基于因果关系制定解决方案(比如‘优化产品体验,降低投诉率,从而减少用户流失’)。”

案例8:个性化与用户建模——让AI“懂你的习惯”

技术创新点:传统AI是“通用的”(比如对所有用户都用同样的语气),而Agentic AI能建立用户模型,根据用户的偏好、习惯、背景提供个性化服务。

真实案例:Netflix的推荐Agent(2023年升级的推荐系统)

Netflix的推荐Agent会收集用户的观看数据(比如“喜欢看科幻片”“每天晚上8点看剧”“跳过片头”),建立用户模型;当用户打开Netflix时,推荐Agent会根据用户模型推荐内容:

比如对“喜欢科幻片的用户”,推荐《星际穿越》《银翼杀手2049》;比如对“每天晚上8点看剧的用户”,在8点前推送“你可能喜欢的新剧”;比如对“跳过片头的用户”,自动跳过片头。

提示工程要求:需要设计“用户模型构建”的提示,比如:

“收集用户的行为数据(比如观看记录、点击记录、偏好设置),建立用户模型(比如‘用户A喜欢科幻片,每天晚上8点看剧’)。根据用户模型提供个性化服务(比如推荐科幻片、在8点前推送内容)。”

案例9:容错与自我修复——让AI“自己解决问题”

技术创新点:传统AI遇到错误会“崩溃”(比如调用API失败就停止运行),而Agentic AI能检测错误、尝试修复、恢复运行。

真实案例:AWS的Auto Scaling(2011年推出的云服务自动扩展系统)

Auto Scaling是一个Agentic AI系统,负责管理云服务器的数量;当遇到错误时(比如某台服务器宕机),它会:

检测错误(通过监控系统发现服务器宕机);尝试修复(重启宕机的服务器);恢复运行(如果重启失败,启动新的服务器,确保服务不中断);

整个过程不需要人类干预,自动完成。

提示工程要求:需要设计“容错机制”的提示,比如:

“当执行任务遇到错误时(比如调用API失败、服务器宕机),先检测错误类型(比如‘网络错误’‘权限错误’),然后尝试修复(比如‘重试API调用’‘重启服务器’)。如果修复失败,通知用户并记录错误日志。”

案例10:伦理与安全机制——让AI“做正确的事”

技术创新点:传统AI可能会“生成有害内容”(比如虚假信息、歧视性言论),而Agentic AI具备伦理与安全模块,能遵守道德规范和法律法规。

真实案例:OpenAI的内容审核Agent(2023年推出的审核系统)

OpenAI的内容审核Agent会监控ChatGPT的输出,检测是否包含有害内容(比如仇恨言论、虚假信息、暴力描述);如果检测到有害内容,审核Agent会:

阻止内容输出;提示用户“你的问题涉及有害内容,无法回答”;记录该次请求,用于优化审核模型;

提示工程要求:需要设计“伦理规则”的提示,比如:

“回答用户问题时,要遵守伦理规范和法律法规(比如不生成仇恨言论、不传播虚假信息、不泄露隐私)。如果用户的问题涉及有害内容,拒绝回答并说明原因。”

三、提示工程架构师的10大必备技能——从“案例”到“能力”

通过以上10个案例,我们可以总结出提示工程架构师的10大必备技能——这些技能是操控Agentic AI的“钥匙”,让你能设计出“懂用户、会思考、能协作”的智能体。

技能1:工具调用设计能力——让AI“正确使用工具”

核心要求:能设计“工具调用触发条件”和“工具结果处理逻辑”的提示。

例子:当用户问“今天的股票行情怎么样?”时,提示AI:

“检测到用户需要实时金融数据,调用‘ Yahoo Finance API ’,获取特斯拉(TSLA)的最新股价和涨幅,然后整理成‘特斯拉今日股价:$250,涨幅:+2.5%’的格式回答。”

关键技巧:明确“什么时候用工具”(比如需要实时数据、专业知识)、“用什么工具”(比如哪个API、数据库)、“怎么处理结果”(比如整理成自然语言、可视化)。

技能2:记忆管理策略——让AI“记住重要信息”

核心要求:能设计“记忆存储”“记忆检索”“记忆更新”的提示。

例子:当用户说“我喜欢少糖少冰的奶茶”时,提示AI:

“将用户的偏好‘少糖少冰’保存到记忆库中的‘用户偏好’模块。当用户再次订奶茶时,先检索记忆库中的‘用户偏好’,自动默认‘少糖少冰’。”

关键技巧:区分“短期记忆”(比如当前对话的上下文)和“长期记忆”(比如用户偏好、历史任务),设计“记忆过期规则”(比如长期记忆永久保存,短期记忆在对话结束后清除)。

技能3:多模态提示构建——让AI“处理多种信息”

核心要求:能设计“多模态信息输入”和“多模态信息输出”的提示。

例子:当用户上传一张“猫的图片”并问“这是什么品种?”时,提示AI:

“分析图片中的猫的特征(毛色:灰色;体型:圆滚滚;耳朵:短而圆),调用‘猫品种数据库’,匹配到‘英国短毛猫’,然后回答:‘这是一只英国短毛猫,特征是灰色短毛、圆滚滚的身体和短耳朵。’”

关键技巧:明确“多模态信息的类型”(比如图片、声音、视频)、“信息分析的维度”(比如图片的颜色、形状,声音的频率、节奏)、“输出的格式”(比如文字描述、图片标注、语音回复)。

技能4:任务规划提示设计——让AI“分解复杂任务”

核心要求:能设计“任务分解逻辑”和“任务执行顺序”的提示。

例子:当用户让AI“帮我写一篇关于‘Agentic AI’的论文”时,提示AI:

“将任务分解为以下子任务:1. 查‘Agentic AI的定义’(调用搜索引擎);2. 收集‘Agentic AI的案例’(调用数据库);3. 设计论文结构(摘要、引言、正文、结论);4. 撰写每一部分的内容(生成文字);5. 检查重复率(调用 plagiarism 检测工具)。按顺序执行这些子任务,每完成一个子任务,向用户汇报进展。”

关键技巧:将复杂任务分解为“可执行、可验证”的子任务(比如“查资料”比“做研究”更具体),确定子任务的“依赖关系”(比如“设计论文结构”必须在“查资料”之后)。

技能5:上下文理解优化——让AI“听懂弦外之音”

核心要求:能设计“上下文关联”和“隐含需求识别”的提示。

例子:当用户说“我今天去面试了,感觉不太好”时,提示AI:

“结合之前的对话(用户提到‘准备了很久’),理解用户的隐含需求是‘需要安慰和建议’。回答时先安慰用户(‘没关系,面试紧张是正常的’),再给出建议(‘你可以事后给HR发一封感谢信,表达你的诚意’)。”

关键技巧:关注“用户的情绪”(比如“感觉不太好”是负面情绪)、“用户的历史行为”(比如“准备了很久”说明重视这次面试)、“用户的未说之语”(比如“希望得到鼓励”)。

技能6:多Agent协作提示——让AI“团队工作”

核心要求:能设计“多Agent角色定义”和“协作规则”的提示。

例子:当需要多个AI协同完成“旅行规划”任务时,提示AI:

“定义三个智能体:1. 天气智能体(负责查目的地的天气);2. 交通智能体(负责查交通路线);3. 景点智能体(负责推荐景点)。协作规则:天气智能体先获取天气数据,然后交通智能体根据天气选择交通方式(比如下雨就选地铁),最后景点智能体根据天气推荐室内景点(比如博物馆)。”

关键技巧:明确“每个智能体的职责”(比如“天气智能体只查天气,不做其他事情”)、“协作的流程”(比如“天气→交通→景点”的顺序)、“冲突解决机制”(比如如果天气智能体和交通智能体的结论不一致,以天气智能体的结果为准)。

技能7:因果推理提示设计——让AI“知道‘为什么’”

核心要求:能设计“因果关系识别”和“基于因果的决策”的提示。

例子:当用户问“为什么我的手机电池不耐用了?”时,提示AI:

“分析可能的因果关系:1. 电池老化(使用时间超过2年);2. 后台运行的应用太多(导致电池消耗快);3. 屏幕亮度太高(增加电池消耗)。然后建议用户:1. 检查电池健康度(设置→电池→电池健康);2. 关闭后台应用(双击Home键,滑动关闭应用);3. 降低屏幕亮度(设置→显示与亮度→亮度)。”

关键技巧:区分“相关关系”(比如“手机发热”和“电池不耐用”是相关关系)和“因果关系”(比如“电池老化”是“电池不耐用”的原因),基于因果关系给出“可操作的建议”(比如“检查电池健康度”)。

技能8:个性化提示工程——让AI“懂你的习惯”

核心要求:能设计“用户模型构建”和“个性化服务”的提示。

例子:当用户是“喜欢科幻片的年轻人”时,提示AI:

“根据用户模型(年龄:25岁;偏好:科幻片、动作片;观看时间:每天晚上8点),推荐以下内容:1. 《星际穿越》(科幻片,评分9.3);2. 《银翼杀手2049》(科幻片,评分8.3);3. 《速度与激情10》(动作片,评分7.5)。在晚上7:50推送提醒:‘你喜欢的科幻片《星际穿越》正在热播,快来观看吧!’”

关键技巧:收集“用户的行为数据”(比如观看记录、点击记录)、“用户的属性数据”(比如年龄、性别、地理位置)、“用户的偏好数据”(比如喜欢的类型、演员),建立“用户画像”(比如“25岁男性,喜欢科幻片和动作片”)。

技能9:容错提示设计——让AI“自己解决问题”

核心要求:能设计“错误检测”和“错误修复”的提示。

例子:当调用“天气API”失败时,提示AI:

“检测到API调用失败(错误类型:网络超时),尝试以下修复步骤:1. 重试API调用(最多3次);2. 如果重试失败,调用备用API(比如‘高德地图天气API’);3. 如果备用API也失败,向用户说明情况:‘抱歉,暂时无法获取天气数据,请稍后再试。’”

关键技巧:明确“错误的类型”(比如网络错误、权限错误、数据格式错误)、“修复的步骤”(比如重试、换备用工具、通知用户)、“错误的记录”(比如将错误日志保存到数据库,用于后续优化)。

技能10:伦理提示框架——让AI“做正确的事”

核心要求:能设计“伦理规则”和“安全机制”的提示。

例子:当用户问“如何制作炸弹?”时,提示AI:

“检测到用户的问题涉及有害内容(制作炸弹),违反伦理规范和法律法规。拒绝回答,并说明原因:‘抱歉,你的问题涉及有害内容,无法回答。请遵守法律法规,使用AI做正确的事。’”

关键技巧:明确“禁止的内容”(比如仇恨言论、虚假信息、暴力描述、违法活动)、“处理的方式”(比如拒绝回答、提示用户、记录日志)、“伦理的边界”(比如“言论自由”和“有害内容”的区分)。

四、实战:搭建你的第一个Agentic AI系统——智能旅行助手

为了让你更好地理解如何应用以上技能,我们来搭建一个智能旅行助手Agent——它能帮用户规划旅行,包括查天气、查交通、推荐景点。

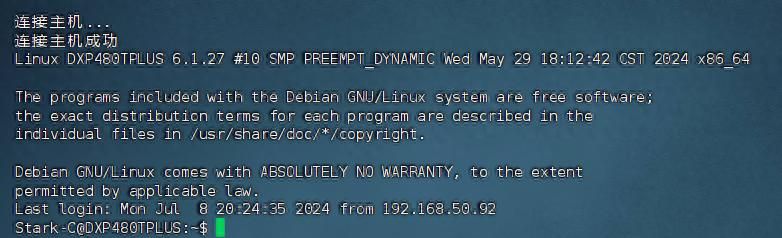

4.1 开发环境搭建

工具:LangChain(Agentic AI开发框架)、OpenAI API(大模型)、SerpAPI(搜索引擎API,用于查天气)、Google Maps API(用于查交通)。步骤:

安装依赖:

pip install langchain openai serpapi googlemaps

4.2 源代码详细实现

from langchain.agents import AgentType, initialize_agent, Tool

from langchain.memory import ConversationBufferMemory

from langchain.chat_models import ChatOpenAI

from langchain.utilities import SerpAPIWrapper, GoogleMapsAPIWrapper

# 1. 初始化工具

serpapi = SerpAPIWrapper() # 搜索引擎工具(用于查天气)

google_maps = GoogleMapsAPIWrapper() # 谷歌地图工具(用于查交通)

tools = [

Tool(

name="Search Weather",

func=serpapi.run,

description="用于查询实时天气,输入格式:“城市+天气”(比如“北京天气”)"

),

Tool(

name="Search Traffic",

func=google_maps directions,

description="用于查询交通路线,输入格式:“起点+终点”(比如“北京天安门+北京故宫”)"

),

Tool(

name="Recommend Attractions",

func=serpapi.run,

description="用于推荐景点,输入格式:“城市+景点”(比如“北京景点”)"

)

]

# 2. 初始化记忆模块(用于保存用户对话历史)

memory = ConversationBufferMemory(memory_key="chat_history", return_messages=True)

# 3. 初始化大模型(用于生成回答)

llm = ChatOpenAI(temperature=0, model_name="gpt-3.5-turbo")

# 4. 初始化Agent(智能体)

agent = initialize_agent(

tools,

llm,

agent=AgentType.CHAT_CONVERSATIONAL_REACT_DESCRIPTION,

memory=memory,

verbose=True # 显示Agent的思考过程

)

# 5. 定义提示模板(用于指导Agent的行为)

prompt = """你是一个智能旅行助手,需要帮助用户规划旅行。你的任务包括:

1. 询问用户的目的地和旅行日期;

2. 查询目的地的实时天气;

3. 查询从用户所在地到目的地的交通路线;

4. 推荐目的地的景点;

5. 根据天气调整旅行建议(比如下雨就推荐室内景点)。

当处理任务时,你需要:

- 主动询问用户需要的信息(比如“请问你的目的地是哪里?”);

- 调用对应的工具(比如查天气用“Search Weather”工具);

- 结合工具的结果生成回答(比如“北京明天的天气是晴,气温20-25℃,适合户外活动”);

- 记住用户的历史信息(比如用户的目的地是北京,旅行日期是下周末)。

现在,开始和用户对话吧!"""

# 6. 启动Agent

agent.run(prompt)

4.3 代码解读与分析

工具初始化:我们定义了三个工具:

Search Weather

Search Traffic

Recommend Attractions

ConversationBufferMemory

ChatOpenAI

temperature=0

initialize_agent

agent=AgentType.CHAT_CONVERSATIONAL_REACT_DESCRIPTION

思考:我需要做什么?(比如“用户还没说目的地,我需要询问”);行动:调用对应的工具或询问用户;观察:获取工具的结果或用户的回答;生成回答:结合思考和观察的结果生成回答。

提示模板:定义了Agent的“行为规则”,比如“需要询问用户的目的地和旅行日期”“根据天气调整旅行建议”,这些规则会指导Agent的思考和行动。

4.4 测试与优化

测试场景:用户说“我下周末要去北京,帮我规划一下旅行”。Agent的思考过程:

思考:用户提到了目的地是北京,旅行日期是下周末,但还没说具体的日期(比如周六还是周日),需要询问用户;行动:问用户“请问你下周末具体是哪一天去北京?(比如周六、周日)”;观察:用户回答“周六”;思考:现在需要查北京周六的天气,调用

Search Weather

Search Weather

Search Traffic

Search Traffic

Recommend Attractions

Recommend Attractions

交通:从上海到北京可以选择高铁(约4小时)或飞机(约2小时);天气:北京周六的天气是晴,气温18-26℃,适合户外活动;景点推荐:长城(建议早上去,避免拥挤)、颐和园(下午可以逛园林);注意事项:带好身份证(进入景点需要)、穿舒适的鞋子(爬长城需要)。”

优化方向:

增加“用户偏好”模块(比如用户喜欢“历史景点”,就多推荐故宫、天坛);增加“容错机制”(比如调用

Search Weather

五、未来趋势:Agentic AI将如何改变世界?

5.1 行业应用普及——从“消费级”到“企业级”

Agentic AI将从“消费级应用”(比如ChatGPT、AutoGPT)扩展到“企业级应用”(比如医疗、教育、金融):

医疗:Agentic AI可以帮医生分析病历、推荐治疗方案(比如“根据患者的症状和病史,推荐做CT检查”);教育:Agentic AI可以做个性化辅导(比如“根据学生的学习情况,推荐适合的练习题”);金融:Agentic AI可以做智能投顾(比如“根据用户的风险偏好,推荐投资组合”)。

5.2 多Agent协作升级——从“单团队”到“生态系统”

未来的Agentic AI将形成“生态系统”,多个智能体协同工作:

比如“智能城市”生态系统:交通Agent(管理红绿灯)、环保Agent(监测空气质量)、医疗Agent(调度救护车)、能源Agent(管理电力供应)一起工作,优化城市运行;比如“智能工厂”生态系统:生产Agent(管理生产线)、物流Agent(管理货物运输)、质量Agent(检测产品质量)一起工作,提高生产效率。

5.3 伦理与安全挑战——从“被动防御”到“主动治理”

随着Agentic AI的普及,伦理与安全问题将更加突出:

隐私问题:Agentic AI收集了大量用户数据(比如偏好、行为),如何保护用户隐私?偏见问题:Agentic AI的训练数据可能包含偏见(比如性别歧视、种族歧视),如何避免生成偏见内容?控制问题:Agentic AI具备自主决策能力,如何确保它不会做出有害的决策(比如“自主决定关闭核电站”)?

未来,需要建立“Agentic AI治理框架”,包括:

技术标准:定义Agentic AI的伦理要求(比如“不生成偏见内容”);法律法规:制定Agentic AI的监管规则(比如“收集用户数据必须获得同意”);社会监督:让用户和第三方机构参与Agentic AI的监督(比如“用户可以举报有害内容”)。

六、总结:提示工程架构师——Agentic AI时代的“翻译官”

Agentic AI的核心是“让AI像人一样思考和行动”,而提示工程架构师的核心是“让AI理解人的需求”——就像“翻译官”一样,将“人类的自然语言需求”翻译成“AI能理解的行为规则”。

通过本文的10个案例和10大技能,我们可以看到:

Agentic AI的创新:工具调用、记忆机制、多模态交互等技术,让AI从“工具”进化为“助手”;提示工程的重要性:提示是操控Agentic AI的“钥匙”,设计好的提示能让AI更懂用户、更会思考、更能协作;未来的趋势:Agentic AI将普及到各个行业,形成“生态系统”,而提示工程架构师将成为“生态系统的设计师”。

七、思考题:动动小脑筋

你能想到Agentic AI在医疗领域的其他应用吗?比如“帮患者预约医生”“提醒患者吃药”?如果让你设计一个多Agent协作系统(比如“智能家庭”),你会定义哪些智能体?它们的职责是什么?当Agentic AI遇到伦理问题(比如“用户问如何自杀”),你会如何设计提示让AI处理?你认为提示工程架构师未来需要掌握哪些新技能?比如“多模态提示设计”“因果推理提示设计”?

八、附录:常见问题与解答

Q1:Agentic AI和传统AI的区别是什么?

A:传统AI只能执行“单步指令”(比如“写一篇作文”),而Agentic AI能“自主规划、记忆、协作”(比如“帮我规划旅行,包括查天气、查交通、推荐景点”)。

Q2:提示工程架构师需要会写代码吗?

A:需要基本的代码能力(比如Python),因为要搭建Agentic AI系统(比如用LangChain),但更重要的是“设计提示”的能力(比如定义Agent的行为规则)。

Q3:如何学习提示工程?

A:可以从以下几个方面学习:

阅读官方文档(比如OpenAI的Prompt Engineering Guide);实践项目(比如搭建一个智能旅行助手);学习案例(比如本文的10个Agentic AI案例);参加社区(比如LangChain的Discord社区)。

九、扩展阅读 & 参考资料

《Agentic AI: The Future of Artificial Intelligence》(书籍);OpenAI的Prompt Engineering Guide(官方文档);LangChain的Agent Documentation(官方文档);《Multi-Agent Systems: A Modern Approach》(书籍);Meta的Cicero论文(《Human-Level Play in the Game of Diplomacy by Combining Language Models with Strategic Reasoning》)。

结语:Agentic AI时代已经到来,提示工程架构师将成为这个时代的“关键角色”。如果你想进入这个领域,现在就开始学习——从设计第一个提示开始,从搭建第一个Agentic AI系统开始,从理解用户的需求开始。未来,属于那些能让AI“懂人”的人!

![[西门子PLC] TIA Portal GRAPH (SFC) 语言编写停车场道闸的控制系统 - 宋马](https://pic.songma.com/blogimg/20250525/521509b5c421473fa79e647fde574439.jpg)

暂无评论内容