引言/导读

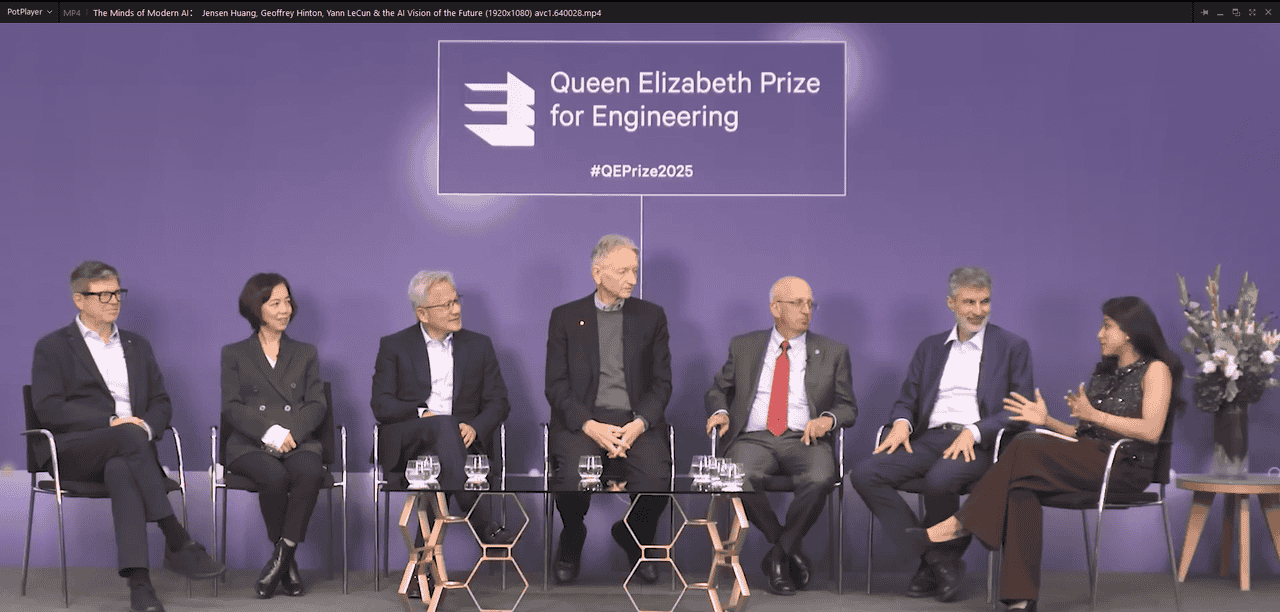

在伦敦举行的FT Live人工智能未来峰会上,六位塑造了现代AI格局的奠基者——包括深度学习的先驱Geoffrey Hinton、Yoshua Bengio、Yann LeCun,以及NVIDIA的首席执行官Jensen Huang、斯坦福大学教授Fei-Fei Li和NVIDIA前首席科学家Bill Dally——齐聚一堂,共同探讨了AI技术从神经网络萌芽到生成式AI浪潮的演进历程,并对当前行业的伦理、经济和未来走向进行了深入反思。这六位杰出人物均荣获了2025年伊丽莎白女王工程奖,以表彰他们对机器学习和AI做出的基础性贡献。

本次对话不仅回顾了他们个人职业生涯中的关键“顿悟时刻”,更直面了行业最尖锐的问题:当前的AI繁荣是否是即将破裂的泡沫?人类距离通用人工智能(AGI)究竟有多远?对于希望理解当前AI爆炸式增长背后真实驱动力、并寻求未来十年技术方向的开发者、产品经理和投资者而言,这场对谈提供了极为稀有且具有前瞻性的洞察。

历史的“Aha”时刻:AI突破的奠基石

多位嘉宾的经历显示,现代AI的崛起并非一蹴而就,而是计算、数据和算法三股力量在不同时间点汇聚的结果。

算力的飞跃:从“内存墙”到深度学习的引擎

AI发展历程中的一个核心瓶颈是计算效率。Bill Dally指出,他职业生涯中的第一个重要时刻发生在九十年代末,当时他试图解决被称为“内存墙”(memory wall)的问题——即从内存中访问数据的成本(能耗和时间)远高于进行算术运算。

流式处理与GPU的诞生:Dally的解决方案是将计算组织成由数据流连接的“内核”(kernels),从而在不频繁访问内存的情况下完成大量计算,这最终促成了流式处理(stream processing)和后来的GPU计算模式。抓住深度学习的契机:2010年至2011年,Dally受到Andrew Ng使用16,000个CPU进行神经网络实验的启发,与同事使用48个NVIDIA GPU重复了实验,结果使他坚信GPU应该专门用于深度学习。黄仁勋(Jensen Huang)的视角:黄仁勋将开发深度学习软件的过程比作设计芯片,他发现这种框架和结构化的设计(如深度学习网络)能够很好地实现规模化,正如芯片设计多年来所经历的那样。一旦算法能够在单个GPU上高效并行运行,这种可扩展性就可以轻松复制到多个GPU、多个系统乃至多个数据中心。

数据的力量:ImageNet与泛化能力的解锁

早期机器学习面临的关键挑战是模型的“泛化能力”——即模型能否在学习了特定数量的例子后,识别出新的样本。

数据饥渴的机器:Fei-Fei Li认识到,机器在训练的早期阶段缺乏数据喂养,而人类和动物的智能发展却是在海量数据中浸润的结果。ImageNet的诞生:Li在2006年至2007年意识到,解决泛化问题需要数据,因此她及其团队进行了在当时看来“疯狂”的尝试,历时三年创建了ImageNet——一个包含1500万张图片、涵盖22,000个类别的互联网规模数据集。“大数据驱动机器学习”:对于Li而言,她的“顿悟时刻”在于认识到大数据是驱动机器学习的关键,并且它成为了当今AI定标法则(scaling law)的基础组成部分。

算法的复兴:从反向传播到自监督学习

算法层面,现代AI的基础在几十年前就已奠定,但直到近年来才获得必要的算力和数据支持。

反向传播与语言模型的雏形:Geoffrey Hinton在1984年尝试使用反向传播来预测序列中的下一个词。尽管这是一个只有100个训练样本的“微小语言模型”,但它证明了系统可以通过尝试预测下一个词来学习如何将词汇转化为捕捉其意义的特征集合,这被视为当前大型语言模型的先驱。40年的等待:Hinton强调,从那时到今天花了40年,原因在于当时缺乏足够的计算资源和数据。从监督学习到自监督学习:Yann LeCun和Hinton在八十年代末曾对学习范式有过争论,LeCun当时更倾向于制定明确任务的监督学习,而Hinton则坚持非监督学习是进步的关键。然而,ImageNet等带标签数据集的出现,使得监督学习在一段时间内表现出色,成为研究社区的焦点。直到约2016-2017年,社区才重新意识到需要回归到自监督学习(Self-Supervised Learning),而这正是当前大型语言模型(LLMs)训练的核心方式——通过预测下一个词来让系统学习良好的数据表征。

AI繁荣的底层逻辑:是泡沫还是基础设施的重构?

面对当前围绕AI公司的高估值和前所未有的关注度,嘉宾们对“AI泡沫”问题提出了强烈的、基于事实的驳斥,认为这是一种根本性的经济和基础设施重构。

对抗“暗光纤”:芯片之王的判断

Jensen Huang直接将当前AI热潮与过去的互联网泡沫进行了对比,并提出了关键区分点:

高利用率的GPU:在互联网泡沫时期,部署的大部分光纤(fiber)是“暗的”(dark),意味着行业部署的资源远超实际需求。然而,今天几乎所有可用的GPU都被“点亮并使用”(lit up and used)。“智能工厂”的时代:黄仁勋提醒,AI需要工厂来生产智能(即生成tokens)。这种需求源于智能必须是上下文感知的,必须实时生成和产生,而不是预编译和检索的。AI行业首次创造了对需要数百亿美元计工厂进行支撑的计算需求,以服务于数万亿美元规模的行业。需求的双重指数增长:这种巨大的需求来自两个同时发生的指数级增长:一是产生一个答案所需的计算量正在巨大增长;二是AI模型的使用量也在指数级增长。

因此,黄仁勋的结论是:我们正处于智能建设的初期阶段,这不是一个泡沫。

效率提升与应用扩展的双重驱动

Bill Dally也支持这种非泡沫论断,并提出了支撑AI持续繁荣的三个趋势:

模型效率正在提高:例如,通过从标准注意力(straight attention)进化到GQA或MLA,可以在更少的计算下获得相同或更好的结果,从而降低了AI的使用成本和门槛。模型质量持续提升:即使未来出现新的架构,模型的质量也不会倒退。应用场景尚未饱和:Dally认为,目前AI可能只触及了最终需求的1%,几乎人类生活的各个方面都可以通过AI辅助来得到改善。

警惕范式陷阱:AGI的过度乐观

Yann LeCun则提供了一个更具辩证性的观点,他同意从应用和基础设施的角度看,当前投资是合理的,因为LLMs的应用潜力巨大,且智能穿戴设备的普及将要求巨大的后端计算服务。

然而,他提出了一个警告,即泡沫存在于过度乐观的预期中:

当前范式的局限性:如果人们认为当前的LLM范式仅通过投入更多基础设施和数据就能达到人类水平的智能(Human-Level Intelligence, HLI),那么这可能构成一个泡沫。需要新的科学突破:LeCun强调,在机器真正具备人类或动物(如猫)的智能之前,我们仍然缺少一些重大的科学突破。

下一代AI的科学前沿与能力边界

对话明确指出,尽管LLMs取得了巨大成功,但它们并非终点,下一代AI的突破需要跳出纯语言模型的框架。

从LLM到Agent的演进

Yoshua Bengio指出,不应再将当前模型称为“语言模型”。它们正在演变为Agent(智能体),通过一系列交互步骤来达成目标,不仅通过对话,还将与计算基础设施进行交互。尽管技术变化速度极快,未来几年难以预测,但Agent的趋势非常清晰。

空间智能与具身AI的缺失

Fei-Fei Li强调,人类智能远超语言能力。她多年来专注于空间智能,这涉及到感知、推理和与物理世界的互动。她指出:

LLMs的局限性:即使是当今最强大的基于语言的模型,在基本的空间智能测试上也会失败。机器人智能的滞后:LeCun也同意,在空间和机器人领域,AI仍然滞后,例如“我们目前还没有一个机器人能像猫一样聪明”。科学前沿:作为一个学科,AI仍有更多的科学前沿需要征服和开放,这必将带来更多的应用。

AGI的时间表:分歧与共识

关于AI何时达到人类水平智能(HLI)或通用人工智能(AGI),六位专家的预测大相径庭,但普遍同意这将是一个渐进过程,而非单一事件。

| 专家 | 观点/预测 | 核心论点 |

|---|---|---|

| 黄仁勋 | 现在及未来几年 | 某些方面(如翻译100种语言)已经超越人类。AGI在当下已是“学术问题”,重要的是应用技术解决重要问题。 |

| Bill Dally | 不重要/不相关 | 目标是增强人类,而不是取代或超越人类。AI应弥补人类不擅长的领域,让人类专注于创造力和同理心。 |

| Fei-Fei Li | 部分已超越/未来长期 | 机器智能和人类智能的用途不同,就像飞机不会像鸟一样飞。部分能力(如识别22,000个物体)已超越。 |

| Geoffrey Hinton | 20年内 | 如果将AGI定义为“在辩论中总能获胜的机器”,那么20年内肯定会实现。 |

| Yann LeCun | 高度不确定/或5年内 | 规划能力呈指数级增长,如果趋势持续,AI在五年内有望达到员工在工作中展现的技能水平(针对工程任务)。但存在很多不确定性,尤其是AI进行AI研究的能力突破。 |

| Yoshua Bengio | 5到10年内有重大进展,但需更久 | 能力将逐步扩展。新的范式可能会在未来5到10年内出现,但整体进程将比我们想象的要慢。 |

深度分析与洞察(分析师视角)

作为一名资深科技内容编辑兼AI领域分析师,从这场历史性的对话中可以提炼出几点关键洞察:

1. 计算力的本质转型:从工具到基础生产力

黄仁勋将AI比作需要数千亿美元投资的“工厂”,这是对AI经济学最深刻的描述之一。过去的软件只是工具,依赖于预编译逻辑,计算需求低。现在的AI则是一种实时生产的智能,它直接参与劳动和工作,成为与劳动力并行的基本生产要素。这种转型意味着AI投资不仅仅是资本支出(CapEx),更是对国家级智能基础设施的建设。这种投资的合理性在于其服务的是数万亿美元规模的传统产业,因此目前的市场估值反映了对这种新型基础设施的预期回报。当前的AI繁荣,本质上是“智能工厂”的全球军备竞赛。

2. 范式的不稳定性和科学研究的回流

尽管NVIDIA和应用层面的乐观情绪高涨,但Bengio、LeCun和Li的担忧揭示了当前的LLM范式存在巨大的科学盲区,尤其是在处理物理世界、空间推理和通用学习方面。LeCun的“泡沫”论并非针对硬件需求,而是针对商业界对**“多数据 + 多算力 = AGI”这一公式的盲目信仰。这场对话提醒我们,下一代AI的突破将不再是简单地堆叠Transformer层和扩展数据集,而必须回归到无监督学习、具身智能和更深层次的科学原理**的探索,以解决LLM无法像猫一样在物理世界中智能运作的根本问题。

3. AGI的辩证解读:从替代到增强的哲学转向

关于AGI的讨论中,出现了明显的哲学分歧。以Huang和Dally为代表的“应用派”倾向于认为AGI的定义和时间表已经不重要,因为AI的能力已经足以应用于现实问题并增强人类。而以Hinton为代表的“科学派”则更关注机器在认知竞争(如辩论)中何时能彻底超越人类。

核心洞察在于: AI的实际应用已经完成了从替代威胁到增强伙伴的角色定位转换。未来的工作流程将不再是“人类 vs. AI”,而是“人类 + AI”在效率和创造力上的协作。这为企业和个人指明了方向:关注如何利用AI在特定领域(如识别、翻译、编码)的超人能力,而不是徒劳地等待一个与人类完全同质的“通用智能”的降临。

总结与展望

这场由六位AI巨头带来的对话,为我们提供了一幅关于AI发展现状和未来趋势的清晰路线图。当前的AI革命由历史性的算法突破、海量数据和不断迭代的计算基础设施共同驱动。我们并非身处“泡沫”之中,而是在建设一个全新的、以实时智能为核心的全球生产力基础设施。

然而,这股浪潮的下一阶段将取决于我们能否解决当前LLM在空间感知和世界模型上的科学难题。未来的竞赛将是关于Agent、具身智能,以及能否找到新的学习范式。

如果说过去十年是关于模型的规模化,那么未来十年将是关于智能的具身化和深层科学原理的重新发现。

我们是否能够成功引导这场“智能工厂”的建设,使其不仅带来效率的提升,更能秉持Fei-Fei Li所倡导的“以人为中心的AI”框架,将人类价值置于技术创新的核心?这个问题,将是所有开发者和决策者需要持续思考的。

要点摘要

非泡沫论的核心:当前几乎所有GPU都在使用中(”lit up”),与互联网时代的“暗光纤”形成鲜明对比。AI即工厂:AI的有效性依赖于实时、上下文感知的智能生成,需要数千亿美元的计算“工厂”来支持。范式局限:目前的LLM范式在空间智能和具身智能方面存在严重不足,机器人智能仍落后于一只猫。AGI的时间:AGI不是一个事件,而是一个渐进过程。部分能力已超越人类,但对于认知竞争中的胜利,预测在5年到20年之间,存在巨大不确定性。下一代趋势:模型正在从单纯的语言模型进化为能够与环境和计算基础设施交互的智能体(Agent)。科学回归:要达到下一代AI,必须进行科学突破,回归到自监督学习和非语言智能的探索,而非仅靠增加算力。

原始视频:https://youtu.be/0zXSrsKlm5A?si=0F2X-o-SDuK_9tgS

中英文字幕:【AI教父与芯片之王:揭秘下一代AI的底层逻辑与“智能工厂”的真相】

暂无评论内容