5大AI原生应用领域知识更新,开发者必看的技术指南

关键词:AI原生应用、开发者、技术指南、知识更新、应用领域

摘要:本文聚焦于5大AI原生应用领域的知识更新,旨在为开发者提供一份全面且实用的技术指南。通过深入介绍各个领域的核心概念、算法原理、实际应用场景等内容,帮助开发者了解最新技术动态,掌握关键技术要点,以便在实际开发中更好地运用AI技术,创造出更具创新性和实用性的应用。

背景介绍

目的和范围

在当今科技飞速发展的时代,AI技术已经渗透到各个领域,而AI原生应用更是成为了推动行业变革的重要力量。本指南的目的就是帮助开发者及时了解5大AI原生应用领域的最新知识和技术,提升他们在这些领域的开发能力和创新能力。本指南涵盖了这5大领域的核心概念、算法原理、实际应用等多个方面的内容。

预期读者

本指南主要面向广大的开发者,包括但不限于软件开发者、数据科学家、人工智能工程师等。无论是初学者还是有一定经验的开发者,都能从本指南中获取有价值的信息。

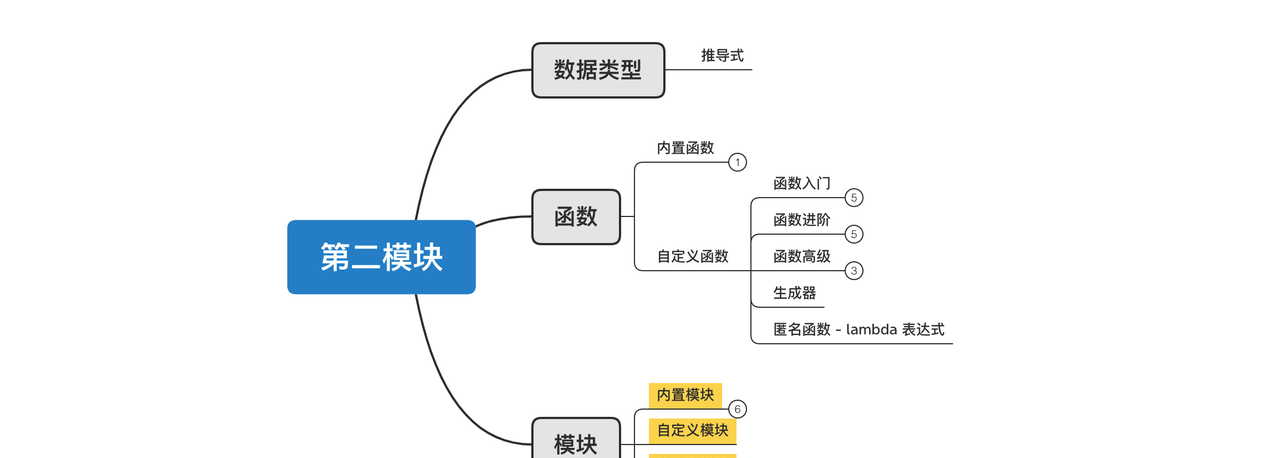

文档结构概述

本指南首先会对5大AI原生应用领域进行逐一介绍,包括核心概念、算法原理、数学模型等内容。然后会给出每个领域的项目实战案例,详细解释代码实现和应用场景。接着会探讨各个领域的实际应用场景、工具和资源推荐以及未来发展趋势与挑战。最后进行总结,并提出一些思考题供开发者进一步思考。

术语表

核心术语定义

AI原生应用:指那些从设计之初就深度融入人工智能技术,以人工智能为核心驱动力的应用程序。

机器学习:是一门多领域交叉学科,涉及概率论、统计学、逼近论、凸分析、算法复杂度理论等多门学科。它专门研究计算机怎样模拟或实现人类的学习行为,以获取新的知识或技能,重新组织已有的知识结构使之不断改善自身的性能。

深度学习:是机器学习的一个分支领域,它是一种基于对数据进行表征学习的方法。深度学习通过构建具有很多层的神经网络模型,自动从大量数据中学习特征和模式。

相关概念解释

自然语言处理:让计算机能够理解、处理和生成人类语言的技术。就像一个翻译官,能把我们说的话转化成计算机能懂的语言,也能把计算机的处理结果用我们能理解的语言表达出来。

计算机视觉:使计算机能够像人类一样“看”世界,识别图像和视频中的物体、场景等信息。可以想象成计算机长了一双眼睛,能识别看到的东西。

缩略词列表

NLP:Natural Language Processing(自然语言处理)

CV:Computer Vision(计算机视觉)

ML:Machine Learning(机器学习)

DL:Deep Learning(深度学习)

核心概念与联系

故事引入

想象一下,你生活在一个充满智能的未来世界。早上起床,智能音箱用温柔的声音告诉你今天的天气和日程安排。当你出门开车时,汽车的自动驾驶系统能安全地把你送到目的地。到了办公室,智能客服机器人能快速准确地回答客户的问题。这些神奇的体验都离不开AI原生应用。接下来,我们就一起走进5大AI原生应用领域,揭开它们的神秘面纱。

核心概念解释(像给小学生讲故事一样)

核心概念一:自然语言处理(NLP)

自然语言处理就像是一个超级语言小能手。我们平时说话、写文章用的都是自然语言,但是计算机一开始可听不懂我们在说什么。自然语言处理就是要教会计算机理解我们的语言。比如说,你跟智能语音助手说“我想听周杰伦的歌”,它能明白你的意思,然后给你播放周杰伦的歌曲。这就像是它把你说的话翻译成了它能懂的指令,然后去完成相应的任务。

核心概念二:计算机视觉(CV)

计算机视觉可以让计算机拥有像人一样的“视力”。就好比我们用眼睛看到一张猫的图片,能马上认出这是一只猫。计算机视觉就是要让计算机也能做到这一点。它可以识别图片里的各种物体,还能分析视频里的动作和场景。比如在监控摄像头里,它能识别出有没有可疑人员进入。

核心概念三:机器学习(ML)

机器学习就像是一个聪明的学生。它能从大量的数据中学习规律和模式。就像我们学习数学,做了很多练习题后,就能掌握解题的方法。机器学习也是一样,给它很多数据,它就能学习到这些数据的特征和规律,然后用这些规律去预测新的数据。比如说,根据过去的销售数据,预测未来的销售额。

核心概念四:深度学习(DL)

深度学习是机器学习的一种更高级的形式。它就像是一个超级学霸,有很多层的学习结构。可以把它想象成一个多层的大楼,每一层都能学习到不同的知识。深度学习可以处理非常复杂的数据,比如图像、语音等。像人脸识别技术,就是深度学习在计算机视觉领域的一个应用,它能准确地识别出不同人的脸。

核心概念五:智能推荐系统

智能推荐系统就像是一个贴心的小秘书。它能根据你的喜好和行为,给你推荐你可能感兴趣的东西。比如你在购物网站上买了一本书,它就会根据这本书的类型和你的购买历史,给你推荐其他相关的书籍。它会分析你的数据,了解你的需求,然后把合适的东西推荐给你。

核心概念之间的关系(用小学生能理解的比喻)

概念一和概念二的关系:自然语言处理和计算机视觉的关系

自然语言处理和计算机视觉就像是一对好朋友,它们可以互相帮助。比如说,在一个智能旅游应用中,计算机视觉可以识别景点的图片,然后自然语言处理可以把这些景点的信息用文字描述出来,还能回答你关于景点的问题。就像一个负责看,一个负责说,一起为你提供更好的服务。

概念二和概念三的关系:计算机视觉和机器学习的关系

计算机视觉要想有很好的“视力”,离不开机器学习的帮助。机器学习就像是计算机视觉的老师,它可以教计算机视觉如何识别物体。通过大量的图片数据,机器学习可以让计算机视觉学习到不同物体的特征和模式。就像老师教学生认识不同的动物,给学生看很多动物的图片,让学生学会区分它们。

概念三与概念四的关系:机器学习和深度学习的关系

深度学习是机器学习的升级版。可以把机器学习看成是普通汽车,而深度学习是超级跑车。它们的目标都是学习数据中的规律,但是深度学习有更强大的学习能力和处理复杂数据的能力。就像超级跑车能跑得更快、更远一样,深度学习能在更复杂的任务中取得更好的效果。

概念四和概念五的关系:深度学习和智能推荐系统的关系

深度学习可以让智能推荐系统变得更聪明。智能推荐系统需要分析大量的用户数据,找到用户的喜好和行为模式。深度学习可以处理这些复杂的数据,提取出更有价值的信息。就像一个聪明的侦探,能从很多线索中找到关键的信息,然后让智能推荐系统更准确地给你推荐东西。

概念一和概念五的关系:自然语言处理和智能推荐系统的关系

自然语言处理可以帮助智能推荐系统更好地理解用户的需求。当你用自然语言表达你想要的东西时,自然语言处理可以把你的话转化成系统能理解的信息。然后智能推荐系统就能根据这些信息,给你推荐合适的东西。就像一个翻译官,把你的话翻译给智能推荐系统听,让它能更好地为你服务。

核心概念原理和架构的文本示意图(专业定义)

自然语言处理:主要包括文本预处理、特征提取、模型训练和预测等步骤。文本预处理是对原始文本进行清洗、分词等操作;特征提取是将文本转化为计算机能处理的特征向量;模型训练是使用机器学习或深度学习模型对特征向量进行训练;预测是使用训练好的模型对新的文本进行分类、情感分析等操作。

计算机视觉:包括图像采集、预处理、特征提取、目标检测和识别等环节。图像采集是获取图像数据;预处理是对图像进行去噪、增强等操作;特征提取是提取图像的特征;目标检测和识别是确定图像中物体的位置和类别。

机器学习:分为监督学习、无监督学习和强化学习。监督学习是有标签的数据进行学习,通过训练模型来预测新的数据;无监督学习是对无标签的数据进行学习,发现数据中的结构和模式;强化学习是通过智能体与环境的交互,不断优化策略以获得最大的奖励。

深度学习:基于深度神经网络,如卷积神经网络(CNN)用于图像识别,循环神经网络(RNN)及其变体(如LSTM、GRU)用于处理序列数据。通过多层神经网络的堆叠,自动学习数据的特征和模式。

智能推荐系统:主要有基于内容的推荐、协同过滤推荐和混合推荐等方法。基于内容的推荐是根据物品的特征和用户的历史行为进行推荐;协同过滤推荐是根据用户之间的相似性或物品之间的相似性进行推荐;混合推荐是结合多种推荐方法,提高推荐的准确性和多样性。

Mermaid 流程图

核心算法原理 & 具体操作步骤

自然语言处理核心算法:词袋模型

原理

词袋模型就像是一个装满单词的袋子,它只关心每个单词出现的频率,而不考虑单词的顺序。例如,对于句子“我喜欢苹果”和“苹果我喜欢”,词袋模型会认为它们是相似的,因为它们包含的单词是一样的。

Python代码实现

from sklearn.feature_extraction.text import CountVectorizer

# 定义文本数据

texts = ["我喜欢苹果", "我喜欢香蕉", "他喜欢苹果"]

# 创建词袋模型对象

vectorizer = CountVectorizer()

# 训练并转换文本数据

X = vectorizer.fit_transform(texts)

# 获取特征名称

feature_names = vectorizer.get_feature_names_out()

# 输出结果

print("特征名称:", feature_names)

print("词袋矩阵:", X.toarray())

计算机视觉核心算法:卷积神经网络(CNN)

原理

卷积神经网络就像是一个多层的过滤器。它通过卷积层对图像进行特征提取,池化层对特征进行降维,最后通过全连接层进行分类。就像用不同的放大镜去观察图像,提取出不同的特征。

Python代码实现(使用Keras)

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Conv2D, MaxPooling2D, Flatten, Dense

# 创建CNN模型

model = Sequential()

# 添加卷积层

model.add(Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)))

# 添加池化层

model.add(MaxPooling2D((2, 2)))

# 添加卷积层

model.add(Conv2D(64, (3, 3), activation='relu'))

# 添加池化层

model.add(MaxPooling2D((2, 2)))

# 展平

model.add(Flatten())

# 添加全连接层

model.add(Dense(64, activation='relu'))

# 添加输出层

model.add(Dense(10, activation='softmax'))

# 编译模型

model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 打印模型结构

model.summary()

机器学习核心算法:决策树

原理

决策树就像是一棵大树,每个节点都是一个决策点。根据数据的特征,从根节点开始,一步步向下走,直到到达叶子节点,得到最终的决策结果。例如,在判断一个水果是苹果还是香蕉时,会根据颜色、形状等特征进行判断。

Python代码实现

from sklearn.datasets import load_iris

from sklearn.tree import DecisionTreeClassifier

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 加载数据集

iris = load_iris()

X = iris.data

y = iris.target

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建决策树模型

model = DecisionTreeClassifier()

# 训练模型

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 计算准确率

accuracy = accuracy_score(y_test, y_pred)

print("准确率:", accuracy)

深度学习核心算法:长短期记忆网络(LSTM)

原理

长短期记忆网络是一种特殊的循环神经网络,它可以解决传统循环神经网络的梯度消失问题。它就像一个有记忆的小盒子,能够记住过去的信息,并且根据当前的输入和过去的记忆进行决策。常用于处理序列数据,如文本、时间序列等。

Python代码实现(使用Keras)

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import LSTM, Dense

import numpy as np

# 生成示例数据

data = np.array([[i for i in range(100)]])

target = np.array([[1]])

# 调整数据形状以适应LSTM输入

data = data.reshape((1, 100, 1))

# 创建LSTM模型

model = Sequential()

model.add(LSTM(50, input_shape=(100, 1)))

model.add(Dense(1))

# 编译模型

model.compile(optimizer='adam', loss='mse')

# 训练模型

model.fit(data, target, epochs=100, verbose=0)

# 预测

prediction = model.predict(data)

print("预测结果:", prediction)

智能推荐系统核心算法:协同过滤

原理

协同过滤是根据用户之间的相似性或物品之间的相似性进行推荐。例如,如果用户A和用户B都喜欢电影X和电影Y,而用户A还喜欢电影Z,那么就可以向用户B推荐电影Z。

Python代码实现

import numpy as np

# 用户-物品评分矩阵

ratings = np.array([

[5, 3, 0, 1],

[4, 0, 0, 1],

[1, 1, 0, 5],

[1, 0, 0, 4],

[0, 1, 5, 4]

])

# 计算用户之间的相似度(使用余弦相似度)

def cosine_similarity(user1, user2):

dot_product = np.dot(user1, user2)

norm_user1 = np.linalg.norm(user1)

norm_user2 = np.linalg.norm(user2)

return dot_product / (norm_user1 * norm_user2)

# 找到与目标用户最相似的K个用户

def find_similar_users(target_user, ratings, k):

similarities = []

for i in range(len(ratings)):

if i != target_user:

similarity = cosine_similarity(ratings[target_user], ratings[i])

similarities.append((i, similarity))

similarities.sort(key=lambda x: x[1], reverse=True)

return similarities[:k]

# 推荐物品

def recommend_items(target_user, ratings, k):

similar_users = find_similar_users(target_user, ratings, k)

item_scores = {

}

for user, similarity in similar_users:

for item in range(len(ratings[user])):

if ratings[target_user][item] == 0 and ratings[user][item] != 0:

if item not in item_scores:

item_scores[item] = 0

item_scores[item] += ratings[user][item] * similarity

sorted_items = sorted(item_scores.items(), key=lambda x: x[1], reverse=True)

return sorted_items

# 示例:为用户0推荐物品

recommended_items = recommend_items(0, ratings, 2)

print("推荐物品:", recommended_items)

数学模型和公式 & 详细讲解 & 举例说明

词袋模型

数学模型

词袋模型可以用向量来表示文本。假设词汇表中有 V V V 个单词,那么每个文本可以表示为一个 V V V 维的向量,向量的每个元素表示对应单词在文本中出现的频率。

公式

设文本 d d d 中单词 w i w_i wi 出现的频率为 t f i , d tf_{i,d} tfi,d,则文本 d d d 的词袋向量 x d mathbf{x}_d xd 为:

x d = [ t f 1 , d , t f 2 , d , ⋯ , t f V , d ] mathbf{x}_d = [tf_{1,d}, tf_{2,d}, cdots, tf_{V,d}] xd=[tf1,d,tf2,d,⋯,tfV,d]

举例说明

对于文本“我喜欢苹果”,假设词汇表为 [“我”, “喜欢”, “苹果”, “香蕉”],则该文本的词袋向量为 [ 1 , 1 , 1 , 0 ] [1, 1, 1, 0] [1,1,1,0]。

卷积神经网络(CNN)

数学模型

卷积层的核心操作是卷积运算。设输入特征图为 X X X,卷积核为 W W W,输出特征图为 Y Y Y,则卷积运算可以表示为:

Y i , j = ∑ m = 0 M − 1 ∑ n = 0 N − 1 X i + m , j + n W m , n + b Y_{i,j} = sum_{m=0}^{M-1} sum_{n=0}^{N-1} X_{i+m,j+n} W_{m,n} + b Yi,j=m=0∑M−1n=0∑N−1Xi+m,j+nWm,n+b

其中, M M M 和 N N N 是卷积核的大小, b b b 是偏置。

公式

池化层通常采用最大池化或平均池化。以最大池化为例,设输入特征图为 X X X,池化窗口大小为 P × P P imes P P×P,输出特征图为 Y Y Y,则最大池化运算可以表示为:

Y i , j = max m = 0 P − 1 max n = 0 P − 1 X i P + m , j P + n Y_{i,j} = max_{m=0}^{P-1} max_{n=0}^{P-1} X_{iP + m,jP + n} Yi,j=m=0maxP−1n=0maxP−1XiP+m,jP+n

举例说明

假设输入特征图是一个 4 × 4 4 imes 4 4×4 的矩阵,卷积核是一个 2 × 2 2 imes 2 2×2 的矩阵,通过卷积运算可以得到一个新的特征图。池化操作可以对特征图进行降维,例如使用 2 × 2 2 imes 2 2×2 的最大池化窗口,将 4 × 4 4 imes 4 4×4 的特征图降维为 2 × 2 2 imes 2 2×2 的特征图。

决策树

数学模型

决策树的构建通常基于信息增益、信息增益比、基尼指数等指标。以信息增益为例,设数据集 D D D 中样本的类别数为 C C C,第 c c c 类样本的数量为 ∣ D c ∣ |D_c| ∣Dc∣,则数据集 D D D 的信息熵为:

H ( D ) = − ∑ c = 1 C ∣ D c ∣ ∣ D ∣ log 2 ∣ D c ∣ ∣ D ∣ H(D) = -sum_{c=1}^{C} frac{|D_c|}{|D|} log_2 frac{|D_c|}{|D|} H(D)=−c=1∑C∣D∣∣Dc∣log2∣D∣∣Dc∣

设属性 A A A 有 V V V 个不同的取值 { a 1 , a 2 , ⋯ , a V } {a_1, a_2, cdots, a_V} {

a1,a2,⋯,aV},将数据集 D D D 划分为 V V V 个子集 { D 1 , D 2 , ⋯ , D V } {D_1, D_2, cdots, D_V} {

D1,D2,⋯,DV},则属性 A A A 对数据集 D D D 的信息增益为:

G a i n ( D , A ) = H ( D ) − ∑ v = 1 V ∣ D v ∣ ∣ D ∣ H ( D v ) Gain(D, A) = H(D) – sum_{v=1}^{V} frac{|D_v|}{|D|} H(D_v) Gain(D,A)=H(D)−v=1∑V∣D∣∣Dv∣H(Dv)

公式

决策树的决策过程可以表示为从根节点开始,根据属性的取值选择相应的分支,直到到达叶子节点。

举例说明

在判断一个水果是苹果还是香蕉时,根据颜色、形状等属性构建决策树。如果颜色是红色,形状是圆形,那么就判断为苹果;如果颜色是黄色,形状是弯曲的,那么就判断为香蕉。

长短期记忆网络(LSTM)

数学模型

LSTM单元包含输入门 i t i_t it、遗忘门 f t f_t ft、输出门 o t o_t ot 和细胞状态 C t C_t Ct。其计算公式如下:

i t = σ ( W i i x t + W h i h t − 1 + b i ) i_t = sigma(W_{ii} x_t + W_{hi} h_{t-1} + b_i) it=σ(Wiixt+Whiht−1+bi)

f t = σ ( W i f x t + W h f h t − 1 + b f ) f_t = sigma(W_{if} x_t + W_{hf} h_{t-1} + b_f) ft=σ(Wifxt+Whfht−1+bf)

C t = f t ⊙ C t − 1 + i t ⊙ tanh ( W i c x t + W h c h t − 1 + b c ) C_t = f_t odot C_{t-1} + i_t odot anh(W_{ic} x_t + W_{hc} h_{t-1} + b_c) Ct=ft⊙Ct−1+it⊙tanh(Wicxt+Whcht−1+bc)

o t = σ ( W i o x t + W h o h t − 1 + b o ) o_t = sigma(W_{io} x_t + W_{ho} h_{t-1} + b_o) ot=σ(Wioxt+Whoht−1+bo)

h t = o t ⊙ tanh ( C t ) h_t = o_t odot anh(C_t) ht=ot⊙tanh(Ct)

其中, σ sigma σ 是 sigmoid 函数, ⊙ odot ⊙ 是逐元素相乘, x t x_t xt 是输入, h t − 1 h_{t-1} ht−1 是上一时刻的隐藏状态, W W W 是权重矩阵, b b b 是偏置。

公式

LSTM通过这些门控机制来控制信息的流动和记忆。

举例说明

在处理一段文本时,LSTM可以记住前面的单词信息,根据当前的单词和前面的记忆来预测下一个单词。

协同过滤

数学模型

协同过滤通常使用余弦相似度来计算用户之间或物品之间的相似度。设用户 u u u 和用户 v v v 的评分向量分别为 r u mathbf{r}_u ru 和 r v mathbf{r}_v rv,则用户 u u u 和用户 v v v 的余弦相似度为:

s i m ( u , v ) = r u ⋅ r v ∥ r u ∥ ∥ r v ∥ sim(u, v) = frac{mathbf{r}_u cdot mathbf{r}_v}{|mathbf{r}_u| |mathbf{r}_v|} sim(u,v)=∥ru∥∥rv∥ru⋅rv

公式

根据相似度,为目标用户推荐物品。设目标用户为 u u u,相似用户集合为 S S S,物品 i i i 被相似用户 v v v 的评分记为 r v , i r_{v,i} rv,i,则物品 i i i 对用户 u u u 的推荐得分 p u , i p_{u,i} pu,i 为:

p u , i = ∑ v ∈ S s i m ( u , v ) r v , i ∑ v ∈ S ∣ s i m ( u , v ) ∣ p_{u,i} = frac{sum_{vin S} sim(u, v) r_{v,i}}{sum_{vin S} |sim(u, v)|} pu,i=∑v∈S∣sim(u,v)∣∑v∈Ssim(u,v)rv,i

举例说明

在电影推荐系统中,根据用户对电影的评分,计算用户之间的相似度。如果用户A和用户B的相似度很高,用户B对电影C的评分很高,而用户A没有看过电影C,那么就可以向用户A推荐电影C。

项目实战:代码实际案例和详细解释说明

自然语言处理项目:情感分析

开发环境搭建

安装Python 3.x

安装必要的库,如numpy、pandas、scikit-learn、tensorflow等。可以使用以下命令进行安装:

pip install numpy pandas scikit-learn tensorflow

源代码详细实现和代码解读

import numpy as np

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.linear_model import LogisticRegression

from sklearn.metrics import accuracy_score

# 加载数据集

data = pd.read_csv('sentiment_data.csv')

X = data['text']

y = data['sentiment']

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 特征提取

vectorizer = TfidfVectorizer()

X_train_vec = vectorizer.fit_transform(X_train)

X_test_vec = vectorizer.transform(X_test)

# 创建模型

model = LogisticRegression()

# 训练模型

model.fit(X_train_vec, y_train)

# 预测

y_pred = model.predict(X_test_vec)

# 计算准确率

accuracy = accuracy_score(y_test, y_pred)

print("准确率:", accuracy)

代码解读与分析

首先,使用pandas库加载数据集,将文本数据和情感标签分别存储在X和y中。

然后,使用train_test_split函数将数据集划分为训练集和测试集。

接着,使用TfidfVectorizer进行特征提取,将文本数据转化为向量表示。

再创建一个逻辑回归模型,并使用训练集进行训练。

最后,使用测试集进行预测,并计算准确率。

计算机视觉项目:手写数字识别

开发环境搭建

安装Python 3.x

安装必要的库,如numpy、matplotlib、tensorflow等。可以使用以下命令进行安装:

pip install numpy matplotlib tensorflow

源代码详细实现和代码解读

import tensorflow as tf

from tensorflow.keras.datasets import mnist

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Flatten, Dense

import matplotlib.pyplot as plt

# 加载数据集

(x_train, y_train), (x_test, y_test) = mnist.load_data()

# 数据预处理

x_train = x_train / 255.0

x_test = x_test / 255.0

# 创建模型

model = Sequential([

Flatten(input_shape=(28, 28)),

Dense(128, activation='relu'),

Dense(10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 训练模型

model.fit(x_train, y_train, epochs=5)

# 评估模型

test_loss, test_acc = model.evaluate(x_test, y_test)

print("测试准确率:", test_acc)

# 预测

predictions = model.predict(x_test)

index = 0

plt.imshow(x_test[index], cmap='gray')

plt.title(f"预测结果: {

np.argmax(predictions[index])}")

plt.show()

代码解读与分析

首先,使用mnist.load_data()加载手写数字数据集。

然后,对数据进行预处理,将像素值归一化到0-1之间。

接着,创建一个简单的神经网络模型,包括一个展平层、一个全连接层和一个输出层。

再编译模型,指定优化器、损失函数和评估指标。

之后,使用训练集进行训练。

最后,使用测试集评估模型,并进行预测,可视化预测结果。

机器学习项目:房价预测

开发环境搭建

安装Python 3.x

安装必要的库,如numpy、pandas、scikit-learn等。可以使用以下命令进行安装:

pip install numpy pandas scikit-learn

源代码详细实现和代码解读

import numpy as np

import pandas as pd

from sklearn.datasets import load_boston

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

from sklearn.metrics import mean_squared_error

# 加载数据集

boston = load_boston()

X = boston.data

y = boston.target

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 创建模型

model = LinearRegression()

# 训练模型

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 计算均方误差

mse = mean_squared_error(y_test, y_pred)

print("均方误差:", mse)

代码解读与分析

首先,使用load_boston()加载波士顿房价数据集。

然后,将数据集划分为训练集和测试集。

接着,创建一个线性回归模型,并使用训练集进行训练。

最后,使用测试集进行预测,并计算均方误差。

深度学习项目:图像生成(使用GAN)

开发环境搭建

安装Python 3.x

安装必要的库,如numpy、tensorflow、matplotlib等。可以使用以下命令进行安装:

pip install numpy tensorflow matplotlib

源代码详细实现和代码解读

import tensorflow as tf

from tensorflow.keras import layers

import numpy as np

import matplotlib.pyplot as plt

# 定义生成器

def make_generator_model():

model = tf.keras.Sequential()

model.add(layers.Dense(7*7*256, use_bias=False, input_shape=(100,)))

model.add(layers.BatchNormalization())

model.add(layers.LeakyReLU())

model.add(layers.Reshape((7, 7, 256)))

assert model.output_shape == (None, 7, 7, 256)

model.add(layers.Conv2DTranspose(128, (5, 5), strides=(2, 2), padding='same', use_bias=False))

assert model.output_shape == (None, 14, 14, 128)

model.add(layers.BatchNormalization())

model.add(layers.LeakyReLU())

model.add(layers.Conv2DTranspose(64, (5, 5), strides=(2, 2), padding='same', use_bias=False))

assert model.output_shape == (None, 28, 28, 64)

model.add(layers.BatchNormalization())

model.add(layers.LeakyReLU())

model.add(layers.Conv2DTranspose(1, (5, 5), strides=(1, 1), padding='same', use_bias=False, activation='tanh'))

assert model.output_shape == (None, 28, 28, 1)

return model

# 定义判别器

def make_discriminator_model():

model = tf.keras.Sequential()

model.add(layers.Conv2D(64, (5, 5), strides=(2, 2), padding='same',

input_shape=[28, 28, 1]))

model.add(layers.LeakyReLU())

model.add(layers.Dropout(0.3))

model.add(layers.Conv2D(128, (5, 5), strides=(2, 2), padding='same'))

model.add(layers.LeakyReLU())

model.add(layers.Dropout(0.3))

model.add(layers.Flatten())

model.add(layers.Dense(1))

return model

# 定义损失函数

cross_entropy = tf.keras.losses.BinaryCrossentropy(from_logits=True)

def discriminator_loss(real_output, fake_output):

real_loss = cross_entropy(tf.ones_like(real_output), real_output)

fake_loss = cross_entropy(tf.zeros_like(fake_output), fake_output)

total_loss = real_loss + fake_loss

return total_loss

def generator_loss(fake_output):

return cross_entropy(tf.ones_like(fake_output), fake_output)

# 定义优化器

generator_optimizer = tf.keras.optimizers.Adam(1e-4)

discriminator_optimizer = tf.keras.optimizers.Adam(1e-4)

# 训练循环

EPOCHS = 50

noise_dim = 100

num_examples_to_generate = 16

seed = tf.random.normal([num_examples_to_generate, noise_dim])

@tf.function

def train_step(images):

noise = tf.random.normal([BATCH_SIZE, noise_dim])

with tf.GradientTape() as gen_tape, tf.GradientTape() as disc_tape:

generated_images = generator(noise, training=True)

real_output = discriminator(images, training=True)

fake_output = discriminator(generated_images, training=True)

gen_loss = generator_loss(fake_output)

disc_loss = discriminator_loss(real_output, fake_output)

gradients_of_generator = gen_tape.gradient(gen_loss, generator.trainable_variables)

gradients_of_discriminator = disc_tape.gradient(disc_loss, discriminator.trainable_variables)

generator_optimizer.apply_gradients(zip(gradients_of_generator, generator.trainable_variables))

discriminator_optimizer.apply_gradients(zip(gradients_of_discriminator, discriminator.trainable_variables))

def train(dataset, epochs):

for epoch in range(epochs):

for image_batch in dataset:

train_step(image_batch)

generate_and_save_images(generator,

epoch + 1,

seed)

def generate_and_save_images(model, epoch, test_input):

predictions = model(test_input, training=False)

fig = plt.figure(figsize=(4, 4))

for i in range(predictions.shape[0]):

plt.subplot(4, 4, i+1)

plt.imshow(predictions[i, :, :, 0] * 127.5 + 127.5, cmap='gray')

plt.axis('off')

plt.savefig('image_at_epoch_{:04d}.png'.format(epoch))

plt.show()

# 加载数据集

(train_images, _), (_, _) = tf.keras.datasets.mnist.load_data()

train_images = train_images.reshape(train_images.shape[0], 28, 28, 1).astype('float32')

train_images = (train_images - 127.5) / 127.5 # 归一化到 [-1, 1]

BUFFER_SIZE = 60000

BATCH_SIZE = 256

# 批处理和打乱数据

train_dataset = tf.data.Dataset.from_tensor_slices(train_images).shuffle(BUFFER_SIZE).batch(BATCH_SIZE)

# 创建生成器和判别器

generator = make_generator_model()

discriminator = make_discriminator_model()

# 训练模型

train(train_dataset, EPOCHS)

代码解读与分析

首先,定义了生成器和判别器模型。生成器的作用是从随机噪声中生成图像,判别器的作用是判断输入的图像是真实图像还是生成的图像。

然后,定义了损失函数和优化器。生成器的目标是让判别器将生成的图像判断为真实图像,判别器的目标是正确区分真实图像和生成的图像。

接着,定义了训练循环,在每个训练步骤中,更新生成器和判别器的参数。

最后,加载MNIST数据集,进行训练,并可视化生成的图像。

智能推荐系统项目:电影推荐

开发环境搭建

安装Python 3.x

安装必要的库,如numpy、pandas、scikit-learn等。可以使用以下命令进行安装:

pip install numpy pandas scikit-learn

源代码详细实现和代码解读

import numpy as np

import pandas as pd

from sklearn.metrics.pairwise import cosine_similarity

# 加载数据集

ratings = pd.read_csv('ratings.csv')

movies = pd.read_csv('movies.csv')

# 创建用户-电影评分矩阵

user_movie_matrix = ratings.pivot(index='userId', columns='movieId', values='rating').fillna(0)

# 计算用户之间的相似度

user_similarity = cosine_similarity(user_movie_matrix)

# 推荐函数

def recommend_movies(user_id, top_n=10):

user_index = user_movie_matrix.index.get_loc(user_id)

similar_users = user_similarity[user_index].argsort()[::-1][1:top_n+1]

similar_user_ratings = user_movie_matrix.iloc[similar_users]

user_ratings = user_movie_matrix.iloc[user_index]

unrated_movies = user_ratings[user_ratings == 0].index

movie_scores = {

}

for movie in unrated_movies:

score = 0

for similar_user in similar_users:

similar_user_rating = similar_user_ratings.loc[similar_user_ratings.index[similar_user]][movie]

score += similar_user_rating * user_similarity[user_index][similar_user]

movie_scores[movie] = score

sorted_movies = sorted(movie_scores.items(), key=lambda x: x[1], reverse=True)[:top_n]

recommended_movie_ids = [movie[0] for movie in sorted_movies]

recommended_movies = movies[movies['movieId'].isin(recommended_movie_ids)]

return recommended_movies

# 示例:为用户1推荐电影

recommended_movies = recommend_movies(1)

print("推荐电影:", recommended_movies)

代码解读与分析

首先,使用pandas库加载电影评分数据集和电影信息数据集。

然后,创建用户-电影评分矩阵,将缺失值填充为0。

接着,使用cosine_similarity函数计算用户之间的相似度。

再定义推荐函数,根据用户之间的相似度,为目标用户推荐未评分的电影。

最后,为用户1推荐电影,并输出推荐结果。

实际应用场景

自然语言处理

智能客服:可以自动回答用户的问题,提高客户服务效率。例如,电商平台的智能客服可以解答用户关于商品信息、订单状态等问题。

机器翻译:实现不同语言之间的翻译。如谷歌翻译、百度翻译等。

文本分类:对新闻、评论等文本进行分类,如情感分类、主题分类等。例如,对电影评论进行情感分析,判断是正面评价还是负面评价。

计算机视觉

安防监控:用于识别可疑人员、车辆等,保障公共安全。例如,在机场、火车站等场所的监控系统中,实时监测人员和物体的活动。

自动驾驶:帮助汽车识别道路、交通标志、行人等,实现自动驾驶功能。如特斯拉、蔚来等汽车品牌都在积极研发自动驾驶技术。

医学影像诊断:辅助医生对X光、CT等医学影像进行诊断,提高诊断的准确性和效率。例如,一些医疗科技公司利用计算机视觉技术帮助医生检测肿瘤等疾病。

机器学习

金融风险评估:根据客户的信用记录、收入情况等数据,评估客户的信用风险,为贷款审批提供参考。例如,银行在发放贷款时,会使用机器学习模型评估借款人的违约风险。

市场营销:分析客户的购买行为和偏好,进行精准营销。例如,电商平台根据用户的浏览和购买历史,向用户推荐合适的商品。

预测分析:预测股票价格、销售额等。例如,金融机构使用机器学习模型预测股票市场的走势。

深度学习

语音识别:将语音转换为文本,实现语音交互。如苹果的Siri、小米的小爱同学等智能语音助手。

图像生成:生成逼真的图像,用于艺术创作、游戏开发等领域。例如,一些艺术家使用深度学习模型生成独特的艺术作品。

游戏AI:让游戏中的角色具有智能行为,提高游戏的趣味性和挑战性。例如,在一些策略游戏中,AI对手可以根据玩家的策略做出相应的反应。

智能推荐系统

电商平台:根据用户的购买历史、浏览记录等,为用户推荐商品。如淘宝、京东等电商平台的商品推荐功能。

视频平台:推荐用户可能感兴趣的视频内容。如抖音、爱奇艺等视频平台的个性化推荐。

音乐平台:推荐符合用户口味的音乐。如网易云音乐、QQ音乐等音乐平台的歌曲推荐。

工具和资源推荐

自然语言处理

工具:NLTK(Natural Language Toolkit)、SpaCy、AllenNLP等。

资源:GLUE基准测试、SuperGLUE基准测试、Wikipedia语料库等。

计算机视觉

工具:OpenCV、Scikit-Image、TensorFlow Object Detection API等。

资源:MNIST数据集、CIFAR-10数据集、ImageNet数据集等。

机器学习

工具:Scikit-learn、XGBoost、LightGBM等。

资源:UCI Machine Learning Repository、Kaggle数据集等。

深度学习

工具:TensorFlow、PyTorch、Keras等。

资源:Google Colab、Kaggle Kernels等免费的计算资源。

智能推荐系统

工具:Surprise、LightFM等。

资源:MovieLens数据集、Amazon Product Reviews数据集等。

未来发展趋势与挑战

自然语言处理

趋势:多语言处理、常识推理、与其他模态的融合(如视觉、语音)等。

挑战:处理复杂的语义理解、处理长文本、保护用户隐私等。

计算机视觉

趋势:3D视觉、视频理解、跨模态学习等。

挑战:处理复杂场景、提高模型的鲁棒性、解决数据标注难题等。

机器学习

趋势:自动化机器学习、联邦学习、可解释机器学习等。

挑战:处理高维数据、防止过拟合、提高模型的可解释性等。

深度学习

趋势:强化深度学习、自监督学习、生成对抗网络的改进等。

挑战:训练成本高、模型可解释性差、数据安全和隐私问题等。

智能推荐系统

趋势:个性化推荐的精细化、融合多源数据、社交推荐等。

挑战:处理冷启动问题、避免推荐结果的同质化、保护用户隐私等。

总结:学到了什么?

核心概念回顾

我们学习了自然语言处理,它能让计算机理解和处理人类语言,就像一个语言小能手。

计算机视觉可以让计算机像人一样“看”世界,识别图像和视频中的物体。

机器学习能从数据中学习规律和模式,就像一个聪明的学生。

深度学习是机器学习的升级版,有更强大的学习能力。

智能推荐系统能根据用户的喜好和行为,为用户推荐感兴趣的东西,就像一个贴心的小秘书。

概念关系回顾

自然语言处理和计算机视觉可以互相帮助,一个负责语言处理,一个负责图像识别。

计算机视觉需要机器学习的帮助来提高识别能力。

深度学习是机器学习的高级形式,能处理更复杂的任务。

深度学习可以让智能推荐系统更准确地推荐物品。

自然语言处理能帮助智能推荐系统更好地理解用户需求。

思考题:动动小脑筋

思考题一

你能想到生活中还有哪些地方用到了自然语言处理技术吗?

思考题二

如果你要开发一个新的计算机视觉应用,你会选择什么场景?如何应用所学的知识?

思考题三

在智能推荐系统中,如何解决冷启动问题?你有什么好的想法?

思考题四

深度学习模型的可解释性一直是一个难题,你认为可以从哪些方面入手解决这个问题?

思考题五

随着AI技术的发展,隐私和安全问题越来越受到关注。在AI原生应用中,如何保障用户的隐私和数据安全?

附录:常见问题与解答

问题一:如何选择适合的机器学习算法?

答:选择适合的机器学习算法需要考虑数据的特点、问题的类型和目标等因素。如果数据是有标签的,且问题是分类问题,可以考虑使用逻辑回归、决策树等算法;如果是回归问题,可以考虑使用线性回归、岭回归等算法。如果数据是无标签的,可以考虑使用聚类算法,如

暂无评论内容