AI人工智能深度学习中的强化学习环境

关键词:AI、人工智能、深度学习、强化学习环境、马尔可夫决策过程、OpenAI Gym

摘要:本文深入探讨了AI人工智能深度学习中的强化学习环境。首先介绍了强化学习环境的背景,包括其目的、预期读者和文档结构。接着阐述了核心概念,如马尔可夫决策过程等,并给出了相应的示意图和流程图。详细讲解了核心算法原理及具体操作步骤,使用Python代码进行了示例。还分析了相关的数学模型和公式,并通过举例说明。通过项目实战,展示了如何搭建开发环境、实现代码并进行解读。探讨了强化学习环境的实际应用场景,推荐了学习资源、开发工具框架和相关论文著作。最后总结了未来发展趋势与挑战,并给出常见问题解答和扩展阅读参考资料。

1. 背景介绍

1.1 目的和范围

强化学习是机器学习的一个重要分支,它关注智能体(agent)如何在环境中采取一系列行动以最大化累积奖励。强化学习环境是智能体进行学习和交互的场景,本文章的目的是全面深入地介绍强化学习环境,包括其核心概念、算法原理、实际应用等方面。范围涵盖了从理论基础到实际项目开发,旨在帮助读者系统地理解和掌握强化学习环境的相关知识和技术。

1.2 预期读者

本文预期读者包括对人工智能、深度学习和强化学习感兴趣的初学者,希望深入了解强化学习环境原理和应用的开发者,以及从事相关研究的科研人员。无论是想要入门强化学习领域,还是希望在实际项目中应用强化学习技术,本文都将提供有价值的参考。

1.3 文档结构概述

本文将按照以下结构进行组织:首先介绍强化学习环境的核心概念与联系,包括相关的理论基础和架构;接着讲解核心算法原理和具体操作步骤,并使用Python代码进行详细阐述;然后分析数学模型和公式,并举例说明;通过项目实战展示如何在实际中应用强化学习环境;探讨实际应用场景;推荐相关的学习资源、开发工具框架和论文著作;最后总结未来发展趋势与挑战,给出常见问题解答和扩展阅读参考资料。

1.4 术语表

1.4.1 核心术语定义

智能体(Agent):在强化学习中,智能体是能够感知环境状态并采取行动的实体,其目标是通过与环境的交互来最大化累积奖励。

环境(Environment):智能体所处的外部世界,它为智能体提供状态信息,并根据智能体的行动给出相应的奖励和下一个状态。

状态(State):环境在某一时刻的描述,智能体根据当前状态来决定采取何种行动。

行动(Action):智能体在某一状态下可以采取的操作,不同的行动会导致环境状态的不同变化。

奖励(Reward):环境在智能体采取行动后给予的反馈信号,用于衡量该行动的好坏,智能体的目标是最大化累积奖励。

策略(Policy):智能体根据当前状态选择行动的规则,通常表示为一个函数 π ( s ) pi(s) π(s),其中 s s s 是状态。

1.4.2 相关概念解释

马尔可夫决策过程(MDP):是强化学习中常用的数学模型,它假设环境的下一个状态只取决于当前状态和智能体采取的行动,具有马尔可夫性质。

折扣因子(Discount Factor):在计算累积奖励时,用于对未来奖励进行折扣,以反映未来奖励的不确定性和及时性,通常用 γ gamma γ 表示,取值范围为 [ 0 , 1 ] [0, 1] [0,1]。

1.4.3 缩略词列表

MDP:马尔可夫决策过程(Markov Decision Process)

RL:强化学习(Reinforcement Learning)

2. 核心概念与联系

2.1 马尔可夫决策过程(MDP)原理

马尔可夫决策过程是强化学习环境的核心数学模型,它由一个四元组 ( S , A , P , R ) (S, A, P, R) (S,A,P,R) 组成,其中:

S S S 是有限的状态集合,表示环境可能处于的所有状态。

A A A 是有限的行动集合,表示智能体在每个状态下可以采取的所有行动。

P P P 是状态转移概率函数, P ( s ′ ∣ s , a ) P(s'|s, a) P(s′∣s,a) 表示在状态 s s s 下采取行动 a a a 后转移到状态 s ′ s' s′ 的概率。

R R R 是奖励函数, R ( s , a , s ′ ) R(s, a, s') R(s,a,s′) 表示在状态 s s s 下采取行动 a a a 并转移到状态 s ′ s' s′ 时获得的奖励。

MDP 满足马尔可夫性质,即未来状态的概率分布只取决于当前状态和当前行动,而与过去的状态和行动无关。这一性质使得我们可以使用动态规划等方法来求解最优策略。

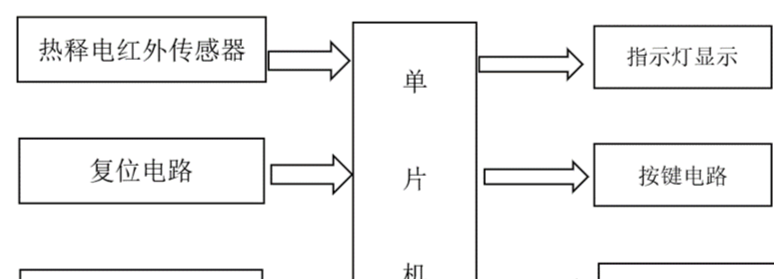

2.2 强化学习环境架构

强化学习环境的基本架构包括智能体和环境两部分,它们之间通过状态、行动和奖励进行交互。智能体根据当前状态选择行动,将行动发送给环境;环境根据行动更新状态,并返回新的状态和奖励给智能体。这个过程不断重复,直到达到终止条件。

以下是强化学习环境架构的文本示意图:

智能体 <-- 状态(State) --> 环境

智能体 --> 行动(Action) --> 环境

智能体 <-- 奖励(Reward) <-- 环境

2.3 Mermaid 流程图

这个流程图展示了强化学习环境中智能体和环境的交互过程。智能体首先感知环境状态,然后根据策略选择行动并执行,环境根据行动更新状态并给出奖励,智能体接收新状态和奖励后判断是否终止,如果未终止则继续循环,直到达到终止条件。

3. 核心算法原理 & 具体操作步骤

3.1 Q – 学习算法原理

Q – 学习是一种无模型的强化学习算法,它通过学习一个动作价值函数 Q ( s , a ) Q(s, a) Q(s,a) 来找到最优策略。动作价值函数 Q ( s , a ) Q(s, a) Q(s,a) 表示在状态 s s s 下采取行动 a a a 并遵循最优策略继续下去所能获得的累积折扣奖励。

Q – 学习的更新公式为:

Q ( s t , a t ) ← Q ( s t , a t ) + α [ r t + 1 + γ max a Q ( s t + 1 , a ) − Q ( s t , a t ) ] Q(s_t, a_t) leftarrow Q(s_t, a_t) + alpha [r_{t+1} + gamma max_{a} Q(s_{t+1}, a) – Q(s_t, a_t)] Q(st,at)←Q(st,at)+α[rt+1+γamaxQ(st+1,a)−Q(st,at)]

其中:

s t s_t st 是当前状态。

a t a_t at 是当前采取的行动。

r t + 1 r_{t+1} rt+1 是执行行动 a t a_t at 后获得的奖励。

s t + 1 s_{t+1} st+1 是执行行动 a t a_t at 后转移到的新状态。

α alpha α 是学习率,控制每次更新的步长。

γ gamma γ 是折扣因子,用于对未来奖励进行折扣。

3.2 具体操作步骤

初始化:初始化动作价值函数 Q ( s , a ) Q(s, a) Q(s,a) 为零,设置学习率 α alpha α 和折扣因子 γ gamma γ。

循环执行以下步骤:

观察当前状态 s t s_t st。

根据 Q Q Q 函数选择行动 a t a_t at,可以使用 ϵ epsilon ϵ – 贪心策略,即有 ϵ epsilon ϵ 的概率随机选择行动,有 1 − ϵ 1 – epsilon 1−ϵ 的概率选择 Q Q Q 值最大的行动。

执行行动 a t a_t at,观察环境返回的奖励 r t + 1 r_{t+1} rt+1 和新状态 s t + 1 s_{t+1} st+1。

根据 Q – 学习更新公式更新 Q ( s t , a t ) Q(s_t, a_t) Q(st,at)。

判断是否达到终止条件,如果是则结束循环,否则将 s t + 1 s_{t+1} st+1 作为新的当前状态继续循环。

3.3 Python 代码实现

import numpy as np

# 定义环境参数

num_states = 5

num_actions = 2

alpha = 0.1

gamma = 0.9

epsilon = 0.1

num_episodes = 1000

# 初始化 Q 表

Q = np.zeros((num_states, num_actions))

# 定义环境转移和奖励函数(示例)

def env_step(state, action):

if state == 0 and action == 0:

next_state = 1

reward = 1

elif state == 1 and action == 1:

next_state = 2

reward = 2

else:

next_state = state

reward = 0

return next_state, reward

# Q - 学习算法

for episode in range(num_episodes):

state = 0

done = False

while not done:

# 选择行动(epsilon - 贪心策略)

if np.random.uniform(0, 1) < epsilon:

action = np.random.choice(num_actions)

else:

action = np.argmax(Q[state, :])

# 执行行动

next_state, reward = env_step(state, action)

# 更新 Q 表

Q[state, action] = Q[state, action] + alpha * (reward + gamma * np.max(Q[next_state, :]) - Q[state, action])

state = next_state

# 判断是否终止

if state == 2:

done = True

print("最终的 Q 表:")

print(Q)

在这段代码中,我们首先定义了环境的参数,包括状态数、行动数、学习率、折扣因子和训练的回合数。然后初始化了 Q 表,定义了环境的转移和奖励函数。在训练过程中,使用 ϵ epsilon ϵ – 贪心策略选择行动,执行行动后根据 Q – 学习更新公式更新 Q 表,直到达到终止条件。最后打印出最终的 Q 表。

4. 数学模型和公式 & 详细讲解 & 举例说明

4.1 累积折扣奖励

在强化学习中,智能体的目标是最大化累积折扣奖励。累积折扣奖励 G t G_t Gt 定义为从时间步 t t t 开始的未来奖励的折扣和:

G t = ∑ k = 0 ∞ γ k r t + k + 1 G_t = sum_{k=0}^{infty} gamma^k r_{t+k+1} Gt=k=0∑∞γkrt+k+1

其中 r t + k + 1 r_{t+k+1} rt+k+1 是时间步 t + k + 1 t + k + 1 t+k+1 获得的奖励, γ gamma γ 是折扣因子。折扣因子 γ gamma γ 的作用是使得未来的奖励相对于当前奖励的重要性降低,因为未来的奖励具有不确定性。

例如,假设智能体在时间步 t t t 开始获得的奖励序列为 r t + 1 = 1 , r t + 2 = 2 , r t + 3 = 3 r_{t+1} = 1, r_{t+2} = 2, r_{t+3} = 3 rt+1=1,rt+2=2,rt+3=3,折扣因子 γ = 0.9 gamma = 0.9 γ=0.9,则累积折扣奖励为:

G t = 1 + 0.9 × 2 + 0. 9 2 × 3 = 1 + 1.8 + 2.43 = 5.23 G_t = 1 + 0.9 imes 2 + 0.9^2 imes 3 = 1 + 1.8 + 2.43 = 5.23 Gt=1+0.9×2+0.92×3=1+1.8+2.43=5.23

4.2 状态价值函数和动作价值函数

状态价值函数: V π ( s ) V^{pi}(s) Vπ(s) 表示在策略 π pi π 下,从状态 s s s 开始所能获得的期望累积折扣奖励,定义为:

V π ( s ) = E π [ G t ∣ s t = s ] V^{pi}(s) = mathbb{E}_{pi} [G_t | s_t = s] Vπ(s)=Eπ[Gt∣st=s]

其中 E π mathbb{E}_{pi} Eπ 表示在策略 π pi π 下的期望。

动作价值函数: Q π ( s , a ) Q^{pi}(s, a) Qπ(s,a) 表示在策略 π pi π 下,从状态 s s s 采取行动 a a a 后所能获得的期望累积折扣奖励,定义为:

Q π ( s , a ) = E π [ G t ∣ s t = s , a t = a ] Q^{pi}(s, a) = mathbb{E}_{pi} [G_t | s_t = s, a_t = a] Qπ(s,a)=Eπ[Gt∣st=s,at=a]

4.3 贝尔曼方程

贝尔曼方程是强化学习中的重要方程,它描述了状态价值函数和动作价值函数的递归关系。

状态价值函数的贝尔曼方程:

V π ( s ) = ∑ a ∈ A π ( a ∣ s ) ∑ s ′ ∈ S P ( s ′ ∣ s , a ) [ R ( s , a , s ′ ) + γ V π ( s ′ ) ] V^{pi}(s) = sum_{a in A} pi(a|s) sum_{s' in S} P(s'|s, a) [R(s, a, s') + gamma V^{pi}(s')] Vπ(s)=a∈A∑π(a∣s)s′∈S∑P(s′∣s,a)[R(s,a,s′)+γVπ(s′)]

这个方程表示在策略 π pi π 下,状态 s s s 的价值等于在该状态下采取所有可能行动的概率加权和,每个行动的价值是执行该行动后转移到下一个状态的概率乘以该转移的奖励加上下一个状态的折扣价值。

动作价值函数的贝尔曼方程:

Q π ( s , a ) = ∑ s ′ ∈ S P ( s ′ ∣ s , a ) [ R ( s , a , s ′ ) + γ ∑ a ′ ∈ A π ( a ′ ∣ s ′ ) Q π ( s ′ , a ′ ) ] Q^{pi}(s, a) = sum_{s' in S} P(s'|s, a) [R(s, a, s') + gamma sum_{a' in A} pi(a'|s') Q^{pi}(s', a')] Qπ(s,a)=s′∈S∑P(s′∣s,a)[R(s,a,s′)+γa′∈A∑π(a′∣s′)Qπ(s′,a′)]

这个方程表示在策略 π pi π 下,状态 s s s 采取行动 a a a 的价值等于执行该行动后转移到下一个状态的概率乘以该转移的奖励加上下一个状态下采取所有可能行动的概率加权和,每个行动的价值是该行动的折扣价值。

4.4 最优策略和最优价值函数

最优策略 π ∗ pi^* π∗ 是使得累积折扣奖励最大的策略,即:

π ∗ = arg max π V π ( s ) pi^* = arg max_{pi} V^{pi}(s) π∗=argπmaxVπ(s)

最优状态价值函数 V ∗ ( s ) V^*(s) V∗(s) 和最优动作价值函数 Q ∗ ( s , a ) Q^*(s, a) Q∗(s,a) 分别定义为:

V ∗ ( s ) = max π V π ( s ) V^*(s) = max_{pi} V^{pi}(s) V∗(s)=πmaxVπ(s)

Q ∗ ( s , a ) = max π Q π ( s , a ) Q^*(s, a) = max_{pi} Q^{pi}(s, a) Q∗(s,a)=πmaxQπ(s,a)

最优价值函数满足贝尔曼最优方程:

最优状态价值函数的贝尔曼最优方程:

V ∗ ( s ) = max a ∈ A ∑ s ′ ∈ S P ( s ′ ∣ s , a ) [ R ( s , a , s ′ ) + γ V ∗ ( s ′ ) ] V^*(s) = max_{a in A} sum_{s' in S} P(s'|s, a) [R(s, a, s') + gamma V^*(s')] V∗(s)=a∈Amaxs′∈S∑P(s′∣s,a)[R(s,a,s′)+γV∗(s′)]

最优动作价值函数的贝尔曼最优方程:

Q ∗ ( s , a ) = ∑ s ′ ∈ S P ( s ′ ∣ s , a ) [ R ( s , a , s ′ ) + γ max a ′ ∈ A Q ∗ ( s ′ , a ′ ) ] Q^*(s, a) = sum_{s' in S} P(s'|s, a) [R(s, a, s') + gamma max_{a' in A} Q^*(s', a')] Q∗(s,a)=s′∈S∑P(s′∣s,a)[R(s,a,s′)+γa′∈AmaxQ∗(s′,a′)]

通过求解贝尔曼最优方程,可以得到最优策略。

5. 项目实战:代码实际案例和详细解释说明

5.1 开发环境搭建

为了进行强化学习项目实战,我们可以使用 OpenAI Gym 作为强化学习环境,同时使用 Python 作为开发语言。以下是搭建开发环境的步骤:

安装 Python:确保已经安装了 Python 3.6 或更高版本。可以从 Python 官方网站(https://www.python.org/downloads/)下载并安装。

安装 OpenAI Gym:使用以下命令安装 OpenAI Gym:

pip install gym

安装其他必要的库:根据具体的项目需求,可能还需要安装 NumPy、Matplotlib 等库,可以使用以下命令安装:

pip install numpy matplotlib

5.2 源代码详细实现和代码解读

我们以 OpenAI Gym 中的 CartPole 环境为例,实现一个简单的 Q – 学习智能体。

import gym

import numpy as np

# 定义环境

env = gym.make('CartPole-v1')

# 离散化状态空间

num_bins = 10

state_bins = []

for i in range(env.observation_space.shape[0]):

state_bins.append(np.linspace(env.observation_space.low[i], env.observation_space.high[i], num_bins))

# 初始化 Q 表

num_states = (num_bins,) * env.observation_space.shape[0]

num_actions = env.action_space.n

Q = np.zeros(num_states + (num_actions,))

# 定义超参数

alpha = 0.1

gamma = 0.9

epsilon = 0.1

num_episodes = 1000

# 离散化状态

def discretize_state(state):

discrete_state = []

for i in range(len(state)):

discrete_state.append(np.digitize(state[i], state_bins[i]) - 1)

return tuple(discrete_state)

# Q - 学习算法

for episode in range(num_episodes):

state = env.reset()

discrete_state = discretize_state(state)

done = False

while not done:

# 选择行动(epsilon - 贪心策略)

if np.random.uniform(0, 1) < epsilon:

action = env.action_space.sample()

else:

action = np.argmax(Q[discrete_state])

# 执行行动

next_state, reward, done, _ = env.step(action)

next_discrete_state = discretize_state(next_state)

# 更新 Q 表

Q[discrete_state + (action,)] = Q[discrete_state + (action,)] + alpha * (reward + gamma * np.max(Q[next_discrete_state]) - Q[discrete_state + (action,)])

discrete_state = next_discrete_state

if episode % 100 == 0:

print(f"Episode {

episode}: Completed")

env.close()

5.3 代码解读与分析

环境定义:使用 gym.make('CartPole-v1') 创建 CartPole 环境。

状态离散化:由于 CartPole 环境的状态空间是连续的,而 Q – 学习通常适用于离散状态空间,因此需要将状态离散化。我们将每个连续状态维度划分为 num_bins 个区间,通过 np.digitize 函数将连续状态转换为离散状态。

Q 表初始化:根据离散化后的状态空间和动作空间初始化 Q 表。

超参数设置:设置学习率 alpha、折扣因子 gamma、探索率 epsilon 和训练的回合数 num_episodes。

Q – 学习循环:在每个回合中,智能体根据 ϵ epsilon ϵ – 贪心策略选择行动,执行行动后更新 Q 表,直到回合结束。

输出信息:每 100 个回合打印一次完成信息。

通过这个项目实战,我们可以看到如何使用 Q – 学习算法在 OpenAI Gym 环境中训练智能体。

6. 实际应用场景

6.1 游戏领域

强化学习环境在游戏领域有广泛的应用。例如,在棋类游戏如围棋、国际象棋中,智能体可以通过与环境(棋盘状态)的交互,学习到最优的落子策略。AlphaGo 就是一个典型的例子,它使用强化学习和深度学习相结合的方法,通过自我对弈来学习围棋策略,最终击败了人类顶尖棋手。

在电子游戏中,强化学习也可以用于训练智能体控制游戏角色的行为。例如,在《星际争霸》等即时战略游戏中,智能体可以学习如何合理地建造建筑、训练部队和进行战斗,以取得游戏的胜利。

6.2 机器人控制

在机器人控制领域,强化学习环境可以帮助机器人学习如何在复杂的环境中完成任务。例如,机器人在未知环境中进行导航,智能体可以根据环境的状态(如障碍物的位置、自身的位置和朝向等)选择合适的行动(如前进、转弯等),通过不断地与环境交互和学习,逐渐找到最优的导航路径。

机器人的抓取任务也是强化学习的一个应用场景。智能体可以学习如何调整机器人手臂的姿态和力度,以准确地抓取不同形状和大小的物体。

6.3 金融领域

在金融领域,强化学习环境可以用于投资决策。智能体可以根据市场的状态(如股票价格、成交量等)选择合适的投资策略(如买入、卖出、持有等),以最大化投资收益。通过与金融市场环境的交互和学习,智能体可以不断优化投资策略,适应市场的变化。

另外,在风险管理方面,强化学习也可以用于制定风险控制策略。智能体可以学习如何根据不同的风险指标和市场情况,调整投资组合的比例,以降低风险。

6.4 自动驾驶

自动驾驶是强化学习环境的一个重要应用场景。智能体需要根据车辆周围的环境状态(如道路状况、其他车辆和行人的位置等)选择合适的驾驶行为(如加速、减速、转弯等)。通过在模拟环境中进行大量的训练,智能体可以学习到安全、高效的驾驶策略。

同时,强化学习还可以用于优化自动驾驶系统的能源消耗。智能体可以学习如何根据路况和车辆状态,合理地控制车辆的动力系统,以降低能源消耗。

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

《强化学习:原理与Python实现》:这本书详细介绍了强化学习的基本原理和算法,并通过Python代码进行了实现和讲解,适合初学者入门。

《Reinforcement Learning: An Introduction》:这是强化学习领域的经典教材,由 Richard S. Sutton 和 Andrew G. Barto 编写,全面系统地介绍了强化学习的理论和方法。

7.1.2 在线课程

Coursera 上的 “Reinforcement Learning Specialization”:由 University of Alberta 提供,包括多门课程,涵盖了强化学习的基础知识和高级应用。

edX 上的 “Introduction to Reinforcement Learning”:由 Massachusetts Institute of Technology 提供,适合对强化学习感兴趣的初学者。

7.1.3 技术博客和网站

OpenAI Blog(https://openai.com/blog/):OpenAI 官方博客,提供了很多关于强化学习和人工智能的最新研究成果和应用案例。

Towards Data Science(https://towardsdatascience.com/):一个数据科学和人工智能领域的技术博客平台,有很多关于强化学习的优质文章。

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

PyCharm:一款专业的 Python 集成开发环境,提供了丰富的代码编辑、调试和项目管理功能,适合开发强化学习项目。

Jupyter Notebook:一个交互式的开发环境,支持 Python 代码的实时运行和可视化展示,非常适合进行强化学习算法的实验和验证。

7.2.2 调试和性能分析工具

TensorBoard:一个 TensorFlow 提供的可视化工具,可以用于监控强化学习训练过程中的各种指标,如奖励曲线、损失函数等,帮助调试和优化模型。

cProfile:Python 内置的性能分析工具,可以用于分析代码的运行时间和函数调用次数,找出性能瓶颈。

7.2.3 相关框架和库

OpenAI Gym:一个用于开发和比较强化学习算法的工具包,提供了丰富的强化学习环境,方便进行算法的测试和验证。

Stable Baselines3:一个基于 PyTorch 的强化学习库,提供了多种预训练的强化学习算法和模型,方便快速搭建和训练强化学习智能体。

7.3 相关论文著作推荐

7.3.1 经典论文

“Q – learning” by Christopher J. C. H. Watkins and Peter Dayan:这是 Q – 学习算法的经典论文,首次提出了 Q – 学习的概念和算法。

“Playing Atari with Deep Reinforcement Learning” by Volodymyr Mnih et al.:这篇论文提出了深度 Q 网络(DQN)算法,将深度学习和强化学习相结合,在 Atari 游戏上取得了很好的效果。

7.3.2 最新研究成果

“Proximal Policy Optimization Algorithms” by John Schulman et al.:提出了近端策略优化(PPO)算法,是一种高效的无模型强化学习算法,在很多任务上取得了很好的效果。

“Soft Actor – Critic: Off – Policy Maximum Entropy Deep Reinforcement Learning with a Stochastic Actor” by Tuomas Haarnoja et al.:提出了软演员 – 评论家(SAC)算法,结合了最大熵原理和深度强化学习,在连续控制任务上表现出色。

7.3.3 应用案例分析

“Mastering the Game of Go without Human Knowledge” by David Silver et al.:介绍了 AlphaGo Zero 的实现原理和方法,展示了强化学习在棋类游戏中的强大应用。

“End – to – End Learning of Driving Models from Large – Scale Video Datasets” by Fisher Yu et al.:探讨了强化学习在自动驾驶领域的应用,通过大规模视频数据集训练自动驾驶模型。

8. 总结:未来发展趋势与挑战

8.1 未来发展趋势

多智能体强化学习:随着实际应用场景的复杂化,多智能体系统的需求越来越大。多智能体强化学习研究多个智能体之间的协作和竞争关系,未来有望在自动驾驶、机器人协作等领域取得更大的突破。

结合深度学习和强化学习:深度学习可以处理复杂的感知任务,强化学习可以进行决策和优化。将两者结合可以构建更强大的智能系统,例如在图像识别和游戏等领域已经取得了很好的效果,未来在更多领域的应用前景广阔。

无模型强化学习的改进:无模型强化学习不需要对环境进行建模,具有更强的通用性。未来将不断改进无模型强化学习算法,提高其学习效率和性能。

强化学习在医疗、教育等领域的应用拓展:强化学习在医疗领域可以用于疾病诊断和治疗方案优化,在教育领域可以用于个性化学习方案的制定。未来将进一步拓展强化学习在这些领域的应用。

8.2 挑战

样本效率问题:强化学习通常需要大量的样本进行训练,样本效率较低。如何提高样本效率,减少训练所需的样本数量,是强化学习面临的一个重要挑战。

环境建模和泛化能力:在实际应用中,环境往往是复杂多变的。如何准确地对环境进行建模,以及提高智能体在不同环境下的泛化能力,是需要解决的问题。

可解释性问题:强化学习模型通常是黑盒模型,其决策过程难以解释。在一些对安全性和可靠性要求较高的领域,如医疗和自动驾驶,模型的可解释性至关重要。

伦理和法律问题:随着强化学习技术的广泛应用,伦理和法律问题也逐渐凸显。例如,在自动驾驶中,如果发生事故,责任如何界定;在金融领域,智能体的决策是否会引发不公平竞争等问题。

9. 附录:常见问题与解答

9.1 强化学习和监督学习有什么区别?

监督学习是基于有标签的数据进行学习,目标是学习输入和输出之间的映射关系。而强化学习是通过智能体与环境的交互来学习,智能体的目标是最大化累积奖励,没有明确的标签数据。

9.2 什么是探索与利用的权衡?

在强化学习中,探索是指智能体尝试新的行动以发现更好的策略,利用是指智能体选择已知的最优行动以获取最大的奖励。探索与利用的权衡是指在学习过程中,智能体需要在探索新行动和利用已有知识之间找到一个平衡,以避免陷入局部最优。

9.3 如何选择合适的折扣因子?

折扣因子 γ gamma γ 的取值范围为 [ 0 , 1 ] [0, 1] [0,1]。当 γ gamma γ 接近 0 时,智能体更关注即时奖励;当 γ gamma γ 接近 1 时,智能体更关注长期奖励。选择合适的折扣因子需要根据具体的应用场景来决定,如果环境的变化较快,即时奖励更重要,可以选择较小的 γ gamma γ;如果环境的变化较慢,长期奖励更重要,可以选择较大的 γ gamma γ。

9.4 强化学习环境一定需要满足马尔可夫性质吗?

虽然马尔可夫决策过程是强化学习中常用的数学模型,但并不是所有的强化学习环境都需要严格满足马尔可夫性质。在一些实际应用中,即使环境不满足马尔可夫性质,也可以通过适当的处理(如增加状态的维度)来近似满足马尔可夫性质,从而使用现有的强化学习算法进行求解。

10. 扩展阅读 & 参考资料

Sutton, Richard S., and Andrew G. Barto. Reinforcement Learning: An Introduction. MIT press, 2018.

Watkins, Christopher JCH, and Peter Dayan. “Q – learning.” Machine learning 8.3 – 4 (1992): 279 – 292.

Mnih, Volodymyr, et al. “Playing Atari with deep reinforcement learning.” arXiv preprint arXiv:1312.5602 (2013).

Schulman, John, et al. “Proximal policy optimization algorithms.” arXiv preprint arXiv:1707.06347 (2017).

Haarnoja, Tuomas, et al. “Soft actor – critic: Off – policy maximum entropy deep reinforcement learning with a stochastic actor.” arXiv preprint arXiv:1801.01290 (2018).

Silver, David, et al. “Mastering the game of Go without human knowledge.” Nature 550.7676 (2017): 354 – 359.

Yu, Fisher, et al. “End – to – end learning of driving models from large – scale video datasets.” arXiv preprint arXiv:1806.07917 (2018).

OpenAI Gym Documentation: https://gym.openai.com/docs/

Stable Baselines3 Documentation: https://stable – baselines3.readthedocs.io/en/master/

暂无评论内容