目录

一、走进 PyTorch 的世界

二、探秘 PyTorch 的优势

2.1 动态计算图:灵活的思维模式

2.2 简洁易用:新手友好的设计

2.3 强大的社区与生态:众人拾柴火焰高

三、PyTorch 核心组件解析

3.1 张量(Tensor):数据的基石

3.2 自动求导(Autograd):梯度计算的神器

3.3 神经网络(nn)模块:搭建智能大厦的积木

3.4 数据处理(Data):有序的数据准备

四、PyTorch 应用场景大放送

4.1 计算机视觉:让机器看懂世界

4.2 自然语言处理:开启人机对话之门

4.3 其他领域:无限的可能

五、开启 PyTorch 学习之旅

一、走进 PyTorch 的世界

在深度学习的领域中,框架就像是魔法师的魔杖,是开发者们施展强大 AI 魔法的关键工具。它极大地简化了深度学习模型的开发过程,让开发者们无需从头搭建复杂的底层架构,就能专注于模型的创新与优化。在众多优秀的深度学习框架中,PyTorch 以其独特的魅力和强大的功能,成为了众多开发者的心头好。

PyTorch 是一个开源的 Python 机器学习库,基于 Torch 库,底层由 C++ 实现 ,应用于人工智能领域,如计算机视觉和自然语言处理。它最初由 Meta Platforms(原 Facebook)的人工智能研究团队开发,现在属于 Linux 基金会的一部分,在修改后的 BSD 许可证下发布,是自由及开放源代码软件 。尽管 Python 接口是开发的主要重点且更加完善,但 PyTorch 也有 C++ 接口,方便不同需求的开发者使用。

二、探秘 PyTorch 的优势

2.1 动态计算图:灵活的思维模式

在深度学习框架的世界里,计算图是描述和模拟神经网络计算过程的一种方法,分为静态计算图和动态计算图 。静态计算图就像是提前规划好的固定路线,在编译时生成,执行前需要经过完整的构图和编译优化过程。一旦确定,其结构和计算过程就固定下来,如同按照既定图纸建造的大楼,难以在建造过程中更改结构。而动态计算图则像是一个灵活的探索者,在运行时动态构建,可以根据每次执行的实际情况进行调整。

PyTorch 采用的动态计算图,为开发者带来了极大的便利。以调试复杂模型为例,在使用静态计算图的框架中,由于计算过程是预先定义好的,很难在运行过程中实时查看中间结果,定位错误就像在黑暗中摸索。而 PyTorch 的动态计算图允许开发者在每一步操作中即时查看中间结果,使用常规的 Python 调试工具(如 pdb 调试器)进行逐行调试,就像在明亮的环境中修理机器,每个零件的状态都一目了然。

在动态调整网络结构方面,动态计算图的优势同样明显。比如在构建循环神经网络(RNN)或其变体长短时记忆网络(LSTM)时,不同时间步的计算可能需要根据当前的输入和状态进行动态调整。使用 PyTorch,开发者可以轻松地在模型中使用条件语句和循环等控制流结构,根据实际情况灵活地改变网络的计算路径,就像一个建筑师可以在建造过程中根据需求随时修改设计图纸。 这种灵活性使得研究人员在试验新的网络架构或动态行为时能够更加高效地进行探索和创新。

2.2 简洁易用:新手友好的设计

PyTorch 的 API 设计简洁直观,对新手极其友好,让深度学习的门槛不再高不可攀。它的设计理念遵循 Python 的编程习惯,使得熟悉 Python 的开发者能够快速上手。在构建神经网络时,只需要继承nn.Module类,在__init__方法中定义网络层,在forward方法中定义前向传播逻辑,就能轻松搭建出一个神经网络模型。

我们来看一个简单的例子,使用 PyTorch 搭建一个用于手写数字识别的多层感知机(MLP)模型:

import torch

import torch.nn as nn

import torch.optim as optim

# 定义模型

class MLP(nn.Module):

def __init__(self):

super(MLP, self).__init__()

self.fc1 = nn.Linear(784, 256) # 输入层到隐藏层

self.relu = nn.ReLU()

self.fc2 = nn.Linear(256, 10) # 隐藏层到输出层

def forward(self, x):

x = x.view(-1, 784) # 将输入数据展平

x = self.fc1(x)

x = self.relu(x)

x = self.fc2(x)

return x

# 初始化模型

model = MLP()

# 定义损失函数和优化器

criterion = nn.CrossEntropyLoss()

optimizer = optim.SGD(model.parameters(), lr=0.01)在这段代码中,我们首先定义了一个MLP类,继承自nn.Module。在__init__方法中,通过nn.Linear定义了两个全连接层,分别用于输入到隐藏层和隐藏层到输出层的转换,并使用nn.ReLU作为激活函数。在forward方法中,定义了数据的前向传播过程,先将输入数据展平,然后依次通过两个全连接层和激活函数,最终输出预测结果。整个过程简洁明了,逻辑清晰,即使是深度学习的初学者也能轻松理解和掌握。

2.3 强大的社区与生态:众人拾柴火焰高

PyTorch 拥有一个庞大且活跃的社区,这是其能够持续发展和不断进步的重要动力。在社区中,开发者们积极交流经验、分享代码和研究成果,形成了一个良好的学习和创新氛围。各种技术论坛上,每天都有大量关于 PyTorch 的讨论,无论是遇到技术难题寻求帮助,还是分享自己的成功经验,都能得到及时的回应和支持。

丰富的教程资源也是 PyTorch 社区的一大亮点。从基础的入门教程到高级的应用案例,从理论知识讲解到实战项目演练,应有尽有。这些教程涵盖了不同的难度级别和应用领域,能够满足不同层次开发者的学习需求。对于想要快速入门 PyTorch 的新手来说,官方文档中的教程和示例代码是最好的学习资料,它们详细地介绍了 PyTorch 的基本概念、使用方法和常见应用场景,帮助新手快速建立起对 PyTorch 的认识和理解。而对于有一定经验的开发者,社区中的开源项目和技术博客则提供了更深入的学习资源,他们可以通过学习优秀的代码实现和技术分享,不断提升自己的技术水平。

除了社区交流和教程资源,PyTorch 还拥有大量的预训练模型和工具包,这些资源极大地加速了深度学习项目的开发进程。在计算机视觉领域,torchvision库提供了众多经典的预训练模型,如 VGG、ResNet、DenseNet 等,以及常用的数据集和图像预处理工具。使用这些预训练模型,开发者可以在短时间内搭建起高效的图像分类、目标检测、图像分割等应用模型,只需对模型进行微调,就能适应不同的任务需求,大大节省了模型训练的时间和计算资源。在自然语言处理领域,transformers库提供了一系列强大的预训练模型,如 BERT、GPT 等,以及丰富的工具和接口,方便开发者进行文本分类、情感分析、机器翻译等任务的开发。这些预训练模型和工具包就像是建筑高楼大厦的预制构件,开发者可以直接使用它们,快速搭建起自己的深度学习应用,而无需从头开始构建复杂的模型结构。

三、PyTorch 核心组件解析

3.1 张量(Tensor):数据的基石

张量(Tensor)是 PyTorch 中最基本的数据结构,就像是建造高楼大厦的基石,是深度学习模型处理数据的基础单元。它本质上是一个多维数组,可以看作是 NumPy 数组的进阶版本,不仅支持在 CPU 上进行高效的数值计算,还能轻松地在 GPU 上运行,利用 GPU 强大的并行计算能力加速计算过程。

从概念上来说,张量和 NumPy 数组有很多相似之处。比如,我们可以像创建 NumPy 数组一样创建张量,并且都可以通过索引和切片来访问和修改其中的元素。下面是一个简单的示例,展示了如何创建一个张量并进行基本操作:

import torch

# 创建一个2x3的张量

tensor_example = torch.tensor([[1.0, 2.0, 3.0], [4.0, 5.0, 6.0]])

print(tensor_example)

# 获取张量的形状

print(tensor_example.shape)

# 张量切片操作

sub_tensor = tensor_example[:, 1:]

print(sub_tensor)在深度学习的实际应用中,张量扮演着不可或缺的角色。以图像数据为例,一张彩色图像通常可以表示为一个三维张量,其形状为 [高度,宽度,通道数] ,其中通道数一般为 3,分别对应红(R)、绿(G)、蓝(B)三个颜色通道。如果我们有一个包含多张图像的数据集,那么这个数据集可以表示为一个四维张量,形状为 [图像数量,高度,宽度,通道数] 。在处理图像分类任务时,模型的输入就是这样的图像张量,模型通过对张量进行一系列的运算和变换,提取图像的特征,从而判断图像所属的类别。

在文本数据处理中,张量同样发挥着重要作用。比如在自然语言处理中,通常会将文本中的每个单词映射为一个固定长度的向量,这个向量就可以看作是一个一维张量。而一个句子由多个单词组成,那么这个句子就可以表示为一个二维张量,形状为 [句子长度,词向量维度] 。通过将文本数据转换为张量,深度学习模型就能够对其进行处理,实现诸如文本分类、情感分析、机器翻译等任务。

3.2 自动求导(Autograd):梯度计算的神器

自动求导(Autograd)是 PyTorch 的核心功能之一,它就像是一位神奇的数学家,能够自动为我们计算复杂函数的导数,在神经网络的训练过程中起着至关重要的作用。在深度学习中,我们需要通过不断调整模型的参数,使得模型的预测结果尽可能接近真实值,这个过程就需要计算损失函数关于模型参数的梯度,然后根据梯度来更新参数。如果没有自动求导机制,手动计算这些梯度将是一项极其繁琐且容易出错的任务,尤其是对于复杂的神经网络模型。

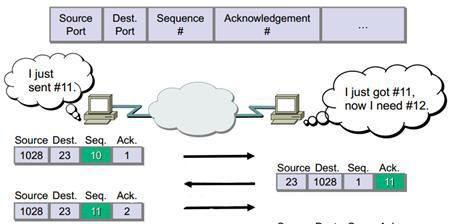

自动求导的原理基于计算图和链式法则。计算图是一种有向无环图,它记录了张量之间的运算关系,每个节点表示一个张量,每条边表示一个运算操作。在正向传播过程中,计算图根据输入张量和运算操作计算出输出张量;在反向传播过程中,计算图根据链式法则自动计算出梯度,从输出张量的梯度开始,逐步反向传播到输入张量,从而得到每个张量的梯度。

下面通过一个简单的数学函数求导的代码示例来展示自动求导的原理:

import torch

# 创建一个需要求导的张量x

x = torch.tensor(3.0, requires_grad=True)

# 定义函数 y = x^2 + 2*x + 1

y = x**2 + 2*x + 1

# 计算y关于x的导数

y.backward()

# 输出x的梯度

print(x.grad)在这段代码中,我们首先创建了一个张量x,并将requires_grad参数设置为True,表示需要对x进行自动求导。然后定义了一个函数y,它是关于x的一个多项式函数。接着调用y.backward()方法,这个方法会自动计算y关于x的导数,并将结果存储在x.grad中。最后输出x.grad,得到y关于x的导数。运行这段代码,输出结果为tensor(8.),与我们手动计算的结果一致。通过这个简单的例子,可以直观地感受到自动求导的强大功能,它让我们无需手动推导复杂的导数公式,就能轻松计算出函数的梯度。

3.3 神经网络(nn)模块:搭建智能大厦的积木

神经网络(nn)模块是 PyTorch 中用于构建神经网络模型的核心组件,它就像是一套丰富的积木,包含了各种类型的层(如全连接层、卷积层、循环层等)、激活函数(如 ReLU、Sigmoid、Tanh 等)以及损失函数(如交叉熵损失函数、均方误差损失函数等),为我们搭建各种复杂的神经网络模型提供了极大的便利。

在构建神经网络模型时,我们通常需要继承nn.Module类,然后在类的构造函数__init__中定义模型的各个层,在forward方法中定义数据的前向传播逻辑。以搭建一个简单的多层感知机(MLP)为例,代码如下:

import torch

import torch.nn as nn

# 定义多层感知机模型

class MLP(nn.Module):

def __init__(self, input_size, hidden_size, output_size):

super(MLP, self).__init__()

self.fc1 = nn.Linear(input_size, hidden_size) # 输入层到隐藏层的全连接层

self.relu = nn.ReLU() # 激活函数

self.fc2 = nn.Linear(hidden_size, output_size) # 隐藏层到输出层的全连接层

def forward(self, x):

x = self.fc1(x)

x = self.relu(x)

x = self.fc2(x)

return x

# 初始化模型

input_size = 784 # 输入特征数量,例如MNIST图像数据的特征数

hidden_size = 128 # 隐藏层神经元数量

output_size = 10 # 输出类别数量,例如MNIST数据集有10个数字类别

model = MLP(input_size, hidden_size, output_size)

# 打印模型结构

print(model)在这段代码中,我们定义了一个MLP类,它继承自nn.Module。在__init__方法中,通过nn.Linear定义了两个全连接层,分别用于输入层到隐藏层和隐藏层到输出层的转换,并使用nn.ReLU作为激活函数,为模型引入非线性。在forward方法中,定义了数据的前向传播过程,输入数据x首先经过第一个全连接层fc1,然后通过激活函数relu进行非线性变换,最后经过第二个全连接层fc2得到输出结果。通过这样的方式,我们就利用nn模块搭建了一个简单的多层感知机模型。这个模型可以用于各种分类和回归任务,只需要根据具体任务的需求调整输入特征数量、隐藏层神经元数量和输出类别数量等参数即可。

3.4 数据处理(Data):有序的数据准备

在深度学习中,数据处理是模型训练的重要前提,就像是烹饪前的食材准备工作,只有将数据进行合理的处理和组织,才能让模型更好地学习和训练。PyTorch 中的数据处理主要依赖于torch.utils.data模块,其中Dataset和DataLoader是两个关键的类,它们分别负责数据的加载和数据的批量处理。

Dataset类是一个抽象类,它定义了数据集的基本接口,我们需要继承这个类并实现__len__和__getitem__方法,来创建自己的数据集类。__len__方法返回数据集的大小,__getitem__方法根据索引返回数据集中的一个样本,包括数据和对应的标签。例如,我们可以创建一个简单的自定义数据集类:

import torch

from torch.utils.data import Dataset

# 自定义数据集类

class CustomDataset(Dataset):

def __init__(self, data, labels):

self.data = data

self.labels = labels

def __len__(self):

return len(self.data)

def __getitem__(self, idx):

return self.data[idx], self.labels[idx]DataLoader类则是用于将Dataset包装成一个可迭代的数据加载器,它可以自动将数据分成多个批次(batch),并支持数据的打乱(shuffle)、多线程加载等功能。使用DataLoader可以大大提高数据加载的效率,尤其是在处理大规模数据集时。下面是一个使用DataLoader加载 MNIST 数据集的代码示例:

import torch

import torchvision

import torchvision.transforms as transforms

# 数据预处理

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.5,), (0.5,))

])

# 加载MNIST训练数据集

train_dataset = torchvision.datasets.MNIST(root='./data', train=True,

download=True, transform=transform)

train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=32,

shuffle=True)

# 遍历数据加载器

for batch_idx, (data, target) in enumerate(train_loader):

print(f"Batch {batch_idx}: data shape = {data.shape}, target shape = {target.shape}")在这段代码中,首先定义了数据预处理的步骤,包括将图像数据转换为张量,并进行归一化处理。然后使用torchvision.datasets.MNIST加载 MNIST 训练数据集,并将其包装成一个DataLoader对象,设置batch_size为 32,表示每个批次包含 32 个样本,shuffle=True表示在每个 epoch 训练时打乱数据顺序。最后通过遍历train_loader,可以按批次获取数据和标签,并进行后续的模型训练操作。通过Dataset和DataLoader的配合使用,我们能够高效地处理和加载各种类型的数据集,为深度学习模型的训练提供有力支持。

四、PyTorch 应用场景大放送

4.1 计算机视觉:让机器看懂世界

在计算机视觉领域,PyTorch 就像是一位技艺高超的视觉大师,大显身手,帮助机器理解和解析图像与视频信息,广泛应用于图像分类、物体检测、图像分割等众多关键任务中。

在图像分类任务里,PyTorch 可以助力模型精准判断图像所属的类别。以经典的 CIFAR-10 数据集为例,该数据集包含 10 个不同类别的 6 万张彩色图像,常用于图像分类算法的评估。我们可以使用 PyTorch 构建一个简单的卷积神经网络(CNN)来对这些图像进行分类,代码如下:

import torch

import torchvision

import torchvision.transforms as transforms

import torch.nn as nn

import torch.optim as optim

# 数据预处理

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.5, 0.5, 0.5), (0.5, 0.5, 0.5))

])

# 加载训练集和测试集

trainset = torchvision.datasets.CIFAR10(root='./data', train=True,

download=True, transform=transform)

trainloader = torch.utils.data.DataLoader(trainset, batch_size=32,

shuffle=True)

testset = torchvision.datasets.CIFAR10(root='./data', train=False,

download=True, transform=transform)

testloader = torch.utils.data.DataLoader(testset, batch_size=32,

shuffle=False)

# 定义卷积神经网络模型

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.conv1 = nn.Conv2d(3, 6, 5)

self.pool = nn.MaxPool2d(2, 2)

self.conv2 = nn.Conv2d(6, 16, 5)

self.fc1 = nn.Linear(16 * 5 * 5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10)

def forward(self, x):

x = self.pool(nn.functional.relu(self.conv1(x)))

x = self.pool(nn.functional.relu(self.conv2(x)))

x = x.view(-1, 16 * 5 * 5)

x = nn.functional.relu(self.fc1(x))

x = nn.functional.relu(self.fc2(x))

x = self.fc3(x)

return x

net = Net()

# 定义损失函数和优化器

criterion = nn.CrossEntropyLoss()

optimizer = optim.SGD(net.parameters(), lr=0.001, momentum=0.9)

# 训练模型

for epoch in range(10): # 这里可以根据实际情况调整训练轮数

running_loss = 0.0

for i, data in enumerate(trainloader, 0):

inputs, labels = data

optimizer.zero_grad()

outputs = net(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

running_loss += loss.item()

if i % 2000 == 1999: # 每2000个mini-batch打印一次损失

print('[%d, %5d] loss: %.3f' %

(epoch + 1, i + 1, running_loss / 2000))

running_loss = 0.0

print('Finished Training')

# 测试模型

correct = 0

total = 0

with torch.no_grad():

for data in testloader:

images, labels = data

outputs = net(images)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print('Accuracy of the network on the 10000 test images: %d %%' % (

100 * correct / total))在这个代码示例中,我们首先对 CIFAR-10 数据集进行了预处理,将图像转换为张量并进行归一化处理。然后定义了一个简单的 CNN 模型,该模型包含两个卷积层、两个池化层和三个全连接层。接着使用交叉熵损失函数和随机梯度下降优化器对模型进行训练。经过多个 epoch 的训练后,模型在测试集上达到了一定的准确率,能够准确地对不同类别的图像进行分类。

在物体检测方面,PyTorch 同样表现出色。以基于 PyTorch 实现的 YOLOv5 目标检测算法为例,它能够快速准确地检测出图像或视频中的多个物体,并标注出它们的位置和类别。在实际应用中,比如在智能安防系统中,通过部署基于 PyTorch 的物体检测模型,可以实时监测监控画面中的人物、车辆等物体,一旦检测到异常行为(如陌生人闯入、车辆违规停放等),立即发出警报,为保障安全提供了有力支持 。在自动驾驶领域,物体检测技术也是至关重要的一环,通过检测道路上的车辆、行人、交通标志等物体,为自动驾驶汽车的决策提供关键信息,确保行驶安全。

4.2 自然语言处理:开启人机对话之门

在自然语言处理的奇妙世界里,PyTorch 是一位精通语言魔法的专家,能够帮助机器理解、生成和处理人类语言,在文本分类、情感分析、机器翻译、文本生成等多个任务中发挥着关键作用,让人机对话成为现实。

在文本分类任务中,PyTorch 可以帮助模型根据文本的内容将其划分到不同的类别中。以常见的新闻分类任务为例,我们可以使用 PyTorch 构建一个基于循环神经网络(RNN)或 Transformer 的文本分类模型。下面是一个使用 PyTorch 实现的基于 LSTM(长短期记忆网络,是 RNN 的一种变体)的文本分类代码示例:

import torch

import torch.nn as nn

import torch.optim as optim

from torchtext.legacy import data, datasets

# 定义文本字段和标签字段

TEXT = data.Field(tokenize='spacy', lower=True)

LABEL = data.LabelField(dtype=torch.float)

# 加载IMDB影评数据集(这里可替换为新闻数据集)

train_data, test_data = datasets.IMDB.splits(TEXT, LABEL)

# 构建词汇表

TEXT.build_vocab(train_data, max_size=25000)

LABEL.build_vocab(train_data)

# 创建数据迭代器

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

train_iterator, test_iterator = data.BucketIterator.splits(

(train_data, test_data),

batch_size=64,

device=device)

# 定义LSTM文本分类模型

class LSTMClassifier(nn.Module):

def __init__(self, vocab_size, embedding_dim, hidden_dim, output_dim):

super(LSTMClassifier, self).__init__()

self.embedding = nn.Embedding(vocab_size, embedding_dim)

self.lstm = nn.LSTM(embedding_dim, hidden_dim)

self.fc = nn.Linear(hidden_dim, output_dim)

def forward(self, text):

embedded = self.embedding(text)

output, (hidden, cell) = self.lstm(embedded)

return self.fc(hidden[-1])

# 初始化模型参数

vocab_size = len(TEXT.vocab)

embedding_dim = 100

hidden_dim = 256

output_dim = 1

model = LSTMClassifier(vocab_size, embedding_dim, hidden_dim, output_dim).to(device)

# 定义损失函数和优化器

criterion = nn.BCEWithLogitsLoss()

optimizer = optim.Adam(model.parameters())

# 训练模型

for epoch in range(10): # 这里可以根据实际情况调整训练轮数

model.train()

for batch in train_iterator:

optimizer.zero_grad()

predictions = model(batch.text).squeeze(1)

loss = criterion(predictions, batch.label)

loss.backward()

optimizer.step()

# 测试模型

model.eval()

correct = 0

total = 0

with torch.no_grad():

for batch in test_iterator:

predictions = model(batch.text).squeeze(1)

predicted = torch.round(torch.sigmoid(predictions))

total += batch.label.size(0)

correct += (predicted == batch.label).sum().item()

print('Accuracy of the model on the test data: %d %%' % (100 * correct / total))在这段代码中,我们首先定义了文本字段和标签字段,用于处理文本数据和标签。然后加载 IMDB 影评数据集(实际应用中可替换为新闻数据集),并构建词汇表。接着创建了数据迭代器,以便按批次加载数据。之后定义了一个基于 LSTM 的文本分类模型,该模型包含一个嵌入层、一个 LSTM 层和一个全连接层。通过嵌入层将文本中的单词转换为向量表示,LSTM 层用于捕捉文本中的上下文信息,全连接层则根据 LSTM 层的输出进行分类预测。使用二元交叉熵损失函数和 Adam 优化器对模型进行训练,经过多个 epoch 的训练后,模型在测试集上能够准确地对文本进行分类。

在机器翻译领域,PyTorch 也有广泛的应用。比如基于 Transformer 架构的神经机器翻译模型,它能够将一种自然语言翻译成另一种自然语言。在实际应用中,像谷歌翻译等在线翻译工具,背后就可能运用了基于 PyTorch 开发的翻译模型,帮助人们跨越语言障碍,实现全球范围内的信息交流。

4.3 其他领域:无限的可能

除了计算机视觉和自然语言处理这两个热门领域,PyTorch 在其他领域也展现出了无限的潜力,为科研人员和开发者提供了广阔的创新空间。

在生成对抗网络(GANs)领域,PyTorch 是实现各种创意的得力助手。生成对抗网络由生成器和判别器组成,两者相互对抗、相互学习。生成器负责生成假的数据样本,判别器则负责判断数据样本是真实的还是生成的。通过这种对抗训练的方式,生成器逐渐学会生成更加逼真的数据。以使用 PyTorch 实现的 DCGAN(深度卷积生成对抗网络)为例,它可以用于生成逼真的图像,如生成二次元头像、人脸图像等。在艺术创作领域,艺术家们可以利用基于 PyTorch 的生成对抗网络生成独特的艺术作品,为艺术创作带来新的灵感和可能性;在图像修复和增强领域,生成对抗网络也能发挥重要作用,比如修复老照片、提高图像分辨率等。

在强化学习领域,PyTorch 同样发挥着重要作用。强化学习是一种通过智能体与环境进行交互,根据环境反馈的奖励信号来学习最优行为策略的机器学习方法。PyTorch 提供了丰富的工具和库,方便研究者和开发者实现各种强化学习算法,如深度 Q 网络(DQN)、策略梯度算法等。在游戏领域,基于 PyTorch 的强化学习算法可以训练智能体在游戏中学习最优策略,从而达到超越人类玩家的水平,如 OpenAI 开发的 Dota 2 AI,就是利用强化学习技术,通过大量的训练和学习,在 Dota 2 游戏中展现出了惊人的实力;在机器人控制领域,强化学习可以帮助机器人学习如何在复杂的环境中完成各种任务,如移动、抓取物体等,提高机器人的自主性和适应性 。

五、开启 PyTorch 学习之旅

PyTorch 以其独特的优势、丰富的核心组件和广泛的应用场景,成为了深度学习领域中一颗璀璨的明星。它不仅为研究人员提供了探索未知的强大工具,也为开发者们搭建了实现创新的广阔平台。无论是在学术研究的前沿,还是在工业应用的实践中,PyTorch 都发挥着不可或缺的作用。

如果你对深度学习充满热情,渴望掌握这一前沿技术,那么 PyTorch 绝对是你的不二之选。它的简洁易用将让你轻松入门,快速上手;它的强大功能将满足你不断探索的需求,助力你在深度学习的道路上不断前行。为了帮助你更好地学习 PyTorch,你可以参考 PyTorch 官方文档,它提供了全面而详细的教程和 API 说明,是学习 PyTorch 的最佳指南;你也可以阅读《深度学习之 PyTorch 实战计算机视觉》《PyTorch 深度学习实践》等书籍,它们将带你深入了解 PyTorch 的原理和应用;在线课程也是不错的选择,如 Coursera 上的 “Deep Learning Specialization”、Udemy 上的 “PyTorch Zero to All” 等课程,都能让你在专业老师的指导下系统地学习 PyTorch。

希望你能在 PyTorch 的学习中不断探索,收获满满,开启属于自己的深度学习之旅!如果你在学习过程中有任何问题或心得,欢迎在评论区留言分享,让我们一起交流进步 。

暂无评论内容