AI原生应用开发:边缘推理 vs 云端推理全面对比

关键词:AI原生应用开发、边缘推理、云端推理、对比、性能、成本

摘要:本文主要探讨了在AI原生应用开发中边缘推理和云端推理这两种重要方式。通过详细对比它们在性能、成本、应用场景等多方面的特点,帮助开发者更好地理解两者的差异,以便在实际开发中做出更合适的选择,同时也对它们未来的发展趋势进行了展望。

背景介绍

目的和范围

在AI原生应用开发的世界里,推理是一个关键的环节。边缘推理和云端推理就像是两条不同的道路,各有其独特之处。我们这篇文章的目的就是要全面对比这两种推理方式,涵盖它们的原理、性能、成本、应用场景等方面,让开发者清楚地了解它们的优缺点,从而在开发AI原生应用时做出更明智的决策。

预期读者

这篇文章主要是为AI原生应用开发者、对AI技术感兴趣的技术人员以及想要了解AI应用开发中推理方式选择的人准备的。无论你是刚入门的新手,还是经验丰富的专家,都能从本文中获得有价值的信息。

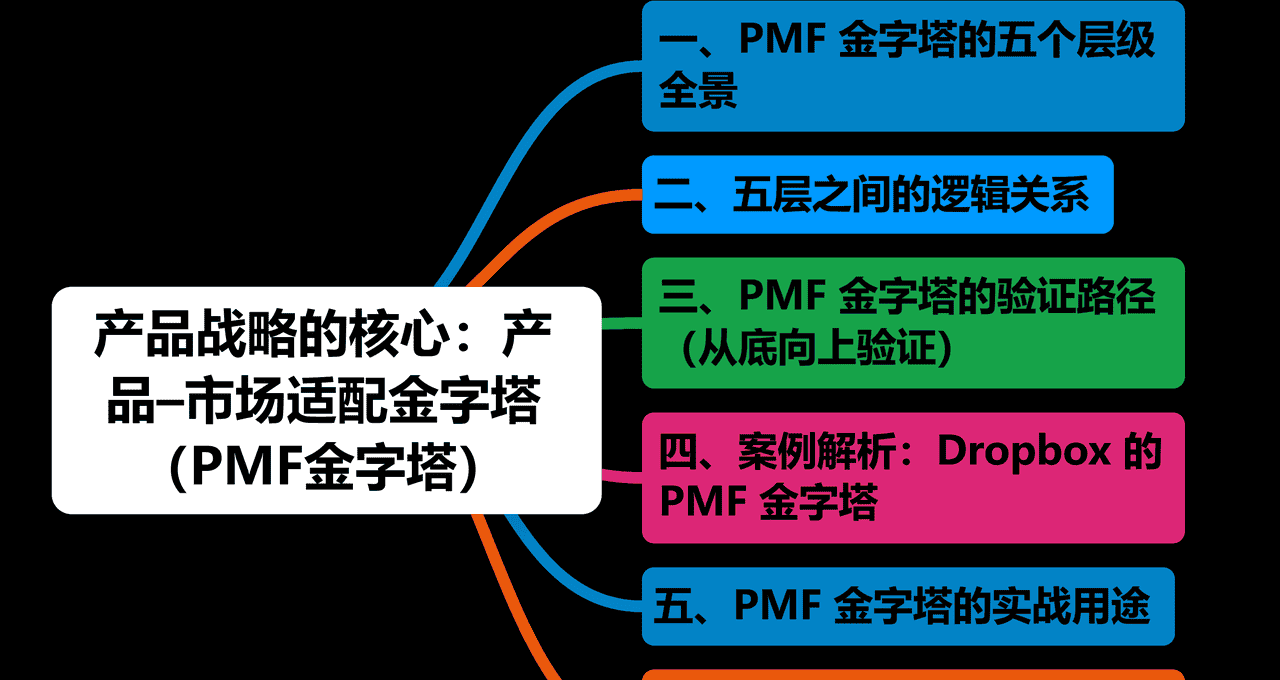

文档结构概述

接下来,我们会先介绍边缘推理和云端推理的核心概念,解释它们是什么以及它们之间的关系。然后深入探讨它们的算法原理和具体操作步骤,通过数学模型和公式来详细说明。再通过实际的项目案例来展示它们在代码中的实现和应用。之后分析它们的实际应用场景,推荐一些相关的工具和资源。最后展望它们的未来发展趋势与挑战,并对全文进行总结,还会提出一些思考题供大家进一步思考。

术语表

核心术语定义

边缘推理:就像是在事情发生的现场直接解决问题。在AI中,就是把推理过程放在靠近数据源头的设备上进行,比如手机、摄像头等。

云端推理:可以想象成把问题送到一个超级大的智慧中心去解决。在AI里,就是把数据上传到云端服务器,由服务器进行推理计算。

相关概念解释

推理:简单来说,就是AI模型根据输入的数据得出结果的过程,就像我们根据题目算出答案一样。

AI原生应用:是专门为AI技术设计和开发的应用程序,充分利用了AI的各种能力。

缩略词列表

AI:Artificial Intelligence,人工智能

CPU:Central Processing Unit,中央处理器

GPU:Graphics Processing Unit,图形处理器

核心概念与联系

故事引入

想象一下,有一个小镇,小镇上的居民经常会遇到一些问题需要解答。有一种方式是,居民们把问题写下来,然后通过快递送到一个很远的大城市里的智慧中心,智慧中心的专家们解答完后再把答案寄回来,这就有点像云端推理。另一种方式是,小镇上自己培养了一些小专家,居民们遇到问题直接问这些小专家,当场就能得到答案,这就类似于边缘推理。

核心概念解释(像给小学生讲故事一样)

** 核心概念一:边缘推理**

边缘推理就像是你自己带着一个小老师在身边。比如说你有一个智能手表,当你运动的时候,手表可以马上根据你运动的数据,计算出你消耗了多少卡路里。这个计算过程就在手表这个设备上完成,不需要把数据传到很远的地方去,就像小老师在你身边马上给你算出结果一样。

** 核心概念二:云端推理**

云端推理就像是你遇到问题要去问远方的大专家。比如你用手机拍了一张照片,想知道照片里是什么花。你把照片上传到一个云端的服务器,服务器上有很强大的计算能力和很多的知识,它可以分析照片,然后告诉你这是什么花。就像你把问题寄给远方的大专家,大专家帮你解答一样。

** 核心概念三:AI原生应用开发**

AI原生应用开发就像是建造一个超级智能的房子。开发者要用各种AI技术作为材料,比如边缘推理和云端推理,来建造出功能强大、能智能处理各种事情的应用程序,就像用不同的材料建造出舒适、实用的房子一样。

核心概念之间的关系(用小学生能理解的比喻)

** 概念一和概念二的关系**:边缘推理和云端推理就像两个好朋友,它们可以一起合作。就像小镇上的小专家和大城市的大专家,如果小镇上的小专家遇到解决不了的问题,就可以把问题送到大城市的大专家那里去。在AI原生应用里,如果边缘设备计算能力不够,就可以把数据传到云端进行推理。

** 概念二和概念三的关系**:云端推理是AI原生应用开发这个超级智能房子的一个重要支柱。很多AI原生应用需要强大的计算能力来处理复杂的问题,云端推理就提供了这样的能力。就像房子需要坚固的柱子来支撑一样,云端推理支撑着AI原生应用处理大量数据和复杂任务。

** 概念一和概念三的关系**:边缘推理是AI原生应用开发这个超级智能房子的灵活小助手。它可以让应用在本地快速做出反应,不需要依赖网络。就像房子里有一些小工具,可以随时拿起来用,很方便。在AI原生应用中,边缘推理可以让应用在没有网络或者网络不好的情况下也能正常工作。

核心概念原理和架构的文本示意图(专业定义)

边缘推理的原理是在靠近数据源的设备上部署AI模型,设备收集数据后,直接使用本地的计算资源进行推理。其架构包括数据源设备(如传感器、摄像头等)、本地计算单元(如CPU、GPU等)和AI模型。

云端推理的原理是将数据从数据源设备上传到云端服务器,服务器上有强大的计算资源和存储资源,服务器运行AI模型进行推理,然后将结果返回给数据源设备。其架构包括数据源设备、网络连接、云端服务器和AI模型。

Mermaid 流程图

核心算法原理 & 具体操作步骤

边缘推理算法原理及操作步骤(以Python为例)

边缘推理通常使用轻量级的AI模型,比如TensorFlow Lite模型。以下是一个简单的边缘推理示例,假设我们要在树莓派上对图像进行分类。

import tflite_runtime.interpreter as tflite

import numpy as np

from PIL import Image

# 加载模型

interpreter = tflite.Interpreter(model_path='model.tflite')

interpreter.allocate_tensors()

# 获取输入和输出张量的信息

input_details = interpreter.get_input_details()

output_details = interpreter.get_output_details()

# 加载图像并进行预处理

image = Image.open('test_image.jpg').resize((input_details[0]['shape'][1], input_details[0]['shape'][2]))

image = np.expand_dims(image, axis=0)

image = (np.float32(image) - 127.5) / 127.5

# 设置输入张量

interpreter.set_tensor(input_details[0]['index'], image)

# 进行推理

interpreter.invoke()

# 获取输出结果

output_data = interpreter.get_tensor(output_details[0]['index'])

predicted_class = np.argmax(output_data)

print(f"Predicted class: {

predicted_class}")

云端推理算法原理及操作步骤(以Python和Flask为例)

云端推理通常使用强大的服务器和深度学习框架,如PyTorch。以下是一个简单的云端推理示例,使用Flask搭建一个简单的API服务器。

from flask import Flask, request, jsonify

import torch

import torchvision.models as models

import torchvision.transforms as transforms

from PIL import Image

app = Flask(__name__)

# 加载预训练的模型

model = models.resnet18(pretrained=True)

model.eval()

# 定义图像预处理函数

transform = transforms.Compose([

transforms.Resize(256),

transforms.CenterCrop(224),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

@app.route('/predict', methods=['POST'])

def predict():

# 获取上传的图像

file = request.files['image']

image = Image.open(file.stream)

# 预处理图像

image = transform(image).unsqueeze(0)

# 进行推理

with torch.no_grad():

output = model(image)

# 获取预测结果

_, predicted = torch.max(output.data, 1)

result = predicted.item()

return jsonify({

'predicted_class': result})

if __name__ == '__main__':

app.run(debug=True)

数学模型和公式 & 详细讲解 & 举例说明

边缘推理数学模型

边缘推理中常用的模型评估指标有准确率(Accuracy)、召回率(Recall)等。

准确率的计算公式为:

A c c u r a c y = T P + T N T P + T N + F P + F N Accuracy = frac{TP + TN}{TP + TN + FP + FN} Accuracy=TP+TN+FP+FNTP+TN

其中, T P TP TP 表示真正例, T N TN TN 表示真反例, F P FP FP 表示假正例, F N FN FN 表示假反例。

例如,在一个图像分类任务中,我们有100张图像,其中50张是猫的图像,50张是狗的图像。边缘推理模型正确分类了40张猫的图像和45张狗的图像,那么:

T P = 40 TP = 40 TP=40, T N = 45 TN = 45 TN=45, F P = 5 FP = 5 FP=5, F N = 10 FN = 10 FN=10

A c c u r a c y = 40 + 45 40 + 45 + 5 + 10 = 85 100 = 0.85 Accuracy = frac{40 + 45}{40 + 45 + 5 + 10} = frac{85}{100} = 0.85 Accuracy=40+45+5+1040+45=10085=0.85

云端推理数学模型

云端推理通常涉及到大规模的数据处理和复杂的模型训练,常用的损失函数有交叉熵损失(Cross Entropy Loss)。

对于二分类问题,交叉熵损失的计算公式为:

L = − 1 N ∑ i = 1 N [ y i log ( p i ) + ( 1 − y i ) log ( 1 − p i ) ] L = – frac{1}{N} sum_{i=1}^{N} [y_i log(p_i) + (1 – y_i) log(1 – p_i)] L=−N1i=1∑N[yilog(pi)+(1−yi)log(1−pi)]

其中, N N N 是样本数量, y i y_i yi 是真实标签(0或1), p i p_i pi 是模型预测的概率。

例如,我们有3个样本,真实标签分别为 [ 1 , 0 , 1 ] [1, 0, 1] [1,0,1],模型预测的概率分别为 [ 0.8 , 0.2 , 0.6 ] [0.8, 0.2, 0.6] [0.8,0.2,0.6],则:

L = − 1 3 [ ( 1 × log ( 0.8 ) + ( 1 − 1 ) × log ( 1 − 0.8 ) ) + ( 0 × log ( 0.2 ) + ( 1 − 0 ) × log ( 1 − 0.2 ) ) + ( 1 × log ( 0.6 ) + ( 1 − 1 ) × log ( 1 − 0.6 ) ) ] L = – frac{1}{3} [(1 imes log(0.8) + (1 – 1) imes log(1 – 0.8)) + (0 imes log(0.2) + (1 – 0) imes log(1 – 0.2)) + (1 imes log(0.6) + (1 – 1) imes log(1 – 0.6))] L=−31[(1×log(0.8)+(1−1)×log(1−0.8))+(0×log(0.2)+(1−0)×log(1−0.2))+(1×log(0.6)+(1−1)×log(1−0.6))]

项目实战:代码实际案例和详细解释说明

开发环境搭建

边缘推理开发环境搭建

硬件:树莓派、摄像头

软件:Raspbian系统、Python 3、TensorFlow Lite

安装步骤:

下载并安装Raspbian系统到树莓派。

安装Python 3:sudo apt-get install python3

安装TensorFlow Lite:pip3 install tflite-runtime

云端推理开发环境搭建

硬件:云服务器(如阿里云ECS)

软件:Ubuntu系统、Python 3、Flask、PyTorch

安装步骤:

创建云服务器实例并安装Ubuntu系统。

安装Python 3:sudo apt-get install python3

安装Flask:pip3 install flask

安装PyTorch:pip3 install torch torchvision

源代码详细实现和代码解读

边缘推理代码解读

import tflite_runtime.interpreter as tflite

import numpy as np

from PIL import Image

# 加载模型

interpreter = tflite.Interpreter(model_path='model.tflite')

interpreter.allocate_tensors()

# 获取输入和输出张量的信息

input_details = interpreter.get_input_details()

output_details = interpreter.get_output_details()

# 加载图像并进行预处理

image = Image.open('test_image.jpg').resize((input_details[0]['shape'][1], input_details[0]['shape'][2]))

image = np.expand_dims(image, axis=0)

image = (np.float32(image) - 127.5) / 127.5

# 设置输入张量

interpreter.set_tensor(input_details[0]['index'], image)

# 进行推理

interpreter.invoke()

# 获取输出结果

output_data = interpreter.get_tensor(output_details[0]['index'])

predicted_class = np.argmax(output_data)

print(f"Predicted class: {

predicted_class}")

代码解释:

导入必要的库,包括TensorFlow Lite解释器、NumPy和Pillow库。

加载TensorFlow Lite模型并分配张量。

获取输入和输出张量的信息,用于后续的图像预处理和结果获取。

加载图像并进行预处理,包括调整大小、扩展维度和归一化。

设置输入张量并进行推理。

获取输出结果并找出预测的类别。

云端推理代码解读

from flask import Flask, request, jsonify

import torch

import torchvision.models as models

import torchvision.transforms as transforms

from PIL import Image

app = Flask(__name__)

# 加载预训练的模型

model = models.resnet18(pretrained=True)

model.eval()

# 定义图像预处理函数

transform = transforms.Compose([

transforms.Resize(256),

transforms.CenterCrop(224),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

@app.route('/predict', methods=['POST'])

def predict():

# 获取上传的图像

file = request.files['image']

image = Image.open(file.stream)

# 预处理图像

image = transform(image).unsqueeze(0)

# 进行推理

with torch.no_grad():

output = model(image)

# 获取预测结果

_, predicted = torch.max(output.data, 1)

result = predicted.item()

return jsonify({

'predicted_class': result})

if __name__ == '__main__':

app.run(debug=True)

代码解释:

导入必要的库,包括Flask、PyTorch和Torchvision库。

创建Flask应用实例。

加载预训练的ResNet18模型并设置为评估模式。

定义图像预处理函数,包括调整大小、裁剪、转换为张量和归一化。

定义一个路由 /predict,用于接收POST请求并进行图像分类。

在路由函数中,获取上传的图像,进行预处理,然后进行推理。

获取预测结果并以JSON格式返回。

代码解读与分析

边缘推理代码分析

优点:代码简单,不需要网络连接,推理速度快,适合实时性要求高的场景。

缺点:计算资源有限,只能使用轻量级模型,模型精度可能较低。

云端推理代码分析

优点:可以使用强大的服务器资源,处理复杂的模型和大规模的数据,模型精度高。

缺点:需要网络连接,推理延迟较高,不适合实时性要求高的场景。

实际应用场景

边缘推理应用场景

智能家居:智能门锁、智能摄像头等设备可以在本地进行人脸识别、动作检测等推理,不需要将数据上传到云端,保证了隐私和实时性。

工业自动化:工业机器人可以在本地进行视觉检测、故障诊断等推理,提高生产效率和稳定性。

云端推理应用场景

图像和视频处理:如在线图像识别、视频内容审核等,需要处理大量的图像和视频数据,云端的强大计算能力可以满足需求。

智能客服:可以使用大规模的语言模型进行自然语言处理和对话生成,提供更智能的服务。

工具和资源推荐

边缘推理工具和资源

TensorFlow Lite:一个轻量级的深度学习框架,适合在边缘设备上运行。

OpenCV:一个开源的计算机视觉库,可用于图像和视频处理。

Edge Impulse:一个边缘AI开发平台,提供模型训练、部署等一站式服务。

云端推理工具和资源

Amazon SageMaker:亚马逊提供的云端机器学习平台,可用于模型训练和推理。

Google Cloud AI Platform:谷歌提供的云端AI平台,支持多种深度学习框架。

Microsoft Azure Machine Learning:微软提供的云端机器学习服务,提供丰富的工具和资源。

未来发展趋势与挑战

边缘推理未来发展趋势与挑战

趋势:随着边缘设备性能的不断提升,边缘推理将越来越普及,应用场景也会越来越广泛。同时,边缘推理与物联网、5G等技术的结合将创造更多的机会。

挑战:边缘设备的计算资源和存储资源有限,如何优化模型以提高效率是一个挑战。另外,边缘设备的安全和隐私问题也需要重视。

云端推理未来发展趋势与挑战

趋势:云端推理将继续向大规模、高性能方向发展,支持更复杂的模型和更多的数据。同时,云端推理与边缘推理的协同将成为未来的发展方向。

挑战:云端推理的成本较高,如何降低成本是一个挑战。另外,云端服务器的能耗和碳排放问题也需要解决。

总结:学到了什么?

核心概念回顾

我们学习了边缘推理、云端推理和AI原生应用开发这三个核心概念。边缘推理是在靠近数据源的设备上进行推理,就像身边的小老师;云端推理是把数据上传到云端服务器进行推理,就像远方的大专家;AI原生应用开发是利用各种AI技术建造超级智能的房子。

概念关系回顾

我们了解了边缘推理和云端推理可以相互合作,就像小镇上的小专家和大城市的大专家。云端推理是AI原生应用开发的重要支柱,边缘推理是AI原生应用开发的灵活小助手。

思考题:动动小脑筋

思考题一:你能想到生活中还有哪些地方可以应用边缘推理吗?

思考题二:如果要开发一个实时性要求很高的AI原生应用,你会选择边缘推理还是云端推理,为什么?

附录:常见问题与解答

问题一:边缘推理和云端推理哪个更安全?

答:边缘推理在本地设备上进行,数据不需要上传到云端,相对来说更安全,能更好地保护隐私。但边缘设备也可能存在被攻击的风险,需要做好安全防护。云端推理的数据在传输和存储过程中也需要采取安全措施,如加密等。

问题二:边缘推理和云端推理的成本哪个更高?

答:一般来说,云端推理的成本更高。云端推理需要使用云端服务器,会产生服务器租赁费用、数据传输费用等。边缘推理主要是设备的购买和维护成本,但随着设备性能的提升,成本也可能会增加。

扩展阅读 & 参考资料

《深度学习》(花书)

TensorFlow官方文档

PyTorch官方文档

相关的学术论文和技术博客文章

暂无评论内容