1、内存是什么?

一、内存是什么?

内存(Memory) 是计算机系统中用于临时存储数据和程序的高速存储设备,属于计算机的 “主存储器”(主存)。它的作用是让 CPU 快速访问正在运行的程序和数据,是计算机高效运行的关键组件。

特点:速度快(相比硬盘等外存)、断电后数据丢失(易失性)、容量相对较小。

分类:

随机存取存储器(RAM):如 DDR、LPDDR 等,用于日常数据存储,可读可写。

只读存储器(ROM):如 BIOS 芯片,数据固化,一般不可修改。

二、内存的发展历程

内存的发展围绕 容量提升、速度加快、功耗降低、接口优化 展开,以下是关键阶段:

1. 早期阶段(1950-1970 年代)

磁芯存储器:通过磁性环(磁芯)存储二进制数据,速度慢、体积大,是早期计算机的主要内存。

半导体存储器萌芽:1968 年,Intel 推出首款 DRAM 芯片(1103),基于 MOS 技术,取代磁芯存储器,奠定现代内存基础。

2. DRAM 时代(1980-2000 年代)

FPM DRAM(快速页模式):1980 年代主流,通过分页技术提升访问速度,但带宽有限。

EDO DRAM(扩展数据输出):1990 年代中期使用,减少数据访问延迟,速度提升约 15-30%。

SDRAM(同步动态随机存取存储器):1996 年推出,与 CPU 时钟同步,带宽显著提升(如 PC100/133 标准)。

3. DDR 系列迭代(2000 年代至今)

DDR(Double Data Rate SDRAM):

DDR1(2000 年):双倍速率传输,带宽达 2.1GB/s(如 PC2100)。

DDR2(2003 年):电压降低至 1.8V,预取位数提升至 4bit,带宽最高 12.8GB/s(PC2-12800)。

DDR3(2007 年):电压 1.5V,频率更高(如 1600MHz),带宽达 25.6GB/s(PC3-21300)。

DDR4(2014 年):电压 1.2V,单条容量突破 32GB,带宽最高 51.2GB/s(PC4-3200)。

DDR5(2020 年):电压 1.1V,引入独立电源管理,单条容量可达 128GB,带宽最高 128GB/s(如 6400MT/s)。

4. 其他类型内存

SRAM(静态随机存取存储器):速度极快(纳秒级),用于 CPU 缓存(L1/L2/L3),成本高、容量小。

LPDDR(低功耗 DDR):专为移动设备设计,功耗更低(如 LPDDR5X 用于手机、平板)。

HBM(高带宽内存):堆叠式结构,带宽极高(如 HBM3 达 TB 级),用于 GPU 和高性能计算。

三、内存的核心技术

1. 双倍速率传输(Double Data Rate, DDR)

利用时钟信号的上升沿和下降沿同时传输数据,使实际带宽翻倍。例如,DDR4-3200 的时钟频率为 1600MHz,但传输速率达 3200MT/s(兆传输 / 秒)。

2. 预取技术(Prefetch)

在 DRAM 内部预先读取多个数据位(如 DDR 预取 2bit,DDR2/3/4 预取 4bit),减少 CPU 等待时间。

3. 多 Bank 架构

将内存划分为多个独立 Bank(如 8 个 Bank),允许同时访问不同 Bank 的数据,提升并行性。

4. 电源管理与低功耗设计

ODT(On-Die Termination):片内终端电阻,减少信号反射,提升稳定性。

PASR(Partial Array Self-Refresh):仅刷新部分内存区域,降低待机功耗(DDR4/DDR5 支持)。

Sub-NVT 技术:DDR5 引入,通过独立电压调节模块(PMIC)优化电压,进一步降低功耗。

5. 可靠性技术

ECC(错误校验与纠正):检测并纠正单比特错误,用于服务器和工作站。

RAS(行地址选通)/CAS(列地址选通)控制:精确管理数据读写时序,减少错误。

四、内存的工作原理

内存基于 半导体存储单元 工作,核心流程如下:

1. 存储单元结构

每个存储单元由 晶体管 和 电容 组成(DRAM):

电容存储电荷(0 或 1),晶体管控制读写。

由于电容会漏电,需定期刷新(Refresh)保持数据(约 64ms 刷新一次)。

2. 读写流程

CPU 发送地址信号:通过内存控制器(通常集成在 CPU 中)指定目标存储单元的 行地址(RAS) 和 列地址(CAS)。

行激活(Row Activate):选中对应行,将数据从存储阵列传输至 行缓冲器(Row Buffer)。

列读取 / 写入(Column Read/Write):从行缓冲器中提取或写入指定列的数据,通过 数据总线 传输至 CPU 或内存控制器。

预充电(Precharge):操作完成后,关闭当前行,为下一次操作做准备。

3. 刷新机制

由于电容漏电,需定期刷新所有存储单元。DDR 通过 自动刷新(Auto-Refresh) 和 自刷新(Self-Refresh) 实现:

自动刷新:正常工作时周期性刷新。

自刷新:进入低功耗模式时,仅刷新内存而不响应外部命令。

总结

内存是计算机的 “数据中转站”,其发展始终围绕性能与功耗的平衡。从早期磁芯到现代 DDR5/HBM,技术革新不断突破速度与容量的极限,而核心原理(如电容存储、时序控制)仍是理解内存工作的基础。未来,3D 堆叠内存(如 3D XPoint、MRAM 等新型存储器)可能进一步改变内存格局。

2、详细介绍内存的读写速度及影响因素

内存的读写速度是衡量计算机性能的核心指标之一,其快慢直接影响系统响应速度和数据处理效率。以下从 速度指标定义、影响因素、提升技术 三方面详细解析:

一、内存读写速度的衡量指标

内存速度通常用以下参数描述:

1. 频率(Frequency)

定义:内存工作的时钟频率,单位为 MHz 或 GHz,反映每秒振荡次数。

例:DDR4-3200 的时钟频率为 1600MHz(DDR 双倍速率,实际传输速率为 3200MT/s)。

关系:频率越高,理论上数据传输周期越短(周期 = 1 / 频率)。

例:2000MHz 频率的周期为 0.5ns,1000MHz 则为 1ns。

2. 传输速率(Transfer Rate)

定义:每秒传输的数据量,单位为 MT/s(兆传输 / 秒) 或 GB/s(千兆字节 / 秒)。

DDR 系列公式:传输速率(MT/s)= 频率(MHz)× 2(双倍速率)。

例:DDR5-6400 的传输速率为 6400MT/s(频率 3200MHz)。

带宽(Bandwidth):每秒实际传输的字节数,公式为:带宽(GB/s)=8×1000传输速率(MT/s)×位宽(bit)

例:DDR4-3200(64bit 位宽)的带宽为:8×10003200×64=25.6 GB/s

3. 延迟(Latency)

定义:从发出指令到数据开始传输的时间差,单位为 纳秒(ns)。

常见参数:以 CAS Latency(CL)为例,如 CL16 表示列地址选通延迟为 16 个时钟周期。

计算方式:延迟(ns)=频率(MHz)CL值×1000

例:DDR4-3200(CL16)的延迟为:320016×1000=5 ns

二、影响内存读写速度的核心因素

内存速度由 硬件设计、时序控制、外部环境 共同决定,具体影响因素如下:

1. 内存类型与代际(最关键因素)

不同类型内存的速度差异:

| 类型 | 典型频率范围 | 带宽范围 | 延迟范围 |

|---|---|---|---|

| DDR4 | 1600-3200MHz | 12.8-25.6GB/s | 6-15ns |

| DDR5 | 4800-8000MHz | 38.4-64GB/s | 8-12ns |

| LPDDR5 | 2133-8533MT/s | 17-68GB/s | 更低(移动优化) |

| HBM3 | 3.2-5.3Gbps | 1.5-5TB/s | 极低(堆叠架构) |

代际升级的技术突破:

DDR5 相比 DDR4:频率上限提升 50%+,引入独立电源管理芯片(PMIC),减少信号干扰。

HBM 通过 3D 堆叠(如 8 层芯片堆叠),位宽可达 1024bit 以上,带宽远超传统 DDR。

2. 时序参数(Timing Parameters)

内存时序通过一组数字(如 CL-TRCD-TRP-TRAS)控制读写节奏,核心参数包括:

CAS Latency(CL):列地址选通延迟,影响读取延迟。

RAS-to-CAS Delay(TRCD):行激活到列读取的间隔。

Row Precharge Time(TRP):行预充电时间,影响 Bank 切换速度。

Row Active Time(TRAS):行激活持续时间,需大于 CL+TRCD。

影响示例:

同一频率下,CL14 的内存比 CL16 延迟更低(如 DDR4-3200 CL14 延迟为 4.375ns,CL16 为 5ns)。

时序过紧可能导致数据读写错误,需与频率匹配优化。

3. 位宽与通道数(Bandwidth Key)

位宽:内存一次能传输的数据位数,由内存颗粒的并行性决定。

单通道 DDR4 位宽为 64bit,四通道则为 256bit,带宽直接提升 4 倍。

通道数:多通道技术(如双通道、四通道)通过并行传输提升总带宽。

例:双通道 DDR4-3200(64bit×2)的总带宽为 25.6GB/s×2=51.2GB/s。

4. 控制器与主板支持

内存控制器:集成在 CPU 中,决定支持的内存类型、频率及通道数。

例:Intel 第 12 代 CPU 支持 DDR5-4800,而 AMD Ryzen 5000 系列仅支持 DDR4-3200(需超频)。

主板供电与布线:

高端主板通过独立供电模块(如 DDR5 的 PMIC)和优化布线减少信号衰减,支持更高频率(如 DDR5-7200+)。

劣质主板可能因供电不足或 EMI 干扰导致高频内存不稳定。

5. 物理容量与颗粒密度

单条容量:大容量内存(如单条 32GB)需更多存储颗粒,可能增加信号传输距离,导致延迟略微上升。

颗粒密度:高密度颗粒(如 16Gb 颗粒)可在相同体积下提升容量,但工艺难度高,高频下稳定性挑战大。

6. 温度与功耗

温度影响:高温会加剧电容漏电,迫使内存降低频率或增加刷新频率,导致速度下降。

功耗控制:低电压设计(如 DDR5-1.1V)可减少发热,允许更高频率长时间运行。

三、提升内存读写速度的技术手段

1. 硬件层面

工艺升级:从 28nm 到 14nm 再到 7nm,半导体工艺缩小使晶体管密度增加,频率上限提升(如 DDR5 颗粒采用 10nm 级工艺)。

3D 堆叠技术:

HBM 通过 TSV(硅通孔)堆叠多层 DRAM 芯片,缩短信号路径,提升带宽(如 HBM3 堆叠 8 层,带宽达 5.3TB/s)。

3D XPoint(Intel Optane)采用 3D 交叉阵列,速度比 DRAM 快 1000 倍,但成本高,多用于缓存。

2. 时序与超频优化

手动超频:通过 BIOS 提高内存频率(如将 DDR4-3200 超至 3600MHz),并适当放宽时序(如 CL18→CL16)以平衡稳定性。

XMP/EXPO 技术:厂商预设的超频配置文件,一键提升频率和优化时序(如 DDR4-3600 XMP 预设 CL18-22-22-42)。

3. 多通道与弹性内存

非对称双通道:允许不同容量内存组成双通道(如 8GB+16GB),提升带宽的同时兼容旧硬件。

弹性内存技术:动态分配内存通道,减少大容量单条内存的带宽浪费(如部分主板支持单条内存开启双通道)。

4. 新型存储器探索

MRAM(磁阻随机存储器):基于磁阻效应,速度接近 SRAM,非易失性(断电不丢数据),未来可能替代部分 DRAM 场景。

ReRAM(阻变存储器):通过电阻变化存储数据,速度比 NAND 快 1000 倍,适合低延迟场景。

四、实际场景中的速度表现

1. 不同应用对内存速度的敏感度

高敏感场景:

游戏:低延迟(CL 值)比高频率更重要,如 DDR4-3600 CL14 的帧率可能高于 DDR4-4000 CL18。

视频编辑 / 3D 渲染:带宽(通道数)更关键,四通道内存可显著提升多线程数据处理速度。

低敏感场景:

日常办公:DDR4-2666 与 DDR4-3200 的差异难以感知,容量(如 16GB→32GB)影响更大。

2. 测试工具与典型数据

常用测试软件:

AIDA64:测量内存读取 / 写入 / 复制速度及延迟。

MemTest86:检测内存稳定性,高频率超频后需长时间测试。

典型平台数据:

| 配置 | 读取速度(GB/s) | 写入速度(GB/s) | 延迟(ns) |

|---|---|---|---|

| DDR4-3200 CL16 单通道 | 25.6 | 25.3 | 5.0 |

| DDR4-3600 CL18 双通道 | 57.2 | 56.8 | 4.8 |

| DDR5-6000 CL36 单通道 | 48.0 | 47.5 | 6.0 |

总结

内存读写速度是 频率、时序、位宽、通道数、硬件兼容性 共同作用的结果。对于普通用户,优先选择新一代内存(如 DDR5)和主板支持的最高频率;对于发烧友,可通过超频和时序优化进一步挖掘性能,但需平衡稳定性与散热。未来,随着 3D 堆叠和新型存储技术的成熟,内存速度将突破现有瓶颈,为 AI、云计算等场景提供更强的数据吞吐能力。

3、如何查看电脑内存的读写速度?

查看电脑内存读写速度可以使用操作系统自带工具、第三方软件或 BIOS 设置,具体方法如下:

使用任务管理器(Windows 系统):右键单击桌面任务栏,选择 “任务管理器”,或按键盘上的 “Ctrl+Shift+Esc” 键打开。在任务管理器中,转到 “性能” 选项卡,点击左侧边栏中的 “内存”,在右侧窗口可看到内存相关信息,部分系统会直接显示 “读取速度” 和 “写入速度” 参数。

使用命令提示符(Windows 系统)6:按下 “Win+R” 组合键,输入 “cmd” 后按回车键打开命令提示符,输入命令 “wmic memorychip get speed”,回车后窗口会显示内存的频率,可间接了解内存速度,一般频率越高,读写速度越快。

使用 “关于本机”(macOS 系统)6:点击屏幕左上角的苹果图标,选择 “关于本机”,然后点击 “系统报告”,在系统信息中找到 “内存” 部分,可查看到内存条的详细参数,包含频率信息,从而间接了解内存读写速度。

使用 CPU-Z:从 CPU-Z 官方网站下载并安装该软件,打开后切换到 “Memory” 选项卡,可查看内存的频率、类型等信息,还可通过 SPD 选项页,读取更详细的内存性能规格信息,包括带宽、速率等。

使用 AIDA643:这是一款功能强大的系统诊断工具,安装后打开,其自带的 Memory Latency 评测,可以通过对内存延时的评测,直观显示出内存子系统的效能,能查看内存的读写、拷贝速度以及延迟时间等详细信息。

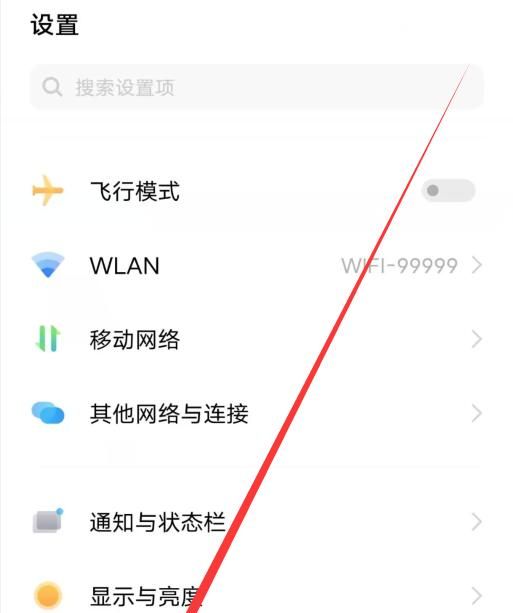

查看 BIOS 或 UEFI 设置:重新启动计算机,在启动时按特定键(通常是 F2、F10 或 Del 等,具体按键可查看主板说明书)进入 BIOS 或 UEFI 设置。然后导航至显示硬件信息或系统配置的菜单,查找与 “内存”“OC”“XMP” 或 “RAM” 相关的条目,内存频率会以兆赫兹(MHz)为单位列出,可据此间接了解内存读写速度。

4、内存读写速度对游戏性能有多大影响?

内存读写速度是影响游戏性能的重要因素之一,其对游戏的影响程度取决于游戏类型、引擎优化、硬件配置(如 CPU、显卡)以及内存本身的规格(频率、时序、容量等)。以下是详细分析:

一、内存读写速度如何影响游戏性能?

1. 游戏加载速度

直接影响:内存读写速度越快,CPU 从内存中调取游戏数据(如地图、模型、纹理、代码指令)的效率越高,游戏加载时间越短。

典型场景:开放世界游戏(如《荒野大镖客 2》《艾尔登法环》)需要频繁读取大量地图数据,高读写速度内存可显著减少加载等待时间。

对比案例:DDR4-3200(读取速度约 42GB/s) vs. DDR4-2400(读取速度约 31GB/s),后者加载大型游戏可能慢 10%-20%。

2. 帧率稳定性(FPS)

关键逻辑:游戏运行时,CPU 需实时将指令和数据传输给显卡(GPU)渲染画面。若内存读写速度不足,会导致 CPU 或 GPU “卡顿”(等待数据),造成帧率波动(FPS 忽高忽低)。

影响程度:

低分辨率 / 轻量级游戏(如《CS:GO》《英雄联盟》):CPU 性能占主导,内存速度不足可能导致帧率上限降低(如从 300FPS 降至 250FPS)。

高分辨率 / 3A 大作(如《赛博朋克 2077》4K 画质):GPU 负载更高,内存速度对帧率影响相对减小,但仍可能因数据传输延迟导致帧率波动(如从 60FPS 稳定输出变为 55-60FPS 波动)。

3. 多任务与后台处理

内存带宽不足的瓶颈:若游戏后台运行直播软件、杀毒软件等,内存需同时处理游戏数据和后台程序,低读写速度可能导致游戏帧率骤降(如从稳定 100FPS 降至 70FPS)。

解决方案:高读写速度内存(如 DDR5-6000)能更好地应对多任务场景,减少性能损失。

4. 游戏画质与细节表现

纹理流送技术:部分游戏(如《微软模拟飞行》)采用 “虚拟纹理” 技术,需实时从内存读取高分辨率纹理。内存速度不足可能导致纹理加载延迟,出现画面 “模糊 – 清晰” 的卡顿感,或触发显存不足(导致画质降级)。

显存 – 内存协同:当 GPU 显存不足时,会临时调用内存作为 “虚拟显存”。此时内存读写速度直接影响显存数据交换效率,低速度可能导致严重卡顿(如《艾尔登法环》开启高画质时)。

二、影响内存速度对游戏性能作用的关键因素

1. CPU 与内存控制器性能

瓶颈点:若 CPU 的内存控制器(如 Intel 的 SA 电压模块或 AMD 的 Infinity Fabric)性能不足,即使搭配高频内存,实际读写速度也无法完全发挥(如 AMD Ryzen 5 5600G 搭配 DDR4-3600 时,受 IF 总线频率限制,实际效能可能接近 DDR4-3200)。

优化建议:

Intel 平台:确保内存频率与 CPU 支持的最大频率匹配(如 i5-12400 支持 DDR4-3200,超高频内存可能无法提升性能)。

AMD 平台:调整 Infinity Fabric 频率与内存频率 1:1 同步(如内存 3600MHz 时,IF 设为 1800MHz),以降低延迟、提升效率。

2. 内存时序(CL/CR/TRCD/TRP 等)

延迟的影响:内存频率高但时序差(如 CL18 vs. CL14),可能导致实际延迟更高,对游戏帧率稳定性影响更大。

案例:DDR4-3200 CL14 的延迟约 8.75ns,而 DDR4-3600 CL18 的延迟约 10ns,后者在竞技类游戏(如《Apex 英雄》)中可能导致帧率下降 5%-8%。

3. 游戏引擎优化

优化差异:

优化良好的引擎(如《使命召唤》系列):对内存依赖较低,高频内存提升帧率可能不足 5%。

优化较差或内存敏感的引擎(如《星际公民》《武装突袭 3》):高频内存可显著提升帧率(10%-15% 甚至更高)。

规律:使用 Unity、Unreal 引擎的游戏通常对内存速度更敏感,尤其是未充分优化的独立游戏。

4. 内存容量与通道模式

容量不足的优先级:若内存容量不足(如 8GB 运行《赛博朋克 2077》),系统会频繁调用硬盘虚拟内存,此时读写速度问题会被 “容量瓶颈” 掩盖,优先升级容量比提升速度更有效。

双通道 vs. 单通道:双通道内存(如 2×8GB)的读写带宽是单通道(1×16GB)的近 2 倍,对游戏性能提升显著(如《原神》1080P 高画质下,双通道 DDR4-3200 比单通道帧率高 15%-20%)。

三、不同场景下的性能提升实测参考

| 测试平台 | 游戏 / 场景 | 内存配置 | 帧率(FPS) | 加载时间 |

|---|---|---|---|---|

| CPU: i5-12600K GPU: RTX 3060 |

《永劫无间》1080P 中画质 | DDR4-3200 CL16 8×2GB | 110-120 | 45 秒 |

| 同上 | 同上 | DDR4-4000 CL18 8×2GB | 120-130 | 38 秒 |

| CPU: Ryzen 7 5800X GPU: RX 6800 XT |

《艾尔登法环》4K 高画质 | DDR4-3600 CL16 16×2GB | 58-63 | 1 分 10 秒 |

| 同上 | 同上 | DDR5-6000 CL36 16×2GB | 60-65 | 55 秒 |

| CPU: i9-13900K GPU: RTX 4090 |

《赛博朋克 2077》4K 光追 | DDR5-5600 CL40 16×2GB | 75-80 | 1 分 30 秒 |

| 同上 | 同上 | DDR5-7200 CL34 16×2GB | 78-83 | 1 分 10 秒 |

四、总结:是否需要为游戏升级高频内存?

建议升级的情况:

使用老旧平台(如 DDR3 内存或 DDR4-2400 及以下频率),升级到 DDR4-3200 或 DDR5 可显著提升游戏加载速度和帧率。

竞技类 / 高帧率需求游戏(如《CS2》《无畏契约》),高频内存可突破 CPU 瓶颈,提升帧率上限(如从 200FPS 提升至 240FPS)。

多任务玩家:需同时运行游戏、直播、录屏等程序,高频内存可减少卡顿。

无需优先升级的情况:

已使用主流高频内存(如 DDR4-3600 或 DDR5-5600),且游戏帧率稳定在目标值(如 60FPS 或 144FPS),提升空间有限。

显卡性能瓶颈明显(如用 RTX 3050 玩 4K 游戏),此时升级显卡比内存更有效。

内存容量不足(如单通道 8GB),优先扩容至双通道 16GB 再考虑速度。

性价比建议:

Intel 平台:12 代 / 13 代酷睿搭配 DDR4-3200(性价比高)或 DDR5-6000(未来兼容性好)。

AMD 平台:Ryzen 5000 及以上建议 DDR4-3600(IF 同步优化),Ryzen 7000 系列建议 DDR5-5600 起步。

时序优先级:同频率下,低时序(如 CL16)比高时序(CL18)更有利于游戏延迟优化。

通过合理搭配内存规格(频率、容量、通道、时序),可在预算范围内最大化游戏性能,尤其是对 CPU 性能敏感的游戏场景。

5、不同类型的游戏对内存读写速度的要求有所差异,以下是具体介绍:

休闲游戏:如《糖果传奇》《植物大战僵尸》等休闲游戏。它们的游戏场景简单,数据量较小,对内存读写速度要求较低,通常内存读取速度在 500MB/s 以上即可满足基本需求,4GB 内存基本能保证游戏流畅运行1。

中型游戏:像《英雄联盟》《DOTA2》等中型游戏。这类游戏有一定规模的地图和角色数据,需要较快的内存读写来保证游戏过程中数据的及时传输,建议内存读取速度在 800MB/s 以上,通常 8GB 内存能正常运行,若要同时进行其他操作,16GB 内存更佳。

大型 3A 游戏:例如《巫师 3》《GTA5》《黑神话:悟空》等。此类游戏包含大量高清纹理、复杂场景建模和丰富音效资源,在启动游戏、加载地图时需要快速读取大量数据,对内存读写速度要求较高,读取速度最好在 1000MB/s 以上1。推荐至少 16GB 内存,若想获得更好体验,32GB 内存更为合适。

开放世界游戏:如《塞尔达传说:旷野之息》《方舟:生存进化》等4。游戏世界广阔,场景复杂,物理计算量大,需频繁读写大量场景数据、角色数据等,对内存读写速度要求极高,读取速度应达到 1000MB/s 以上,最好能达到 1500MB/s 甚至更高。为保证游戏流畅运行,32GB 内存是更好的选择。

沙盒游戏:以《我的世界》为例,虽然最低 4GB 内存可运行11。但如果要构建大型建筑、加载大量模组,或多人在线游玩,对内存读写速度要求会大幅提高,建议内存读取速度在 800MB/s 以上,内存容量 16GB 或更高,才能确保游戏不出现卡顿。

6、16GB 内存是否能满足市面上所有游戏的运行要求,需结合游戏类型、画质设置、操作系统及后台程序等因素综合判断。以下是详细分析:

一、当前主流游戏对内存的需求

1. 多数 3A 大作和新发布游戏

推荐配置普遍为 16GB:

例如《赛博朋克 2077》《艾尔登法环》《霍格沃茨之遗》等近期热门 3A 游戏,官方推荐配置多为 16GB 内存。在 1080P/2K 分辨率、中高画质下,16GB 内存通常可流畅运行,内存占用率约 60%~80%。

例外情况:若开启最高画质(如 4K 分辨率 + 光追 + 高材质包),部分游戏(如《微软模拟飞行》)内存占用可能接近或超过 16GB,导致卡顿或频繁加载。

2. 开放世界与沙盒游戏

基础需求可满足,但高负载场景需注意:

《GTA5》《荒野大镖客 2》等开放世界游戏在 16GB 内存下可正常运行,但在复杂场景(如城市中心、多人互动)中,内存占用可能达到 12~14GB,剩余空间有限。

《我的世界》若加载大量模组(Mod)或大型地图,内存需求可能超过 16GB,需手动调整 Java 虚拟机内存分配。

3. 多人在线游戏(MMO/BR)

通常足够,但后台程序可能影响:

《绝地求生》《Apex 英雄》等吃鸡类游戏,16GB 内存可满足最高画质需求,内存占用约 8~12GB。

若同时运行直播软件、游戏加加等后台程序,可能导致内存占用突破 16GB,引发卡顿。

4. 老旧或低配置游戏

完全无压力:

如《英雄联盟》《CS:GO》《星露谷物语》等,4~8GB 内存即可运行,16GB 内存远超需求。

二、16GB 内存的局限性

1. 未来游戏的内存需求增长

次世代游戏趋向更高配置:

随着 UE5 引擎普及(如《黑神话:悟空》《Project TARISLAND》),游戏对内存的需求可能提升。部分未上市的 3A 大作可能将推荐内存提升至 24~32GB(尤其是支持 8K 画质或超大规模开放世界的游戏)。

2. 特殊场景下的内存不足

4K 分辨率 + 极致画质:

高分辨率下,游戏需加载更多纹理数据,显存和内存占用同步增加。例如《战神 5》在 4K + 最高画质下,内存占用可能接近 16GB 上限,导致频繁调用虚拟内存(硬盘缓存),引发帧率波动。

多任务并行:

同时运行游戏、视频剪辑软件(如 Premiere)、虚拟机等重度程序时,16GB 内存可能被快速占满,导致游戏卡顿甚至崩溃。

3. 虚拟内存的瓶颈

当物理内存不足时,系统会调用硬盘作为虚拟内存。但机械硬盘(HDD)的读写速度远低于内存(通常仅 100~200MB/s),可能导致游戏加载延迟、画面卡顿或闪退。即使使用固态硬盘(SSD),虚拟内存的效率仍无法与物理内存相比。

三、是否需要升级到 32GB?

推荐升级的情况:

追求极致画质或 4K 分辨率:

尤其是使用 RTX 40 系列显卡搭配高分辨率显示器的玩家,更大内存可避免因显存 / 内存共享导致的性能瓶颈。

多任务重度用户:

常同时运行游戏、直播、录屏、编程等多任务者,32GB 内存可提供更大冗余。

长期规划(2~3 年):

为适配未来 3~5 年的新游戏,提前升级内存可延长硬件寿命。

暂时无需升级的情况:

主要玩 1080P 中高画质 3A 游戏,且无多任务需求;

电脑使用机械硬盘,优先升级 SSD(对游戏加载速度提升更明显)。

总结

16GB 内存目前可满足市面上 95% 以上游戏的运行需求,尤其在 1080P/2K 分辨率、中高画质下表现稳定。但对于追求极致画质、4K 分辨率或多任务并行的玩家,32GB 内存将成为未来 2~3 年的更优选择。若预算有限,可先确保使用 SSD(提升虚拟内存效率),待未来游戏普遍要求更高内存时再升级。

7、Linux操作系统对内存是如何管理和分配以及回收的?

Linux 操作系统的内存管理基于虚拟内存机制,通过高效的分配、管理和回收策略,确保多任务环境下的内存资源合理利用。以下是其核心原理和机制的详细解析:

一、内存管理的基础架构

1. 虚拟内存(Virtual Memory)

核心思想:将物理内存(RAM)与磁盘交换空间(Swap)结合,为每个进程分配独立的虚拟地址空间,避免进程间内存冲突。

地址空间划分:

用户空间(User Space):每个进程独立拥有约 3GB(32 位系统)或 128TB(64 位系统)的虚拟地址空间,用于运行程序代码、数据和堆 / 栈。

内核空间(Kernel Space):所有进程共享约 1GB(32 位)或更高的内核地址空间,用于内核程序和设备驱动。

2. 分页机制(Paging)

内存分割:将虚拟内存和物理内存划分为固定大小的页(Page,通常为 4KB,可通过大页(Huge Page)优化)。

页表(Page Table):通过多级页表实现虚拟地址到物理地址的映射,支持内存保护(只读 / 可写 / 执行权限)和缓存(TLB,转换后备缓冲区)。

二、内存分配机制

1. 内核空间内存分配

** slab 分配器 **:

针对内核频繁申请 / 释放的小对象(如文件描述符、进程控制块),通过缓存机制减少碎片,提升分配效率。

预先分配多个对象缓存池,避免重复调用kmalloc和kfree带来的开销。

伙伴系统(Buddy System):

管理连续物理内存块,以 2 的幂次(如 4KB、8KB、16KB)分配内存,减少外部碎片。

适用于分配较大内存(如 DMA 缓冲区、内核模块加载)。

2. 用户空间内存分配

动态内存分配函数:

malloc/free:通过 C 库实现,底层调用brk(扩展堆空间)或mmap(映射匿名文件)分配内存。

mmap/munmap:直接映射文件或设备到虚拟地址空间,适用于大内存分配(如共享内存、动态库加载)。

内存区域(VMA,Virtual Memory Area):

用户空间的虚拟地址空间被划分为多个 VMA,每个 VMA 对应一段连续的内存区域(如代码段、数据段、堆、栈、共享库),通过struct vm_area_struct管理属性(权限、映射文件等)。

三、内存回收机制

Linux 通过主动回收和被动回收机制释放不再使用的内存,确保系统稳定运行。

1. 内存回收触发条件

物理内存不足:当可用内存低于阈值(watermark)时,触发回收。

周期性扫描:通过后台线程(如kswapd)定期检查内存使用情况,预防内存耗尽。

2. 回收策略

(1)页面缓存回收(Page Cache)

机制:回收未被修改的文件缓存页(如已读取的文本文件、程序代码),直接丢弃;若为脏页(已修改),需先写入磁盘再回收。

工具:通过sync命令强制将脏页写入磁盘,echo 1 > /proc/sys/vm/drop_caches可手动释放缓存。

(2)匿名页回收(Anonymous Pages)

Swap 交换:将匿名页(如进程的堆 / 栈数据)写入 Swap 分区,释放物理内存。

开启 / 关闭 Swap:通过swapon/swapoff命令管理,/etc/fstab配置开机自动挂载。

缺点:Swap 速度远低于内存,频繁交换会导致系统卡顿(OOM 风险)。

LRU 算法(最近最少使用):

通过双向链表将页面分为活跃列表(Active List)和非活跃列表(Inactive List)。

优先回收非活跃列表中长时间未访问的页面,降低对活跃进程的影响。

(3)OOM Killer(内存不足杀手)

当内存极度匮乏且无法通过回收解决时,内核会触发 OOM(Out of Memory)机制,强制杀死占用内存最多的进程(通过oom_score评分确定目标)。

可通过/proc/<pid>/oom_score_adj调整进程被杀死的优先级(负值表示豁免)。

四、内存管理的优化策略

1. 大页内存(Huge Pages)

原理:使用更大的页尺寸(如 2MB/1GB)减少页表条目,降低 TLB 缓存未命中(TLB Miss)概率,提升大数据量场景(如数据库、虚拟机)的性能。

配置:

bash

echo 1024 > /proc/sys/vm/nr_hugepages # 预留1024个2MB大页

2. 透明大页(Transparent Huge Pages, THP)

自动管理:内核动态将相邻小页合并为大页,无需应用程序显式配置。

性能影响:对某些数据库(如 MySQL)可能导致碎片化,可通过以下命令优化:

bash

echo never > /sys/kernel/mm/transparent_hugepage/enabled # 关闭THP(部分场景推荐)

3. 内存压缩(Memory Compression)

ZRAM 模块:将内存数据压缩后存储在 Swap 中,减少实际写入磁盘的数据量,提升交换效率(适用于移动设备或低内存系统)。

配置:

bash

modprobe zram # 加载模块

echo 1073741824 > /sys/block/zram0/disksize # 设置压缩Swap大小为1GB

4. 内存规整(Memory Defragmentation)

实时规整(Kcompactd):后台线程定期整理物理内存碎片,确保大内存分配请求(如 DMA)能获得连续空间。

手动触发:

bash

echo 1 > /proc/sys/vm/compact_memory # 触发内存规整

五、关键配置文件与工具

1. 配置文件

/etc/sysctl.conf:全局内核参数配置,如:

ini

vm.swappiness=10 # 设置Swap使用倾向(0~100,默认60,数值越低越优先回收缓存)

vm.vfs_cache_pressure=100 # 调整文件缓存回收优先级(数值越高越优先回收缓存)

2. 监控工具

free/proc/meminfo:查看内存使用总量、缓存、Swap 等信息。

top/htop:实时监控进程内存占用(RES为常驻内存,VIRT为虚拟内存)。

vmstat:分析内存分页、交换活动及系统整体性能。

strace:跟踪进程的内存分配调用(如mmap、brk)。

总结

Linux 内存管理通过虚拟内存、分页机制、高效分配器和多层回收策略,在多任务环境中实现了资源的动态平衡。其核心目标是:

隔离性:确保进程间内存安全,避免越界访问;

高效性:通过缓存、大页、压缩等技术提升访问速度;

鲁棒性:通过回收和 OOM 机制防止系统因内存耗尽崩溃。

对于普通用户,理解内存管理原理有助于优化系统配置(如调整 Swap 策略、关闭 THP);对于开发者,则可通过大页、内存映射等技术提升应用性能。

8、内存分配失败时,Linux系统会有怎样的处理机制

在 Linux 系统中,当内存分配失败时,会触发一系列错误处理机制和内存回收策略,以尽可能维持系统稳定运行。以下是具体的处理流程和机制:

一、内存分配失败的触发场景

用户空间分配失败

应用程序调用 malloc/new 等函数申请内存时,底层通过 brk(扩展堆)或 mmap(映射虚拟内存)实现。若虚拟地址空间耗尽或物理内存不足,会返回 NULL(C 语言)或抛出异常(如 C++ 的 std::bad_alloc)。

示例:循环申请大内存直至系统极限,最终触发分配失败。

内核空间分配失败

内核模块或驱动调用 kmalloc/vmalloc 申请内存时,若物理内存不足(尤其是连续内存不足),会返回 NULL 或触发错误处理路径(如 panic,但通常会避免直接崩溃)。

二、用户空间内存分配失败的处理

1. 应用程序层面的处理

返回值判断:

C 语言中需通过 if (ptr == NULL) 判断分配失败,通常进行错误日志记录、释放已有资源或尝试缩小分配尺寸。

c

void* ptr = malloc(1024 * 1024 * 1024); // 申请1GB内存

if (!ptr) {

perror("malloc failed");

exit(EXIT_FAILURE);

}

异常处理(C++):

new 操作失败时默认抛出 std::bad_alloc 异常,可通过 try-catch 捕获并处理:

cpp

try {

int* arr = new int[1000000000]; // 可能触发异常

} catch (const std::bad_alloc& e) {

std::cerr << "Memory allocation failed: " << e.what() << std::endl;

}

2. 系统层面的内存回收尝试

触发异步回收:

当用户空间申请内存失败时,内核会先尝试通过 后台回收线程(kswapd) 释放缓存页(Page Cache)或交换匿名页(Anonymous Pages)到 Swap,腾出物理内存。

缩小内存占用:

若回收仍不足,系统可能通过 内存规整(Kcompactd) 整理碎片,或触发 OOM Killer(见下文)选择性杀死进程。

三、内核空间内存分配失败的处理

内核分配内存(如通过 kmalloc)时对稳定性要求更高,处理方式因分配场景(紧急 / 非紧急)而异:

1. 非紧急分配(可阻塞)

等待回收:

若分配允许阻塞(如进程上下文调用),内核会主动触发内存回收(调用 __alloc_pages 时触发 kswapd 或直接同步回收),直到内存足够或超时。

失败处理函数:

分配失败时,内核通常会返回 NULL,调用者需检查返回值并执行错误路径(如释放其他资源、回滚操作)。

2. 紧急分配(不可阻塞)

原子分配(GFP_ATOMIC):

中断处理、DMA 操作等场景需使用 GFP_ATOMIC 标志,此时分配失败会返回 NULL,但内核会尽量避免在此类场景中触发 OOM(因可能导致系统崩溃)。

紧急保留内存:

部分内核子系统(如 DMA)会预先保留一部分内存(通过 memblock 机制),确保紧急情况下有可用空间。

四、内存耗尽(OOM,Out of Memory)机制

当系统内存极度匮乏且无法通过常规回收解决时,会触发 OOM Killer(内存不足杀手),其核心逻辑如下:

1. OOM 触发条件

物理内存 + Swap 空间不足,且内存回收无法及时释放足够资源。

内核参数 vm.oom_kill_allocating_task(默认开启)允许杀死当前申请内存的进程。

2. 进程评分(oom_score)

内核通过 oom_score 算法为每个进程计算被杀死的优先级,评分越高越优先被终止。评分因素包括:

内存占用量:进程占用的物理内存(RSS)越大,评分越高。

进程类型:用户空间进程评分高于内核线程,普通进程高于特权进程(如 init)。

参数调整:可通过 /proc/<pid>/oom_score_adj 修改评分(范围 -1000 到 1000,-1000 表示豁免)。

3. OOM Killer 执行流程

扫描进程列表:遍历所有用户空间进程,计算 oom_score。

选择目标进程:优先杀死评分最高且非豁免的进程(通常是占用内存最多的应用,如浏览器、数据库)。

终止进程:发送 SIGKILL 信号强制结束进程,释放其占用的内存。

日志记录:在 dmesg 中记录被杀进程信息,如:

plaintext

[12345.678] Out of memory: Kill process 1234 (chrome) score 1001 or sacrifice child

五、内存分配失败的优化与调试

1. 预防内存分配失败

限制进程内存使用:

通过 ulimit 或 systemd 的 MemoryMax 参数限制单个进程的内存上限,避免单个进程耗尽系统资源。

bash

ulimit -v 2097152 # 限制进程虚拟内存为2GB

调整 Swap 策略:

增大 Swap 空间或降低 vm.swappiness(如设为 10),减少内存直接耗尽的风险:

bash

echo 10 > /proc/sys/vm/swappiness

2. 调试工具

查看 OOM 日志:

bash

dmesg | grep -i 'out of memory' # 查看最近的OOM事件

journalctl -k | grep 'oom-kill' # systemd日志中的OOM记录

监控内存使用:

使用 top/htop 观察进程的 RES(常驻内存)和 %MEM 占用,或通过 pmap <pid> 分析进程内存映射。

压力测试工具:

使用 stress-ng 或 memtester 模拟内存压力,验证系统稳定性:

bash

stress-ng --vm 4 --vm-bytes 1G # 启动4个线程,每个申请1GB内存

总结

Linux 处理内存分配失败的核心逻辑是:先尝试回收,再按需杀死进程。用户空间通过返回值或异常通知应用,内核空间通过分级处理保障关键功能,最终通过 OOM Killer 牺牲非关键进程来维持系统存活。理解这些机制有助于优化系统配置(如调整 Swap、限制进程内存)或定位内存泄漏问题。

9、怎样优化linux系统的内存管理?

优化 Linux 系统的内存管理需要从内存分配策略、回收机制、Swap 使用、进程管理等多维度入手,结合系统负载和应用场景调整参数。以下是具体的优化方向和实践方法:

一、调整内存分配与回收策略

1. 优化内存回收参数(vm 子系统)

vm.swappiness(控制 Swap 使用倾向)

作用:取值范围 0-100,数值越高越优先使用 Swap 交换内存。

优化场景:

服务器 / 高性能场景:设为 10-20(减少 Swap 使用,避免性能下降)。

桌面 / 低内存设备:设为 60-70(允许适当使用 Swap,防止 OOM)。

设置方法:

bash

echo 10 > /proc/sys/vm/swappiness # 临时生效

echo "vm.swappiness = 10" >> /etc/sysctl.conf # 永久生效(需sysctl -p)

vm.dirty_ratio 和 vm.dirty_background_ratio(控制脏页写入磁盘)

作用:

dirty_background_ratio:当脏页占内存比例超过此值时,触发后台线程(pdflush)写入磁盘。

dirty_ratio:当脏页占比超过此值时,阻塞进程直接写入磁盘(避免内存耗尽)。

优化建议:

高并发写入场景(如数据库):适当调大(如 dirty_background_ratio=5,dirty_ratio=10),减少磁盘写入阻塞。

普通场景:保持默认值(通常为 10 和 20)。

设置方法:

bash

sysctl -w vm.dirty_background_ratio=5

sysctl -w vm.dirty_ratio=10

2. 启用透明大页(Transparent Huge Pages, THP)

作用:通过更大的内存页(2MB/1GB)减少页表缓存(TLB)压力,提升大内存应用(如数据库)性能。

注意事项:

可能增加内存碎片化,部分场景(如 Java 应用)需关闭。

临时开关:

bash

echo always > /sys/kernel/mm/transparent_hugepage/enabled # 始终启用

echo never > /sys/kernel/mm/transparent_hugepage/enabled # 始终禁用

永久生效:修改 /etc/rc.local 或创建 systemd 服务。

二、优化 Swap 空间配置

1. 合理使用 Swap

场景建议:

物理内存紧张的系统:启用 Swap 作为内存溢出缓冲(如嵌入式设备、老旧服务器)。

高性能服务器:若内存充足,可关闭 Swap(避免内核误判将活跃内存交换到磁盘)。

创建 / 调整 Swap 分区:

bash

# 创建Swap文件(2GB为例)

fallocate -l 2G /swapfile

chmod 600 /swapfile

mkswap /swapfile

swapon /swapfile

# 永久挂载(添加到 /etc/fstab)

/swapfile none swap sw 0 0

2. 调整 Swap 优先级(swappiness 配合)

结合 vm.swappiness 参数,控制 Swap 的使用时机(见上文)。

三、限制进程内存占用

1. 使用 systemd 管理进程内存

配置 MemoryMax:在 .service 文件中限制单个服务的内存上限,避免其耗尽系统资源。

ini

[Service]

MemoryMax=4G # 限制内存使用不超过4GB

MemorySwapMax=4G # 限制内存+Swap总和(需启用Swap)

重新加载配置:systemctl daemon-reload

重启服务:systemctl restart <service-name>

2. 通过 ulimit 限制用户内存

临时限制(当前会话):

bash

ulimit -v 2097152 # 限制虚拟内存为2GB(`-v` 单位为KB)

ulimit -m 1048576 # 限制物理内存为1GB(`-m` 单位为KB)

永久限制(针对用户或组):

编辑 /etc/security/limits.conf,添加:

plaintext

username hard memlock 1048576 # 用户username的内存锁定上限为1GB

* soft nofile 65536 # 所有用户的文件描述符软限制为65536

四、优化内核内存管理特性

1. 启用内存规整(Memory Compaction)

作用:整理物理内存碎片,提升连续内存分配成功率(如 DMA 场景)。

参数调整:

bash

echo 1 > /proc/sys/vm/compact_memory # 手动触发内存规整

sysctl -w vm.compaction_proactiveness=100 # 调整主动规整积极性(0-1000,默认100)

2. 关闭不必要的内存特性

关闭透明大页(针对特定场景):

若发现 THP 导致性能下降(如 Java 应用),可永久禁用(见上文)。

关闭内存锁(mlock)滥用:

检查是否有进程通过 mlock 锁定大量内存,通过 pstree -p 或 lsof 排查并优化。

五、监控与调优工具

1. 实时监控工具

top/htop:查看进程内存占用(RES/%MEM)、Swap 使用情况。

vmstat:分析内存分页(si/so 表示 Swap 进出速率,若持续高于 0 需已关注)。

bash

vmstat 5 # 每5秒输出一次内存/IO状态

sar -r:统计内存使用趋势(需安装 sysstat 包)。

2. 内存分析工具

strace:跟踪进程的内存分配系统调用(如 brk/mmap),定位分配失败点。

perf:分析内核内存管理函数的性能瓶颈(如 __alloc_pages 耗时)。

numastat:针对 NUMA 架构系统,优化内存跨节点分配效率。

六、特定场景优化建议

1. 数据库服务器

增大页缓存(Page Cache):

数据库常通过内存缓存数据,可适当调大 vm.max_map_count(默认 65530),允许更多内存映射:

bash

sysctl -w vm.max_map_count=262144

禁用 Swap:避免数据库热数据被交换到磁盘,通过 swapoff -a 临时关闭或修改 /etc/fstab。

2. 容器化环境(Docker/Kubernetes)

使用 Cgroups 限制容器内存:

bash

docker run --memory=4g myapp # 限制容器内存为4GB

启用 systemd 内存控制组:确保容器内存限制与宿主机策略一致。

3. 高并发 Web 服务

优化 TCP 内存缓冲区:

通过 sysctl 调整 net.core.rmem_max/wmem_max 等参数,提升网络性能(需结合业务场景测试)。

总结:优化流程与验证

定位问题:通过 top/vmstat 确认内存瓶颈类型(物理内存不足、Swap 颠簸、碎片等)。

优先级调整:先调整 swappiness、限制进程内存,再尝试内核参数优化。

分阶段验证:每次修改后监控系统稳定性(如 OOM 事件减少、应用延迟降低),避免过度优化导致副作用。

长期维护:定期通过 logrotate 分析 OOM 日志,结合业务增长调整内存配置(如扩容物理内存)。

通过以上措施,可在不同场景下提升 Linux 内存利用率,减少内存泄漏和 OOM 风险,保障系统稳定性与性能。

10、优化内存管理对系统性能的具体影响是什么?

优化内存管理对 Linux 系统性能的影响是多维度的,既直接影响内存本身的使用效率,也会通过关联组件(如 CPU、磁盘 I/O)间接提升整体性能。以下是具体影响及原理:

一、提升内存利用率,减少资源浪费

降低内存碎片化

影响:优化内存分配策略(如调整 slab 分配器参数、使用更高效的内存管理器)可减少小块内存碎片,提高物理内存的有效利用率。

案例:碎片化严重时,即便总内存充足,也可能因无法分配连续大块内存导致程序崩溃(如虚拟机创建失败)。优化后,相同内存可承载更多进程或更大数据。

合理利用缓存机制

影响:Linux 会将空闲内存用于缓存文件数据(Page Cache),优化 swappiness 参数或启用 transparent huge pages 可平衡缓存与进程内存需求,避免缓存被频繁清除或过度占用内存。

数据:若缓存命中率从 50% 提升至 70%,磁盘 I/O 次数可减少约 30%,显著加速文件读写密集型任务(如数据库、Web 服务器)。

二、减少 CPU 资源消耗

降低内存管理的 CPU 开销

影响:优化内核内存管理模块(如 kswapd 交换守护进程的参数)可减少内存回收时的 CPU 占用。例如,调整 vm.swappiness 避免不必要的换页(Swap)操作,减少 kswapd 频繁扫描内存的消耗。

场景:在高负载服务器上,优化后 CPU 空闲时间可能提升 5%-10%,释放资源用于处理用户进程。

减少上下文切换和锁竞争

影响:多线程程序中,优化内存分配器(如从默认的 ptmalloc 切换为 jemalloc/tcmalloc)可降低线程间的锁竞争(如全局分配锁),减少 CPU 上下文切换次数。

数据:在高并发场景下,使用 jemalloc 可使线程同步开销降低 20%-50%,提升多核 CPU 的利用率。

三、加速数据访问,降低延迟

减少换页(Swap)操作

影响:Swap 是将内存数据写入磁盘的机制,其速度比内存慢数千倍。优化内存管理可避免进程因内存不足频繁换页,降低延迟。

案例:若某数据库进程因内存不足频繁 Swap,查询响应时间可能从毫秒级飙升至秒级;优化后(如增加内存或调整 swappiness),延迟可回归正常水平。

利用大页内存(Huge Pages)

影响:启用大页内存(如 transparent huge pages)可减少页表条目,降低地址转换的 TLB(Translation Lookaside Buffer)缺失率,加速 CPU 访问内存的速度。

数据:在虚拟化或数据库场景中,大页内存可使内存访问延迟降低 10%-30%,吞吐量提升约 15%。

四、提升系统稳定性和吞吐量

避免内存泄漏导致的崩溃

影响:通过工具(如 valgrind、AddressSanitizer)优化应用层内存泄漏问题,可防止进程因持续占用内存导致系统 OOM(Out of Memory),提升稳定性。

场景:长期运行的服务(如 Web 服务器)若存在内存泄漏,可能因耗尽内存被系统强制杀死;优化后可支持更长的运行周期。

支持更多并发进程

影响:优化内存分配效率后,系统可在相同物理内存下运行更多进程(如容器、虚拟机),提升资源利用率。

数据:在容器化环境中,通过内核参数优化(如调整 vm.max_map_count),单节点可承载的容器数量可能增加 20%-30%。

五、优化磁盘 I/O 性能

减少磁盘交换压力

影响:内存管理优化可降低 Swap 使用频率,减少磁盘 I/O 负载。例如,当 swappiness 从 60 调至 10 时,磁盘 Swap 写入量可能减少 80% 以上,缓解机械硬盘的性能瓶颈。

场景:在使用 SSD 作为 Swap 设备的系统中,减少 Swap 可延长硬盘寿命;在机械硬盘系统中,可避免因 Swap 导致的系统卡顿。

优化文件缓存与磁盘同步

影响:调整 vm.dirty_ratio 和 vm.dirty_background_ratio 可控制内存中缓存数据写入磁盘的时机,避免大量同步操作阻塞其他 I/O 请求。

效果:合理设置参数可使文件写入的吞吐量提升 10%-20%,尤其在高并发写入场景(如日志服务、实时数据处理)中效果显著。

六、典型优化手段与对应性能提升总结

| 优化手段 | 核心目标 | 性能提升表现 |

|---|---|---|

调整 swappiness |

减少不必要的 Swap 操作 | 磁盘 I/O 次数减少 30%-80% |

| 启用大页内存 | 降低 TLB 缺失率,加速内存访问 | 内存访问延迟降低 10%-30% |

| 更换用户态内存分配器 | 减少线程锁竞争 | 多核 CPU 利用率提升 15%-50% |

| 优化 slab 分配器参数 | 减少内核内存碎片 | 内核内存分配速度提升 5%-20% |

| 限制进程内存使用 | 防止单个进程耗尽内存 | 系统 OOM 频率降低 90% 以上 |

| 清理无效缓存 / 减少泄漏 | 释放被占用的无效内存 | 可用内存增加 10%-50%(视泄漏程度) |

总结

优化内存管理的核心是在 空间效率(利用率)和 时间效率(访问速度)之间找到平衡,并减少系统组件间的性能瓶颈(如 CPU 锁竞争、磁盘 I/O 压力)。对于不同场景(桌面、服务器、嵌入式),需针对性调整策略:

桌面系统:侧重低延迟和响应速度,优先减少 Swap 和提升缓存命中率。

服务器:侧重吞吐量和稳定性,需平衡多进程内存分配、大页内存利用和 I/O 优化。

嵌入式系统:侧重内存占用最小化,可能需使用定制化内存分配器或关闭非必要缓存机制。

通过合理优化,Linux 系统可在相同硬件条件下实现更高的性能上限,或在性能目标不变时降低硬件资源消耗。

11、调整哪些内核参数可以降低内存管理的CPU开销?

通过调整vm.swappiness、vm.vfs_cache_pressure、vm.dirty_ratio和vm.dirty_background_ratio等内核参数,可以降低 Linux 系统内存管理的 CPU 开销,具体如下:

vm.swappiness:该参数用于控制系统使用交换分区的频率,默认值为 60。值越高,系统越倾向于将内存内容移动到交换分区;值越低,则越倾向于保留物理内存中的内容。若设置过高,系统可能会过度依赖交换分区,由于磁盘 I/O 速度远慢于内存,会导致 CPU 在等待数据从磁盘交换到内存的过程中消耗大量时间。建议将其设置为较低值,如 10 或更低,以减少磁盘 I/O 开销,降低内存管理的 CPU 占用。

vm.vfs_cache_pressure:此参数控制目录项和 inode 缓冲区被回收的概率,默认值为 100。降低该值可以减少文件元数据被回收的可能性,从而提高文件操作效率,减少因频繁回收和重新加载文件元数据导致的 CPU 开销。对于一些文件操作频繁的场景,可将其设置为 50 左右,但对于频繁创建和删除大量临时文件的应用场景,可能需要适当调高该值。

vm.dirty_ratio和vm.dirty_background_ratio1:vm.dirty_ratio控制着内存中脏页的比例,当脏页比例达到此值时,进程将同步脏页到磁盘;vm.dirty_background_ratio则是触发内核后台线程同步脏页到磁盘的脏页比例。如果设置过低,会导致频繁的磁盘写入操作,增加 CPU 开销。在高负载 I/O 场景下,可适当调高这两个参数,如将vm.dirty_ratio设置为 10,vm.dirty_background_ratio设置为 3,以减少频繁同步写回带来的性能开销。

vm.hugetlb_shm_group等大页内存相关参数:大页内存可以减少 TLB 缺失次数并提高缓存命中率,从而降低内存管理的 CPU 开销2。vm.hugetlb_shm_group用于设置大页内存的用户组,通过合理设置,可让特定用户或程序使用大页内存。此外,还可通过vm.nr_hugepages设置大页的数量等。但过度启用大页内存可能会导致页面置换开销增加,需根据具体场景进行测试与调整。

暂无评论内容