一文读懂AI人工智能领域的分类

关键词:人工智能分类、机器学习、深度学习、监督学习、无监督学习、强化学习、专家系统

摘要:本文全面系统地介绍了人工智能领域的分类体系,从基础概念到前沿技术,详细解析了机器学习、深度学习等核心分支的原理和应用。文章采用循序渐进的方式,通过算法原理、数学模型、代码实现和实际案例等多维度剖析AI分类,帮助读者构建完整的知识框架,并展望未来发展趋势。

1. 背景介绍

1.1 目的和范围

本文旨在为读者提供人工智能领域的系统性分类指南,涵盖从基础理论到实践应用的完整知识体系。我们将重点探讨机器学习、深度学习等主流技术分支的分类方法、原理差异和应用场景。

1.2 预期读者

本文适合以下读者群体:

AI领域的初学者和爱好者

计算机科学及相关专业的学生

希望了解AI技术分类的软件工程师

需要应用AI技术的产品经理和业务决策者

1.3 文档结构概述

文章首先介绍AI分类的基本框架,然后深入探讨各类技术的原理和实现,最后通过实际案例展示应用场景。全文包含理论讲解、数学推导、代码实现和资源推荐等多个维度。

1.4 术语表

1.4.1 核心术语定义

人工智能(AI): 使机器模拟人类智能行为的科学与工程

机器学习(ML): 让计算机从数据中学习而不需要明确编程的AI子领域

深度学习(DL): 基于多层神经网络的机器学习方法

1.4.2 相关概念解释

监督学习: 使用标记数据训练模型的机器学习方法

无监督学习: 从未标记数据中发现模式的机器学习方法

强化学习: 通过奖励机制学习最优行为的机器学习方法

1.4.3 缩略词列表

AI: Artificial Intelligence

ML: Machine Learning

DL: Deep Learning

ANN: Artificial Neural Network

CNN: Convolutional Neural Network

RNN: Recurrent Neural Network

2. 核心概念与联系

人工智能领域可以按照多种维度进行分类,最常见的是基于学习方式和应用场景的分类体系。

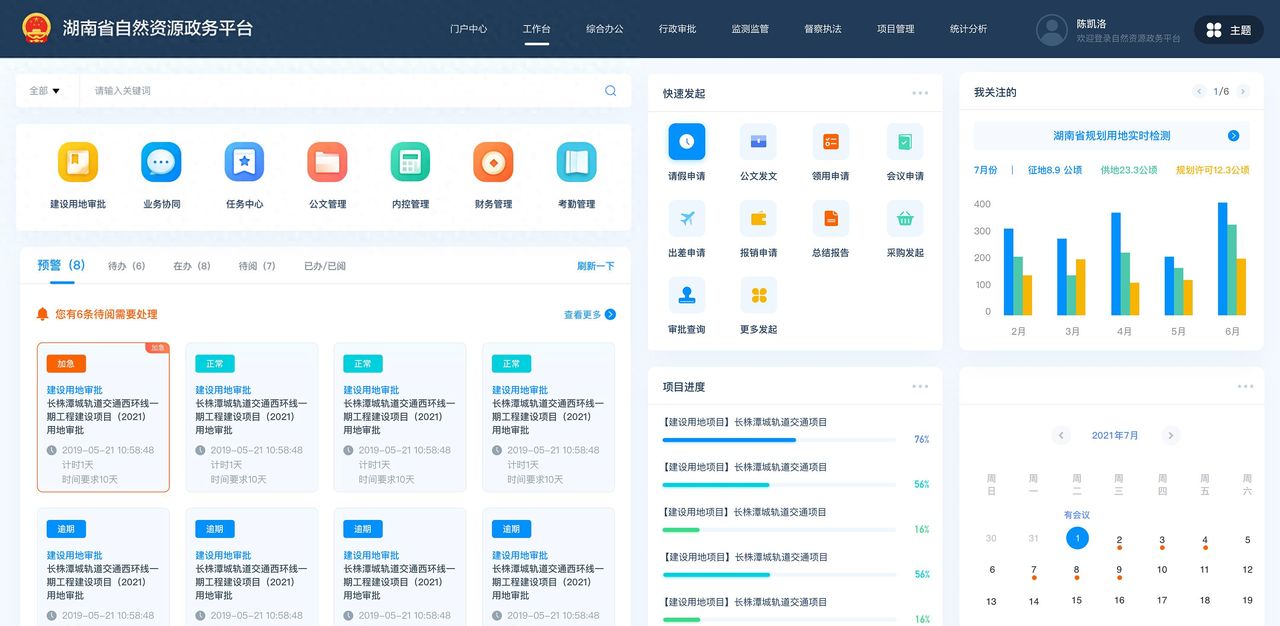

上图展示了AI领域的主要分类框架。传统AI系统主要基于硬编码规则,而现代AI则主要依赖数据驱动的机器学习方法。深度学习作为机器学习的一个子集,近年来取得了突破性进展。

3. 核心算法原理 & 具体操作步骤

3.1 监督学习算法示例:决策树

from sklearn.datasets import load_iris

from sklearn.tree import DecisionTreeClassifier, export_text

# 加载数据集

iris = load_iris()

X, y = iris.data, iris.target

# 创建决策树分类器

clf = DecisionTreeClassifier(max_depth=3, random_state=42)

clf.fit(X, y)

# 输出决策规则

tree_rules = export_text(clf, feature_names=iris['feature_names'])

print(tree_rules)

决策树通过递归地将数据集分割成更小的子集来工作,每次分割都基于最能区分目标类别的特征。上述代码展示了如何使用scikit-learn库实现一个简单的决策树分类器。

3.2 无监督学习算法示例:K-Means聚类

from sklearn.cluster import KMeans

from sklearn.datasets import make_blobs

import matplotlib.pyplot as plt

# 生成模拟数据

X, _ = make_blobs(n_samples=300, centers=4, cluster_std=0.60, random_state=0)

# 应用K-Means算法

kmeans = KMeans(n_clusters=4)

kmeans.fit(X)

y_kmeans = kmeans.predict(X)

# 可视化结果

plt.scatter(X[:, 0], X[:, 1], c=y_kmeans, s=50, cmap='viridis')

centers = kmeans.cluster_centers_

plt.scatter(centers[:, 0], centers[:, 1], c='red', s=200, alpha=0.75)

plt.show()

K-Means算法通过迭代过程将数据点分配到K个簇中,目标是使每个点到其所属簇中心的平方距离之和最小化。

4. 数学模型和公式 & 详细讲解 & 举例说明

4.1 线性回归模型

线性回归是监督学习中最基础的算法之一,其数学模型为:

y = β 0 + β 1 x 1 + β 2 x 2 + . . . + β n x n + ϵ y = eta_0 + eta_1x_1 + eta_2x_2 + … + eta_nx_n + epsilon y=β0+β1x1+β2x2+…+βnxn+ϵ

其中:

y y y 是目标变量

x 1 , x 2 , . . . , x n x_1, x_2, …, x_n x1,x2,…,xn 是特征变量

β 0 eta_0 β0 是截距项

β 1 , β 2 , . . . , β n eta_1, eta_2, …, eta_n β1,β2,…,βn 是系数

ϵ epsilon ϵ 是误差项

参数估计通常采用最小二乘法,目标是最小化残差平方和:

min ∑ i = 1 n ( y i − y i ^ ) 2 min sum_{i=1}^n (y_i – hat{y_i})^2 mini=1∑n(yi−yi^)2

4.2 神经网络的前向传播

对于简单的全连接神经网络,前向传播可以表示为:

z [ l ] = W [ l ] a [ l − 1 ] + b [ l ] z^{[l]} = W^{[l]}a^{[l-1]} + b^{[l]} z[l]=W[l]a[l−1]+b[l]

a [ l ] = g [ l ] ( z [ l ] ) a^{[l]} = g^{[l]}(z^{[l]}) a[l]=g[l](z[l])

其中:

l l l 表示网络层数

W [ l ] W^{[l]} W[l] 是第 l l l层的权重矩阵

b [ l ] b^{[l]} b[l] 是偏置向量

g [ l ] g^{[l]} g[l] 是激活函数

a [ l ] a^{[l]} a[l] 是第 l l l层的输出

5. 项目实战:代码实际案例和详细解释说明

5.1 开发环境搭建

推荐使用Python环境和以下库:

pip install numpy pandas matplotlib scikit-learn tensorflow keras

5.2 图像分类实战:使用CNN识别MNIST手写数字

import tensorflow as tf

from tensorflow.keras import layers, models

# 加载数据

(train_images, train_labels), (test_images, test_labels) = tf.keras.datasets.mnist.load_data()

# 预处理数据

train_images = train_images.reshape((60000, 28, 28, 1)).astype('float32') / 255

test_images = test_images.reshape((10000, 28, 28, 1)).astype('float32') / 255

# 构建CNN模型

model = models.Sequential([

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.Flatten(),

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax')

])

# 编译和训练模型

model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

model.fit(train_images, train_labels, epochs=5, batch_size=64)

# 评估模型

test_loss, test_acc = model.evaluate(test_images, test_labels)

print(f'Test accuracy: {

test_acc}')

5.3 代码解读与分析

这个CNN模型包含三个主要部分:

卷积层:使用3×3的卷积核提取图像特征

池化层:通过最大池化减少空间维度

全连接层:将提取的特征映射到10个数字类别

模型使用ReLU激活函数引入非线性,最后一层使用softmax激活函数输出概率分布。训练过程采用Adam优化器和交叉熵损失函数。

6. 实际应用场景

6.1 监督学习的应用

医疗诊断:基于医学影像的疾病分类

金融风控:信用评分和欺诈检测

推荐系统:电商平台的产品推荐

6.2 无监督学习的应用

客户细分:市场营销中的用户分群

异常检测:网络入侵检测

数据压缩:特征提取和降维

6.3 强化学习的应用

游戏AI:AlphaGo等游戏智能体

机器人控制:自主导航和操作

资源管理:数据中心能耗优化

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

《人工智能:现代方法》- Stuart Russell, Peter Norvig

《深度学习》- Ian Goodfellow等

《机器学习实战》- Peter Harrington

7.1.2 在线课程

Coursera: 机器学习 by Andrew Ng

Fast.ai: 实用深度学习课程

Udacity: 人工智能纳米学位

7.1.3 技术博客和网站

Towards Data Science

Distill.pub

OpenAI Blog

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

Jupyter Notebook

VS Code with Python插件

PyCharm

7.2.2 调试和性能分析工具

TensorBoard

PyTorch Profiler

Weights & Biases

7.2.3 相关框架和库

TensorFlow/PyTorch

Scikit-learn

Hugging Face Transformers

7.3 相关论文著作推荐

7.3.1 经典论文

“A Few Useful Things to Know About Machine Learning” – Pedro Domingos

“Attention Is All You Need” – Vaswani et al.

“Deep Learning” – Yann LeCun, Yoshua Bengio, Geoffrey Hinton

7.3.2 最新研究成果

大语言模型(LLM)研究

多模态学习

联邦学习

7.3.3 应用案例分析

ImageNet竞赛优胜方案

AlphaFold蛋白质结构预测

GPT系列语言模型

8. 总结:未来发展趋势与挑战

人工智能领域正经历着前所未有的快速发展,未来趋势包括:

多模态学习:整合视觉、语言、听觉等多种感知模态

自监督学习:减少对标注数据的依赖

可解释AI:提高模型决策的透明度和可信度

边缘AI:在终端设备上部署轻量级模型

AI伦理:解决偏见、隐私和责任归属问题

主要挑战包括:

数据隐私和安全

模型泛化能力

计算资源需求

社会伦理影响

9. 附录:常见问题与解答

Q1: 监督学习和无监督学习的主要区别是什么?

A: 监督学习使用标记数据进行训练,目标是学习输入到输出的映射;无监督学习使用未标记数据,目标是发现数据中的隐藏结构。

Q2: 深度学习与传统机器学习有何不同?

A: 深度学习通过多层神经网络自动学习特征表示,而传统机器学习通常需要手动特征工程。深度学习在大规模数据上表现更好,但需要更多计算资源。

Q3: 如何选择适合的AI算法?

A: 选择算法应考虑以下因素:数据规模和特征、问题类型(分类/回归/聚类等)、可解释性要求、计算资源限制等。通常建议从简单模型开始,逐步尝试更复杂的算法。

10. 扩展阅读 & 参考资料

DeepLearning.AI

arXiv AI相关论文

Google AI Blog

MIT AI Lab

Stanford AI Index Report

暂无评论内容