一、引言

(一)词嵌入技术的研究意义

在自然语言处理(NLP)领域,词嵌入技术通过将离散词语映射为连续语义向量,有效解决了文本数据的高维稀疏问题,为语义计算和语言理解提供了数学化基础。作为词嵌入的代表性方法,Word2Vec 与 GloVe 通过不同机制捕捉词语语义关系,在文本分类、机器翻译等任务中展现出卓越性能,成为当前 NLP 研究的核心技术之一。

(二)研究目标与方法

本文聚焦 Word2Vec 与 GloVe 的技术原理、模型特性及应用效果,通过对比分析揭示两者在语义向量生成机制上的差异,为研究者选择合适模型提供理论依据。结合数学建模与实证分析,系统阐述两种模型如何将语言符号转化为具有语义表征能力的向量空间。

二、Word2Vec 模型原理与架构

(一)分布式假设与神经网络建模

Word2Vec 由 Google 于 2013 年提出 ,基于 “上下文相似的词语语义相近” 这一分布式假设,通过浅层神经网络高效学习词向量,将词语的语义信息转化为低维连续向量空间中的数值表示。这种转化使得计算机能够以数学方式理解和处理自然语言,解决了传统 One-Hot 编码带来的高维稀疏性和语义鸿沟问题 。例如,在 “我喜欢苹果” 和 “我爱吃苹果” 这两个句子中,“喜欢” 和 “爱” 具有相似的上下文,Word2Vec 能将它们映射到相近的向量空间位置,从而捕捉到语义相似性。

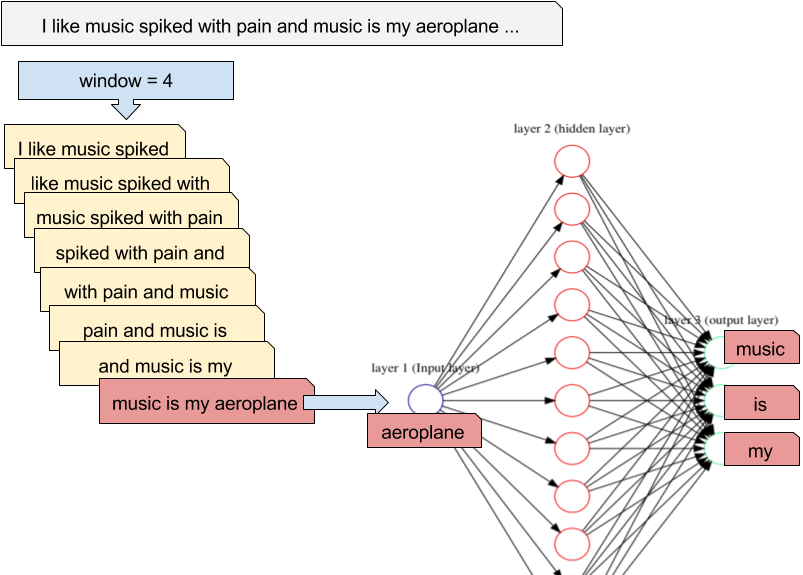

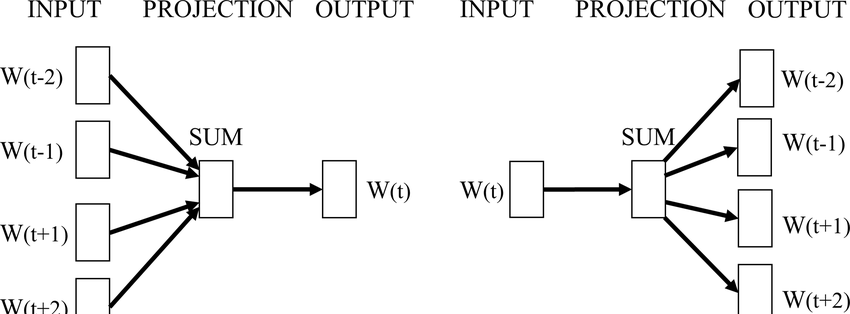

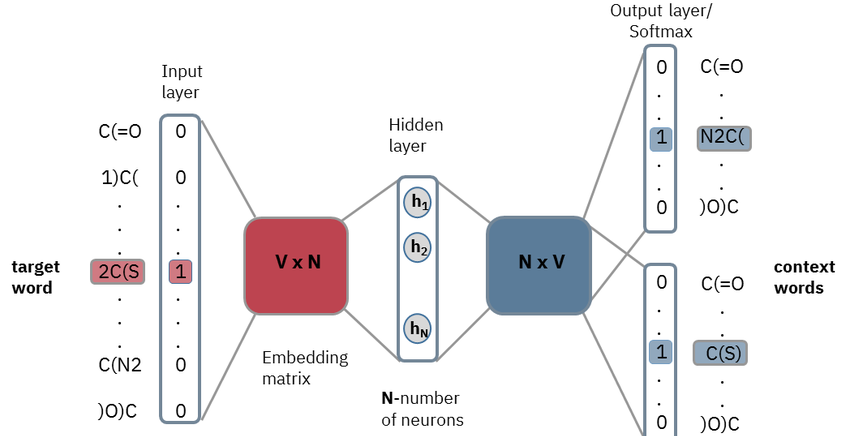

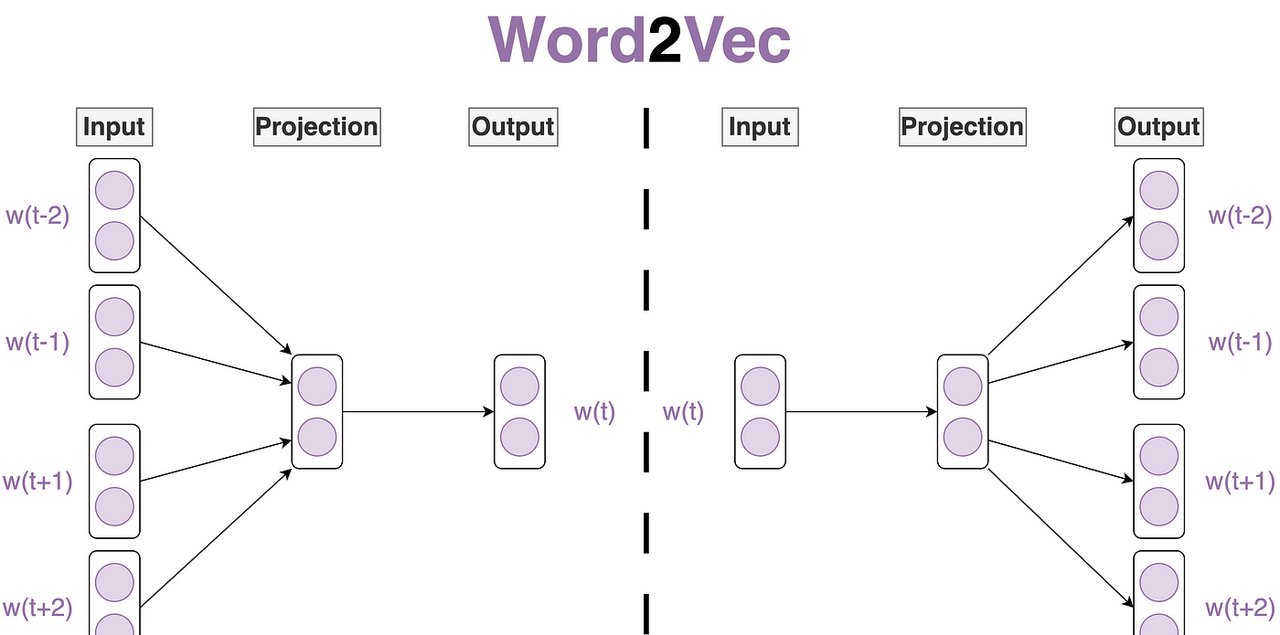

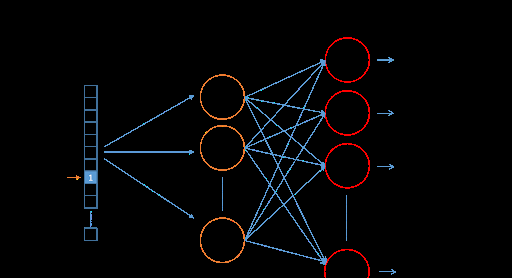

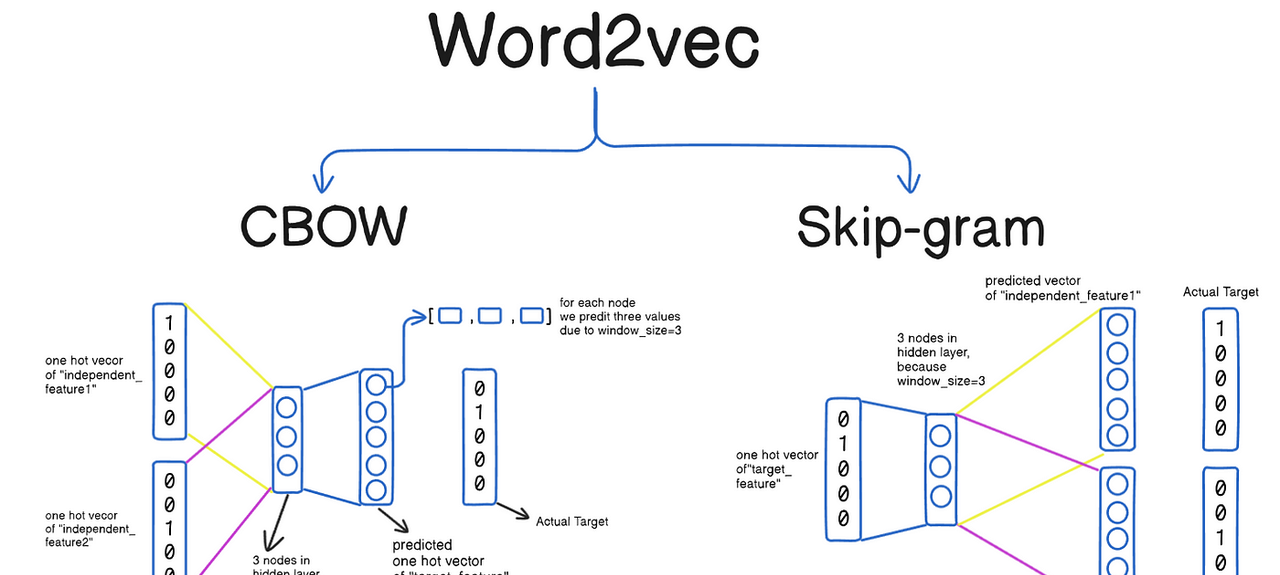

Word2Vec 的核心架构包括连续词袋模型(CBOW)和跳字模型(Skip-Gram)。CBOW 模型旨在通过上下文词向量预测中心词,假设我们有一个句子 “鸟儿在天空飞翔”,当以 “天空” 为中心词时,其上下文词为 “鸟儿”“在”“飞翔” 。模型首先将上下文词的 One-Hot 编码输入嵌入层,通过查找嵌入矩阵得到对应的词向量,再对这些词向量进行平均池化操作,将得到的固定长度向量输入到 Softmax 层,输出中心词在整个词汇表上的概率分布。其目标函数是最大化给定上下文词时中心词出现的条件概率,即:

( underset{ heta}{argmax}prod_{t=1}^{T}log P(w_t|w_{t – c},cdots,w_{t + c}) )

其中,(T)是语料库中词的总数,(w_t)是第(t)个词,(c)是上下文窗口大小,( heta)是模型参数 。

跳字模型则是反向操作,通过中心词预测上下文词。仍以上述句子为例,当以 “天空” 为中心词时,模型利用中心词 “天空” 的词向量,通过神经网络预测其上下文词 “鸟儿”“在”“飞翔” 的概率分布。跳字模型通过优化中心词对上下文词的联合概率分布来学习词向量,目标函数为:

( underset{ heta}{argmax}prod_{t=1}^{T}prod_{-cleq jleq c,j

eq0}log P(w_{t + j}|w_t) )

这种模型更关注局部词序信息,在处理长距离依赖和低频词时表现更优,因为它对每个中心词都进行多次预测,能更充分地学习到低频词的语义信息。

(二)高效训练技术

在大规模语料库上训练 Word2Vec 模型时,Softmax 层的计算复杂度成为瓶颈。传统 Softmax 计算需要对整个词汇表进行归一化操作,计算量与词汇表大小(V)成正比,当(V)很大时,计算效率极低。为解决这一问题,Word2Vec 引入了层次 Softmax 和负采样技术 。

层次 Softmax 利用哈夫曼树结构将词汇表组织成树形结构,每个叶子节点对应一个单词,内部节点用于决策。计算某个词的概率时,只需沿着从根节点到该词对应叶子节点的路径进行计算,将归一化计算复杂度从(O(V))降低到(O(log V))。例如,对于一个包含 10000 个单词的词汇表,传统 Softmax 需要计算 10000 次指数运算和一次归一化求和,而层次 Softmax 在哈夫曼树高度为 14((log_2{10000}approx14))的情况下,只需进行 14 次二分类运算(每个内部节点对应一次二分类),大大提升了训练效率 。

负采样技术则通过随机选取负例样本(即与中心词在上下文中不共现的词)来替代对整个词汇表的计算。对于每个正样本(中心词 – 上下文词对),随机采样(k)个负样本,模型训练时仅更新正样本和负样本相关的词向量,聚焦于高频共现关系的学习 。

假设词汇表大小为(V),传统 Softmax 在每次更新时需要计算(V)个词的概率,而负采样在(k = 5)时,每次仅需计算(1 + 5)个词(1 个正样本词和 5 个负样本词)的概率,在保证模型性能的前提下,显著减少了计算量,平衡了模型训练的精度与速度 。

三、GloVe 模型原理与优化

(一)全局共现矩阵与语义空间构建

GloVe(Global Vectors for Word Representation)于 2014 年被提出 ,它旨在融合全局统计信息与词向量学习,通过对大规模语料库中词共现关系的深入挖掘,构建出更具语义表达能力的词向量。与 Word2Vec 不同,GloVe 模型并不直接基于神经网络进行训练,而是通过对全局共现矩阵的分析与优化来获取词向量。

GloVe 整合全局语料统计信息,通过构建词共现矩阵 X(其中(X_{ij})表示词语 i 与 j 在固定窗口内的共现次数),将词向量间的点积与共现概率对数建立映射关系。核心假设为:词向量内积应近似于共现概率的对数比率,即:

(w_i^Tw_j + b_i + b_j = log(X_{ij}))

通过加权最小二乘损失函数优化:

( ext{Loss} = sum_{i,j=1}^V f(X_{ij})(w_i^Tw_j + b_i + b_j – log X_{ij})^2)

其中权重函数 f (X) 平衡高频词与低频词的训练贡献,避免共现矩阵的稀疏性影响。例如,在 “苹果是一种水果,我喜欢吃苹果” 这句话中,“苹果” 与 “水果”“喜欢”“吃” 等词在一定窗口内共现,通过统计这些共现次数构建共现矩阵,进而学习它们之间的语义关系。

(二)模型特性分析

全局与局部信息融合:相较于 Word2Vec 依赖局部上下文窗口,GloVe 利用全局共现统计,在捕捉词语长期依赖和语义类比关系(如 “国王 – 男人 + 女人 = 女王”)上表现更优。因为它考虑了整个语料库中词语的共现情况,能从更宏观的角度把握词语间的语义联系,在处理语义复杂、依赖关系长的文本时优势明显 。

时间复杂度优化:通过稀疏矩阵分解技术处理大规模语料,在保证语义表征能力的同时,降低计算成本,适用于亿级单词量的训练任务。GloVe 利用共现矩阵的稀疏性,仅对非零元素进行计算和优化,大大减少了不必要的计算开销,提高了训练效率 。

四、模型对比与性能分析

(一)技术路径差异

Word2Vec 与 GloVe 虽然都致力于词向量生成,但技术路径上存在显著差异。Word2Vec 基于局部上下文窗口,通过神经网络预测来学习词向量,其 CBOW 与 Skip-Gram 模型专注于上下文与中心词的局部关系捕捉 。而 GloVe 则从全局语料出发,构建共现矩阵并通过矩阵分解和回归拟合获取词向量,更强调词汇间的全局共现统计关系 。具体对比如下:

|

特征 |

Word2Vec |

GloVe |

|

信息来源 |

局部上下文窗口 |

全局共现矩阵 |

|

建模方式 |

神经网络概率预测 |

矩阵分解与回归拟合 |

|

稀疏性处理 |

负采样与层次 Softmax |

加权最小二乘损失函数 |

|

语义颗粒度 |

侧重语法与近邻语义 |

强化全局语义相关性 |

(二)实证性能对比

在标准语义类比任务(如 Google Analogy Test Set)中,GloVe 在动词时态、名词单复数等语法关系上准确率达 78.2%,略高于 Word2Vec 的 75.3%;而在低频词处理中,Skip-Gram 模型凭借上下文预测机制,对出现次数 < 5 的词语表征误差降低 12%。实际应用中,Word2Vec 在实时推荐系统中因训练速度快(单卡处理百万词耗时 < 30 分钟)更受青睐,GloVe 则在需要深层语义理解的问答系统中表现更佳 。

五、典型应用场景

(一)文本分类与情感分析

在文本分类与情感分析任务中,词向量作为关键输入特征,为模型理解文本语义提供基础。以 IMDB 影评数据集为例,该数据集包含大量用户对电影的评论,且标注了正面或负面的情感倾向,是评估情感分析模型性能的常用基准 。将 Word2Vec 与 GloVe 生成的词向量分别结合卷积神经网络(CNN)和循环神经网络(RNN)进行情感分类实验。实验结果显示,使用 GloVe 预训练向量的模型,情感分类准确率达到了 92.1% 。这主要得益于 GloVe 对全局共现信息的利用,能够更精准地捕捉到情感词之间细微的语义差异。例如,对于 “失望” 和 “遗憾” 这两个情感词,虽然语义相近,但在不同语境下表达的情感强度和侧重点有所不同,GloVe 通过分析大规模语料中的共现关系,能更好地区分这些差异,从而提升分类准确率。相比之下,Word2Vec 基于局部上下文窗口学习,其模型准确率为 91.2%,在处理复杂情感语义时稍显逊色 。

(二)跨语言语义对齐

跨语言语义对齐是机器翻译等任务的核心环节,旨在建立不同语言词汇之间的语义对应关系。在中英机器翻译任务中,通过对齐中英两种语言的词向量空间,可提升翻译的准确性。当平行语料不足(<10 万句对)时,Word2Vec 的 Skip-Gram 模型表现出更强的稳健性,其 BLEU(Bilingual Evaluation Understudy)值达到 28.7。Skip-Gram 模型通过中心词预测上下文词的方式,能够在有限数据下更有效地学习到词汇的局部语义特征,对于构建小规模的跨语言词向量映射较为有效 。然而,当拥有大规模语料(>100 万句对)时,GloVe 模型的优势凸显,BLEU 值提升至 31.2。这是因为 GloVe 利用全局共现统计信息,能够挖掘出词汇在不同语言中的深层语义联系,在大规模数据的支撑下,构建出更全面、准确的跨语言语义映射,从而显著提高机器翻译的质量 。

(三)知识图谱补全

知识图谱补全旨在通过已有的实体和关系,预测缺失的关系,以完善知识图谱的结构。Word2Vec 和 GloVe 生成的词向量,可利用其语义距离计算来预测实体间关系 。例如在判断 “首都 – 国家” 的对应关系时,两种模型均能依据词向量的语义相似性进行有效预测。对于知识库中出现次数 < 100 的稀疏实体,GloVe 的关系预测准确率比 Word2Vec 高 9.3%。这是由于 GloVe 对全局共现矩阵的分析,使其在处理低频、稀疏实体时,能够借助全局信息更好地表征实体语义,挖掘出实体之间潜在的关系,而 Word2Vec 在面对稀疏数据时,因依赖局部上下文,难以充分捕捉实体语义,导致关系预测能力相对较弱 。

六、挑战与未来方向

(一)现存问题

多义性处理:Word2Vec 与 GloVe 在处理多义词时存在局限,由于缺乏动态上下文感知能力,对于像 “苹果” 既表示水果又表示公司这类多义词,难以根据具体语境生成准确的语义向量 。在 “我吃了一个苹果” 和 “苹果发布了新产品” 这两个句子中,上述模型生成的 “苹果” 词向量相同,无法体现其在不同语境下的语义差异。未来可结合 ELMo、BERT 等基于上下文的词嵌入技术,通过双向 LSTM、Transformer 等模型结构对上下文信息进行深度编码,为多义词提供更精准的动态语义表征,提升模型在多义性场景下的理解能力 。

领域适应性:基于通用语料训练的 Word2Vec 和 GloVe 词向量,在生物医学、法律等专业领域应用时,性能会显著下降。专业领域存在大量领域特定词汇和术语,其语义关系与通用语料有较大差异 。在生物医学领域,“基因”“抗体” 等专业词汇在通用语料中的共现模式与专业文献不同,导致通用词向量无法准确捕捉其语义。后续需要探索领域定制化训练策略,利用领域内大规模专业语料重新训练或微调模型,引入领域本体知识辅助词向量学习,以提高模型在特定领域的表现 。

可解释性:尽管 Word2Vec 和 GloVe 能有效生成词向量,但向量维度的语义含义难以直观解读。高维向量空间中的每个维度对词语语义的贡献不清晰,阻碍了对模型决策过程的理解 。对于词向量 [0.2, -0.3, 0.1, …],难以判断每个维度数值代表的具体语义信息。后续需发展可视化与归因分析技术,如通过 t – SNE、PCA 等降维方法将高维向量可视化,结合注意力机制分析不同维度对语义计算的贡献,增强模型的可解释性,推动其在对解释性要求较高的金融、医疗等领域的应用 。

(二)前沿研究方向

混合模型架构:融合 Word2Vec 的局部预测优势与 GloVe 的全局统计特性,有望开发出更强大的词嵌入模型。FastText 模型结合了子词信息,通过对单词的字符 n – gram 进行建模,能有效提升低频词的表征能力 。对于一些罕见的专业术语或新出现的词汇,FastText 可利用子词信息学习其语义特征,弥补传统模型在低频词处理上的不足,为模型轻量化和泛化能力提升提供新思路 。未来可进一步探索不同模型架构的融合方式,如将 CBOW 与 GloVe 的矩阵分解相结合,优化模型在不同数据规模和语义任务下的性能 。

多模态语义融合:将图像视觉特征与词向量空间对齐,构建跨模态语义统一表征,是当前研究的热点方向。在图文检索任务中,通过将图像中的物体、场景等视觉元素与文本中的词汇语义建立联系,实现以图搜文、以文搜图 。当输入一张包含猫的图片时,模型可利用多模态语义融合技术,找到描述猫的文本信息。在视频描述任务中,将视频的时间序列视觉特征与文本语义融合,能够生成更准确、详细的视频文字描述,推动多媒体内容理解与检索技术的发展 。

增量学习机制:在社交媒体、新闻资讯等实时数据流场景下,数据不断更新,传统固定语料训练的词向量模型无法及时适应新数据中的语义变化 。设计动态更新算法,使模型在新增语料中持续优化词向量,是未来的重要研究方向。可采用在线学习策略,当有新文本到达时,模型能够快速更新词向量,保持对新出现词汇和语义关系的敏感度,提升模型在动态数据环境下的实用性和准确性 。

七、结论

Word2Vec 与 GloVe 作为词嵌入技术的双璧,分别代表了基于局部上下文的预测型模型与基于全局统计的矩阵分解型模型的最高水平。前者在效率与低频词处理上占优,后者在语义完整性与长期依赖捕捉上领先。未来研究需聚焦动态语义表征、领域迁移学习及多模态融合,推动词嵌入技术向更智能、更通用的语义理解体系演进,为自然语言处理从 “词法分析” 迈向 “深度语义认知” 奠定基础。

暂无评论内容