分布式计算在大数据可视化中的应用实践

关键词:分布式计算、大数据可视化、应用实践、数据处理、可视化展示

摘要:本文深入探讨了分布式计算在大数据可视化中的应用实践。首先介绍了分布式计算和大数据可视化的背景知识,包括目的、预期读者、文档结构等。接着阐述了核心概念及其联系,详细讲解了相关算法原理和具体操作步骤,通过数学模型和公式进行了理论支持,并给出实际例子。在项目实战部分,提供了开发环境搭建、源代码实现和解读。还分析了分布式计算在大数据可视化中的实际应用场景,推荐了相关工具和资源。最后总结了未来发展趋势与挑战,解答了常见问题并给出扩展阅读和参考资料,旨在为相关领域的技术人员和研究者提供全面的技术指导和实践参考。

1. 背景介绍

1.1 目的和范围

随着信息技术的飞速发展,大数据时代已经来临。大量的数据被产生和收集,如何从这些海量数据中提取有价值的信息并以直观的方式呈现给用户,成为了一个重要的研究课题。大数据可视化作为一种有效的手段,可以将复杂的数据转化为图形、图表等直观的形式,帮助用户更好地理解和分析数据。然而,处理和可视化大数据面临着诸多挑战,如数据量大、计算复杂度高、存储需求大等。分布式计算通过将计算任务分配到多个计算节点上并行执行,可以有效地解决这些问题。本文的目的在于探讨分布式计算在大数据可视化中的应用实践,包括相关技术原理、算法实现、实际案例分析等,为大数据可视化的研究和应用提供参考。

本文的范围涵盖了分布式计算和大数据可视化的基本概念、核心算法、数学模型、项目实战、实际应用场景、工具和资源推荐等方面。通过全面的介绍和分析,帮助读者深入了解分布式计算在大数据可视化中的应用。

1.2 预期读者

本文的预期读者包括大数据领域的技术人员、数据分析师、可视化设计师、软件开发者以及对分布式计算和大数据可视化感兴趣的研究者。对于有一定编程基础和数据处理经验的读者,本文可以提供深入的技术细节和实践案例;对于初学者,本文也会从基础概念开始介绍,逐步引导读者理解分布式计算在大数据可视化中的应用。

1.3 文档结构概述

本文共分为十个部分。第一部分为背景介绍,主要阐述了本文的目的、范围、预期读者和文档结构。第二部分介绍了分布式计算和大数据可视化的核心概念及其联系,并通过文本示意图和 Mermaid 流程图进行说明。第三部分详细讲解了核心算法原理和具体操作步骤,给出了 Python 源代码示例。第四部分介绍了相关的数学模型和公式,并进行详细讲解和举例说明。第五部分为项目实战,包括开发环境搭建、源代码详细实现和代码解读。第六部分分析了分布式计算在大数据可视化中的实际应用场景。第七部分推荐了相关的工具和资源,包括学习资源、开发工具框架和相关论文著作。第八部分总结了未来发展趋势与挑战。第九部分为附录,解答了常见问题。第十部分提供了扩展阅读和参考资料。

1.4 术语表

1.4.1 核心术语定义

分布式计算:是一种计算方式,将一个大型的计算任务分解成多个小的子任务,分配到多个计算节点上并行执行,最后将各个节点的计算结果汇总得到最终结果。大数据可视化:是指将海量、复杂的数据通过图形、图表、地图等直观的形式展示出来,帮助用户更好地理解和分析数据。数据分区:将大规模的数据划分为多个较小的子集,每个子集可以独立进行处理和存储。并行处理:多个计算任务同时执行,以提高计算效率。

1.4.2 相关概念解释

集群:由多个计算节点组成的计算机系统,这些节点通过网络连接在一起,协同完成计算任务。数据仓库:用于存储和管理大量数据的数据库系统,通常包含历史数据和实时数据。可视化工具:用于创建和展示可视化图表的软件工具,如 Tableau、PowerBI 等。

1.4.3 缩略词列表

Hadoop:一个开源的分布式计算平台,包括 HDFS(分布式文件系统)和 MapReduce(分布式计算框架)。Spark:一个快速通用的集群计算系统,提供了高效的数据处理和分析能力。ETL:Extract(抽取)、Transform(转换)、Load(加载)的缩写,是数据处理的常见流程。

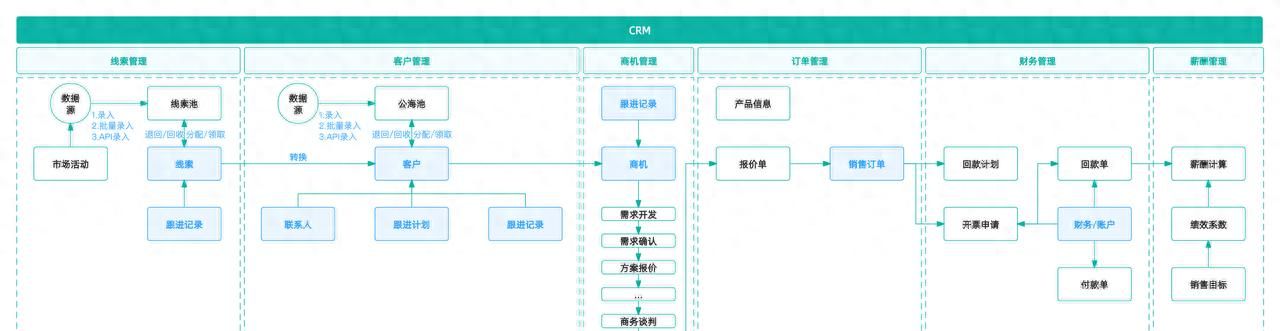

2. 核心概念与联系

2.1 分布式计算核心概念

分布式计算的核心思想是将一个复杂的计算任务分解成多个子任务,并将这些子任务分配到多个计算节点上并行执行。这样可以充分利用多个节点的计算资源,提高计算效率。常见的分布式计算框架有 Hadoop 和 Spark。

Hadoop 是一个开源的分布式计算平台,主要由 HDFS(分布式文件系统)和 MapReduce(分布式计算框架)组成。HDFS 用于存储大规模的数据,将数据分散存储在多个节点上,提供了高可靠性和高可扩展性。MapReduce 是一种编程模型,用于处理大规模数据集。它将计算任务分为 Map 和 Reduce 两个阶段,Map 阶段将输入数据进行处理,生成中间结果;Reduce 阶段将中间结果进行汇总和处理,得到最终结果。

Spark 是一个快速通用的集群计算系统,提供了比 Hadoop 更高效的数据处理和分析能力。Spark 基于内存计算,减少了数据的读写开销,提高了计算速度。它支持多种编程语言,如 Python、Java、Scala 等,提供了丰富的 API 接口,方便用户进行数据处理和分析。

2.2 大数据可视化核心概念

大数据可视化是指将海量、复杂的数据通过图形、图表、地图等直观的形式展示出来,帮助用户更好地理解和分析数据。大数据可视化的目的是将数据中的信息以直观的方式呈现给用户,让用户能够快速发现数据中的规律和趋势。

常见的大数据可视化类型包括柱状图、折线图、饼图、散点图、地图等。不同的可视化类型适用于不同的数据类型和分析目的。例如,柱状图适用于比较不同类别之间的数据大小;折线图适用于展示数据的变化趋势;饼图适用于展示各部分占总体的比例;散点图适用于发现数据之间的关系;地图适用于展示地理数据。

2.3 分布式计算与大数据可视化的联系

分布式计算为大数据可视化提供了强大的计算支持。在大数据可视化过程中,需要对海量的数据进行处理和分析,如数据清洗、数据挖掘、统计分析等。这些计算任务通常具有较高的复杂度和计算量,单台计算机难以完成。分布式计算可以将这些计算任务分配到多个计算节点上并行执行,大大提高了计算效率,使得大数据可视化能够在较短的时间内完成。

同时,大数据可视化也为分布式计算提供了直观的展示方式。通过可视化图表,用户可以直观地了解分布式计算的结果,发现数据中的规律和趋势,为决策提供支持。例如,在分布式计算中,可以通过可视化图表展示各个节点的计算性能、数据处理进度等信息,帮助用户监控和管理分布式计算系统。

2.4 文本示意图和 Mermaid 流程图

2.4.1 文本示意图

分布式计算在大数据可视化中的应用流程可以用以下文本示意图表示:

大数据源 --> 数据采集 --> 数据存储(分布式文件系统) --> 数据处理(分布式计算框架) --> 数据可视化(可视化工具) --> 用户

这个示意图展示了从大数据源到用户的整个流程。首先,从大数据源中采集数据,然后将数据存储在分布式文件系统中。接着,使用分布式计算框架对数据进行处理,如数据清洗、数据挖掘、统计分析等。最后,使用可视化工具将处理后的数据以直观的形式展示给用户。

2.4.2 Mermaid 流程图

graph LR

A[大数据源] --> B[数据采集]

B --> C[数据存储(分布式文件系统)]

C --> D[数据处理(分布式计算框架)]

D --> E[数据可视化(可视化工具)]

E --> F[用户]

这个 Mermaid 流程图与文本示意图表达的意思相同,更加直观地展示了分布式计算在大数据可视化中的应用流程。

3. 核心算法原理 & 具体操作步骤

3.1 数据分区算法

在分布式计算中,数据分区是一个重要的步骤。数据分区的目的是将大规模的数据划分为多个较小的子集,每个子集可以独立进行处理和存储。常见的数据分区算法有哈希分区、范围分区和随机分区。

3.1.1 哈希分区算法原理

哈希分区算法是根据数据的哈希值将数据分配到不同的分区中。具体步骤如下:

选择一个哈希函数,对数据的某个属性(如主键)进行哈希计算,得到一个哈希值。根据哈希值和分区数量,计算数据应该分配到的分区编号。将数据分配到对应的分区中。

3.1.2 哈希分区算法 Python 实现

def hash_partition(data, num_partitions):

partitions = [[] for _ in range(num_partitions)]

for item in data:

# 假设数据的第一个元素是主键

key = item[0]

hash_value = hash(key)

partition_index = hash_value % num_partitions

partitions[partition_index].append(item)

return partitions

# 示例数据

data = [(1, 'A'), (2, 'B'), (3, 'C'), (4, 'D'), (5, 'E')]

num_partitions = 3

partitions = hash_partition(data, num_partitions)

for i, partition in enumerate(partitions):

print(f"Partition {i}: {partition}")

3.2 并行处理算法

并行处理是分布式计算的核心思想之一。在大数据可视化中,需要对大量的数据进行处理和分析,并行处理可以提高计算效率。常见的并行处理算法有 MapReduce 和 Spark 的 RDD(弹性分布式数据集)操作。

3.2.1 MapReduce 算法原理

MapReduce 是一种编程模型,用于处理大规模数据集。它将计算任务分为 Map 和 Reduce 两个阶段。

Map 阶段:将输入数据进行处理,生成中间结果。每个 Map 任务独立处理一部分输入数据,输出一系列的键值对。Reduce 阶段:将中间结果进行汇总和处理,得到最终结果。Reduce 任务接收来自多个 Map 任务的中间结果,对相同键的值进行合并和处理。

3.2.2 MapReduce 算法 Python 实现

# 示例数据

data = ["hello world", "hello python", "python is great"]

# Map 函数

def map_function(line):

words = line.split()

result = []

for word in words:

result.append((word, 1))

return result

# Reduce 函数

def reduce_function(key, values):

return (key, sum(values))

# Map 阶段

map_results = []

for line in data:

map_results.extend(map_function(line))

# 分组

grouped_results = {}

for key, value in map_results:

if key not in grouped_results:

grouped_results[key] = []

grouped_results[key].append(value)

# Reduce 阶段

reduce_results = []

for key, values in grouped_results.items():

reduce_results.append(reduce_function(key, values))

print(reduce_results)

3.3 具体操作步骤

3.3.1 数据采集

从各种数据源中采集数据,如数据库、文件系统、传感器等。可以使用 Python 的第三方库,如 Pandas、SQLAlchemy 等进行数据采集。

3.3.2 数据存储

将采集到的数据存储在分布式文件系统中,如 HDFS。可以使用 Hadoop 的命令行工具或 Python 的 HDFS 客户端库进行数据存储。

3.3.3 数据处理

使用分布式计算框架对数据进行处理,如 Hadoop 的 MapReduce 或 Spark。根据具体的需求选择合适的算法和工具进行数据处理。

3.3.4 数据可视化

使用可视化工具将处理后的数据以直观的形式展示出来,如 Tableau、PowerBI 或 Python 的可视化库,如 Matplotlib、Seaborn 等。

4. 数学模型和公式 & 详细讲解 & 举例说明

4.1 数据分区数学模型

4.1.1 哈希分区数学模型

哈希分区的数学模型可以表示为:

其中,ppp 是分区编号,h(k)h(k)h(k) 是哈希函数对键 kkk 的哈希值,nnn 是分区数量。

例如,假设有一个数据集,键的范围是 [1,10][1, 10][1,10],分区数量 n=3n = 3n=3。选择哈希函数 h(k)=kh(k) = kh(k)=k,则键 k=1k = 1k=1 的哈希值为 111,分区编号 p=1 mod 3=1p = 1 mod 3 = 1p=1mod3=1;键 k=2k = 2k=2 的哈希值为 222,分区编号 p=2 mod 3=2p = 2 mod 3 = 2p=2mod3=2;键 k=3k = 3k=3 的哈希值为 333,分区编号 p=3 mod 3=0p = 3 mod 3 = 0p=3mod3=0。

4.1.2 范围分区数学模型

范围分区是根据数据的某个属性值将数据划分为不同的范围,每个范围对应一个分区。假设数据的属性值为 xxx,分区范围为 [r0,r1),[r1,r2),⋯ ,[rn−1,rn][r_0, r_1), [r_1, r_2), cdots, [r_{n – 1}, r_n][r0,r1),[r1,r2),⋯,[rn−1,rn],则分区编号 ppp 可以表示为:

例如,假设有一个数据集,属性值的范围是 [1,10][1, 10][1,10],分区范围为 [1,4),[4,7),[7,10][1, 4), [4, 7), [7, 10][1,4),[4,7),[7,10],则属性值 x=2x = 2x=2 属于第一个分区,分区编号 p=0p = 0p=0;属性值 x=5x = 5x=5 属于第二个分区,分区编号 p=1p = 1p=1;属性值 x=8x = 8x=8 属于第三个分区,分区编号 p=2p = 2p=2。

4.2 并行处理数学模型

4.2.1 MapReduce 数学模型

MapReduce 的数学模型可以用以下公式表示:

Map 阶段:

输入:I={i1,i2,⋯ ,im}I = {i_1, i_2, cdots, i_m}I={i1,i2,⋯,im}

输出:M={m1,m2,⋯ ,mn}M = {m_1, m_2, cdots, m_n}M={m1,m2,⋯,mn}

其中,mj=Map(ik)m_j = ext{Map}(i_k)mj=Map(ik),ik∈Ii_k in Iik∈I

Reduce 阶段:

输入:M={m1,m2,⋯ ,mn}M = {m_1, m_2, cdots, m_n}M={m1,m2,⋯,mn}

输出:R={r1,r2,⋯ ,rs}R = {r_1, r_2, cdots, r_s}R={r1,r2,⋯,rs}

其中,rl=Reduce(k,{v1,v2,⋯ ,vt})r_l = ext{Reduce}(k, {v_1, v_2, cdots, v_t})rl=Reduce(k,{v1,v2,⋯,vt}),kkk 是键,{v1,v2,⋯ ,vt}{v_1, v_2, cdots, v_t}{v1,v2,⋯,vt} 是相同键的值集合。

例如,假设有一个数据集 I={“helloworld”,”hellopython”,”pythonisgreat”}I = {“hello world”, “hello python”, “python is great”}I={“helloworld”,”hellopython”,”pythonisgreat”},Map 函数将每个单词映射为 (word,1)(word, 1)(word,1) 的键值对,Reduce 函数将相同单词的计数相加。则 Map 阶段的输出 MMM 为:

Reduce 阶段的输出 RRR 为:

4.3 举例说明

4.3.1 数据分区举例

假设有一个数据集,包含以下记录:

| ID | Name |

|---|---|

| 1 | Alice |

| 2 | Bob |

| 3 | Charlie |

| 4 | David |

| 5 | Eve |

使用哈希分区算法,分区数量 n=2n = 2n=2,哈希函数 h(k)=kh(k) = kh(k)=k。则记录的分区情况如下:

| ID | Name | 分区编号 |

|---|---|---|

| 1 | Alice | 1 |

| 2 | Bob | 0 |

| 3 | Charlie | 1 |

| 4 | David | 0 |

| 5 | Eve | 1 |

4.3.2 并行处理举例

假设有一个数据集,包含以下单词:

使用 MapReduce 算法进行单词计数。Map 函数将每个单词映射为 (word,1)(word, 1)(word,1) 的键值对,Reduce 函数将相同单词的计数相加。则 Map 阶段的输出 MMM 为:

分组后得到:

Reduce 阶段的输出 RRR 为:

5. 项目实战:代码实际案例和详细解释说明

5.1 开发环境搭建

5.1.1 安装 Hadoop

Hadoop 是一个开源的分布式计算平台,用于存储和处理大规模数据。可以按照以下步骤安装 Hadoop:

下载 Hadoop 安装包,从官方网站(https://hadoop.apache.org/releases.html)选择合适的版本进行下载。解压安装包到指定目录,例如

/usr/local/hadoop

~/.bashrc

export HADOOP_HOME=/usr/local/hadoop

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

使环境变量生效,执行

source ~/.bashrc

core-site.xml

hdfs-site.xml

mapred-site.xml

yarn-site.xml

5.1.2 安装 Spark

Spark 是一个快速通用的集群计算系统,提供了高效的数据处理和分析能力。可以按照以下步骤安装 Spark:

下载 Spark 安装包,从官方网站(https://spark.apache.org/downloads.html)选择合适的版本进行下载。解压安装包到指定目录,例如

/usr/local/spark

~/.bashrc

export SPARK_HOME=/usr/local/spark

export PATH=$PATH:$SPARK_HOME/bin

使环境变量生效,执行

source ~/.bashrc

5.1.3 安装 Python 和相关库

安装 Python 3.x 版本,并使用

pip

pip install pandas matplotlib seaborn

5.2 源代码详细实现和代码解读

5.2.1 数据采集和存储

以下是一个使用 Python 从 CSV 文件中采集数据并存储到 HDFS 的示例代码:

import pandas as pd

from hdfs import InsecureClient

# 读取 CSV 文件

data = pd.read_csv('data.csv')

# 连接到 HDFS

client = InsecureClient('http://localhost:50070', user='hadoop')

# 将数据保存为 CSV 文件到 HDFS

client.write('/user/hadoop/data.csv', data.to_csv(sep=' ', na_rep='nan'), overwrite=True)

代码解读:

pandas

hdfs

client.write

5.2.2 数据处理(Spark 示例)

以下是一个使用 Spark 进行数据处理的示例代码:

from pyspark.sql import SparkSession

# 创建 SparkSession

spark = SparkSession.builder

.appName("DataProcessing")

.getOrCreate()

# 从 HDFS 读取数据

df = spark.read.csv("hdfs://localhost:9000/user/hadoop/data.csv", header=True, inferSchema=True)

# 进行数据处理,例如计算每个列的平均值

avg_df = df.select(*[spark.mean(col).alias(col + '_avg') for col in df.columns])

# 显示结果

avg_df.show()

# 停止 SparkSession

spark.stop()

代码解读:

SparkSession

spark.read.csv

df.select

spark.mean

avg_df.show()

spark.stop()

5.2.3 数据可视化

以下是一个使用 Matplotlib 进行数据可视化的示例代码:

import pandas as pd

import matplotlib.pyplot as plt

# 从 HDFS 读取数据

client = InsecureClient('http://localhost:50070', user='hadoop')

data = client.read('/user/hadoop/data.csv')

df = pd.read_csv(pd.compat.StringIO(data.decode('utf-8')), sep=' ')

# 绘制柱状图

df.plot(kind='bar')

plt.title('Data Visualization')

plt.xlabel('X-axis')

plt.ylabel('Y-axis')

plt.show()

代码解读:

pandas

matplotlib.pyplot

df.plot(kind='bar')

plt.title

plt.xlabel

plt.ylabel

plt.show()

5.3 代码解读与分析

5.3.1 数据采集和存储代码分析

在数据采集和存储代码中,使用

pandas

pandas

hdfs

hdfs

5.3.2 数据处理代码分析

在数据处理代码中,使用

SparkSession

SparkSession

SparkContext

SQLContext

HiveContext

spark.read.csv

df.select

spark.mean

5.3.3 数据可视化代码分析

在数据可视化代码中,使用

pandas

matplotlib.pyplot

matplotlib

6. 实际应用场景

6.1 金融领域

在金融领域,分布式计算和大数据可视化可以用于风险评估、投资分析和市场趋势预测等方面。例如,银行可以收集大量的客户交易数据、信用数据和市场数据,使用分布式计算框架对这些数据进行处理和分析,如计算客户的信用评分、预测市场的走势等。然后,使用大数据可视化工具将分析结果以直观的形式展示给银行的管理人员和分析师,帮助他们做出更明智的决策。

6.2 医疗领域

在医疗领域,分布式计算和大数据可视化可以用于疾病预测、医疗质量评估和药物研发等方面。例如,医院可以收集大量的患者病历数据、医疗影像数据和基因数据,使用分布式计算框架对这些数据进行处理和分析,如预测疾病的发生风险、评估医疗质量等。然后,使用大数据可视化工具将分析结果以直观的形式展示给医生和研究人员,帮助他们更好地了解患者的病情和疾病的发展趋势。

6.3 交通领域

在交通领域,分布式计算和大数据可视化可以用于交通流量预测、智能交通管理和交通事故分析等方面。例如,交通管理部门可以收集大量的交通传感器数据、车辆行驶数据和地图数据,使用分布式计算框架对这些数据进行处理和分析,如预测交通流量、优化交通信号控制等。然后,使用大数据可视化工具将分析结果以直观的形式展示给交通管理人员和驾驶员,帮助他们更好地规划出行路线和避免交通拥堵。

6.4 电商领域

在电商领域,分布式计算和大数据可视化可以用于用户行为分析、商品推荐和市场营销等方面。例如,电商平台可以收集大量的用户浏览数据、购买数据和评价数据,使用分布式计算框架对这些数据进行处理和分析,如分析用户的购买偏好、推荐个性化的商品等。然后,使用大数据可视化工具将分析结果以直观的形式展示给电商平台的管理人员和营销人员,帮助他们更好地了解用户需求和制定营销策略。

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

《Hadoop实战》:详细介绍了 Hadoop 的原理、架构和应用,是学习 Hadoop 的经典书籍。《Spark快速大数据分析》:介绍了 Spark 的核心概念、编程模型和应用案例,帮助读者快速掌握 Spark 的使用。《Python数据可视化实战》:介绍了 Python 中常用的可视化库,如 Matplotlib、Seaborn 等,通过实际案例讲解如何使用这些库进行数据可视化。

7.1.2 在线课程

Coursera 上的“大数据基础”课程:介绍了大数据的基本概念、技术和应用,包括分布式计算、数据存储和数据分析等方面。edX 上的“Spark 数据分析”课程:深入介绍了 Spark 的编程模型和应用,通过实际项目让读者掌握 Spark 的使用。网易云课堂上的“Python 数据可视化实战”课程:详细介绍了 Python 中常用的可视化库,通过实际案例让读者掌握数据可视化的技巧。

7.1.3 技术博客和网站

Apache Hadoop 官方网站:提供了 Hadoop 的最新文档、教程和社区资源。Apache Spark 官方网站:提供了 Spark 的最新文档、教程和社区资源。Medium 上的大数据和可视化相关博客:有很多大数据和可视化领域的专家分享的技术文章和经验。

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

PyCharm:是一款专业的 Python 集成开发环境,提供了丰富的代码编辑、调试和测试功能。IntelliJ IDEA:是一款功能强大的 Java 集成开发环境,也支持 Python 和其他编程语言。Visual Studio Code:是一款轻量级的代码编辑器,支持多种编程语言,具有丰富的插件和扩展功能。

7.2.2 调试和性能分析工具

Spark UI:是 Spark 自带的可视化工具,用于监控和分析 Spark 应用程序的运行状态和性能。Hadoop YARN ResourceManager UI:用于监控和管理 Hadoop 集群的资源使用情况。Py-Spy:是一款 Python 性能分析工具,用于分析 Python 代码的性能瓶颈。

7.2.3 相关框架和库

Hadoop:是一个开源的分布式计算平台,包括 HDFS 和 MapReduce 等组件。Spark:是一个快速通用的集群计算系统,提供了高效的数据处理和分析能力。Pandas:是 Python 中常用的数据处理库,提供了强大的数据结构和数据操作功能。Matplotlib:是 Python 中常用的可视化库,提供了丰富的绘图功能。Seaborn:是基于 Matplotlib 的高级可视化库,提供了更美观和简洁的绘图接口。

7.3 相关论文著作推荐

7.3.1 经典论文

“MapReduce: Simplified Data Processing on Large Clusters”:介绍了 MapReduce 编程模型的原理和应用,是分布式计算领域的经典论文。“Resilient Distributed Datasets: A Fault-Tolerant Abstraction for In-Memory Cluster Computing”:介绍了 Spark 的 RDD 编程模型的原理和应用,是 Spark 领域的经典论文。

7.3.2 最新研究成果

可以通过学术搜索引擎,如 Google Scholar、IEEE Xplore 等,搜索分布式计算和大数据可视化领域的最新研究成果。

7.3.3 应用案例分析

可以参考一些大数据和可视化领域的行业报告和案例分析,了解分布式计算在实际应用中的成功案例和经验。

8. 总结:未来发展趋势与挑战

8.1 未来发展趋势

8.1.1 实时性要求提高

随着大数据的快速发展,对数据处理和可视化的实时性要求越来越高。未来,分布式计算和大数据可视化将更加注重实时性,能够在短时间内处理和展示大量的实时数据。

8.1.2 智能化发展

人工智能和机器学习技术的不断发展将推动分布式计算和大数据可视化向智能化方向发展。例如,通过机器学习算法自动识别数据中的模式和趋势,并以可视化的形式展示给用户。

8.1.3 跨平台和跨设备支持

未来,大数据可视化工具将支持更多的平台和设备,如移动设备、智能手表等,方便用户随时随地查看和分析数据。

8.1.4 与物联网融合

物联网的发展将产生大量的传感器数据,分布式计算和大数据可视化将与物联网技术深度融合,实现对物联网数据的实时处理和可视化展示。

8.2 挑战

8.2.1 数据安全和隐私问题

在大数据时代,数据安全和隐私问题成为了一个重要的挑战。分布式计算和大数据可视化需要处理大量的敏感数据,如何保证数据的安全和隐私是一个亟待解决的问题。

8.2.2 系统复杂性和管理难度

分布式计算系统通常具有较高的复杂性,包括多个计算节点、存储节点和网络设备等。如何有效地管理和维护这些系统,提高系统的可靠性和性能是一个挑战。

8.2.3 数据质量问题

大数据的质量往往参差不齐,存在数据缺失、错误和不一致等问题。如何处理和清洗这些数据,提高数据的质量是大数据可视化的一个重要挑战。

8.2.4 人才短缺问题

分布式计算和大数据可视化是一个新兴的领域,需要具备相关技术和知识的专业人才。目前,该领域的人才短缺问题比较严重,如何培养和吸引更多的专业人才是一个挑战。

9. 附录:常见问题与解答

9.1 分布式计算和并行计算有什么区别?

分布式计算是指将一个大型的计算任务分解成多个小的子任务,分配到多个计算节点上并行执行,这些节点通常通过网络连接在一起。并行计算是指多个计算任务同时执行,可以在单个计算机的多个处理器上执行,也可以在多个计算机组成的集群上执行。分布式计算强调的是计算任务的分布和协同,而并行计算强调的是计算任务的同时执行。

9.2 大数据可视化有哪些常用的工具?

常见的大数据可视化工具包括 Tableau、PowerBI、QlikView、D3.js、Highcharts 等。这些工具提供了丰富的可视化图表类型和交互功能,方便用户创建和展示可视化图表。

9.3 如何选择合适的分布式计算框架?

选择合适的分布式计算框架需要考虑以下因素:

数据规模:如果数据规模较小,可以选择一些轻量级的分布式计算框架;如果数据规模较大,需要选择具有高可扩展性的分布式计算框架。计算需求:如果计算任务主要是批处理任务,可以选择 Hadoop 的 MapReduce 或 Spark;如果计算任务主要是实时计算任务,可以选择 Spark Streaming 或 Flink。编程语言支持:不同的分布式计算框架支持不同的编程语言,需要根据自己的编程习惯选择合适的框架。

9.4 如何提高大数据可视化的性能?

可以从以下几个方面提高大数据可视化的性能:

数据预处理:在进行可视化之前,对数据进行清洗、聚合和筛选等预处理操作,减少数据量。选择合适的可视化工具:不同的可视化工具具有不同的性能特点,需要根据数据规模和可视化需求选择合适的工具。使用分布式计算:对于大规模的数据可视化,可以使用分布式计算框架对数据进行处理和分析,提高计算效率。优化可视化图表:选择合适的可视化图表类型,避免使用过于复杂的图表,减少渲染时间。

10. 扩展阅读 & 参考资料

10.1 扩展阅读

《大数据时代:生活、工作与思维的大变革》:介绍了大数据时代的背景、挑战和机遇,以及大数据对社会和生活的影响。《数据之巅:大数据革命,历史、现实与未来》:讲述了大数据的发展历程和应用案例,以及大数据对各个领域的影响。《可视化与视觉思维》:介绍了可视化的基本原理和方法,以及如何通过可视化来提高思维能力和决策能力。

10.2 参考资料

Apache Hadoop 官方文档:https://hadoop.apache.org/docs/Apache Spark 官方文档:https://spark.apache.org/docs/Pandas 官方文档:https://pandas.pydata.org/docs/Matplotlib 官方文档:https://matplotlib.org/stable/contents.htmlSeaborn 官方文档:https://seaborn.pydata.org/

暂无评论内容